Как получить список адресов всех страниц сайта, включая скрытые?

Всем привет. Народ, подскажите какие-нибудь сервисы или скрипт чтобы получит/вывести все ссылки на страницы сайта. Заранее спасибо.

- Вопрос задан более трёх лет назад

- 84376 просмотров

1 комментарий

Оценить 1 комментарий

Вот тут есть сервис https://iksweb.ru/tools/check-search/ по сбору страниц сайта в ПС Яндекс. Можно быстро узнать объём конкурентов или получить список страниц с заголовками и описанием.

Решения вопроса 2

Гугли сервисы «генератор карты сайта (sitemap)»

Ответ написан более трёх лет назад

Комментировать

Нравится 5 Комментировать

Меня все знают как WebDiez.

Ответ написан более трёх лет назад

Нравится 2 1 комментарий

Нужно быть осторожным с этим ресурсом, не все страницы выдает.

На сайте, который сделан на Opencart , https://www.xml-sitemaps.com/ не все страницы нашел. Там их и не особо много было, порядка 90. Но отдельные, типа страницы регистрации, почему то он не нашел.

Ответы на вопрос 1

slrmclaren722 @slrmclaren722

А если например страница требует авторизации как быть?

Ответ написан более трёх лет назад

Stalker_darkway @hronik87 Автор вопроса

Если сайт закрыт, то либо настраивать доступ для сервисов, либо отказываться от этой идеи.

Если сайт открыт, то будет получена ссылка на страницу авторизации и скрипт пойдет дальше смотреть остальные ссылки.

Как получить список URL всех страниц сайта

Здравствуйте. Извиняюсь если пишу не в том разделе. Подскажите как получить список URLов всех страниц сайта? Спасибо.

На сайте с 07.11.2009

10 января 2011, 05:42

Программой Xenu’s Link Sleuth

На сайте с 05.11.2010

10 января 2011, 06:43

Также можно поискать линк на карту сайта, если она имеется.

На сайте с 03.07.2008

10 января 2011, 06:46

Спасибо, программа Xenu’s Link Sleuth работает на УРА! Находит рабочие страницы, картинки, внешние ссылки и показывает где размещены и т.д. Как соберете список, сохраните его в txt файл и откройте этот файл в Excel если нужен список урл страниц.

Авторизуйтесь или зарегистрируйтесь, чтобы оставить комментарий

Проверяем все страницы сайта на PR

Всем читающим и следящим за моим блогом — Добрый День. После Апа PR, несколько человек на блоге спрашивало: «Как проверить все страницы большого сайта на PR?». Ведь большинство онлайн сервисов позволяют проверять только по 50 страниц, что очень не удобно, когда сайт имеет сотни или тысячи страниц. Давайте сегодня попробуем разобраться в этой проблеме.

Значение Page Rank многие не до оценивают и очень зря, ведь цены на ссылки, размещённых на страницах имеющих PR, вырастают в 2-3 раза. Например в бирже Get Good Links , ссылка со страницы которая имеет PR 1 стоит 8-10 долларов, PR 2 — 25$ и так далее в геометрической прогрессии.

Мой способ проверки PR

Чтобы массово проверить PR всех внутренних страниц, понадобиться две программы. Первая — которая получит все url страниц сайта. Вторая — позволяющая массово проверять PR страниц.

Парсим страницы сайта

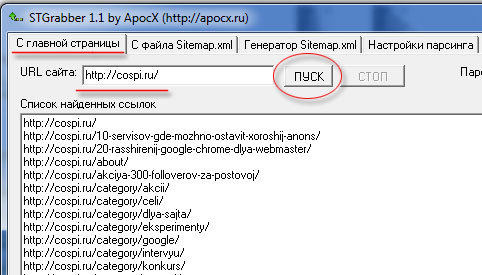

По идеи, можно получить список страниц сайта, с файла sitemap.xml , но это будет не полный список, потому что в этих файлах не указываются — рубрики, теги, постраничные урлы ( https://cospi.ru/page/2/ ) и.т.п. Поэтому берём бесплатную программу stgrabber, вписываем url сайта, обязательно с наклонным слешем в конце и нажимаем Пуск.

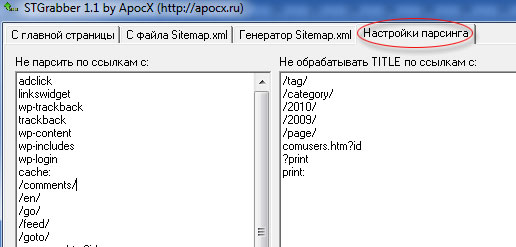

Ждём когда закончит работу программа и копируем список найденных ссылок в текстовый файл, который нам пригодиться для работу в другой программе. Я использую именно эту программу, потому, что у неё есть настройки парсинга (изъятия данных):

В полученный список ссылок, попадают только нужные страницы. В отличии от других программ, для генерации Sitemap , где сканируются все найденные ссылки. Не попадают в список ссылок:

- файлы (favicon например);

- ссылки на сообщения (?replytocom=);

- Системные страницы (?do=search, ?print и.т.п.).

Проверяем на PR

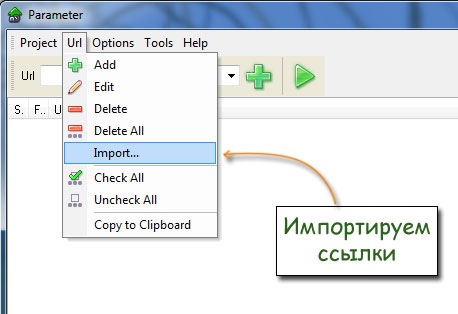

Для этого программу PaRaMeter, импортируем в неё ссылки сайта, которые мы сохранили в текстовом файлике:

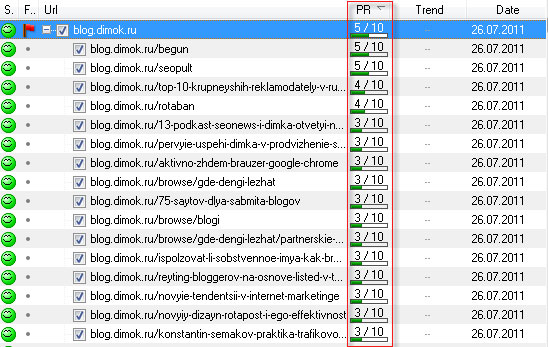

И запускаем проверку. Для наглядности я проверил 1500 страниц блога Димка:

На проверку 1.5 тысячи страниц понадобилось минуты 2-3 примерно. После того, когда программа закончит свою работу, нажимаем кнопочку PR и в таблице все значения от сортируются по убыванию, чтобы удобно было анализировать список. Все обработанные данные можно экспортировать в Excel, для последующего использования. На этом всё, спасибо за внимание.

UPDATE 8.11.2011

Программа PaRaMeter уже не определяет PR, пользуйтесь сервисом, который я описал в статье — Проверка всех страниц сайта на Page Rank.

Как получить список страниц сайта: 4 способа с плюсами и минусами

Регулярный технический анализ сайта – это единственный путь к прибыли и постоянному росту. Для его проведения можно использовать самые разные инструменты от краулинг-сервисов до стандартизованных операторов типа site. Иногда для дополнительной проверки, контроля результатов аудита или других целей в рамках технического анализа веб-мастеру требуется полный список страниц ресурса. Как получить список страниц сайт? Получить их можно разными способами, но в каждом случае есть свои оговорки.

Так, варианты «формирования» перечня URL для конкретного сайта:

- Sitemap.xml. С этого инструмента начинают все оптимизаторы, что правильно. Поскольку карты, настроенные с ошибками, приводят к потере позиций в рейтинге поискового сервиса. С ними надо уметь работать всем.

- Яндекс.Вебмастер – еще один помощник, который надо знать.

- Поверхностное сканирование. Иногда используется для экспресс-анализа и аудита.

- Загрузка вручную из заранее сформированного при создании и доработках сайта перечня.

Работа с XML-картами

При проверке маленьких сайтов (до 100 тысяч страниц) это самый удобный способ получить список адресов, в том числе для написания кода на поиск уязвимостей. Но при аудите крупных ресурсов в выборке отразятся далеко не все страницы. Причин расхождений может быть много – неправильная настройка индексации, программные ошибки (баги), когда сайт сам формирует десятки дополнительных URL, так называемые мусорные страницы, которые не закрыты через robots.txt.

Практика показывает, что в полученном перечне может недоставать до 80% страниц. Если использовать выборку с таким дефицитом информации как основу для внесения исправлений на сайт, можно потерять массу полезной информации и получить совершенно неверные приоритетные ошибки: хвататься за скорость загрузки, тогда как основной проблемой является индексация, или наоборот. У технического анализа части страниц погрешность может оказаться очень большой.

Консоль Яндекса

Выборка из поисковой консоли дает более высокую вероятность полноты итогового списка адресов страниц. Это при условии, что сайт технически выполнен без откровенных ошибок. Если ошибки есть, и портал большой, то риск получить неполный список растет.

Правда, не так сильно, как в других случаях. Потому при необходимости провести анализ быстро (или получить список URL для других целей в режиме здесь и сейчас) этот вариант можно рассматривать как оптимальный.

Поверхностное сканирование

При поверхностном сканировании каждый URL анализируется на предмет присутствия на нем других адресов. Такой вариант дает самые высокие шансы получить полный перечень адресов. Но и по трудозатратам он первый. Рутинной работы с ним много. Надо:

- загрузить HTML;

- проверить загрузку (парсинг);

- выделить ссылки;

- переходить от одной страницы к другой по мере сканирования, чтобы не дублировать операции;

- отсеивать метатеги и т. д.

Если ни на одном из этапов не допустить ошибок, результат будет точным. Но когда он будет?

Ручная загрузка списка страниц сайта

Если ресурс создан меньше месяца назад (и ему де-факто не нужен список страниц, потому что такие молодые сайты можно проверять и без него), ручная загрузка подходит. В остальных случаях (особенно после года активного развития) веб-мастер уже не может быть на 100% уверенным, что у него полный список страниц.

Чтобы проверить себя, можно посмотреть файлы (логи) роботов, сформированные по запросу. С большой вероятностью там уже будут десятки URL неизвестной природы.