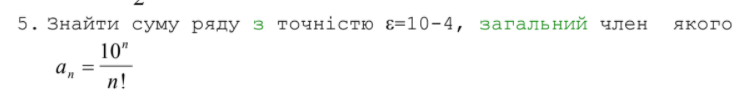

Вычислить сумму ряда с заданной точностью?

Очень сомневаюсь что у меня правильный код, надеюсь получить помощь

Sum = 0 eps = 1e-4 while Sum < eps: Sum += 10 ** 1 / factorial(1) print(Sum)- Вопрос задан более двух лет назад

- 1661 просмотр

Комментировать

Решения вопроса 0

Ответы на вопрос 2

uvelichitel @uvelichitel

habrahabr.ru/users/uvelichitel

Ряд, понятное дело, убывающий, и быстро)) Можно считать что точность достигнута, когда член ряда стал < eps. Как нибудь так:

import math Sum = 0 eps = 1e-4 i = 1 a = 1 while a > eps: a = 10 ** i / math.factorial(i) Sum += a i += 1 print(Sum)Ответ написан более двух лет назад

SashaSyshenko @SashaSyshenko Автор вопроса

А что такое "a"?

Если это количество членов ряда, то по условию я это запрашивать для ввода не могу(в других заданиях чётко написано найти первых 15 членов ряда).

uvelichitel @uvelichitel

"a" это текущий член ряда, "i" это его номер

SashaSyshenko, очевидно же. a - это очередной член ряда. Когда он стал меньше заданной точности, можно остановиться - дальше будут ещё меньше.

SashaSyshenko @SashaSyshenko Автор вопроса

Я извиняюсь, но какой начальный "a"? В условии не задан, в коде не написано.

uvelichitel @uvelichitel

Послушайте, SashaSyshenko, если вы не знаете что значит сходимость ряда, не очень сильны в Python, но вам по каким то причинам нужно решать задачки такого рода, то наймите себе репетитора. Вряд ли здесь, на бесплатном ресурсе, вам будут терпеливо всё растолковывать и разжёвывать))

SashaSyshenko @SashaSyshenko Автор вопроса

Спасибо за всё

Можно считать что точность достигнута, когда член ряда стал < eps.

Как я помню, это верно для знакопеременных рядов. В остальных случаях может быть, но не обязательно и требует дополнительного обоснования.

uvelichitel @uvelichitel

wisgest, согласен, требует дополнительного обоснования. Более того, доказательство будет верно только для eps < определённой величины. И вы что, предлагаете провести анализ и обоснование это построить для решения задачи из ЕГЭ?))

uvelichitel @uvelichitel

wisgest, точное обоснование мне строить конечно лень. Но. Например после n = 10000 ряд очевидно будет убывать быстрее чем 1/(1000**n). А сходимость такого ряда и очевидна и легко доказуема))

uvelichitel, не имею понятия об ЕГЭ. На мой взгляд (в смысле «будь моя воля»), таких сомнительных задач на ЕГЭ быть не должно. Для меня задача выглядит вполне ВУЗовской, хотя и там обычно обоснования не требуют и подходят к вопросу безответственно, давая такие задачи.

uvelichitel, так дело не столько в обосновании сходимости, её можно принять на веру, исходя из условия, а в критерии достижения заданной точности.

uvelichitel @uvelichitel

wisgest, сходимость нужна нам для утверждения что сумма оставшихся членов ряда вычислима. В предлагаемых ассимптотических оценках a(n) = 1/(1000**n) очевидно и тривиально доказуемо что любой член ряда больше суммы всех оставшихся членов. Пойдёт?))

Всё-таки, SashaSyshenko прав - поскольку переменная a не инициализирована, условие цикла while a > eps: выполняться не будет

Что такое eps в паскале?

Это просто придуманное кем-то имя переменной. В языке его как специального обозначения нет. Это обозначение часто используется в программах как замена греческой буквы эпсилон, которая, в свою очередь, применяется в математике для обозначения допустимой погрешности вычислений. В программировании есть также понятие "машинный эпсилон", означающее наименьшую величину, при прибавлении которой к единице она меняется на большее число.

Остальные ответы

Похожие вопросы

Eps python что это

Шаг 103.

Введение в машинное обучение с использованием Python. Методы машинного обучения без учителя . . Кластеризация. DBSCAN

На этом шаге мы рассмотрим особенности использования этого алгоритма .

Еще один очень полезный алгоритм кластеризации - DBSCAN (density-based spatial clustering of applications with noise - плотностный алгоритм кластеризации пространственных данных с присутствием шума ) . Основные преимущества алгоритма DBSCAN заключаются в том, что пользователю не нужно заранее задавать количество кластеров, алгоритм может выделить кластеры сложной формы и способен определить точки, которые не принадлежат какому-либо кластеру. DBSCAN работает немного медленнее, чем алгоритм агломеративной кластеризации и алгоритм k -средних, но также может масштабироваться на относительно большие наборы данных.

DBSCAN определяет точки, расположенные в "густонаселенных" областях пространства характеристик, когда многие точки данных расположены близко друг к другу. Эти области называются плотными (dense) областями пространства характеристик. Идея алгоритма DBSCAN заключается в том, что кластеры образуют плотные области данных, которые отделены друг от друга относительно пустыми областями.

Точки, находящиеся в плотной области, называются ядровыми примерами (core samples) или ядровыми точками (corepoints) . Алгоритм DBSCAN имеет два параметра: min_samples и eps . Если по крайней мере min_samples точек находятся в радиусе окрестности eps рассматриваемой точки, то эта точка классифицируется как ядровая. Ядровые точки, расстояния между которыми не превышают радиус окрестности eps , помещаются алгоритмом DBSCAN в один и тот же кластер.

На старте алгоритм выбирает произвольную точку. Затем он находит все точки, удаленные от стартовой точки на расстоянии, не превышающем радиус окрестности eps . Если множество точек, находящихся в пределах радиуса окрестности eps , меньше значения min_samples , стартовая точка помечается как (noise) , это означает, что она не принадлежит какому-либо кластеру. Если это множество точек больше значения min_samples , стартовая точка помечается как ядровая и ей назначается метка нового кластера. Затем посещаются все соседи этой точки (находящиеся в пределах eps ). Если они еще не были присвоены кластеру, им присваивается метка только что созданного кластера. Если они являются ядровыми точками, поочередно посещаются их соседи и т.д. Кластер растет до тех пор, пока не останется ни одной ядерной точки в пределах радиуса окрестности eps . Затем выбирается другая точка, которая еще не была посещена, и повторяется та же самая процедура.

- ядровые точки ,

- точки, которые находятся в пределах радиуса окрестности eps ядровых точек (так называемые пограничные точки или boundary points ) и

- шумовые точки .

Давайте применим алгоритм DBSCAN к синтетическому набору данных, который мы использовали для демонстрации агломеративной кластеризации. Как и алгоритм агломеративной кластеризации, алгоритм DBSCAN не позволяет получать прогнозы для новых тестовых данных, поэтому мы воспользуемся методом fit_predict() , чтобы сразу выполнить кластеризацию и возвратить метки кластеров:

[In 64]: from sklearn.cluster import DBSCAN from sklearn.datasets import make_blobs X, y = make_blobs(random_state=0, n_samples=12) dbscan = DBSCAN() clusters = dbscan.fit_predict(X) print("Принадлежность к кластерам:\n<>".format(clusters)) Принадлежность к кластерам: [-1 -1 -1 -1 -1 -1 -1 -1 -1 -1 -1 -1]

Можно увидеть, что всем точкам данных была присвоена метка -1, которая обозначает шум. Полученная сводка является результатом применения значений eps и min_samples , установленных по умолчанию и не настроенных для работы с небольшими синтетическими наборами данных. Принадлежность к кластерам для различных значений min_samples и eps показана в сводке и визуализирована на рисунке 1:

[In 65]: mglearn.plots.plot_dbscan() min_samples: 2 eps: 1.000000 cluster: [-1 0 0 -1 0 -1 1 1 0 1 -1 -1] min_samples: 2 eps: 1.500000 cluster: [0 1 1 1 1 0 2 2 1 2 2 0] min_samples: 2 eps: 2.000000 cluster: [0 1 1 1 1 0 0 0 1 0 0 0] min_samples: 2 eps: 3.000000 cluster: [0 0 0 0 0 0 0 0 0 0 0 0] min_samples: 3 eps: 1.000000 cluster: [-1 0 0 -1 0 -1 1 1 0 1 -1 -1] min_samples: 3 eps: 1.500000 cluster: [0 1 1 1 1 0 2 2 1 2 2 0] min_samples: 3 eps: 2.000000 cluster: [0 1 1 1 1 0 0 0 1 0 0 0] min_samples: 3 eps: 3.000000 cluster: [0 0 0 0 0 0 0 0 0 0 0 0] min_samples: 5 eps: 1.000000 cluster: [-1 -1 -1 -1 -1 -1 -1 -1 -1 -1 -1 -1] min_samples: 5 eps: 1.500000 cluster: [-1 0 0 0 0 -1 -1 -1 0 -1 -1 -1] min_samples: 5 eps: 2.000000 cluster: [-1 0 0 0 0 -1 -1 -1 0 -1 -1 -1] min_samples: 5 eps: 3.000000 cluster: [0 0 0 0 0 0 0 0 0 0 0 0]

Рис.1. Принадлежность к кластерам, вычисленная с помощью алгоритма DBSCAN при различных значениях min_samples и eps

На этом графике точки, которые принадлежат кластерам, окрашены сплошным цветом, а шумовые точки - белым цветом. Ядровые точки показаны в виде больших маркеров, тогда как пограничные точки отображаются в виде небольших маркеров. Увеличение значения eps (слева направо на рисунке) означает включение большего количества точек в кластер. Это приводит к росту размеров кластеров, но также может привести к тому, что несколько кластеров будут объединены в один. Увеличение значения min_samples (сверху вниз на рисунке) означает уменьшение количества ядерных точек и увеличение количества шумовых точек.

Параметр eps чуть более важен, поскольку он определяет, что подразумевается под "близостью" точек друг к другу. Очень маленькое значение eps будет означать отсутствие ядерных точек и может привести к тому, что все точки будут помечены как шумовые. Очень большое значение eps приведет к тому, что все точки сформируют один кластер.

Значение min_samples главным образом определяет, будут ли точки, расположенные в менее плотных областях, помечены как выбросы или как кластеры. Если увеличить значение min_samples , все, что могло бы стать кластером с количеством точек, не превышающим min_samples , будет помечено как шум. Поэтому значение min_samples задает минимальный размер кластера. Это очень четко можно увидеть на рисунке 1, когда мы увеличиваем значение min_samples с 3 до 5 при eps=1.5 . При min_samples =3 получаем три кластера: первый кластер состоит из четырех точек, второй - из пяти точек и третий - из трех точек. При min_samples=5 два кластера меньшего размера (с тремя и четырьмя точками) теперь помечены как шум и остается лишь кластер с пятью точками.

Несмотря на то что в алгоритме DBSCAN не нужно явно указывать количество кластеров, значение eps неявно задает количество выделяемых кластеров. Иногда подобрать оптимальное значение eps становится проще после масштабирования данных с помощью StandardScaler или MinMaxScaler , так как использование этих методов масштабирования гарантирует, что все характеристики будут иметь одинаковый масштаб.

Рисунок 2 показывает результат выполнения алгоритма DBSCAN для наборе данных two_moons . Алгоритм фактически находит две группы данных в форме полумесяцев и разделяет их, используя настройки по умолчанию:

[In 66]: X, y = make_moons(n_samples=200, noise=0.05, random_state=0) # масштабируем данные так, чтобы получить нулевое среднее и единичную дисперсию scaler = StandardScaler() scaler.fit(X) X_scaled = scaler.transform(X) dbscan = DBSCAN() clusters = dbscan.fit_predict(X_scaled) # выводим принадлежность к кластерам plt.scatter(X_scaled[:, 0], X_scaled[:, 1], c=clusters, cmap=mglearn.cm2, s=60) plt.xlabel("Признак 0") plt.ylabel("Признак 1")

Рис.2. Принадлежность к кластерам, вычисленная с помощью алгоритма DBSCAN , использовалось значение по умолчанию eps=0.5

Поскольку алгоритм выделил нужное количество кластеров (два), настройки параметров, похоже, работают хорошо. Если мы уменьшим значение eps до 0.2 (значение по умолчанию 0.5), мы получим восемь кластеров, что явно слишком много. Увеличение eps до 0.7 даст один кластер.

Используя DBSCAN , будьте осторожны при работе с возвращаемыми номерами кластеров. Использование -1 для обозначения шума может привести к неожиданным эффектам, если метки кластеров будут использоваться для индексирования другого массива.

На следующем шаге мы проведем сравнение и дадим оценку качества алгоритмов кластеризации .

Eps python что это

Hexagons → [OFF TOPIC] Hollow Knight radiant tutorial for bossfight "Markoth"

MikeMirzayanov → Codeforces Single Account Policy: zh0ukangyang is Removed from the Rating

![]()

Gheal → Codeforces Round #833 (Div. 2) Editorial

stefdasca → Easy and Quick Video Tutorials for the CSES Problem Set

vrintle → Invitation to Gym Contest — Alpha IV (by AlgoRave)

maomao90 → Editorial for Hello 2024

maomao90 → I am top 1 contributor. AMA!

![]()

YoyOyoYOy000y000 → Centroid Decomposition on a tree(Beginner)

D_coder22 → Uncertainty in Python Time of Execution

bycicle → Click here if you want a fast way to get rid of your alt

SlavicG → Codeforces Round 918 (Div. 4)

mohammed_orkhan → I wnat to be EXPERT!!

thenymphsofdelphi → Codeforces Round #873 (Div. 1 & 2) Editorial

VivaciousAubergine → Wow! You received a rating of -501 in the CodeTON round. Share it!

diskoteka → Codeforces Round #878 (Div.3) Разбор

CheaterExposer → [UPDATE] Codeforces Cheater IOI Medalist

sarthak1357 → CSES shortest routes 1

![]()

Pyqe → Codeforces Round #831 (Div. 1 + Div. 2, based on COMPFEST 14 Final) Editorial

![]()

arham_doshi → cses graph session editorial(incomplete)

SAD_IN_NIGHTMARE → 2024 OIs

parth_1818 → Know Some Sorting Techniques

I_am_Polish_Girl → Dijkstra Algorithgm

atcoder_official → AtCoder Beginner Contest 335 (Sponsored by Mynavi) Announcement

awoo → Разбор Educational Codeforces Round 149

Vectrizz → Золотой расчет: оптимизация ценности в рюкзаке с умением раздробить слитки!