Контекстная реклама

Хочу задать вопросы)

Предложили настроить контекстную рекламу, цену назвали 185 $ за два поисковика. Я думал, это уже стоимость всех работ и сюда входит стоимость кликов. Оказывается это стоимость что бы просто настроить контекстную рекламу в гугл и яндекс. Сверху посчитали, что по 5$ на поисковик в день примерно будет уходить на клики. Получается 385 $ в месяц с работой и оплатой кликов. Тематика «молодежная одежда» Хотел бы узнать, не много ли это 185$ за работу, как я думал, что все берут процент от суммы выделяемой. процент этот примерно 25.

Djonik Senior Member

Город:

# 3 февраля 2015 22:34

Бегун сразу из списка уберите-почитайте отзывы как они кидают вебмастеров.

mianchuk Senior Member Автор темы

Город:

# 3 февраля 2015 23:39 Редактировалось mianchuk, 1 раз.

Djonik: Бегун сразу из списка уберите-почитайте отзывы как они кидают вебмастеров.

Я наоборот хотел попросить, чтобы подсказали и другие, менее популярные системы. Давновато с Бегуном не работал, но, раз он есть, то может быть полезен кому-то.

Добавлено спустя 1 минута 23 секунды

dominik119: как я думал, что все берут процент от суммы выделяемой.

По-разному берут, у разных компаний разная схема работы. Обратитесь к нескольким потенциальным исполнителям — картина прорисуется более ясная. Опять же, от количества рекламных кампаний, для Вас создаваемых, и количества объявлений в них тоже что-то зависит наверное.

Добавлено спустя 2 минуты 46 секунд

dominik119: посчитали, что по 5$ на поисковик в день примерно будет уходить на клики

Прелесть контекстной рекламы в том, что Вы сами определяете, сколько хотите тратить. Можете 5 долл. в день тратить, а можете 50 и больше — если тематика востребованная и Вы готовы отработать поток посетителей, то проблем тут нет.

Город:

# 4 февраля 2015 22:11

dominik119: Хочу задать вопросы)

Предложили настроить контекстную рекламу, цену назвали 185 $ за два поисковика. Я думал, это уже стоимость всех работ и сюда входит стоимость кликов. Оказывается это стоимость что бы просто настроить контекстную рекламу в гугл и яндекс. Сверху посчитали, что по 5$ на поисковик в день примерно будет уходить на клики. Получается 385 $ в месяц с работой и оплатой кликов. Тематика «молодежная одежда» Хотел бы узнать, не много ли это 185$ за работу, как я думал, что все берут процент от суммы выделяемой. процент этот примерно 25.

Давайте Вам помогу бесплатно настроить, при этом поэтапную настройку выложим в эту ветку. Скрины, естественно в части личной информации будут закрыты.

ОРЁЛ Senior Member

Город:

# 4 февраля 2015 22:27

dominik119: Хочу задать вопросы)

Предложили настроить контекстную рекламу, цену назвали 185 $ за два поисковика. Я думал, это уже стоимость всех работ и сюда входит стоимость кликов. Оказывается это стоимость что бы просто настроить контекстную рекламу в гугл и яндекс. Сверху посчитали, что по 5$ на поисковик в день примерно будет уходить на клики. Получается 385 $ в месяц с работой и оплатой кликов. Тематика «молодежная одежда» Хотел бы узнать, не много ли это 185$ за работу, как я думал, что все берут процент от суммы выделяемой. процент этот примерно 25.

Давайте Вам помогу бесплатно настроить, при этом поэтапную настройку выложим в эту ветку. Скрины, естественно в части личной информации будут закрыты. Я бы с удовольствием почитал!

178492 Junior Member

Город:

# 4 февраля 2015 22:39

ой, я бы тоже с удовольствием посмотрела грамотный пример настройки. dominik119, соглашайтесь)

mianchuk Senior Member Автор темы

Город:

# 4 марта 2015 23:37

Есть вопрос к профессионалам Яндекс.Директа. Создал новую кампанию для клиента, работает пока в тестовом режиме. Регион показа для объявлений указан Москва, заданы московские адрес и телефон. В тексте объявлений, правда, не указывал явно «Москва». Тем не менее, все равно приходят с объявлений Директа по запросам вроде

передержка кота новосибирск

передержка кошек екатеринбург

бесплтаная передержка кошек ростов-на-дону

передержка для собак в калининграде

астрахань зоогостиница

Т.е. похоже, что ищут из Москвы, но с указанием другого региона в запросе. Подайте идею, как «отрубить» эти лишние чужие регионы, не указывая при этом в минус-словах все города России.

mianchuk Senior Member Автор темы

Город:

# 5 марта 2015 10:05

Хм, похоже, все-таки накосячил я с регионами показа. Поправил. Посмотрим на изменения в статистике.

Город:

# 8 марта 2015 11:46

ОРЁЛ: Fuzler: С

dominik119: Хочу задать вопросы)

Предложили настроить контекстную рекламу, цену назвали 185 $ за два поисковика. Я думал, это уже стоимость всех работ и сюда входит стоимость кликов. Оказывается это стоимость что бы просто настроить контекстную рекламу в гугл и яндекс. Сверху посчитали, что по 5$ на поисковик в день примерно будет уходить на клики. Получается 385 $ в месяц с работой и оплатой кликов. Тематика «молодежная одежда» Хотел бы узнать, не много ли это 185$ за работу, как я думал, что все берут процент от суммы выделяемой. процент этот примерно 25.

Давайте Вам помогу бесплатно настроить, при этом поэтапную настройку выложим в эту ветку. Скрины, естественно в части личной информации будут закрыты. Я бы с удовольствием почитал! Что почитали бы?

Pushisty Zaika: ой, я бы тоже с удовольствием посмотрела грамотный пример настройки. dominik119, соглашайтесь)

Как использовать поискового робота Google для SEO оптимизации?

Сканируйте сайт на наличие технических ошибок и получите список задач с подробными инструкциями по их устранению.

В словаре SEO-специалистов часто можно услышать о таком понятии, как “дружественность сайта к поисковым системам”. Что это значит? Процесс сканирования и индексирования сайта это достаточно затратный процесс для всех поисковых систем, особенно с таким ростом количества сайтов и страниц, как происходит сейчас. Чем дороже процесс по ресурсам, тем больше лимитов и жестких правил устанавливают поисковики. Понимание того, по каким правилам работают поисковые роботы (в частности, Googlebot) поможет постепенно сделать свой сайт “дружественным” для поисковиков. А это помогает быстрее индексировать новые и обновленные страницы, быстрее находить ошибки и т.д.

Что такое Googlebot?

Поисковые роботы (например, Googlebot) – это роботы, которые сканируют веб-страницы и добавляют их индекс. Если код на странице дает боту команду на индексирование, тогда он добавляет эту страницу в индекс, и только тогда она становится доступной пользователям. Очень хорошо этот процесс описан в этом руководстве Google. Ключевыми правилами сканирования, являются четыре следующие шага:

Если страница высоко ранжируется, поисковый робот Google будет тратить больше времени на её сканирование.

Здесь мы можем поговорить о «краулинговом бюджете», представляющем собой точное количество времени, затрачиваемого веб-роботами на сканирование определенного сайта: чем более авторитетна веб-страница, тем больший бюджет она получит.

Google бот постоянно сканирует сайт

Вот что об этом говорит Google: «Поисковый робот Google не имеет доступа к сайту чаще, чем один раз в секунду». Это означает, что сайт находится под постоянным контролем веб-пауков, если у них есть доступ к нему. Сегодня многие SEO специалисты спорят о так званой «скорости обхода» и пытаются найти оптимальный способ обхода сайта роботом, чтобы получить высокий уровень ранжирования. Тем не менее, «скорость обхода» – это всего лишь скорость запросов поискового робота Google, а не повторение сканирования. Вы даже можете изменить этот показатель самостоятельно с помощью Webmasters Tools. Огромное количество внешних ссылок, наличие ссылок с 404 ошибкой, уникальность и упоминания в соцсетях влияют на вашу позицию в результатах поиска. Также важно уточнить, что веб-пауки не сканируют каждую страницу непрерывно, поэтому намного выгоднее сразу создавать полезный и уникальный контент.

Файл Robots.txt – это первое, что сканируют роботы Google

Если страница отмечена в файле robots.txt как запрещенная для сканирования, роботы не будут её сканировать и соответственно в индекс она не попадет.

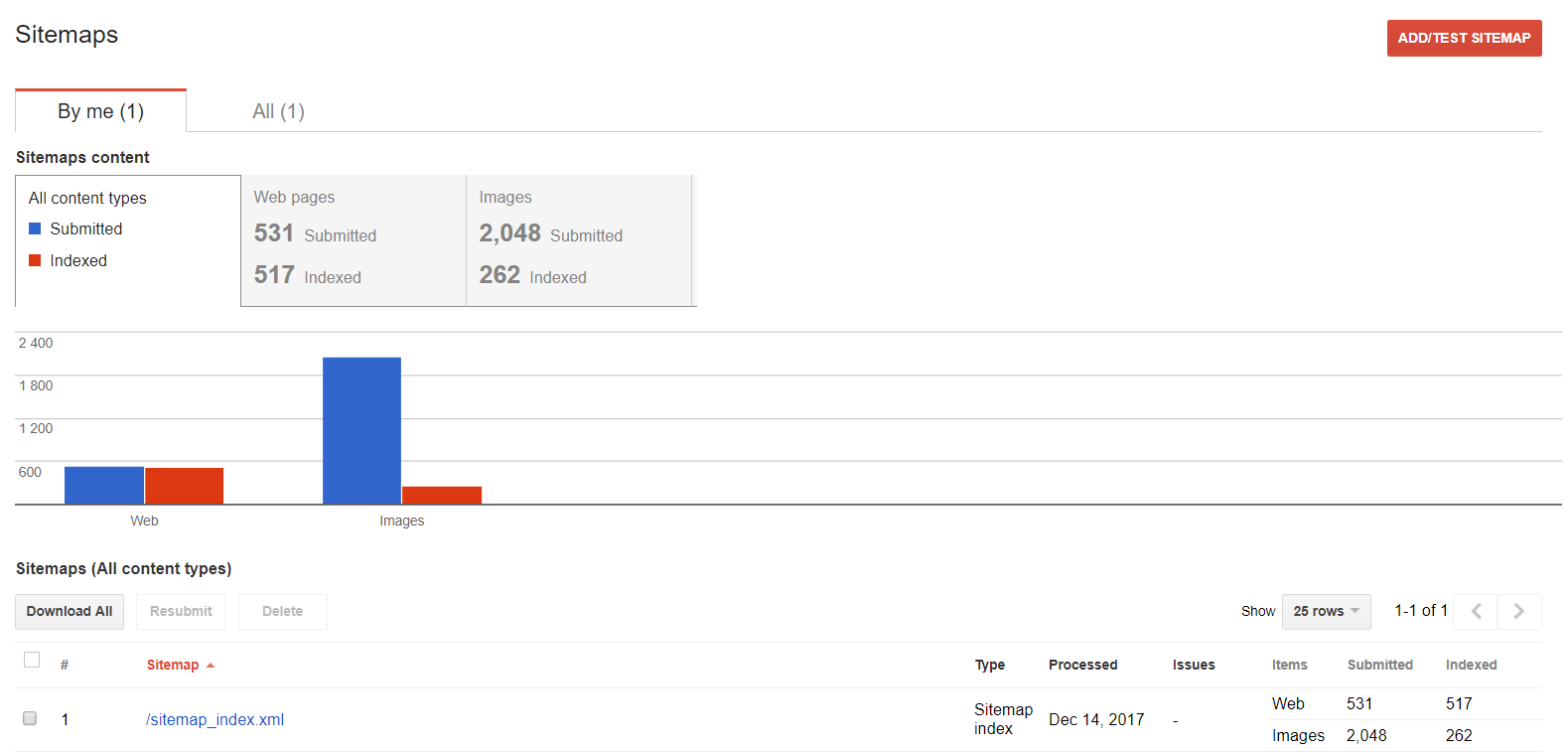

Файл Sitemap.xml – это руководство для ботов Google

Файл Sitemap.xml помогает ботам понять, какие части сайта нужно просканировать и проиндексировать. Так как сайты в основном различаются по своей структуре, гуглбот не может краулить все страницы на сайте автоматически. Качественный файл Sitemap может помочь страницам с низким рейтингом, небольшим количеством обратных внутренних ссылок и бесполезным контентом попасть в индекс на равне с более авторитетными страницами.

Как оптимизировать сайт для лучшего сканирования поисковым роботом Googlebot?

Не недооценивайте файл robots.txt

Файл robots.txt является вместилищем команд для поисковых роботов. И так как ваш “краулинговый бюджет” ограничен, уделите время и постарайтесь закрыть от сканирования все необходимые страницы. Так, ваши самые ценные страницы будет индексироваться быстрее и чаще.

Полезный и уникальный контент действительно имеет значение

Основной тезис такой – контент, который сканируется чаще, ранжируется выше и соответственно приносит больше трафика. Особенно это становится важно сейчас. Google все больше ориентируется на новизну, актуальность страниц. Обновляйте контент на ваших топовых страницах, добавляйте их в индекс вручную и постепенно гуглбот будет сам уделять им больше внимания. Если у сайта слишком большое количество открытых страниц пагинации, то есть вероятность, что нужные вебмастеру страницы могут быть не проиндексированы. Это связано с тем, что поисковых бот израсходует краулинговый бюджет на продублированные страницы.

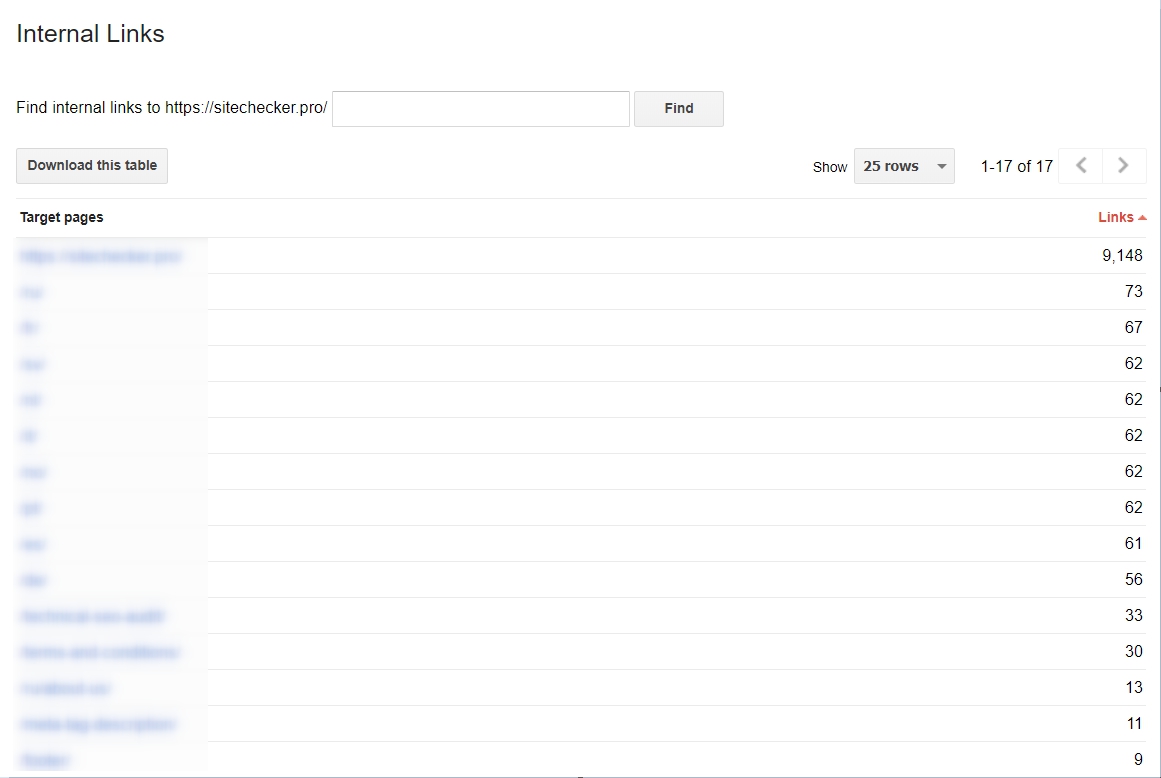

Пора начать использовать внутренние ссылки

Внутренние ссылки не только упрощают использование сайта для пользователя, но и делают проще процесс сканирования для поисковых ботов. Если ранее вы не уделяли внимания каждой ссылке на странице, воспользуйтесь Google Search Console, чтобы отследить активные ссылки. Для еще более глубокого исследования, добавьте ваш сайт в наш краулер и оцените всю структуру внутренних ссылок, анкор лист, распределение весов. Также вы можете попробовать запустить аудит сайта, чтобы найти ошибки и проанализировать внутреннюю структуру сайта, включаяя ссылки.

Sitemap.xml жизненно важен

Еще раз, почему этот файл так важен? Sitemap – это карта местности для бота. Без неё он блуждает по сайту только на основе внутренних ссылок, и страницы которые слабо перелинкованы получают мало внимания, или вообще могут быть не замечены. Это один из важных факторов, которые поисковая система гугл использует при сканировании сайтов.

Как анализировать работу Googlebot?

Для анализа работы гуглбота, просто регулярно проверяйте раздел «Сканирование» в Webmaster Tools.

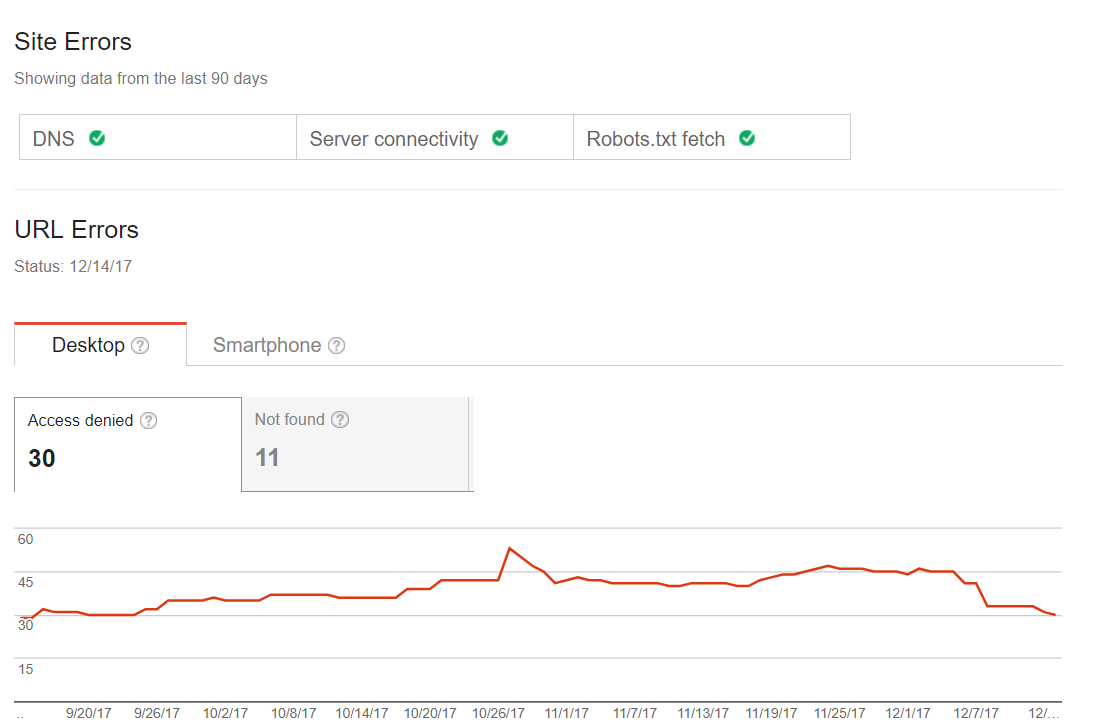

Популярные ошибки при сканировании

Страница “Ошибки сканирования” помогает быстро найти как критические ошибки, так и неопасные уведомления. К этому блоку чаще всего стоит обращаться, когда вы заметили какие то резкие изменения в индексации, снижение количества трафика.

Файлы Sitemap

Используйте эту функцию, если хотите поработать с картой сайта: изучить, добавить или выяснить, какой контент индексируется.

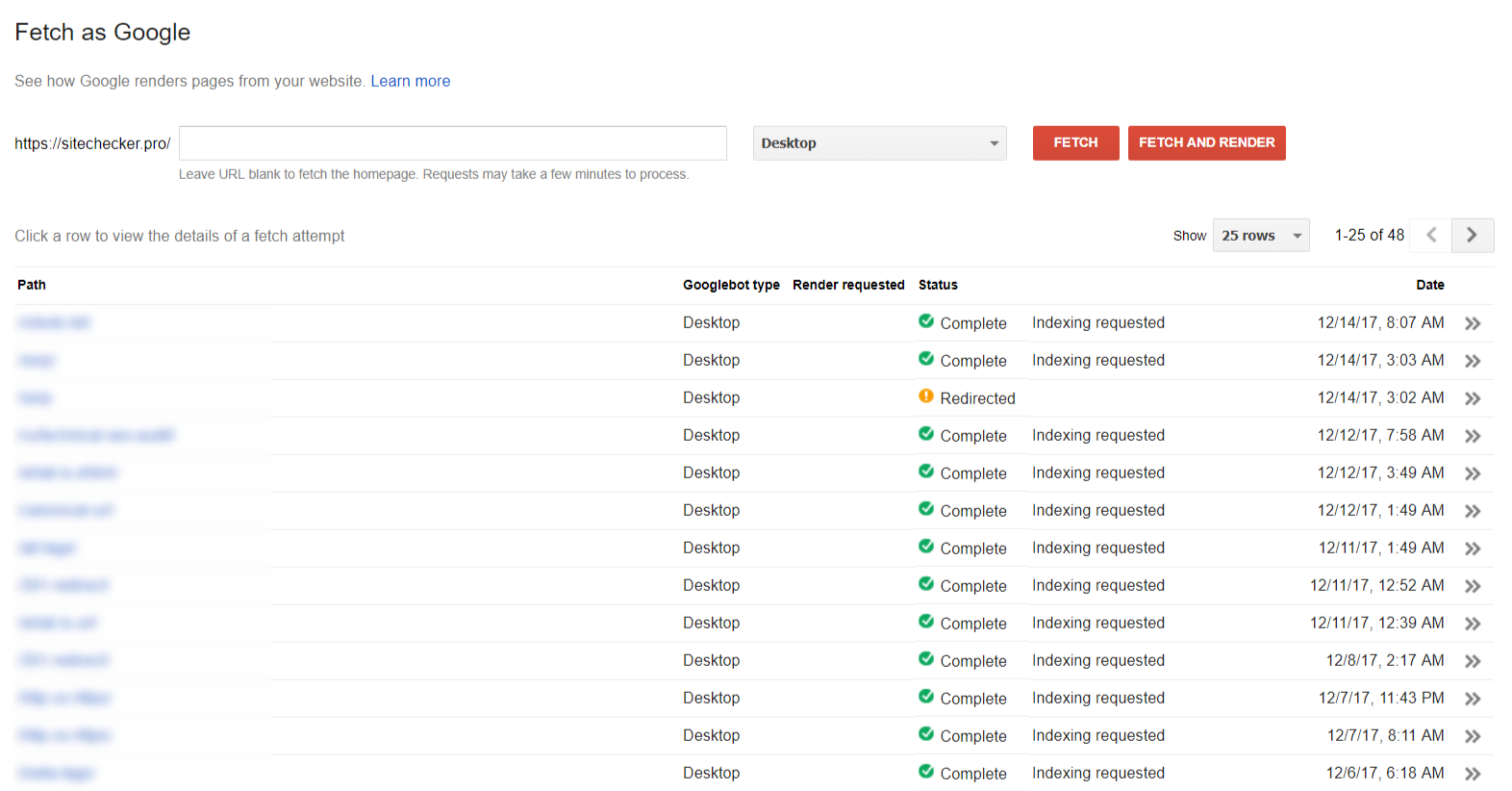

Посмотреть как Googlebot

Функция «Посмотреть как Googlebot» один из самых быстрых способов добавить страницу в индекс гугла.

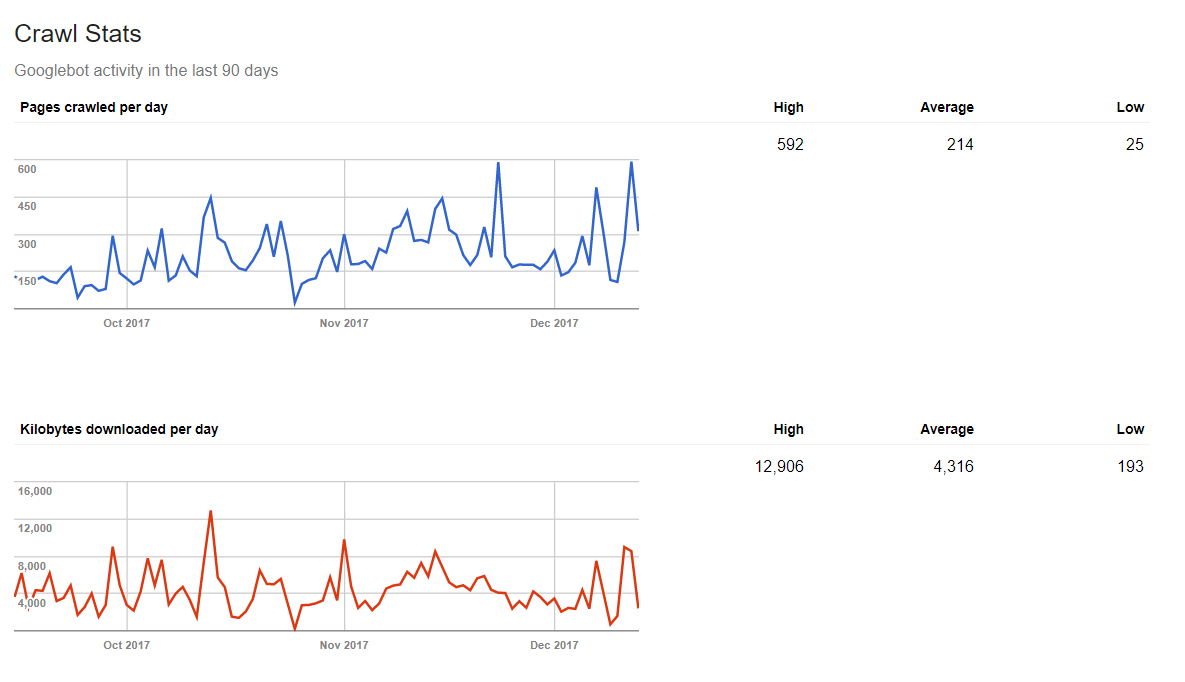

Статистика сканирования

Эта вкладка помогает оценить динамику сканирования сайта в разрезе 90 дней.

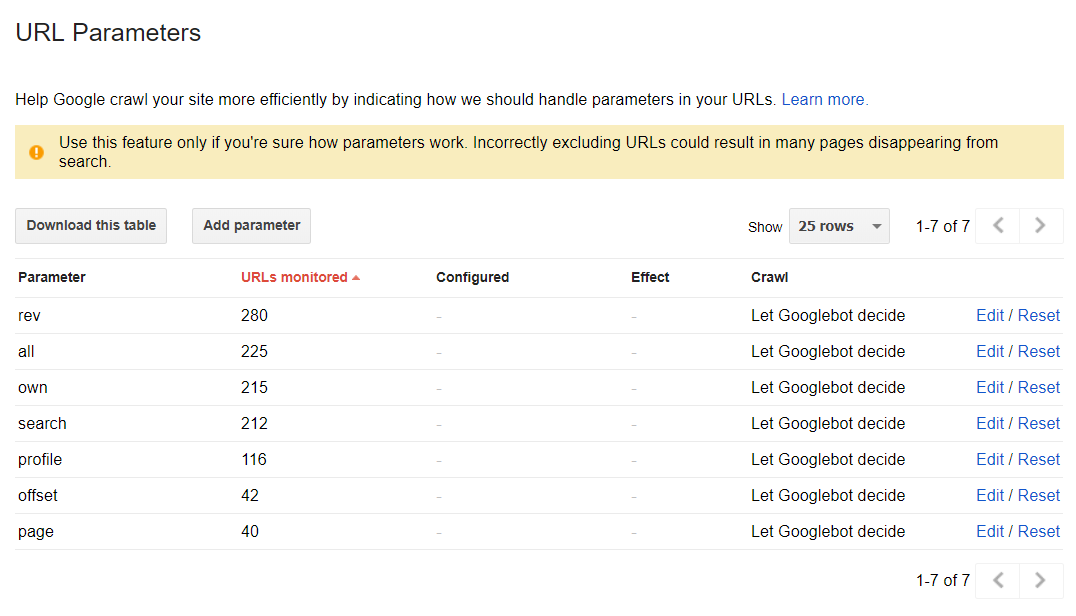

Параметры URL

Google не рекомендует использовать эту функцию без необходимости. По задумке, объяснение значений отдельных частей URL-адреса помогает гуглу лучше понимать как сканировать каждый тип страниц.

Наталия — SEO-эксперт Sitechecker. Она отвечает за блог. Не может жить без создания ценного контента о SEO и диджитал маркетинге.

Проверьте ваш сайт на ошибки

Вам также может быть интересно

AdsBot-Google

AdsBot-Google – это робот поисковой системы Google, который сканирует и определяет качество страниц, на которых подключена контекстная реклама AdWords. Он предназначен для проверки качества и определении релевантности объявления, что помогает установить оптимальную стоимость за клик. В некоторых случаях, когда сайт скрыт от индексации всех ботов в файле robots.txt, AdsBot-Google позволяет поисковой системе получить представление о нем

Контроль доступа робота AdsBot-Google к сайту

Контролировать доступ AdsBot-Google к своему сайту можно различными методами: через файл robots.txt, через метатеги или специальный файл .htaccess.

Документ robots.txt должен располагаться в корневом каталоге интернет-ресурса. Качественный бот, перед тем как работать с другими страницами сайта, просматривает его. Если он будет запрещен, тогда роботы не проанализируют страницу.

Чтобы закрыть доступ AdsBot-Google к любой части сайта, необходимо в robots.txt указать:

Использование метатегов для контроля доступа AdsBot-Google

Чтобы запретить доступ AdsBot-Google к части страницы на сайте, необходимо перед ней вставить тег: . Для закрытия данной области нужно прописать .

бот Google Ad Checker люто нагружает сервер

Начал сильно грузиться сервер, по логам метрики это делает бот Google Ad Checker. Раньше он заходил на сайт 120-150 раз в сутки, теперь до 10-15 тысяч раз. На сайте рекламы нет. А вот на сам сайт реклама с Google Adwords имеется. В поддержке гугла ничем помочь не могут. Вопрос на форуме поднимался, но ответ так никто и не дал. Что это за бот, какая от него польза, и как ему запретить доступ на сайт? Может кто сталкивался, помогите!

- Google не фиксирует частоту сканирования сайта GoogleBot

- Взрывной рост роботности в Метрике

- VKRobotRB — что за зверь?

На сайте с 18.08.2008

20 июля 2018, 12:55

jsmith820, этот бот проверяет работоспособность сайта, рекламы и проч.

Заходов действительно много, у вас такая активная реклама на сайт идет? Стоит проверить Эдвордс, может, какие-то объявления имеют некорректный урл и робот долбится туда, пытаясь постоянно проверить «а вдруг что-то изменилось».

Радикальный способ — вообще прекратить рекламироваться в Эдвордс 🙂

Контекст окупается — создание Директа и Гугл Рекламы (Adwords) ( https://searchengines.guru/ru/forum/964055 ) ||| Ютуб-канал «Директ для собственников бизнеса» ( https://www.youtube.com/channel/UCjzF4_iuZQc3Avbngb_xsjg/ )

На сайте с 06.03.2016

20 июля 2018, 13:12

от эдвордза отказаться низзя, это кормилец.

другое дело, может как-то можно для этого робота crawl-delay задать, но как тогда его в user-agent е назвать?

по поводу некорректных урлов логичное предположение. посмотрел — нет таких, вроде всё норм.

На сайте с 17.07.2008

20 июля 2018, 13:16

IP адреса ботов проверяли по whois, они принадлежат Google?

Под ботов гугла иногда маскируются не относящие к гуглу боты, парсеры и т.д. и .т.п.

На сайте с 06.03.2016

20 июля 2018, 13:31

KM.UA:

IP адреса ботов проверяли по whois, они принадлежат Google?

Под ботов гугла иногда маскируются не относящие к гуглу боты, парсеры и т.д. и .т.п.

На сайте с 11.03.2012

20 июля 2018, 14:09

jsmith820,покажите user agent этого бота и его ip из логов веб-сервера

⭐ BotGuard (https://botguard.net) ⭐ — защита вашего сайта от вредоносных ботов, воровства контента, клонирования, спама и хакерских атак!

На сайте с 06.03.2016

20 июля 2018, 15:25

Оптимизайка:

jsmith820,покажите user agent этого бота и его ip из логов веб-сервера

209.85.238.36 «Mozilla/5.0 (iPhone; CPU iPhone OS 9_1 like Mac OS X) AppleWebKit/601.1.46 (KHTML, like Gecko) Version/9.0 Mobile/13B143 Safari/601.1 (compatible; AdsBot-Google-Mobile; +http://www.google.com/mobile/adsbot.html)

На сайте с 11.03.2012

20 июля 2018, 15:55

jsmith820, похож на настоящий.

На сайте с 01.12.2017

21 июля 2018, 04:57

Если у вас нет рекламы adsense на сайте, что мешает запретить боту сканировать сайт ?

crawl-delay уже давно не работает для ботов google, они его игнорируют

пропишите в robots.txt и всех то делов

На сайте с 11.03.2012

21 июля 2018, 10:11

smurf:

Если у вас нет рекламы adsense на сайте, что мешает запретить боту сканировать сайт ?

Этот бот относится к adwords, а не adsense. Гугл пугает неприятностями:

Важно! Запрет сканирования даже одной страницы может иметь серьезные последствия:

Прекращение показа объявлений. Рейтинг объявлений может существенно снизиться, так как у Google будет недостаточно данных для оценки качества и релевантности целевой страницы. Тогда ваши объявления будут показываться гораздо реже (или вообще перестанут появляться), пока вы не поднимете максимальную цену за клик. Но и в этом случае с показом рекламы возникнут существенные проблемы или она вовсе перестанет появляться.

Отклонение объявлений. Если вы ограничите доступ к конечному URL целевой страницы, на которую ведут ваши объявления, согласно нашим правилам они могут быть отклонены и не будут показываться. Воспользуйтесь Руководством Google для веб-мастеров, чтобы убедиться, что ваши страницы доступны для сканирования.

На сайте с 06.03.2016

22 июля 2018, 19:46

Проанализировав изменения в аккаунте adwords, выявил причину, почему гуглобот adwords так взбесился.

Мы добавили ландинг по схожей тематике, что и основной проект. При этом рекламу по основному проекту тормознули, смотрим какие конверсии даст ландинг.

В результате гуглобот обнаружил два афелированных ресурса, и люто их проверяет, чтобы они не рекламировались в одно и то же время. Отсюда пиковые атаки бота на сайт.

И это ппц, на самом деле. Нагрузки бота очень большие, так что скорее всего придётся переносить сайт на VPS.

И бл*ть, действительно даже в crawl-delay не ограничить эту тварь, и не запретить ей посещать сайт. Вот Оптимизайка верные ссылки дал, санкции будут.