Как работать с LVM в Proxmox?

Добрый день Хабровчане! Последние несколько дней я усердно пытаюсь оседлать proxmox. В линухе я не гуру. Диск с рейдом к директории прикрутить могу, а вот что насчет LVM. Создал я группу томов, добавил в PVE (как я понял, логический том создает сам PVE), вот я все собрал, запустил сервер, все установил. А теперь вопрос: Как мне подключиться к этому диску, чтоб я мог взять от туда, залить туда (в случае необходимости), фалй .qcow2? Мне это нужно понять для дальнейшего использования LVM. Про бекап я знаю, но хотелось бы уметь еще и через терминал.

UPD: Это еще нужно, допустим, для переноса виртуалок hyper-v, после конвертации в qcow2, в proxmox.

- Вопрос задан более года назад

- 1200 просмотров

Комментировать

Решения вопроса 1

В Proxmox не получится работать с хранилищем с типом LVM как с обычным каталогом. Если нужно подцепить образ диска к виртуальной машине, скопировав его откуда-то, или скачать его, то это проще выполнить с хранилищем типа Directory, или через NFS либо SMB/CIFS. Достаточно залить образ диска в поддерживаемом формате в каталог виртуальной машины и дать команду qm rescan. Перемещать образы дисков между хранилищами можно с помощью команды Disk Action -> Move Storage (или эквивалент в cli — команда qm move-disk)

Ответ написан более года назад

Нравится 1 1 комментарий

Proxmox local lvm где

Дополнение к данной инструкции.

Если вы нашли это дополнение, в обязательном порядке рекомендую изучить основную инструкцию и только после переходить к данному дополнению!

Быстрая донастройка панели:

Отключение никому не упёршегося свопа. Панель не упадёт при переполнении озу, не переживайте. Ядро тут достаточно умное (нет, это не значит что только тут умное ядро а везде в других Linux системах тупое, просто тут больше на упор оптимизации идёт) и умеет резервировать озу. По этой причине если у вас будет переполнено озу в контейнере, панель не упадёт. Но если будет переполнено прям с концами, само ядро убьёт процесс в контейнере и озу освободится.

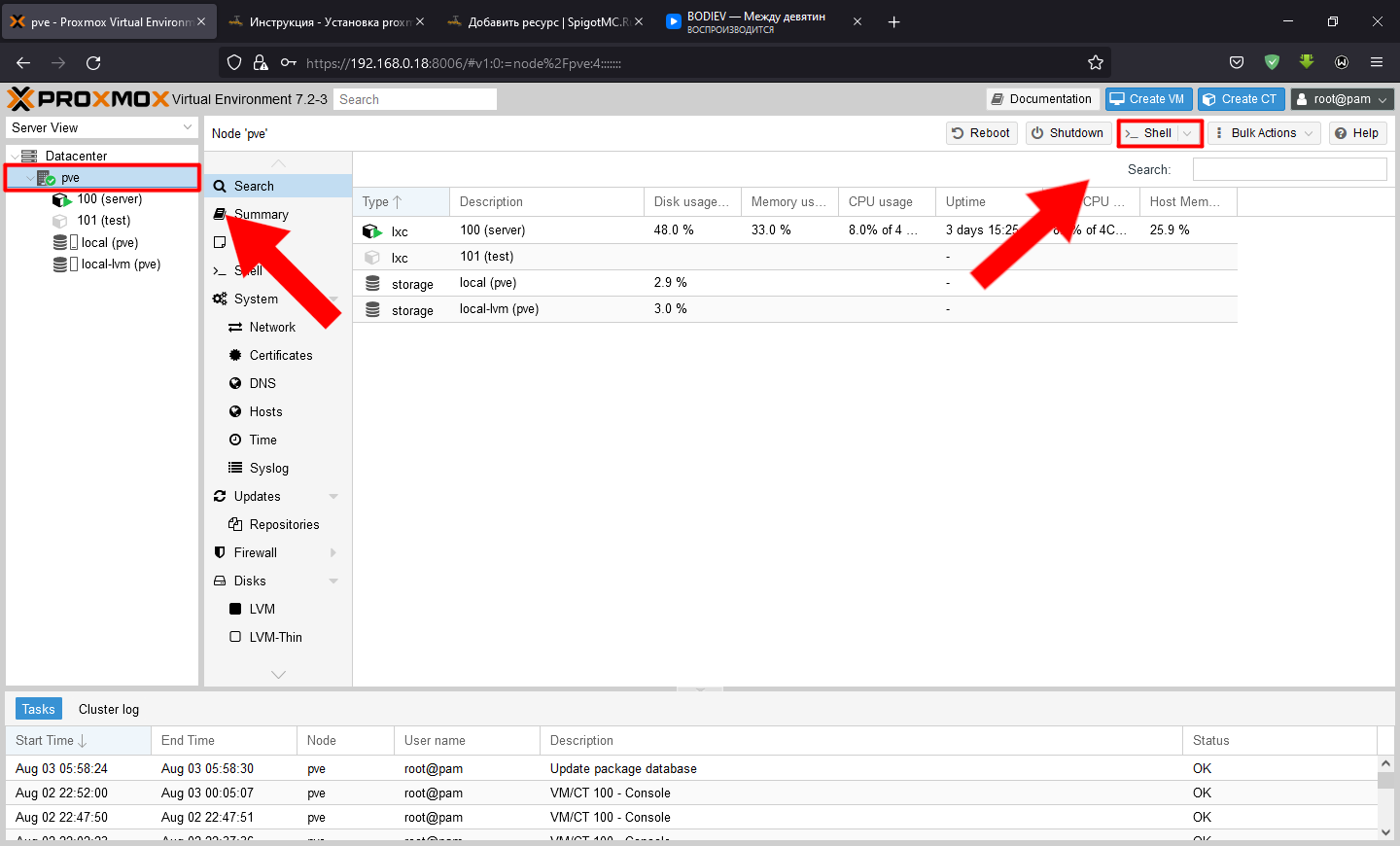

Нажимаем на pve (ну или как у вас называется хост). И жмём на shell (да да, через эту панель можно получить доступ к терминалу без ssh как для самой панели так и для контейнеров с виртуалками):

Там вы увидите терминал. Не вижу смысла показывать его, ведь каждый нормальный линуксоид/сисадмин видел его.

Введите данную команду:

swapoff -a && sed -i '/ swap / s/^\(.*\)$/#\1/g' /etc/fstab Это отключит свап который тормозит наши накопители, а для ссд вовсе является губительным.

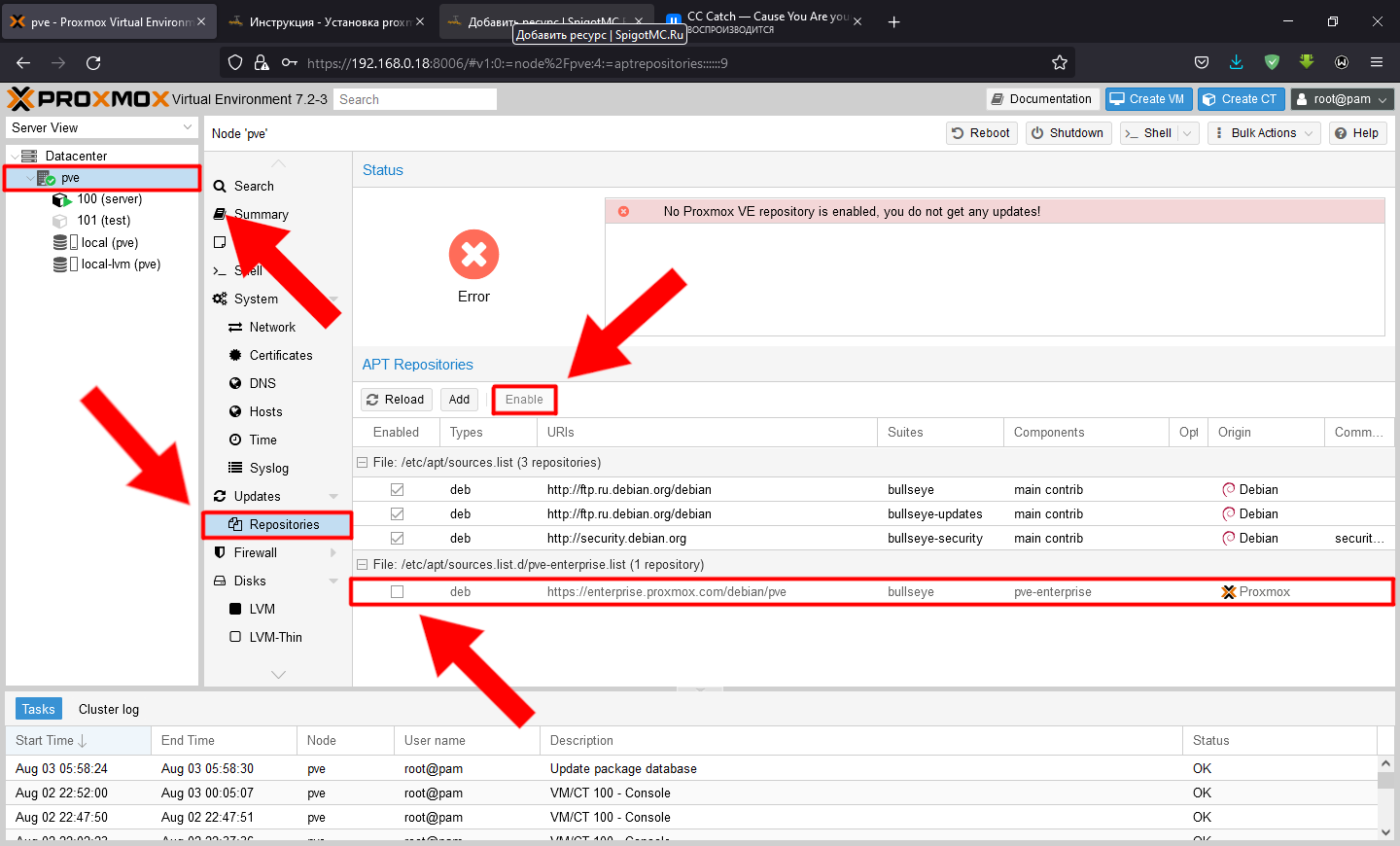

Отключение проприетарных репо:

Сама панель полностью бесплатна. Но имеет в себе платные и проприетарные репозитории самого проксмокса с некоторыми программами, имхо они не нужны и ни разу не пригодились в обычном домашнем (да и не только) использовании.

Тыкаем на pve (ну или как у вас там хост называется). Жмём на updates, жмём раскрыть список, и жмём на repositories, после нажимаем на обведённую строку, и тыкаем на кнопку disable (вместо кнопки enable будет disable) и после всего нажимаем reload:

Помните как мы открывали консоль в прошлом этапе? Открываем её снова, и вводим:

apt update && apt upgrade ждём окончания выполнения команд и радуемся, у нас свежие репо, и без мусора.

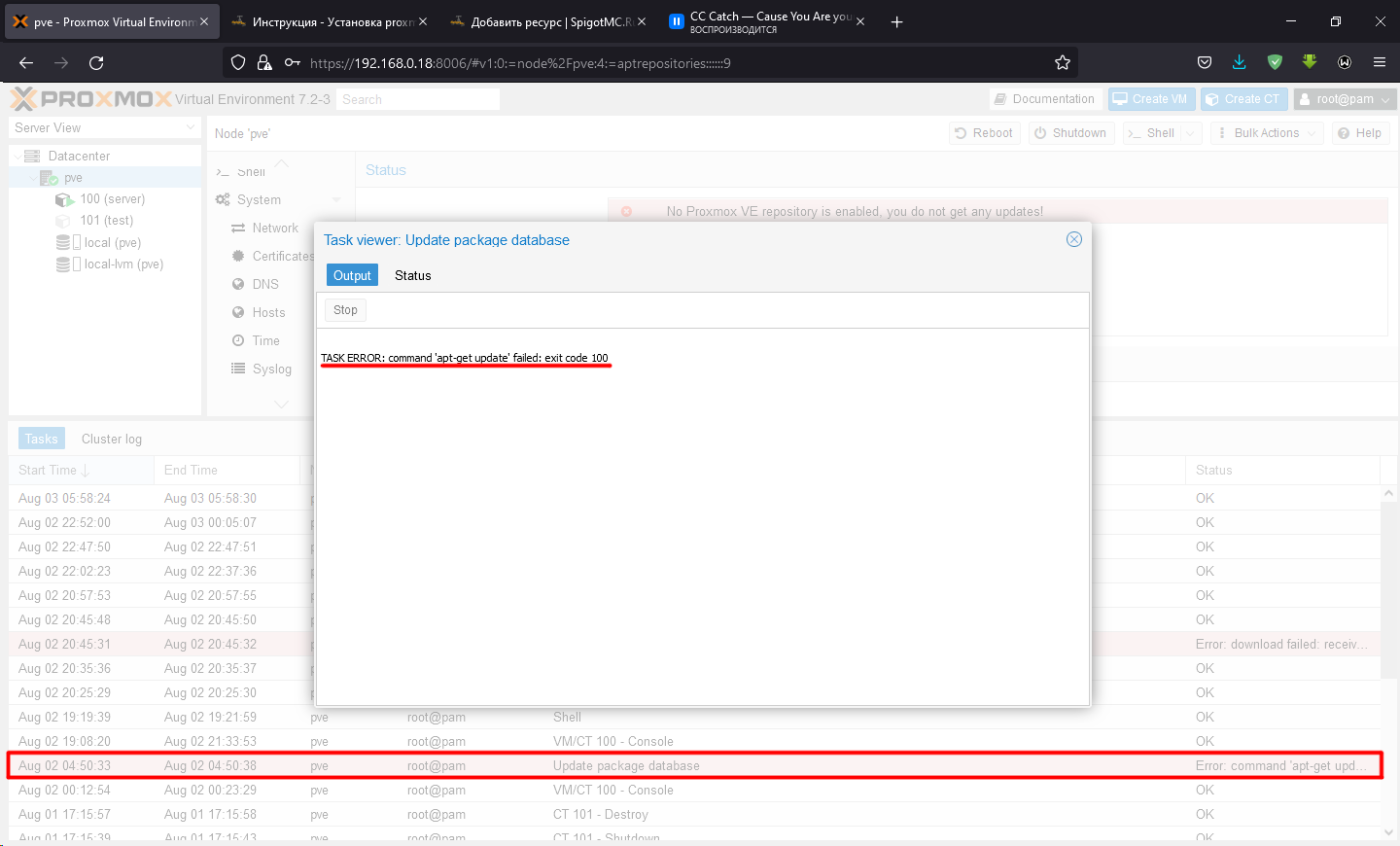

ВАЖНОЕ замечание — это было всё сделано для того, что б оффнуть в логах мусор, а так же дать право на автообновление репозиториев. Если вы не отключите эти репо, панель не сможет обновляться сама (да, она на столько умная) и будет пукать вам в логи вот такими сообщениями:

ВАЖНО! Советую отключить полностью автоматические обновления. Это очень кривая дичь, которая может “уронить” сервак, из-за того что оно что-то там намудрило.

Открываем терминал панели (Shell) и вводим:

systemctl disable pve-daily-update.timer systemctl stop pve-daily-update.timer Это отключит автоматические обновления. При нужде — обновитесь лучше ручками, чем используя эти автоматические костыли.

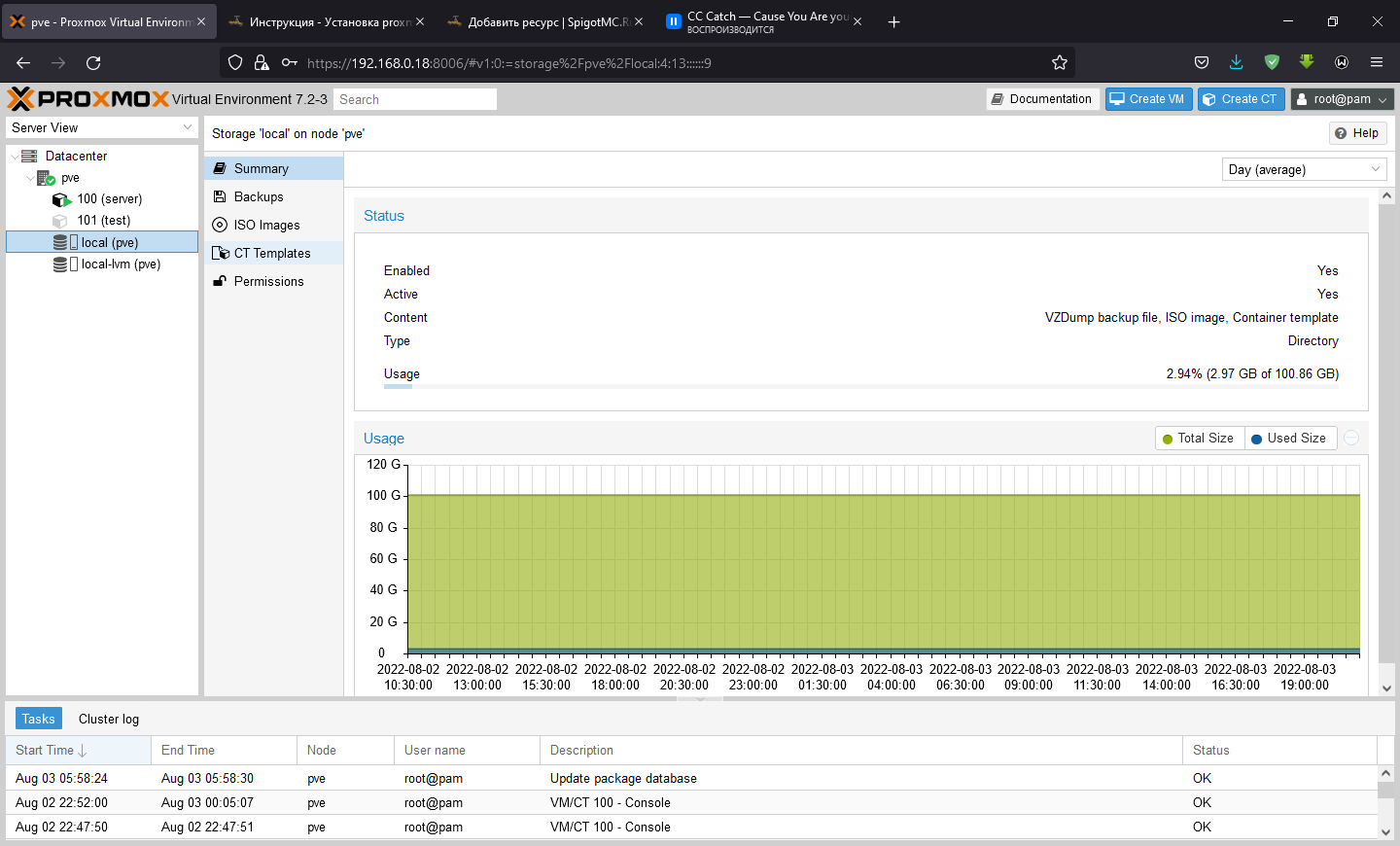

Хранение файлов, образов и дисков:

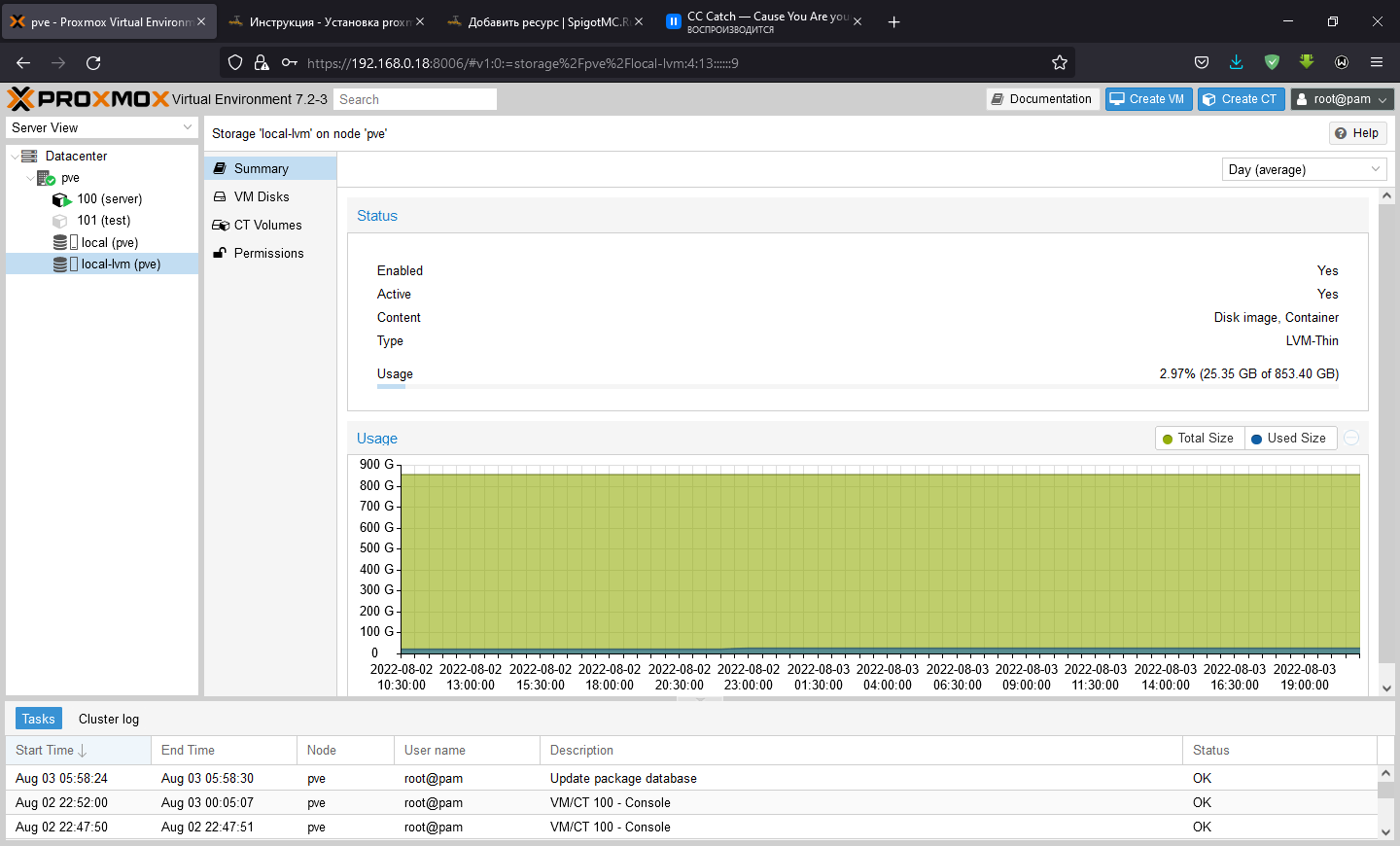

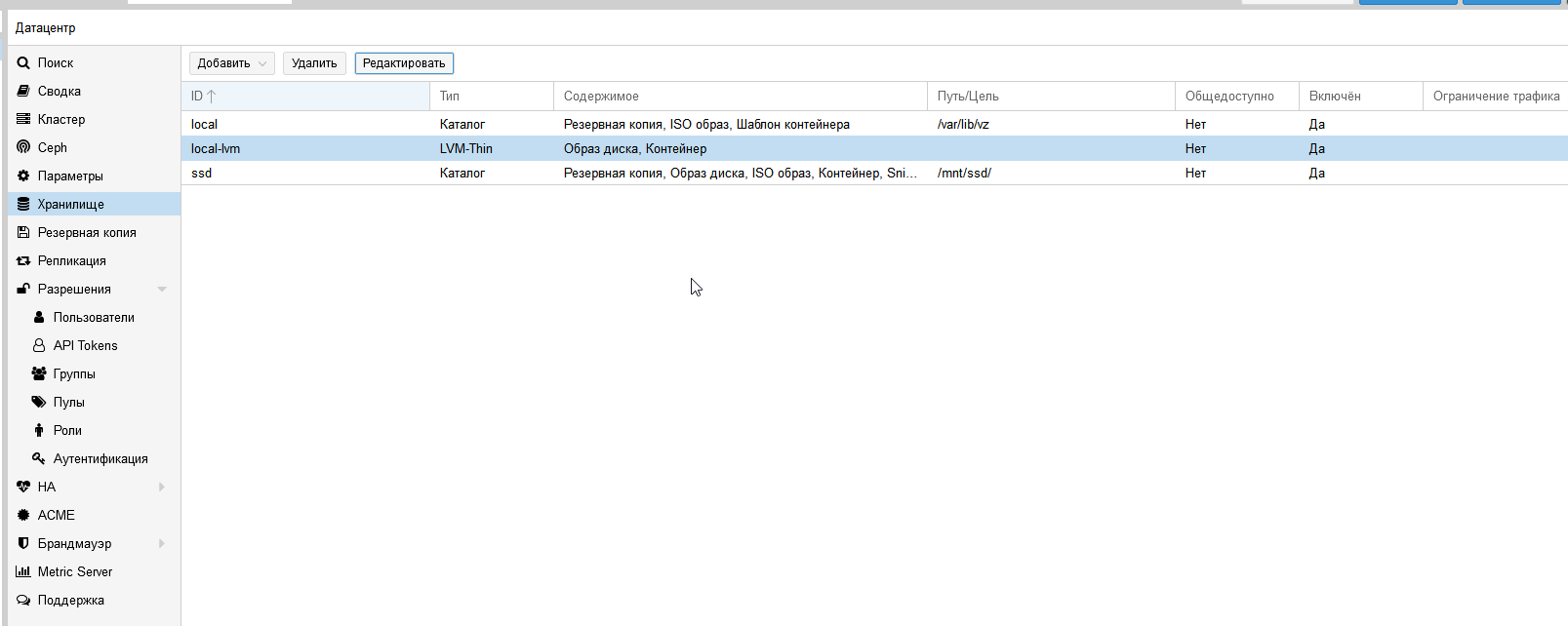

Эта панель очень умная, и имеет разбивку накопителя на два куска. Первый (local-lvm) самый огромный, служит для виртуальных дисков наших контейнеров и виртуалок. Второй (local pve) же в нашем случае является хранилищем образов что мы скачали, бекапов и прочего хлама.

Распил диска идёт +/- 10 к 90, т.е 10% на образы, 90% на виртуальные диски. Как по мне хватить должно более чем.

Что же у нас тут есть по интерфейсу:

- Summary — общая информация об использовании хранилища

- VM Disks — список всех виртуальных дисков для виртуалок

- CT Volumes — список всех виртуальных дисков контейнеров

- Permissions — разрешения, опустим пока это

- Summary — общая информация об использовании хранилища

- Backups — список всех бекапов

- ISO Images — список всех iso образов (нужно для запуска виртуальной машины)

- CT Templates — список наших образов с контейнерами, мы это уже проходили в основном мануале

- Permissions — разрешения, опустим пока это

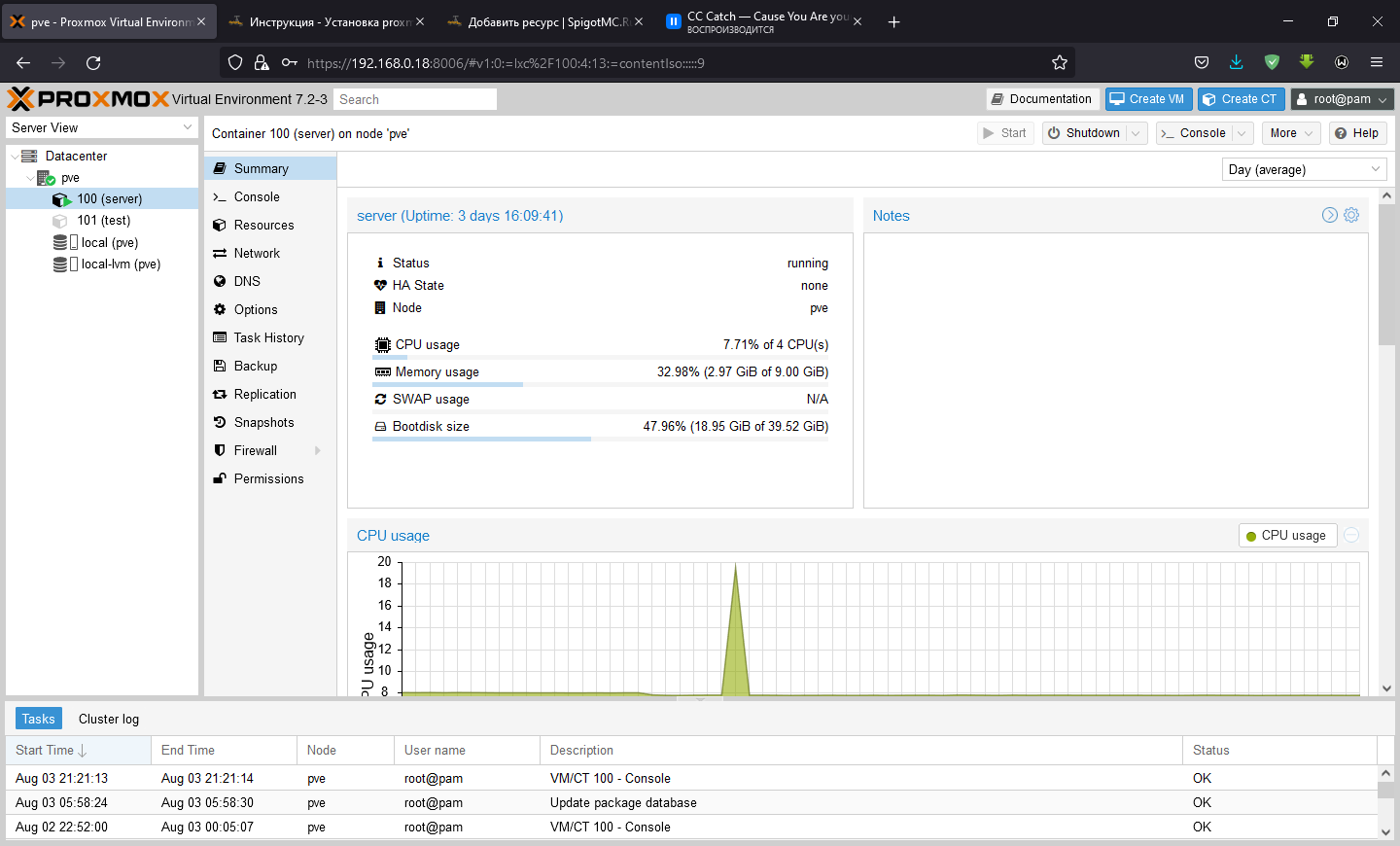

Интерфейс контейнера/ритуалки:

Данная панель предлагает обширные возможности о информации и что происходит в контейнере. Можно блин даже заметки сделать о контейнере или виртуалке. Думаю тут ничего не нуждается в представлении:

Но у нас есть интересные подразделы. Пробегусь по самым основным и критическим:

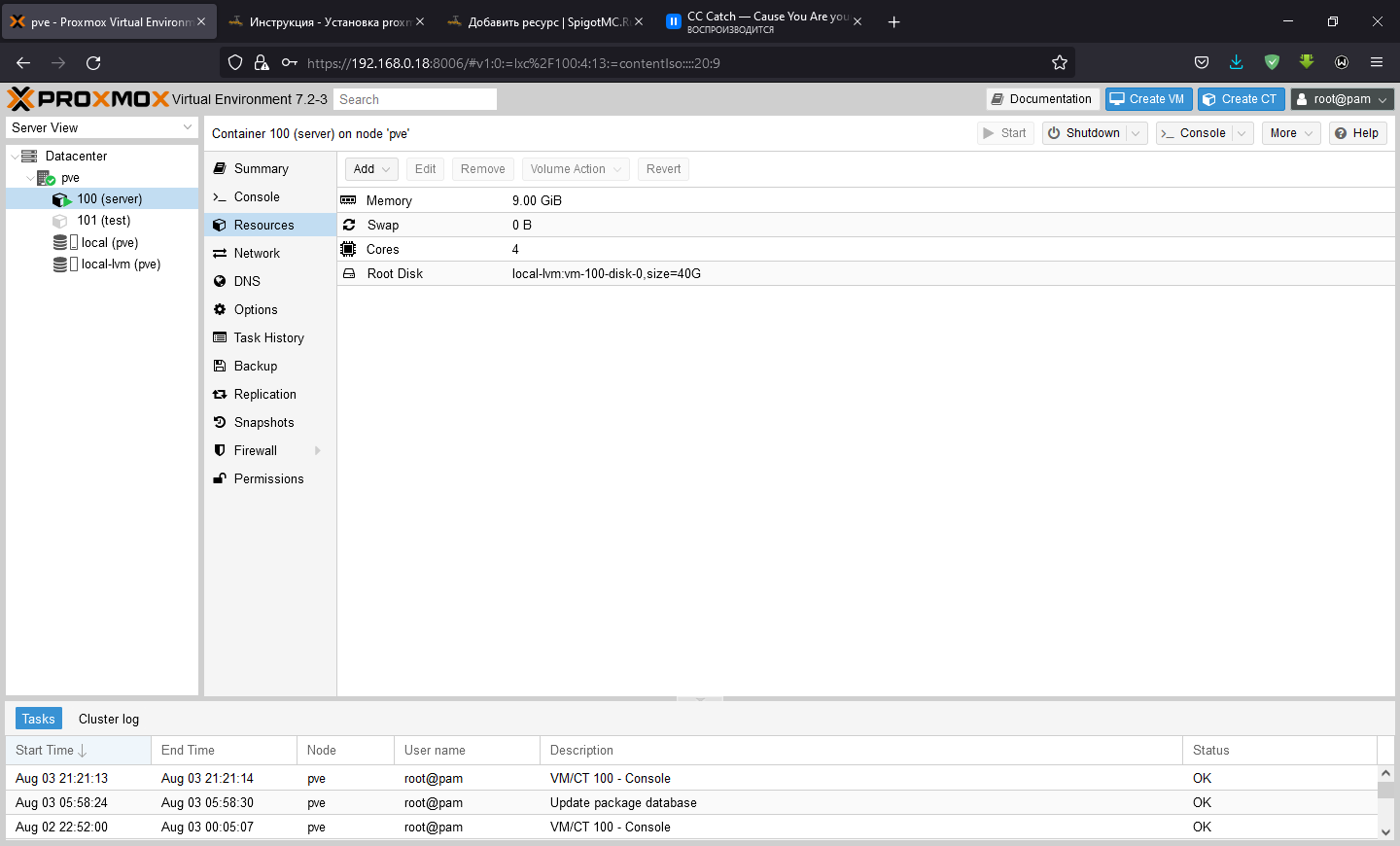

Resources. Тут мы можем редактировать ресурсы нашего контейнера или виртуалки:

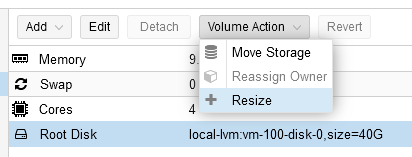

Для редакции нажмите на нужную строку и нажмите edit. Если же вы хотите расширить виртуальный диск (а это возможно без перезагрузки или остановки контейнера как и при редактировании всего из этого раздела, в этом прелесть контейнеров) нажмите на строку с диском (root disk) и после нажмите volume action и нажмите resize:

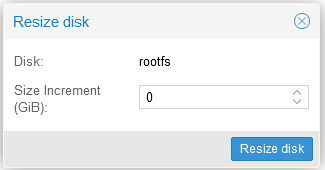

И тут добавляем сколько гигов расширить хотим:

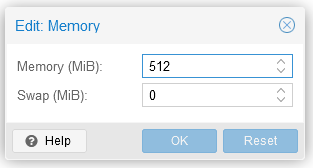

С озу и свапом точно так же, только edit жмём кнопку:

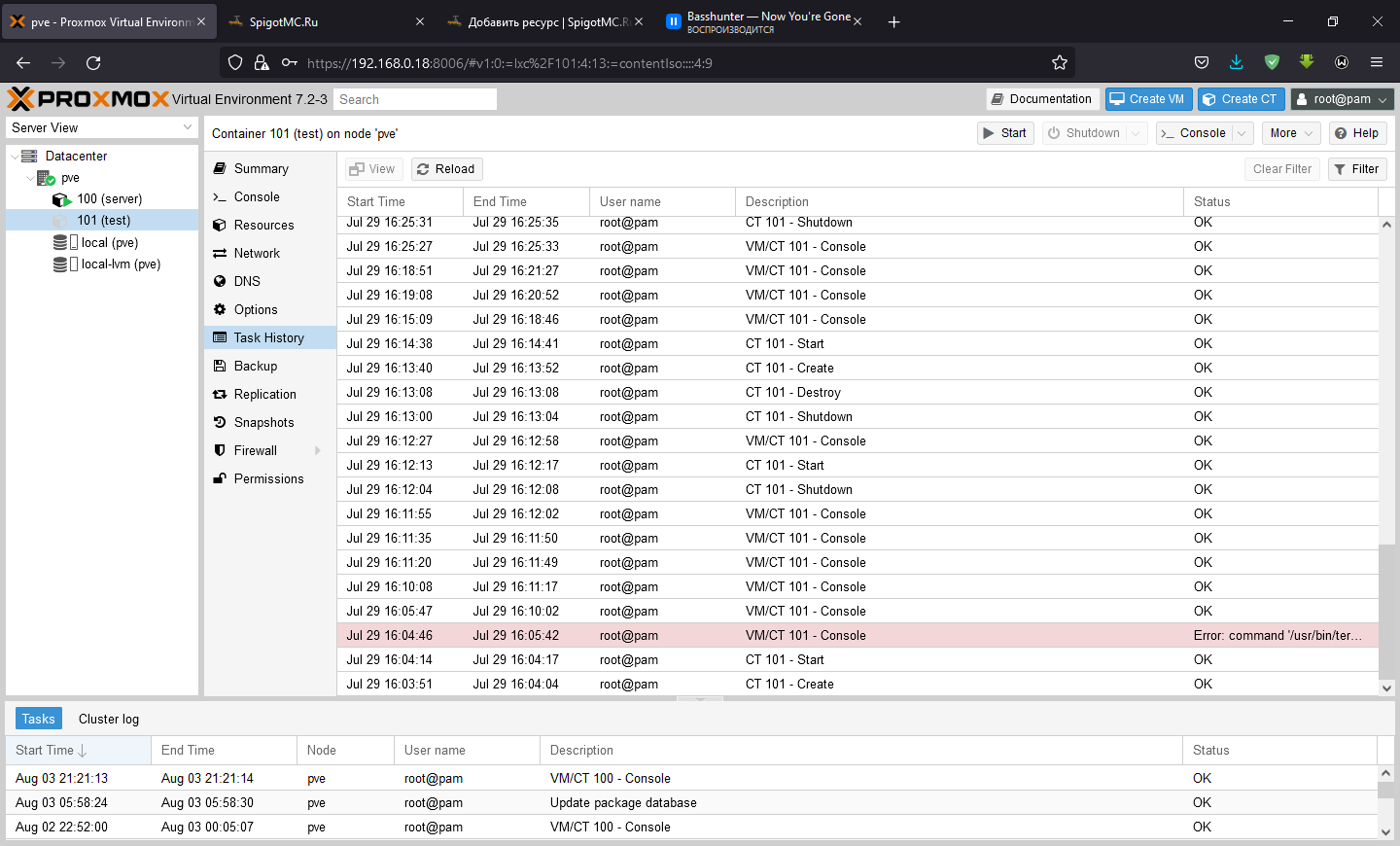

В разделе Task History можно узнать что делалось с контейнером:

Почему не могу делать бекап proxmox на «local lvm»?

раньше была только одна виртуалка на proxmox, да и на той мало что нужно было хранить, теперь пошло дело и стало 10 виртуалок, есть важные, а есть супер важные.

Задумался о бекапе , думаю делать бекапы отдельно каждой виртуалки чем то типа urbackup на другой сервер в локалке

но пока я его еще не настроил, подумал может что то штатное пойдет для начала.

Есть у меня ssd 1tb , на котором лежат все образы VM , а есть еще рейд массив из 8 дисков 500 гб места , хоть и мало но для нескольких виртуалок бы хватило, проблема в том что я не могу сохранить резервную копию на него

я не знаю что не этом local-lvm помимо образов установочных еще есть, может нечего, я просто не помню, больше года назад все настроил , при редактировании через меню выше , нельзя выбрать нечего кроме уже выбранных образ диска и контейнер , а когда в любой VM в резервном копировании выбирать место хранения , есть только local и ssd , но они уже забиты можно сказать

как быть? Как вообще поступают в таких ситуациях? Как правильно все бекапить и спать спокойно? 🙂

спасибо за ответы заранее!

- Вопрос задан более двух лет назад

- 896 просмотров

Proxmox кластер. Хранилище local-lvm при добавлении к кластеру исчезло.

Добрый день. Думаю меня нужно направить куда то почитать. Спасибо за уделённое время!

Цель создать Кластер proxmox. Тренируюсь на двух нодах (pve02 pve13). В планах 7 боевых нод загнать в кластер.

-pve02 при установке исп. zfs RAID1 (1Tb+1Tb)

-pve13 при установке исп. LVM (так как диск 1)

1. Хранилище local-lvm на pve13, после присоединения pve13 к кластеру на pve02 исчезло. Появилось local-zfs — нерабочее конечно.

Хранилище local на pve13 то доступно, то нет.

cat /etc/pve/storage.cfg dir: local path /var/lib/vz content iso,vztmpl,backup zfspool: local-zfs pool rpool/data sparse content images,rootdir Как нужно поправить конфиг что бы видеть свои ранее созданные хранилища на кождой ноде? (Единого хранилища для всех НОД (NAS СХД) нет и не будет к сожалению, каждая нода будет хранить свои машины на своих винтах)

2. На нодах которые запланировал присоединить к кластеру уже есть контейнеры и ВМы. Есть возможность присоединить вместе с ними? (усложняется всё совпадающими CTID)

3. Для чего служит HA — сердечко. По какому принципу эта система работает?

4. Что еще нужно учесть при создании кластера?

Спасибо Вам за любое участие.

Еще вопрос: на pve02 создал RAID1 — zfs. Тестирую — выключаю 1 HDD. Перезапускаю — работает. Сообщений об отсутствии 1-ого HDD в RAID1 не вижу.

5. Как мониторить состояние RAID1 ?

6.Как добавить новый HDD в RAID1 в замен успорченного?

ishk0

08.02.18 14:46:58 MSK

2. Нет, сделай бекап и потом разверни

4. HA будет работать только с общим стораджем, запускать виртуалки если они потухли на живой ноде(в общем как настроишь)

5. Лучше отдельная сетка для кластера

Ien_Shepard ★★★

( 08.02.18 15:31:45 MSK )

Ответ на: комментарий от Ien_Shepard 08.02.18 15:31:45 MSK

Спасибо.

Остался главный вопрос с хранилищем.

Посмотрел storage.cfg на не присоединённых нодах

lvmthin: local-lvm thinpool data vgname pve content rootdir,images

Добавил в кластер — толку нет.

ishk0

( 08.02.18 15:43:24 MSK ) автор топика

pvvking ★★

( 08.02.18 19:26:41 MSK )

Ответ на: комментарий от pvvking 08.02.18 19:26:41 MSK

Вы правы.

Да. Я конечно же видел этот трактат. Вот ссылки на ту тему которая меня интересует:

Простите за не смышлённость, но я не вижу тут подсказки — как реализовать задуманное.

СХЕМА того построения, которое мне требуется.

Скриншот_проблемы — к pve13 приписывается local-zfx которого у него нет. И отсутствует loсal-lvm который у него был до присоединения в кластер. (закомменчины мои эксперименты)

Описание проблемы: Не могу каждой ноде назначить своё хранилище.

Спасибо за любую подсказку.

root@pve13:~# vgdisplay -v --- Volume group --- VG Name pve System ID Format lvm2 Metadata Areas 1 Metadata Sequence No 27 VG Access read/write VG Status resizable MAX LV 0 Cur LV 3 Open LV 2 Max PV 0 Cur PV 1 Act PV 1 VG Size 931.26 GiB PE Size 4.00 MiB Total PE 238402 Alloc PE / Size 234359 / 915.46 GiB Free PE / Size 4043 / 15.79 GiB VG UUID 8KVtut-2ggY-rG13-fiWT-1g28-rzS9-tblxtw --- Logical volume --- LV Path /dev/pve/swap LV Name swap VG Name pve LV UUID vyZ7fQ-GHWQ-x90f-py3w-4JDc-sgIy-eXwA4S LV Write Access read/write LV Creation host, time proxmox, 2018-02-02 15:49:48 +0300 LV Status available # open 2 LV Size 8.00 GiB Current LE 2048 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:0 --- Logical volume --- LV Path /dev/pve/root LV Name root VG Name pve LV UUID epp7P6-T7AQ-Zp47-sdqc-tDRe-SjBT-FqC8c7 LV Write Access read/write LV Creation host, time proxmox, 2018-02-02 15:49:48 +0300 LV Status available # open 1 LV Size 96.00 GiB Current LE 24576 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:1 --- Logical volume --- LV Name data VG Name pve LV UUID id1k8m-4T1r-Fmhf-b7lP-hmDe-eQ5K-FbOJWe LV Write Access read/write LV Creation host, time proxmox, 2018-02-02 15:49:49 +0300 LV Pool metadata data_tmeta LV Pool data data_tdata LV Status available # open 1 LV Size 811.26 GiB Allocated pool data 0.00% Allocated metadata 0.42% Current LE 207683 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:4 --- Physical volumes --- PV Name /dev/sda3 PV UUID lxDBHB-qoY5-C4B0-uOCC-MRNs-MF5I-6L74n2 PV Status allocatable Total PE / Free PE 238402 / 4043