Развертывание кластеризованного файлового сервера с двумя узлами

Отказоустойчивый кластер — это группа независимых компьютеров, которые работают вместе для повышения доступности приложений и служб. Кластеризованные серверы, называемые узлами, подключаются как физическими кабелями, так и программным обеспечением. Если один из узлов кластера завершается сбоем, другой узел начинает предоставлять службу, которая называется отработкой отказа. Из-за этого процесса пользователи испытывают минимальные нарушения работы в службе. Дополнительные сведения об использовании отказоустойчивых кластеров в Azure Stack HCI см. в статье «Создание кластера Azure Stack HCI с помощью Центра Администратор Windows».

В этом руководстве описывается установка и настройка отказоустойчивого кластера файлового сервера общего назначения с двумя узлами. С помощью этих инструкций вы можете узнать о отказоустойчивых кластерах и ознакомиться с интерфейсом оснастки управления отказоустойчивыми кластерами в Windows Server 2019 или Windows Server 2016.

Как работают кластеры файлового сервера с двумя узлами

Серверы в отказоустойчивом кластере могут работать во многих разных ролях, включая файловый сервер, сервер Hyper-V или сервер базы данных. Они также могут обеспечить высокий уровень доступности для различных других служб и приложений.

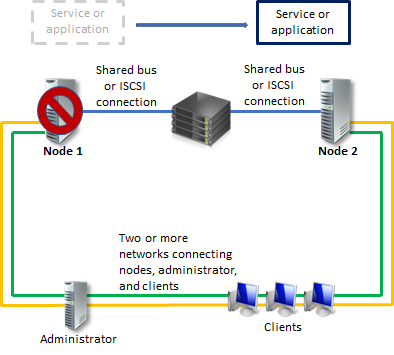

Отказоустойчивый кластер обычно включает единицу хранения, которая физически подключена ко всем серверам в кластере, хотя только один сервер одновременно может получить доступ к томам в хранилище. На следующей схеме показан двухузловой отказоустойчивый кластер, подключенный к единице хранения.

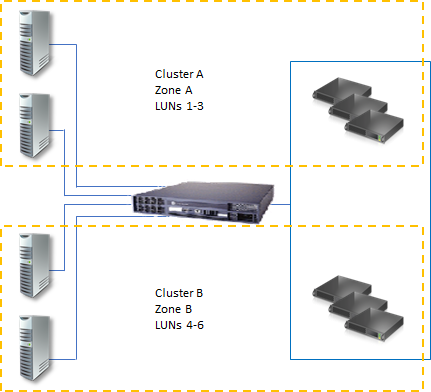

служба хранилища тома или номера логических единиц (LUN), предоставляемые узлам в кластере, не должны предоставляться другим серверам, включая серверы в другом кластере. На следующей схеме показан пример того, как выглядят изолированные LUN в развертывании.

Чтобы гарантировать максимальную доступность для любого сервера, важно следовать рекомендациям по управлению серверами. Например, необходимо тщательно управлять физической средой серверов, проверив изменения, прежде чем полностью реализовать их и отслеживать обновления программного обеспечения и изменения конфигурации на всех кластеризованных серверах.

В следующем сценарии описывается один из возможных способов настройки отказоустойчивого кластера файлового сервера. Файлы общих папок сервера находятся в хранилище кластера, то есть любой узел может выступать в качестве файлового сервера, который предоставляет им общий доступ.

Необходимые компоненты

Чтобы соответствовать критериям официально поддерживаемого развертывания, необходимо выполнить следующие предварительные требования для отказоустойчивого кластера:

- Все компоненты оборудования и программного обеспечения должны отвечать требованиям сертификации для логотипа соответствующей ОС. Для Windows Server требуется сертифицированный логотип Windows Server. Дополнительные сведения о том, какие аппаратные и программные системы сертифицированы, см. в каталоге Windows Server.

- Полностью настроенное решение (серверы, сеть и хранилище) должно пройти все тесты в рабочем процессе проверки, который входит в оснастку отказоустойчивого кластера.

Чтобы использовать отказоустойчивый кластер с двумя узлами, необходимо также выполнить необходимые условия в следующих разделах.

Серверы

Для серверов следует следовать следующим рекомендациям:

- Рекомендуется использовать соответствующие компьютеры с теми же или аналогичными компонентами.

- Серверы для отказоустойчивого кластера с двумя узлами должны выполнять ту же версию Windows Server.

- Серверы для отказоустойчивого кластера с двумя узлами также должны иметь одинаковые обновления программного обеспечения.

Сетевые адаптеры и кабели

Сетевое оборудование, как и другие компоненты в решении отказоустойчивого кластера, должно быть совместимо с Windows Server.

Если используется iSCSI, необходимо выделить сетевые адаптеры либо сетевому обмену данными, либо iSCSI, а не обоим.

Избегайте единственных точек отказа в сетевой инфраструктуре, соединяющей узлы кластера. Существует два способа, которые можно избежать одной точки сбоя:

- Подключение узлам кластера с несколькими различными сетями.

- Подключение узлам кластера с одной сетью, созданной с помощью объединяемых сетевых адаптеров, избыточных коммутаторов, избыточных маршрутизаторов или аналогичного оборудования, которое удаляет отдельные точки сбоя.

Примечание. При подключении узлов кластера к одной сети сеть сеть будет передавать требование избыточности в рабочем процессе проверки конфигурации. Однако в отчете будет содержаться предупреждение о том, что сеть не должна иметь одну точку сбоя.

Контроллеры устройств или соответствующие адаптеры для хранилища

Если вы используете последовательный подключенный небольшой компьютерный интерфейс (SCSI) или Fibre Channel, на всех кластеризованных серверах все компоненты стека хранилища должны совпадать. Программное обеспечение для многопатовых операций ввода-вывода (MPIO) и компоненты программного обеспечения для конкретного устройства (DSM) должны быть идентичными. Мы рекомендуем контроллеры устройств массового хранения, которые вы подключаете к хранилищу кластера, включая адаптер шины узла (HBA), драйверы HBA и встроенное ПО HBA, также идентичны. Если у вас нет одинаковых HBA, необходимо проверить у поставщика хранилища, который вы выполнили поддерживаемые или рекомендуемые конфигурации.

Если вы используете интерфейс iSCSI, каждый кластеризованный сервер должен иметь один или несколько сетевых адаптеров или адаптеров шины узла, предназначенных для хранилища iSCSI. Вы не должны использовать сеть, которую вы уже используете для iSCSI для сетевого взаимодействия. На всех кластеризованных серверах сетевые адаптеры для подключения к целевому хранилищу iSCSI должны быть одинаковыми. Рекомендуется использовать адаптеры Gigabit Ethernet или с более высокой пропускной способностью.

Хранилище

Необходимо использовать общее хранилище, сертифицированное для Windows Server 2016 или Windows Server 2019.

Для отказоустойчивого кластера с двумя узлами хранилище должно содержать по крайней мере два отдельных тома (LUN), если вы используете следящий диск для кворума. Диск-свидетель — это диск в хранилище кластера, которое предназначено для хранения копии базы данных конфигурации кластера.

В этом примере кластера с двумя узлами конфигурация кворума — «Узел» и «Большинство дисков». Большинство узлов и дисков означает, что узлы и следящий диск содержат копии конфигурации кластера. Кластер имеет кворум до тех пор, пока большинство этих копий доступны. Другой том, LUN, содержит файлы, которые вы хотите поделиться пользователями.

Ниже приведены некоторые другие требования к хранилищу, которые следует учитывать:

- Необходимо использовать базовые диски, чтобы использовать поддержку собственного диска, включенную в кластеризация отработки отказа, а не динамические диски.

- Рекомендуется отформатировать секции с помощью NTFS. Для дисков-свидетелей вместо этого необходимо отформатировать секцию с помощью NTFS.

- Для стиля секционирования диска можно использовать основную загрузочную запись (МБ R) или таблицу секционирования GUID (GPT).

- Хранилище должно правильно реагировать на определенные команды SCSI. служба хранилища также должны соответствовать стандарту SCSI Primary Commands-3 (SPC-3). В частности, хранилище должно поддерживать постоянные резервирования, как указано в стандарте SPC-3.

- Минипорт-драйвер, который использует хранилище, должен быть совместим с драйверами хранилища Microsoft Storport.

Требования к сетевой инфраструктуре и учетным записям домена

Чтобы использовать отказоустойчивые кластеры с двумя узлами, вам также потребуются следующие разрешения инфраструктуры и домена:

- При использовании идентичных сетевых адаптеров для сети необходимо также использовать идентичные параметры связи для этих адаптеров (например, скорость, дуплексный режим, управление потоками и тип мультимедиа). Кроме того, сравните параметры на сетевом адаптере и коммутаторе, к которому он подключается, и убедитесь в том, что они не конфликтуют. Если у вас есть частные сети, которые не направляются в остальную часть сетевой инфраструктуры, убедитесь, что каждая частная сеть использует уникальную подсеть. Необходимо убедиться, что подсети уникальны, даже если вы уже предоставили каждому сетевому адаптеру уникальный IP-адрес. Например, если у вас есть один узел кластера в центральном офисе и другой в филиале с отдельной физической сетью, не указывайте 10.0.0.0.0/24 для подсети обеих сетей, даже если вы предоставляете каждому адаптеру уникальный IP-адрес. Дополнительные сведения о настройке сетевых адаптеров см. в разделе «Предварительные требования».

- Серверы в кластере должны использовать систему доменных имен (DNS) для разрешения имен. Кроме того, можно использовать протокол динамического обновления DNS.

- Все серверы в кластере должны находиться в одном домене Active Directory. Серверы также должны иметь ту же роль домена, что и сервер-член или контроллер домена. Рекомендуется использовать роль сервера-члена.

- Рекомендуется, чтобы кластеризованные серверы были серверами-членами. Если они есть, вам нужен дополнительный сервер, который выступает в качестве контроллера домена в домене, который содержит отказоустойчивый кластер.

- При необходимости можно подключить один или несколько сетевых клиентов к отказоустойчивой кластеру. При тестировании можно наблюдать за эффектом подключения к кластеру на клиенте при перемещении или отработки отказа кластеризованного файлового сервера с одного узла кластера на другой.

- При первом создании кластера или добавлении к нему серверов необходимо войти в домен с учетной записью с правами администратора и разрешениями для всех серверов в этом кластере. Используемая учетная запись не должна быть учетной записью Администратор домена, но может быть учетной записью «Пользователи домена», которая находится в группе Администратор istrators на каждом кластеризованном сервере. Если учетная запись не является учетной записью домена Администратор, необходимо предоставить учетную запись или группу, в которую вы планируете добавить его.

Общие папки в отказоустойчивом кластере

В следующем списке описаны функциональные возможности конфигурации общих папок, интегрированные в кластеризация отработки отказа:

- Отображение область только для кластеризованных общих папок. Их нельзя смешивать с некластикционными общими папками. Если пользователь просматривает общие папки, указывая путь кластеризованного файлового сервера, отображается только общие папки, которые входят в определенную роль файлового сервера. Он исключает некластикционные общие папки и общие папки, часть отдельных ролей файлового сервера, которые могут находиться на узле кластера.

- Перечисление на основе доступа можно использовать для скрытия указанной папки из представления пользователей. Вместо того, чтобы пользователи могли видеть папку, но не получать к ней доступ, вы можете запретить им видеть папку вообще. Перечисление на основе доступа можно настроить для кластеризованной общей папки так же, как и для некластикционной общей папки.

- Вы можете настроить автономный доступ (кэширование) для кластеризованной общей папки так же, как и для некластикционной общей папки.

- Независимо от того, используется ли интерфейс отказоустойчивого кластера, Windows Обозреватель или оснастка «Общий доступ» и «Управление служба хранилища», Windows всегда распознает, является ли диск частью хранилища кластера. Если вы уже настроили кластеризованный диск в службе «Управление отказоустойчивыми кластерами» в составе кластеризованного файлового сервера, можно использовать любой из ранее упоминание упоминание интерфейсов для создания общей папки на диске. Если вы еще не настроили этот диск как часть кластеризованного файлового сервера, вы не можете ошибочно создать общую папку на нем. Вместо этого ошибка указывает, что необходимо настроить диск в составе кластеризованного файлового сервера, прежде чем предоставить к нему общий доступ.

- Роль файлового сервера в Windows Server включает в себя необязательную службу ролей, называемую службами для сетевой файловой системы (NFS). Установив службу ролей и настроив общие папки со службами для NFS, можно создать кластеризованный файловый сервер, поддерживающий клиенты на основе UNIX.

Развертывание сетей хранения данных с отказоустойчивыми кластерами

При развертывании сети области хранения (SAN) с отказоустойчивым кластером необходимо выполнить следующие рекомендации.

- Используйте сайт каталога Windows Server для подтверждения хранилища поставщика, включая драйверы, встроенное ПО и программное обеспечение, сертифицированы для Windows Server 2016 или Windows Server 2019.

- Изолируйте устройства хранения, один кластер на каждое устройство. Серверы из разных кластеров не должны иметь доступ к тем же устройствам хранения. В большинстве случаев следует изолировать LUN, используемое для одного набора серверов кластера со всех остальных серверов, используя маскирование LUN или зонирование.

- Рекомендуется использовать программное обеспечение для ввода-вывода с несколькими путими. В структуре хранилища с высоким уровнем доступности можно развертывать отказоустойчивые кластеры с несколькими адаптерами шины узла с помощью программного обеспечения многопутьного ввода-вывода. Эта конфигурация обеспечивает высокий уровень избыточности и доступности. Однако необходимо создать решение с несколькими путими в Microsoft Multipath I/O (MPIO). Поставщик оборудования хранилища также может предоставить модуль MPIO для конкретного устройства (DSM) для вашего оборудования, хотя Windows Server 2016 и Windows Server 2019 включают один или несколько DSM в составе операционной системы.

Установка кластера файлового сервера с двумя узлами

Следуйте указаниям в следующих разделах, чтобы установить кластер файлового сервера с двумя узлами.

Если вы уже установили узлы кластера и хотите настроить отказоустойчивый кластер файлового сервера, см. статью «Настройка кластера файлового сервера с двумя узлами».

Шаг 1. Подключение серверы кластера в сети и хранилище

Для сети отказоустойчивого кластера избегайте отдельных точек сбоя. Чтобы обеспечить избыточность, можно подключить узлы кластера несколькими различными сетями. Вы также можете подключить узлы кластера с одной сетью, созданной с помощью командных сетевых адаптеров, избыточных коммутаторов, избыточных маршрутизаторов или аналогичного оборудования, которое удаляет отдельные точки сбоя. При использовании сети для iSCSI необходимо создать эту сеть вместе с другими сетями.

Для кластера файлового сервера с двумя узлами при подключении серверов к хранилищу кластера необходимо предоставить по крайней мере два тома (LUN). При необходимости можно предоставить дополнительные тома для тщательного тестирования конфигурации. Не предоставляйте кластеризованные тома серверам, которые не в кластере.

Чтобы подключить серверы кластера к сетям и хранилищу, выполните следующие действия.

- Ознакомьтесь с подробными сведениями о сетях в требованияхк инфраструктуре и сетевой инфраструктуре и учетной записи домена.

- Подключение и настройте сети, которые планируется использовать на серверах.

- Если конфигурация тестирования включает клиенты или некластикционный контроллер домена, убедитесь, что эти компьютеры могут подключаться к кластеризованным серверам по крайней мере через одну сеть.

- Чтобы физически подключить серверы к хранилищу, следуйте инструкциям изготовителя.

- Убедитесь, что диски (LUN), которые вы хотите использовать в кластере, предоставляются серверам, которые вы собираетесь в кластер, и только этим серверам. Для предоставления дисков или LUN можно использовать любой из следующих интерфейсов:

- интерфейс, предоставленный изготовителем хранилища;

- Если вы используете iSCSI, используйте соответствующий интерфейс iSCSI.

- Если вы приобрели программное обеспечение, которое управляет форматом или функцией диска, следуйте инструкциям поставщика по использованию этого программного обеспечения с Windows Server.

- На одном из серверов, которые вы хотите кластеровать, перейдите к разделу Start> Администратор istrative Tools>Computer Management Disk Management.>

- Если появится диалоговое окно «Контроль учетных записей пользователей», убедитесь, что отображаемое действие является нужным, а затем нажмите кнопку «Продолжить«.

- В разделе «Управление дисками» убедитесь, что диски кластера видны.

- (Необязательно) Если требуется объем хранилища размером более 2 терабайтов, и интерфейс Windows используется для управления форматом диска, преобразуйте этот диск в стиль секционирования, называемый таблицей разделов GUID (GPT). Чтобы преобразовать диск, выполните следующие действия.

- Резервное копирование всех данных на диске.

- Удалите все тома на диске.

- В разделе «Управление дисками» щелкните правой кнопкой мыши диск (не раздел) и выберите «Преобразовать в диск GPT».

- Для томов меньше 2 терабайт, а не с помощью GPT, можно использовать стиль секции, называемый главной загрузочной записью (МБ R).

- Проверьте форматы всех предоставленных томов или LUN. Рекомендуется использовать NTFS для формата. Для диска-свидетеля необходимо использовать NTFS.

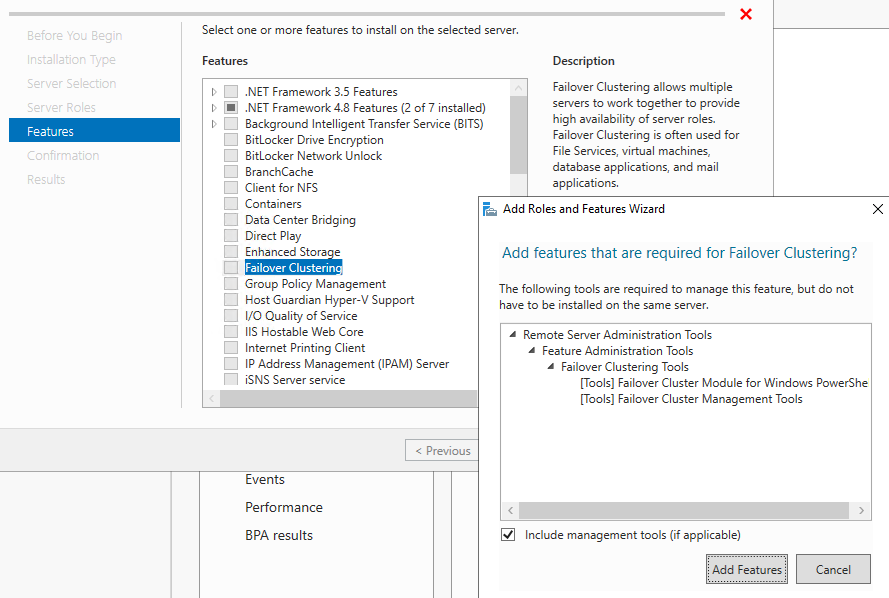

Шаг 2. Установка роли файлового сервера и компонента отказоустойчивого кластера

Затем необходимо установить роль файлового сервера и функцию отказоустойчивого кластера. Оба сервера должны работать под управлением Windows Server 2016 или Windows Server 2019.

- Диспетчер сервера

- PowerShell

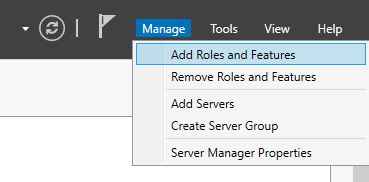

- Откройте диспетчер сервера, а затем откройте раскрывающееся меню «Управление» и выберите пункт «Добавить роли и компоненты«.

- Если откроется окно «Перед началом работы«, нажмите кнопку «Далее«.

- Для типа установки выберите установкуна основе ролей или компонентов.

- Выберите Далее.

- Выберите сервер из пула серверов и имя компьютера, который вы планируете использовать.

- Выберите Далее.

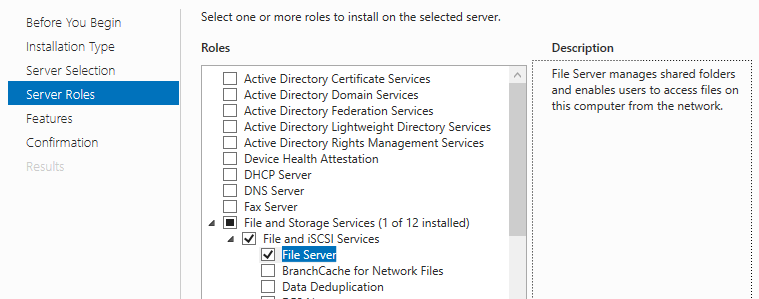

- Для роли сервера выберите файл и файловый сервер служб служба хранилища и >>файловый сервер служб iSCSI.

- Выберите Далее.

- В функциях выберите средства управления отказоустойчивой кластеризации>(если применимо)>Добавить компоненты, а затем нажмите кнопку «Далее».

- На странице Подтверждение щелкните Установить.

- После завершения установки перезапустите компьютер.

- Повторите этот процесс на втором серверном компьютере.

- Откройте сеанс PowerShell, щелкнув правой кнопкой «Пуск» и выбрав Windows PowerShell (Администратор).

- Выполните следующую команду, чтобы установить роль файлового сервера:

Install-WindowsFeature -Name FS-FileServerInstall-WindowsFeature -Name Failover-Clustering -IncludeManagementToolsGet-WindowsFeature -Name FS-FileServer Get-WindowsFeature -Name Failover-ClusteringRestart-ComputerШаг 3. Проверка конфигурации кластера

Перед созданием кластера настоятельно рекомендуется проверить конфигурацию. Проверка помогает подтвердить, что конфигурация серверов, сети и хранилища соответствует набору конкретных требований для отказоустойчивых кластеров.

- Диспетчер сервера

- PowerShell

- Откройте диспетчер сервера, а затем откройте раскрывающееся меню «Сервис» и выберите диспетчер отказоустойчивости кластеров.

- В диспетчере отказоустойчивости кластеров перейдите в средний столбец в разделе «Управление» и выберите «Проверить конфигурацию«.

- Если откроется окно «Перед началом работы«, нажмите кнопку «Далее«.

- В окне «Выбор серверов» или «Кластер» введите имена двух компьютеров, которые планируется создать новые узлы для кластера. Например, если имена запланированных узлов — NODE1 и NODE2, введите эти имена и нажмите кнопку «Добавить«. Вы также можете выбрать кнопку «Обзор», чтобы найти в Active Directory имена существующих узлов, которые можно использовать. После перечисления обоих узлов в разделе «Выбранные серверы» нажмите кнопку «Далее«.

- В окне «Параметры тестирования» выберите «Выполнить все тесты», а затем нажмите кнопку «Далее«.

- На странице подтверждения находится список тестов, которые служба выполняется для проверки. Нажмите кнопку «Далее» и дождитесь завершения тестов.

- После завершения тестирования откроется страница сводки . Чтобы просмотреть дополнительные сведения о тестах и их выходных данных, выберите дополнительные сведения о тестах проверки кластера.

- Выберите «Просмотреть отчет » и прочтите результаты теста.

- Внесите необходимые изменения в конфигурацию и повторно запустите тесты. Чтобы просмотреть результаты теста после завершения этого рабочего процесса, перейдите в отчет проверки отчетов>кластера>SystemRoot>и time.html.

- Если вам нужна дополнительная информация о проверке кластера после завершения рабочего процесса, перейдите к разделу справки по>управлению>отказоустойчивой кластерной службой,>чтобы>узнать,>как проверить конфигурацию отказоустойчивого кластера.

Test-Cluster -Node "",""Дополнительные сведения о тестах проверки отказоустойчивых кластеров см. в разделе «Проверка конфигурации отказоустойчивого кластера».

Шаг 4. Создание кластера

Чтобы создать кластер с настроенных компьютеров, выполните следующие действия.

- Диспетчер сервера

- PowerShell

Примечание. Если вы используете статические IP-адреса, необходимо вручную выбрать сеть для использования и ввести его IP-адрес в поле имени кластера. Если вы используете DHCP для IP-адресов, IP-адрес настраивается автоматически.

New-Cluster -Name -Node "","" -StaticAddress

New-Cluster -Name -Node "",""Настройка отказоустойчивого кластера файлового сервера

Чтобы настроить отказоустойчивый кластер файлового сервера, выполните приведенные действия.

- Откройте диспетчер сервера, а затем откройте раскрывающееся меню «Сервис» и выберите диспетчер отказоустойчивости кластеров.

- При открытии диспетчера отказоустойчивых кластеров вы увидите имя созданного кластера. В противном случае перейдите к среднему столбцу в разделе «Управление» и выберите Подключение в кластер. Введите имя кластера и нажмите кнопку «ОК«.

- В дереве консоли выберите > рядом с именем кластера, чтобы просмотреть элементы, содержащиеся в нем.

- Щелкните правой кнопкой мыши роли, а затем выберите «Роль конфигурации».

- Если откроется окно «Перед началом работы«, нажмите кнопку «Далее«.

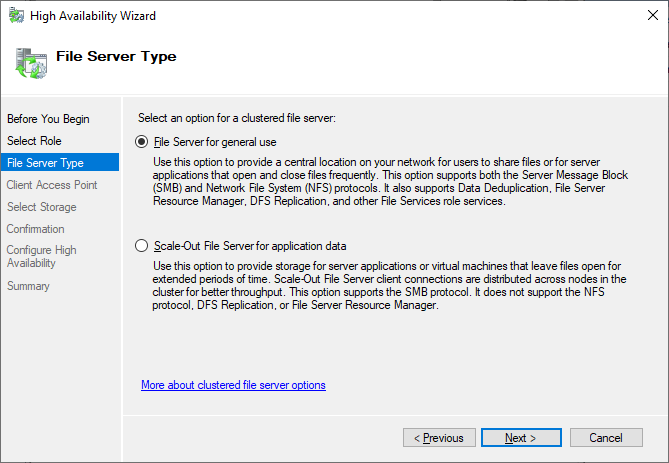

- В списке ролей выберите файловый сервер, а затем нажмите кнопку «Далее«.

- Для типа файлового сервера выберите файловый сервер для общего использования, а затем нажмите кнопку «Далее«.

- В окне точки доступа клиента введите имя файлового сервера, который планируется использовать. Это не имя кластера, а имя, используемое для подключения к общей папке. Например, если вы хотите подключиться \\SERVER , введите SERVER.

Примечание. Если вы используете статические IP-адреса, необходимо вручную выбрать сеть для использования и ввести его IP-адрес в поле имени кластера. Если вы используете DHCP для IP-адресов, IP-адрес настраивается автоматически. P-адреса, IP-адрес будет настроен автоматически.

Примечание. Если служба не добавила роль или роль не работает должным образом, объект имени кластера (CNO) может не иметь разрешения на создание объектов в Active Directory. Для роли файлового сервера требуется объект Computer с тем же именем, что и точка доступа клиента.

- Тип общего доступа.

- Предполагаемый путь к папке общего ресурса.

- Имя общего ресурса.

- Настройте любые другие необходимые параметры, такие как перечисление на основе доступа, кэширование, шифрование и т. д.

- Если вы выбираете разрешения на уровне файлов, которые не заданы по умолчанию, укажите эти разрешения, а также.

Блокчейн нода – как на ней зарабатывают криптовалюту: Гайд по установке на реальном проекте

Нода – рабочая единица блокчейна. Это программа на сервере, или устройстве. Простыми словами нода отвечает за подпись транзакций, обеспечивает стабильность сети. Нодой может выступить любое, хотя бы немного мощное оборудование, даже ноутбук. Только работать ему придется работать 24/7. Находясь в разных уголках мира, ноды, общаясь между собой обеспечивают децентрализацию. Чтобы подделать информацию в блокчейне нужно взять под контроль больше половины всех нод.

Мастрид факт: Чтобы взять под контроль сеть Биткоин, нужно захватить более 7900 серверов и компьютеров других пользователей, которые находятся в разных уголках мира.

Оглавление:

- Для чего устанавливают ноду

- Какая доходность от установки Ноды?

- Ставим ноду на примере IronFish

- Этап 1. Подготовка

- Этап 2. Аренда сервера

- Этап 3. Работа с терминалом, Запуск сервера и генерация ключей доступа

- Этап 4. Установка ноды IronFish

- Этап 5. Остальные задания Тестнета

- Этап 6. Доп. команды

- Что делать если вышло обновление

- Как проверить баланс

- Заключение

Ноды могут быть легкими (лайтноды) и тяжелыми (фуллнодами). Отличие в том, что лайтноды пропускают данные через себя, тогда как фуллноды обязаны данные хранить.

Например на лайтноду придется выделить место на 200 Мб, потому что она лишь пропускает через себя данные не сохраняя. На фуллноду нужно уже 40 Гб, так как все данные сохраняются на сервер, они-то столько и весят. Занимаемое место зависит от выбранного блокчейна.

Для чего устанавливают ноду

Чтобы блокчейн работал и транзакции подписывались, нужны компьютеры которые будут этим заниматься. Это значит что владельцев этих устройств нужно мотивировать к подключению. Обычно это происходит на фазе тестнета – в период тестирования сети и поиска багов перед официальным запуском.

Какая доходность от установки Ноды?

Например, блокчейн Sui обещает по 5000 своих токенов за установку ноды в тестовой сети. Из уже прошедшего — В октябре блокчейн Аптос раздали по 3000$ только за заявку о ее установке. Не говоря о самом запуске.

В этом гайде мы расскажем что такое нода в сфере криптовалют, и установим ее.

СПОЙЛЕР: Нода устанавливается одной строчкой кода

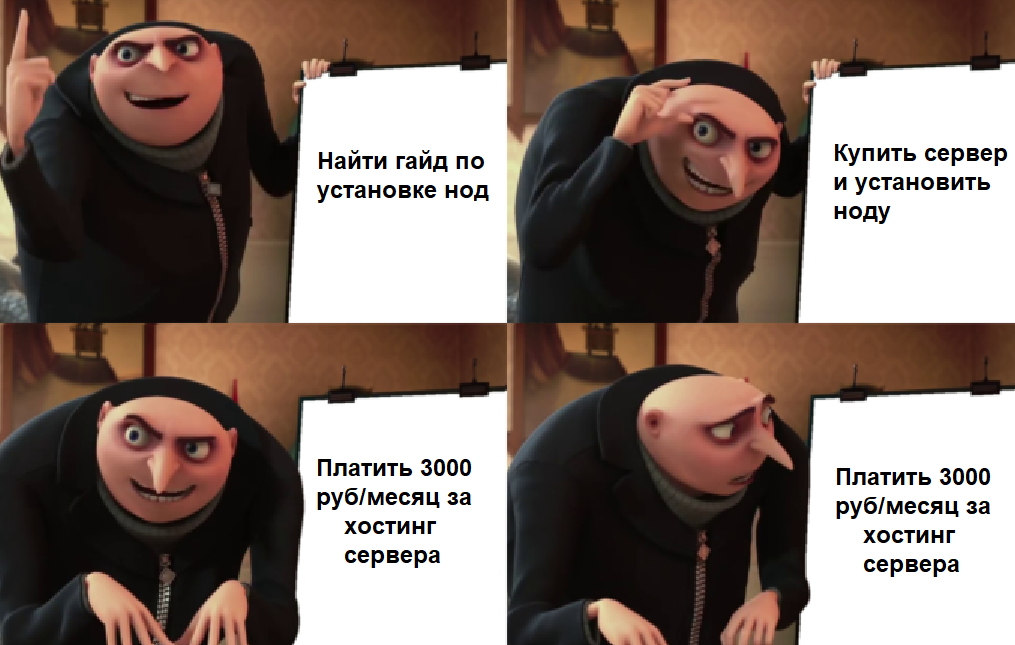

Ставим ноду на примере IronFish

Будем ставить ноду проекта IronFish. За неё обещают награду в их токенах. Это блокчейн, работающий на ZK-Snarks. Ориентируется на полностью приватные транзакции.

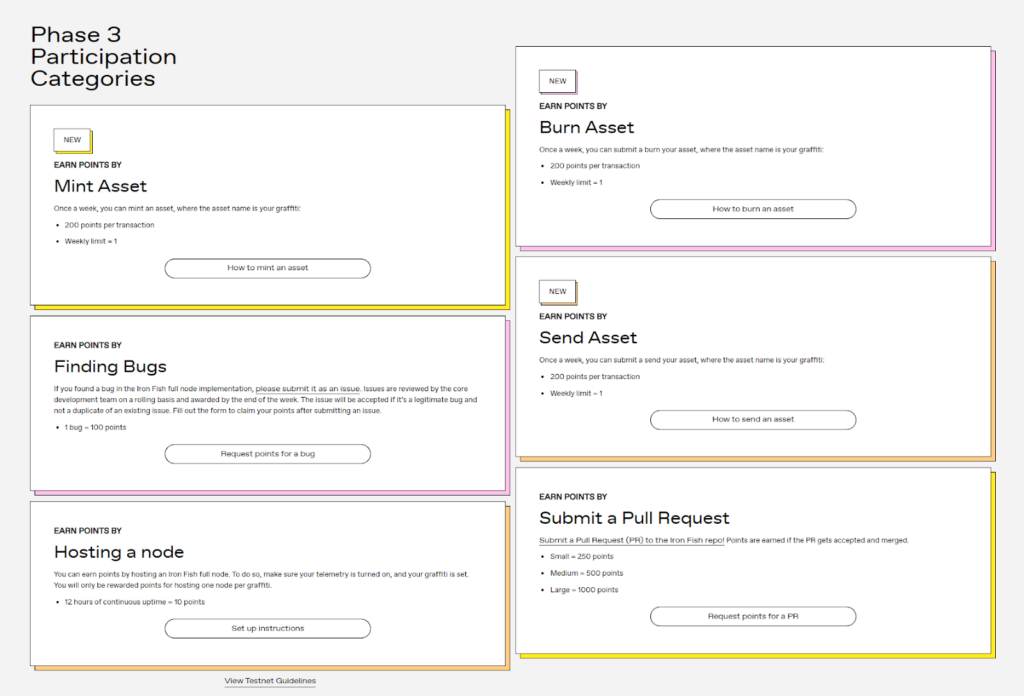

18 января IronFish запустили тестнет. Он продлится полгода. Нам предлагают выполнять простые задания за очки. Одно из заданий – установка ноды.

В будущем очки обещают обменять на токены проекта.

Интересный факт:

В Ironfish инвестировали 32.9 млн $ топовые фонды: a16z, Sequoia Capital и Electric Capital.

Установка состоит из этапов:

- Аренда сервера

- Установка на него ПО через несколько команд

- Обновление ПО раз в неделю (примерно)

- Аккаунт Github (https://github.com/)

- Аккаунт Discord или Telegram

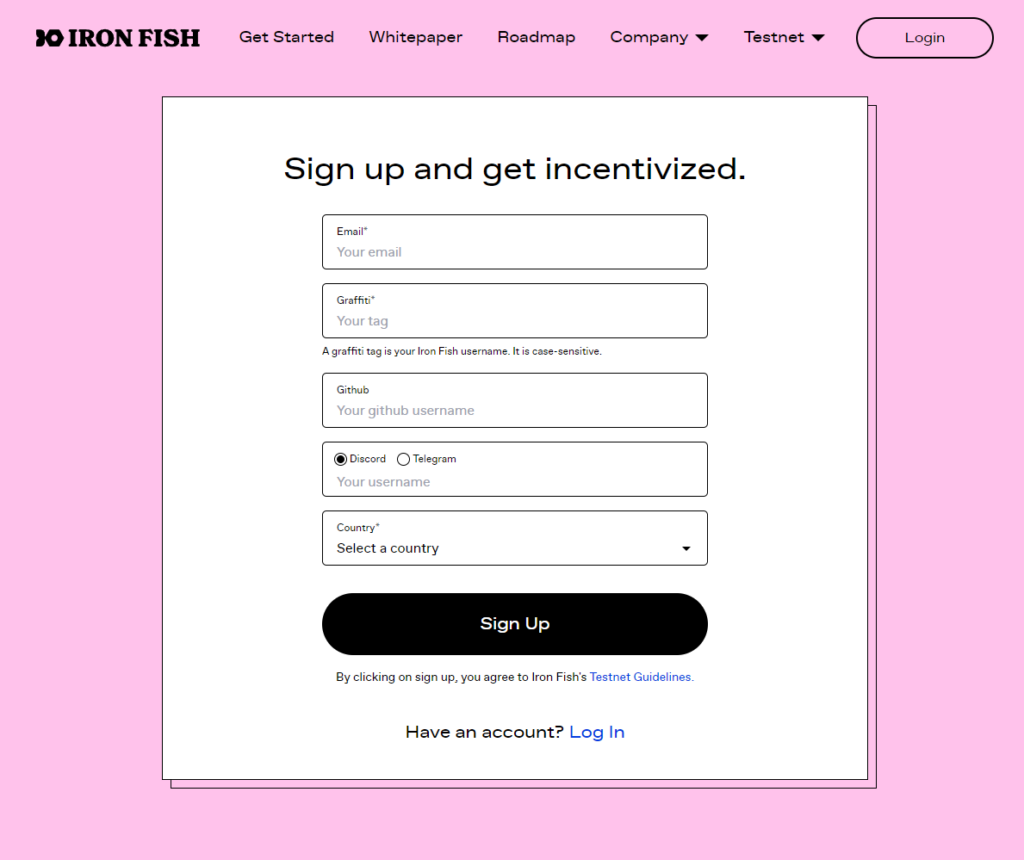

Этап 1. Подготовка

Переходим на сайт IronFish и регистрируемся. Graffiti (тэг) будет использоваться как имя кошелька и ноды.

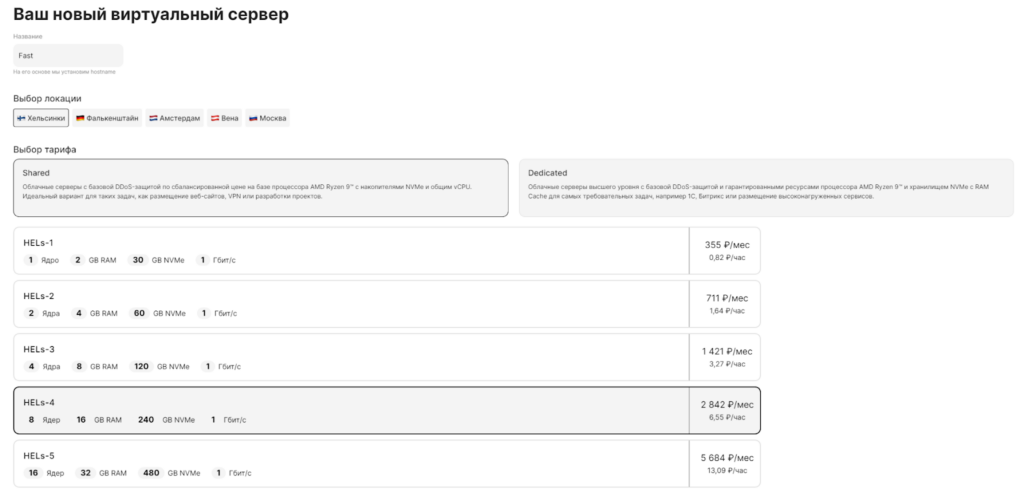

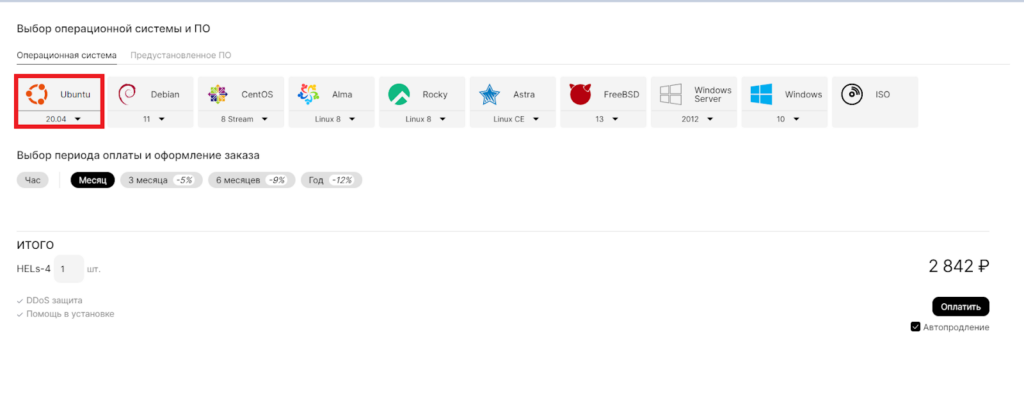

Этап 2. Аренда сервера

В официальных чатах IronFish советуют для ноды сервер с такими техническими характеристиками:

- CPU 4

- RAM 8

- SSD 160 GB

- Ubuntu 20.04

Теперь арендуем сервер по нужным характеристикам. Лично я пользуюсь сервисом Aeza. Русский хостинг, дают личного менеджера с оперативной обратной связью. Не реклама.

При регистрации по реф. ссылке получишь +15% к балансу. (Бонус работает если внести депозит в первые сутки)

Операционную систему выбираем Ubuntu 20.04. По дефолту стоит 22.04.

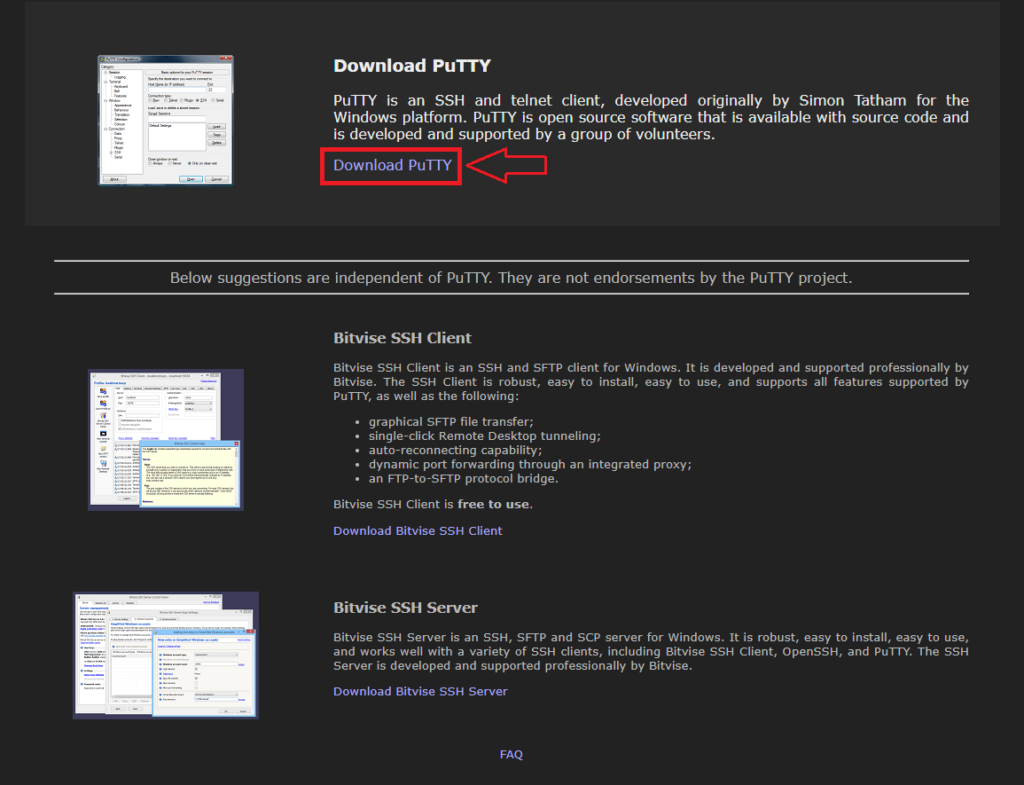

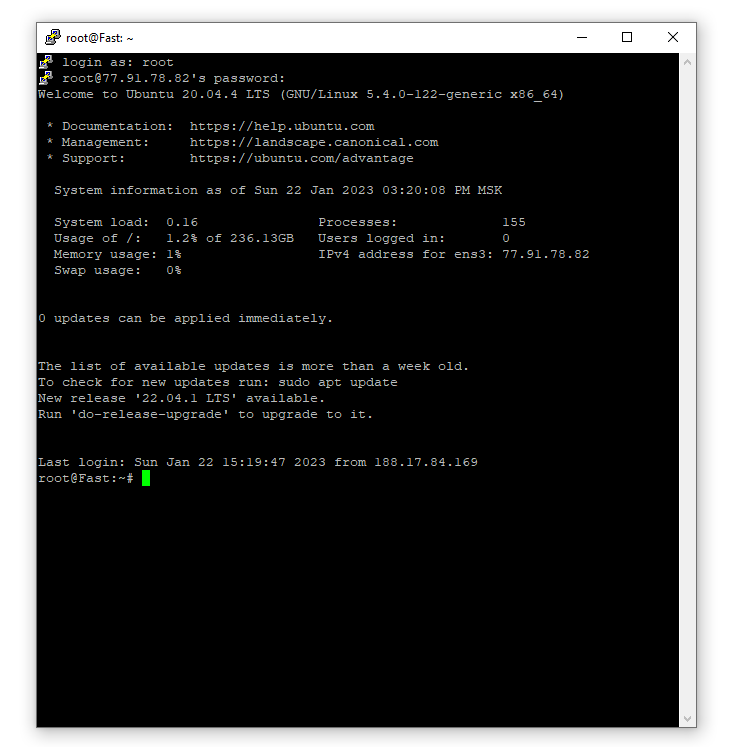

Этап 3. Работа с терминалом, Запуск сервера и генерация ключей доступа

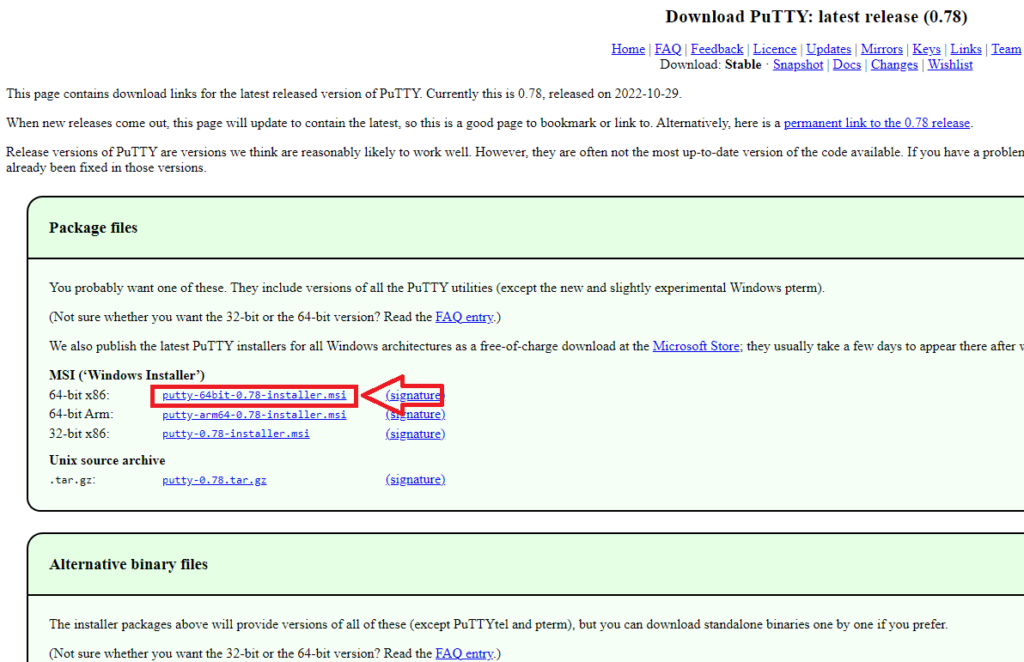

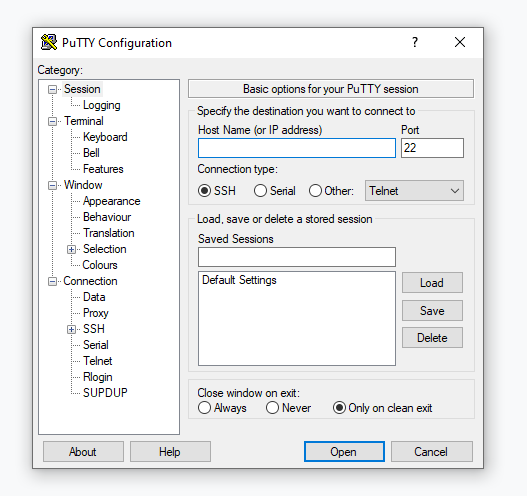

Серверами управляют через терминал. Он похож на простую консоль для ввода команд. Мы будем использовать PuTTY. Установим его.

Качаем по первой ссылке.

Устанавливаем и открываем. Интерфейс выглядит так.

Этап 4. Установка ноды IronFish

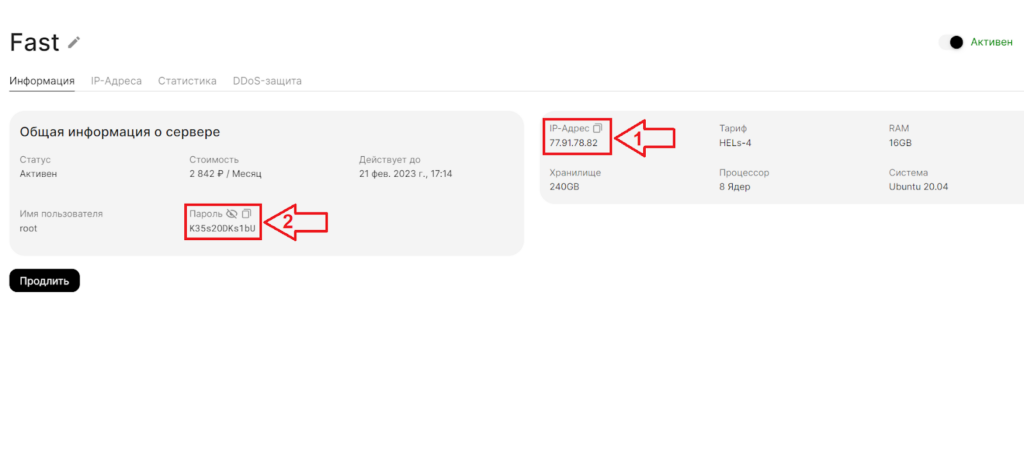

Переходим на страницу нашего сервера и копируем IP-адрес.

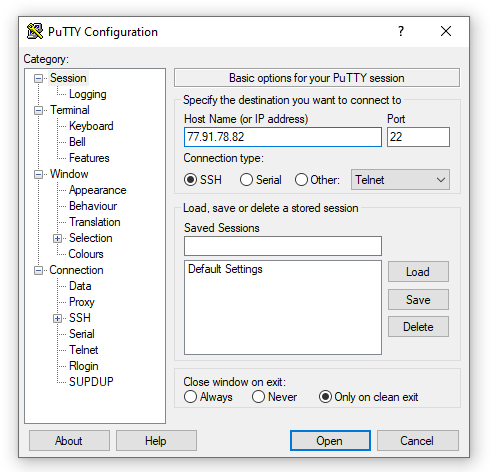

Вставляем IP в строку Host Name в PuTTY, настройки не меняем. Скопируй сразу пароль в левой части экрана. Жмём Open. Мы зашли на наш сервер.

В открывшейся консоли напротив login as: пишем root (логин)

В консоли пароль невидимый в целях безопасности. Чтобы его вставить, нажми ПКМ и энтер. Через несколько секунд нас пустит на сервер.

Для установки ноды есть два пути:

- Установка по официальному гайду

- Установка по гайдам крипто-сообществ

Первый путь как правило долгий, так как придется вводить десятки консольных команд, самому устанавливать необходимое ПО на сервер. Поэтому воспользуемся вторым.

Крипто-сообщества объединили консольные команды и установку ПО в один пакет. Поэтому мы вместо десятка команд, воспользуемся одной.

В СНГ этим занимаются Nodes Guru

Интересный факт

На один сервер, можно ставить ноды разных проектов. Жаль, но ноды одинаковых проектов ставить нельзя

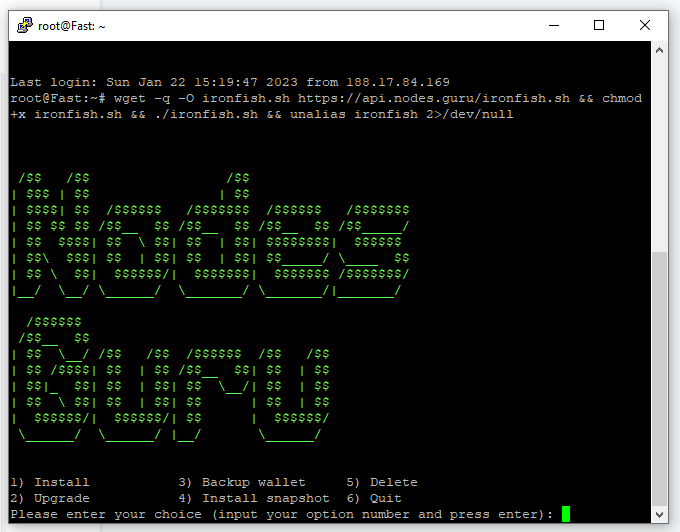

Воспользуемся пакетом от Nodes Guru.

Нода устанавливается в одну команду:

wget -q -O ironfish.sh https://api.nodes.guru/ironfish.sh && chmod +x ironfish.sh && ./ironfish.sh && unalias ironfish 2>/dev/nullВводим в консоль и жмем Enter.

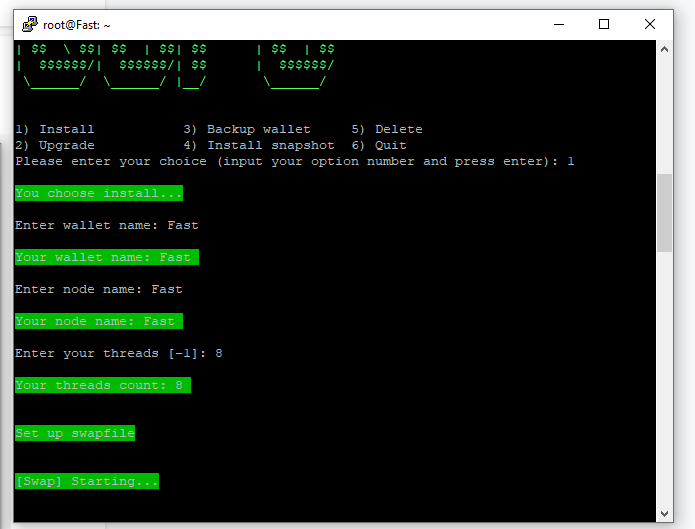

Устанавливаем, отправив цифру 1.

Заполняем по порядку, отвечая на запросы терминала:

- Вводим имя кошелька. Оно должно совпадать с тэгом Ironfish. У меня это Fast.

- Аналогично с именем ноды.

- Затем нас спросят количество ядер сервера (CPU). У меня 8.

После этого пойдет установка ноды.

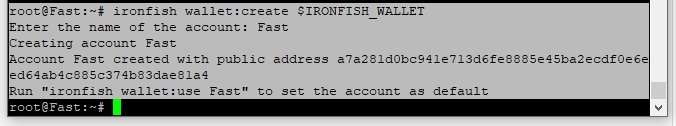

Когда устанавливается нода, на ней автоматически устанавливается кошелек для будущих токенов. Но не тот, что нам нужен. Нам нужно создать кошелек со своим тэгом. Вводим:

ironfish wallet:create $IRONFISH_WALLETНас спросят тэг. У меня Fast.

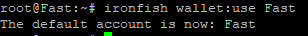

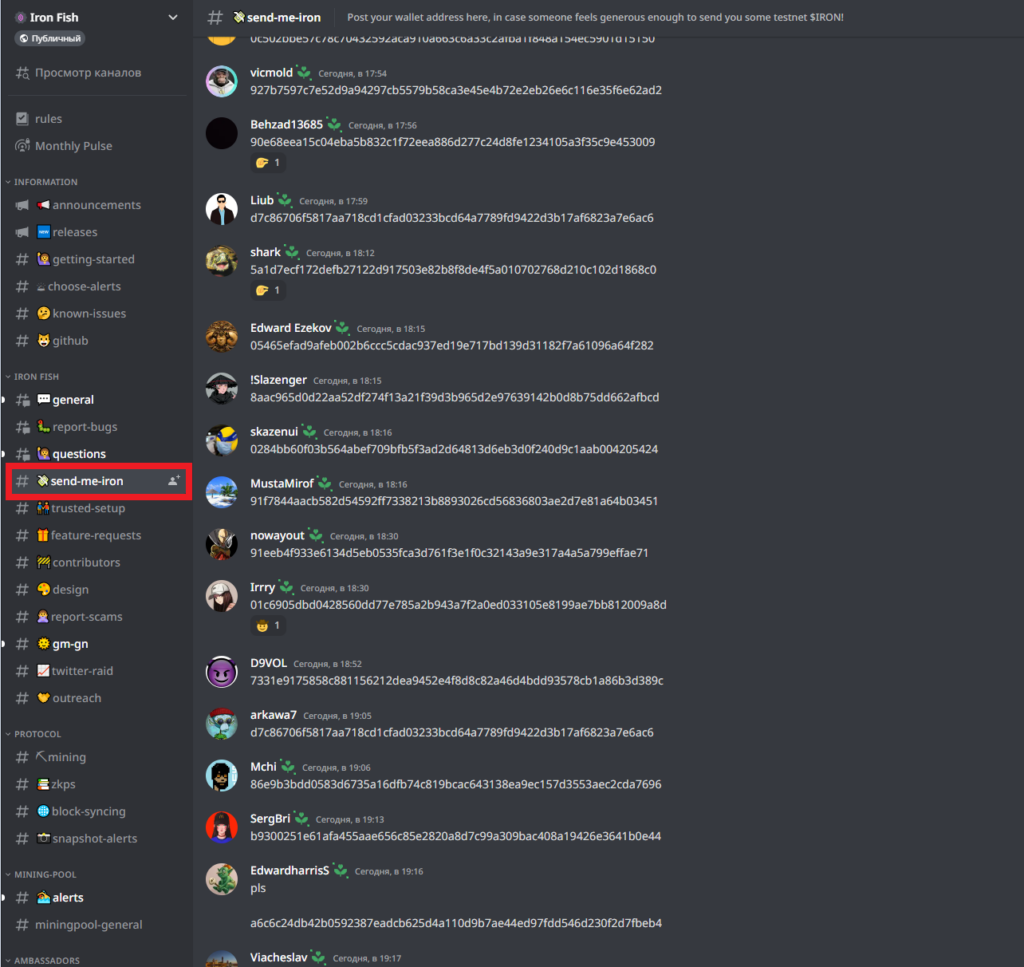

Теперь сделаем новый кошелек как кошелек по умолчанию:

ironfish wallet:use (Тэг)

Получим адрес кошелька через команду:

ironfish wallet:address

Адрес это все что идет после Public Key, у меня это a7a281d0bc941e713d6fe8885e45ba2ecdf0e6eed64ab4c885c374b83dae81a4

Теперь включаем телеметрию командой: ironfish config:set enableTelemetry true

И выключаем майнер. На него ругаются некоторые хостинги, а ещё в этой фазе тестнета он не нужен: service ironfishd-miner stop

Нода установлена. Но не закрываем терминал. Он нам ещё пригодится.

Этап 5. Остальные задания Тестнета

Чтобы получить больше очков, нужно выполнять задания: Создавать, сжигать и отправлять токены.

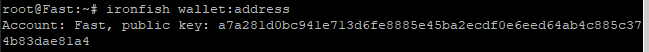

Для этого получим тестовые токены для выполнения. Есть два пути:

- Запросить с крана. Просто напиши в консоль ironfish faucet . Тебя спросят твой Email. Токены придут в течение пары часов.

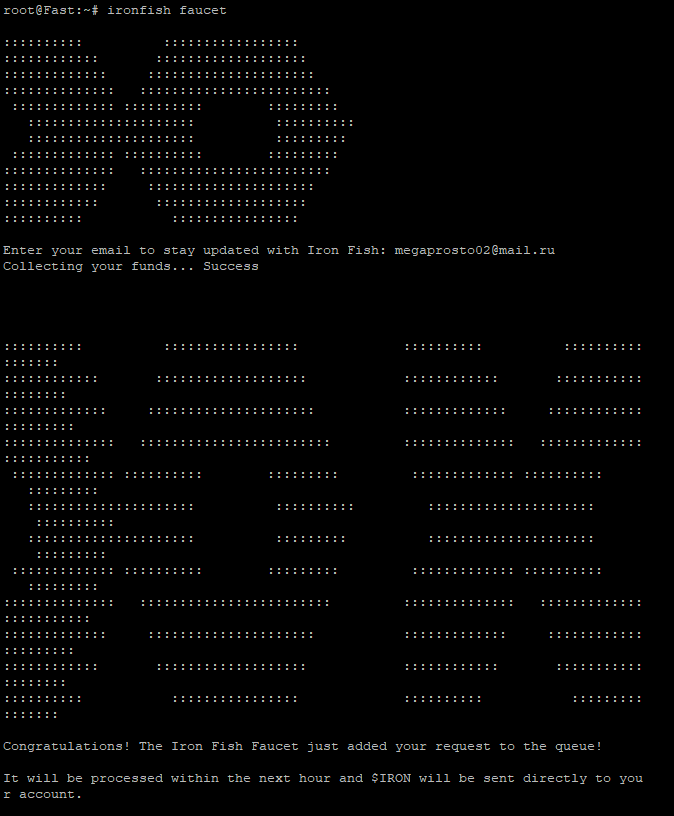

- Выпросить у пользователей. Это норма, в дискорде Ironfish даже есть соответствующий раздел: send me iron.

Кидаем туда Public Key (адрес)

После этого ждём несколько часов, пока пройдут транзакции и обновляем баланс кошелька на сервере:

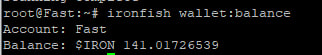

ironfish wallet:rescanЗатем можно и проверить свой баланс:

ironfish wallet:balance

Умельцы из канала How to node сделали скрипт, который автоматически выполняет остальные задания тестнета раз в 4 часа: минтит, отправляет и сжигает токены. А мы его дополнили, чтобы было удобнее запускать.

Если ставили скрипт раньше, удаляем неправильно названный скрипт:

rm mbs.sh- скачиваем скрипт:

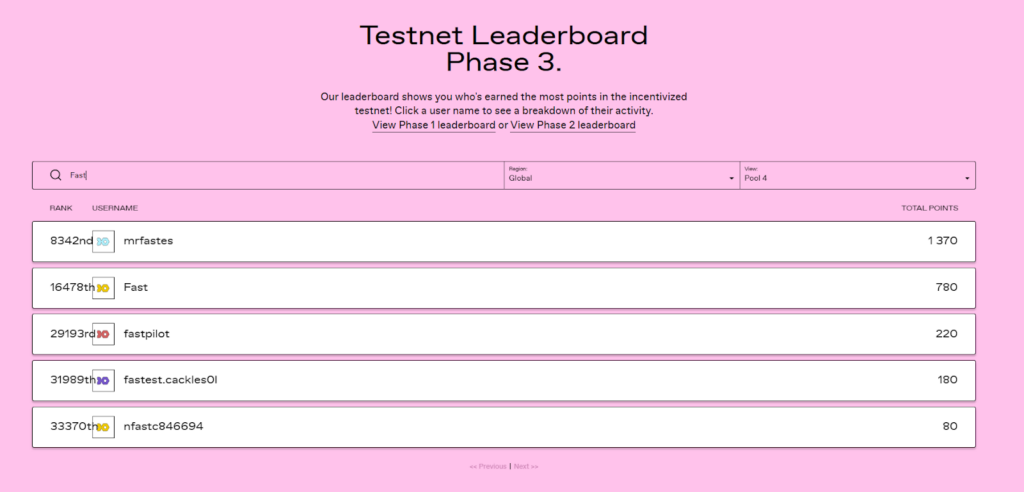

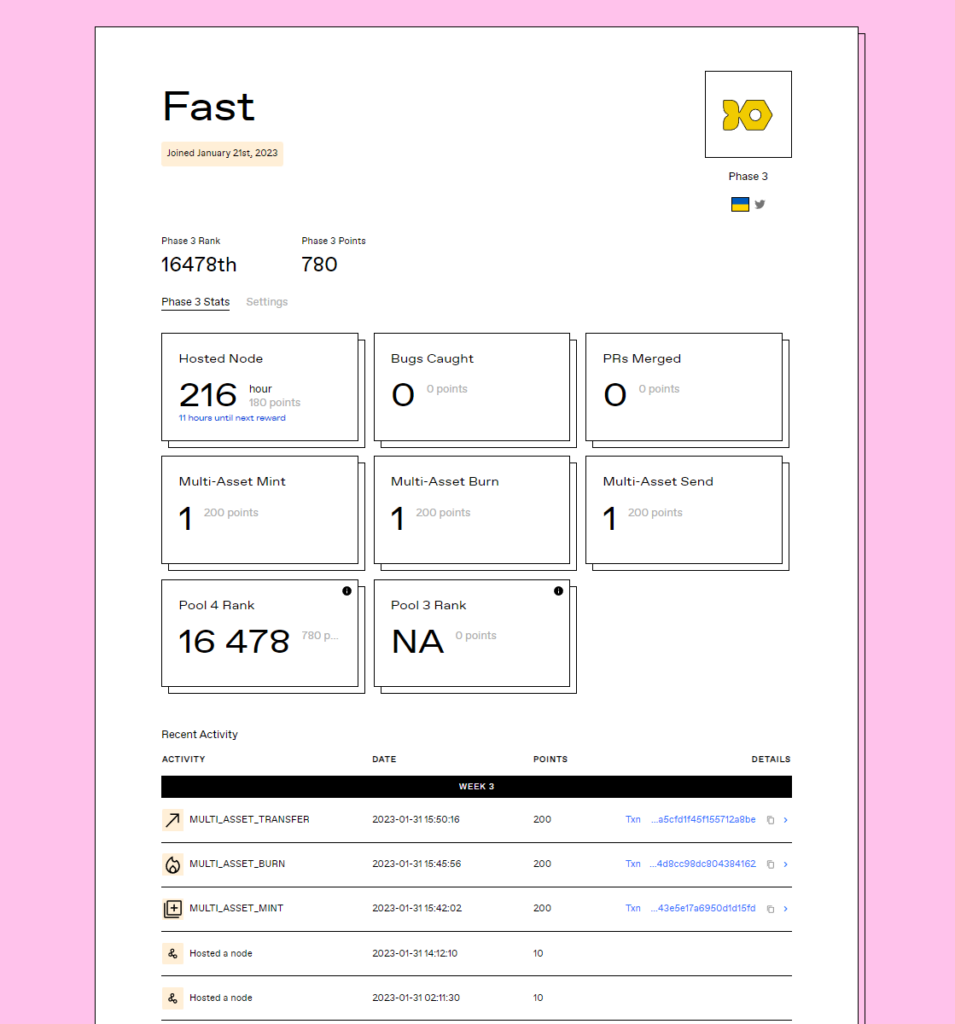

Готово. Все полученные очки можно посмотреть, вбив свой тэг в поиск таблицы лидеров.

Так например выглядит мой профиль. В нём сказано сколько часов стоит моя нода, сколько транзакций я отправил и сколько очков за всё это я получил.

Этап 6. Доп. команды

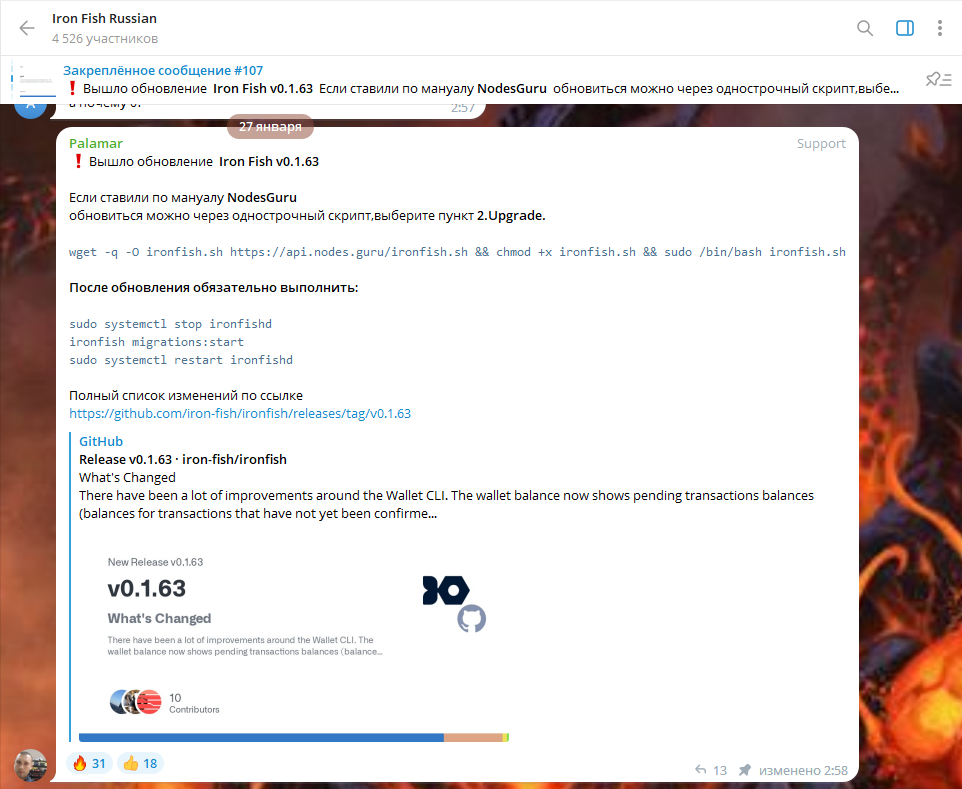

Что делать если вышло обновление

Ноды необходимо обновлять, апдейты выходят примерно каждую неделю.

Об обновлениях пишут в каналах анонсов. Ironfish обновляется через несколько строчек. Искать их здесь.

Некоторые ноды обновлять приходится через полную переустановку. Например SUI, на это уходило около часа.

Как проверить баланс

Командой ironfish wallet:balance

Если на балансе 0, а токены ты точно запрашивал с крана или пользователей, сначала напиши:

ironfish wallet:rescanЗаключение

Эта статья показывает как установить ноду любого проекта. Какие для этого понадобятся инструменты, платформы и сообщества. Где брать информацию.

Когда самостоятельно установишь ноду, ты без проблем сможешь устанавливать ноды и других проектов.

О проекте

- �� Паблик в телеграм

- �� Мы в твиттере

- О Нас

- Вакансии

- Обратная связь

- Карта сайта

- Политика конфиденциальности

- Пользовательское Соглашение

- Отзывы

ТОП Криптовалют

- Токены криптобирж

- Токены крипто кошельков

- Анонимные криптовалюты

- DeFi Токены

- Криптовалюты NFT

- Стейблкоины

- Токены метавселенных

- Фан токены

Можно ли установить 2 проекта на один VPS?

У меня есть один VPS сервер и 2 сайта.

Сайты размещены в каталогах /var/www/domains/example1.com/ и /var/www/domains/example2.com/ .

Можно ли запустить node index.js первого сайта и node index.js так, чтобы они не конфликтовали?

На каких портах их нужно запускать?- Вопрос задан более трёх лет назад

- 382 просмотра

Комментировать

Решения вопроса 1

Frontend Developer

Запускаете, например, на 3000 и 3001.

если хотите с одного хоста, то настраиваете NGINX как-то так:server < listen 80; server_name example.com; access_log /var/log/nginx/example.com; location / < proxy_pass http://127.0.0.1:3000; >location /second-project-path < proxy_pass http://127.0.0.1:3001; >>Корневой путь для первого проекта, /second-project-path для второго.

Если хосты тоже хотите разные, то так:

server < listen 80; server_name first-project.com; access_log /var/log/nginx/first-project.com; location / < proxy_pass http://127.0.0.1:3000; >> server < listen 80; server_name second-project.com; access_log /var/log/nginx/second-project.com; location / < proxy_pass http://127.0.0.1:3001; >> >Две и более мастернод на одном VPS

Зарегистрируйте новую учётную запись в нашем сообществе. Это очень просто!

Войти

Уже есть аккаунт? Войти в систему.

Поделиться

Последние посетители 0 пользователей онлайн

- Ни одного зарегистрированного пользователя не просматривает данную страницу

Similar Topics

AWEX -финансовый сервис: обмен электронных валют, хранение и торговля, более 300 криптовалют

Купить / Продать BTC / обменять любую криптовалюту > Наличные, CASH-IN Представляем Вашему вниманию криптовалютную биржу и обмен электронных валют. https://awex.pro/ru/crypto Мы поможем Вам купить, продать или обменять Вашу валюту во всех популярных направлениях, с наименьшими комиссионными потерями и самым высоким уровнем конфиденциальности! СИЛЬНЫЕ СТОРОНЫ : Большие объемы торгов, высокая ликвидность, многоуровневая система безопасности; Всег

8 Feb 2020, 12:56 в Биржи криптовалют

Индийский инженер потерял более $114 000 из-за инвестиций в мошенническую криптосхему

53-летний инженер из индийского города Бангалор стал жертвой мошенничества — он потерял 95 лакхов рупий ($114 230), инвестировав в криптовалютную схему. Мужчина рассказал, что два года назад он познакомился в Instagram с некой Соней Шеной (Sonia Shenoy), представляющей международную инвестиционную компанию, которая занимается торговлей биткоинами. В январе прошлого года она убедила мужчину инвестировать через нее в биткоин более $114 000. Ситуация стала еще более запутанной в июле

27 Dec 2023, 07:54 в Новости криптовалют

Джастин Сан вывел с Binance более 577 млрд токенов SHIB

Основатель блокчейна Tron вывел с крупнейшей криптобиржи мира Binance более 577 млрд токенов SHIB на сумму $6 млн. Об этом говорят две транзакции специально помеченного кошелька. Криптовалютный адрес с пометкой, что он принадлежит основателю Tron Джастину Сану (Justin Sun), был замечен в крупной транзакции с мемкоинами SHIB. Вывод средств с биржи произошел за два транша: 18 декабря было выведено 500 млрд SHIB на $5,1 млн, а 19 декабря был совершен еще один вывод на 70 млрд SHIB (около $900

19 Dec 2023, 20:12 в Новости криптовалют

Исследование: Более 80% институциональных инвесторов поддерживают криптовалюты

Согласно опросу банка Sygnum, более 80% институциональных инвесторов согласны, что криптовалюты играют важную роль в мировой финансовой индустрии и быстро меняют экономический ландшафт. В начале четвертого квартала исследователи банка Sygnum провели опрос среди 150 компаний, занимающихся инвестициями более 10 лет: это инвесторы в акционерный капитал, банки, хедж-фонды, семейные офисы, фонды и управляющие активами. По результатам исследования под названием Future Finance 23, большинство респ

19 Dec 2023, 09:16 в Новости криптовалют

Coingecko: Уже более половины стран мира легализовали криптовалюты

Аналитики компании Coingecko решили подсчитать уровень распространения криптовалют в мире и выяснили, что более половины стран так или иначе легализовала подобные активы. Криптовалюта сейчас в той или иной степени легальна в 119 странах, а также четырех заморских территориях Великобритании. «Это означает, что уже более половины стран мира легализовали криптовалюту», — пишут эксперты. 64,7% стран, которые легализовали криптовалюту, представляют собой развивающиеся страны

8 Dec 2023, 11:57 в Новости криптовалют

- Ответов 109

- Создана 9 Aug 2018, 13:44

- Последний ответ 4 Oct 2021, 19:48