lacp suspend-individual

When an end-host configured with port-channel LACP or NIC- or link-teaming, it requires the adjacent switch ports to receive LACP PDU to be able to start the negotiation and bring the port-channel to Up and Operational status. Without the end-host sending these LACP PDU, the switch ports will keep its status as down.

It sounds good to have this feature until you have a situation where the end-host needs to bring up just a single link while booting and without port-aggregation (LACP) it failed to send the LACP PDU to the switch. This will make the adjacent switch port to be down as part of its LACP negotiation.

This situation occurs when an end-host boots up with PXE boot to get an image but only enable a single link without LACP. The end-host’s LACP will only ever start (or to be configured) when the end-host received and installed the complete image.

In this scenario we can make the switch to bring the single interface up when the adjacent end-host is up even without sending LACP PDU. This can be achieved by telling the switch not to suspend the port if it didn’t receive LACP PDU.

lacp suspend-individual is a default configuration on Nexus switches to suspend the port if it didn’t receive LACP PDU.

The two N5K below connected to each other via port e1/1-2. Let’s assume that N5K-1 is the switch and N5K-2 is the end-host.

Ideally, both switches are configure using port-channel with LACP dynamic negotiation but for the purpose of this test, only N5K-1 is configured with LACP and N5K-2 pretend to be an end-host that just booted up with no port-channel configuration.

For testing, I’ve also put an SVI VLAN 400 in N5K1 with IP address 12.12.12.1/24 and N5K-2 with IP address 12.12.12.2/24. Configuration below.

! @ N5K-1 interface vlan 400 ip address 12.12.12.1/24 no shut int e1/1-2 switchport switchport mode access switchport access vlan 400 channel-group 400 mode active no shut int port 400 switchport switchport mode access switchport access vlan 400 no shut N5K-1# sh port-chan sum -------------------------------------------------------------------------------- Group Port- Type Protocol Member Ports Channel -------------------------------------------------------------------------------- 400 Po400(SD) Eth LACP Eth1/1(D) Eth1/2(D) ! @ N5K-2 int e1/1-2 no switchport shut int e1/1 ip address 12.12.12.2/24

Now, let’s bring the N5K-2 (end-host) interface e1/1 up.

N5K-1# sh port-chan sum -------------------------------------------------------------------------------- Group Port- Type Protocol Member Ports Channel -------------------------------------------------------------------------------- 400 Po400(SD) Eth LACP Eth1/1(s) Eth1/2(D) N5K-1(config-if)# sh int status -------------------------------------------------------------------------------- Port Name Status Vlan Duplex Speed Type -------------------------------------------------------------------------------- Eth1/1 -- unknown e 400 full 10G SFP-H10GB-C Eth1/2 -- notconnec 400 full 10G SFP-H10GB-C

N5K-1 (switch) port e1/1 will also come up with interface status as unknown and the port-channel status as suspended on port e1/1. Also watch that port-channel 400 status as SD — Switched-Down .

The LACP PDU counter also showing that N5K-1 (switch) is not receiving any from the end-host.

N5K-1(config-if)# show lacp counter LACPDUs Marker Marker Response LACPDUs Port Sent Recv Sent Recv Sent Recv Pkts Err --------------------------------------------------------------------- port-channel400 Ethernet1/1 165 0 0 0 0 0 0

Let’s disable the lacp suspend-individual and see what happens.

N5K-1(config-if)# int port 400 N5K-1(config-if)# no lacp suspend-individual ERROR: Cannot set/reset lacp suspend-individual for port-channel400 that is admin up N5K-1(config-if)# shut N5K-1(config-if)# no lacp suspend-individual Warning: !! Disable lacp suspend-individual only on port-channel with edge ports. Disabling this on network port port-channel could lead to loops.! N5K-1(config-if)# no shut

On a side note, you need to shut the port-channel before disabling the lacp suspend-individual command.

N5K-1# sh port-chan sum -------------------------------------------------------------------------------- Group Port- Type Protocol Member Ports Channel -------------------------------------------------------------------------------- 400 Po400(SD) Eth LACP Eth1/1(I) Eth1/2(D) N5K-1# sh int status -------------------------------------------------------------------------------- Port Name Status Vlan Duplex Speed Type -------------------------------------------------------------------------------- Eth1/1 -- connected 400 full 10G SFP-H10GB-C Eth1/2 -- notconnec 400 full 10G SFP-H10GB-C

See that the N5K1 port member e1/1 is now turns I — Individual and interface status shows as connected .

N5K2 (end-host) interface e1/1 status is connected and UP/UP.

N5K-2# sh ip int brief IP Interface Status for VRF "default"(1) Interface IP Address Interface Status Po300 10.1.22.22 protocol-down/link-up/admin-up Eth1/1 12.12.12.2 protocol-up/link-up/admin-up N5K-2# sh int status -------------------------------------------------------------------------------- Port Name Status Vlan Duplex Speed Type -------------------------------------------------------------------------------- Eth1/1 -- connected routed full 10G SFP-H10GB-C Eth1/2 -- disabled 1 full 10G SFP-H10GB-C

N5K2 (end-host) now has the L3 connectivity to reach the PXE server (wherever it might be) and ping test to N5K2 VLAN 400 IP address (gateway) also successful.

N5K-2# ping 12.12.12.1 PING 12.12.12.1 (12.12.12.1): 56 data bytes 36 bytes from 12.12.12.2: Destination Host Unreachable Request 0 timed out 64 bytes from 12.12.12.1: icmp_seq=1 ttl=254 time=29.158 ms 64 bytes from 12.12.12.1: icmp_seq=2 ttl=254 time=2.044 ms 64 bytes from 12.12.12.1: icmp_seq=3 ttl=254 time=1.394 ms 64 bytes from 12.12.12.1: icmp_seq=4 ttl=254 time=1.397 ms --- 12.12.12.1 ping statistics --- 5 packets transmitted, 4 packets received, 20.00% packet loss round-trip min/avg/max = 1.394/8.498/29.158 ms

Добавление гипервизора в vCenter с LACP

Привет. Сегодня будем добавлять новый гипервизор в vCenter. И не просто добавлять, а добавлять в LACP.

Первоначально необходимо выполнить подготовительные действия:

- Настроить порты на сетевом оборудовании в нужный VLAN.

- Настроить сеть на гипервизоре.

Мы будем подключать гипервизор по 4-м портам данных. Поскольку остальные гипервизоры уже работают через LACP, то на коммутаторе настраиваем для всех 4-х портов interface Port-channel и делаем настройку.

Для Cisco

no port-channel standalone-disablechannel-group XX mode activeno lacp suspend-individualДля Huawei CloudEngine

interface Eth-Trunk18 description hv1024 port link-type trunk port trunk allow-pass vlan 2 to 4094 mode lacp-dynamic interface 25GE1/0/18 description hv1024 eth-trunk 18 device transceiver 10GBASE-FIBER port mode 10G interface 25GE2/0/18 description hv1024 eth-trunk 18 device transceiver 10GBASE-FIBER port mode 10GЭто позволить портам работать и как в LACP и как Uplink.

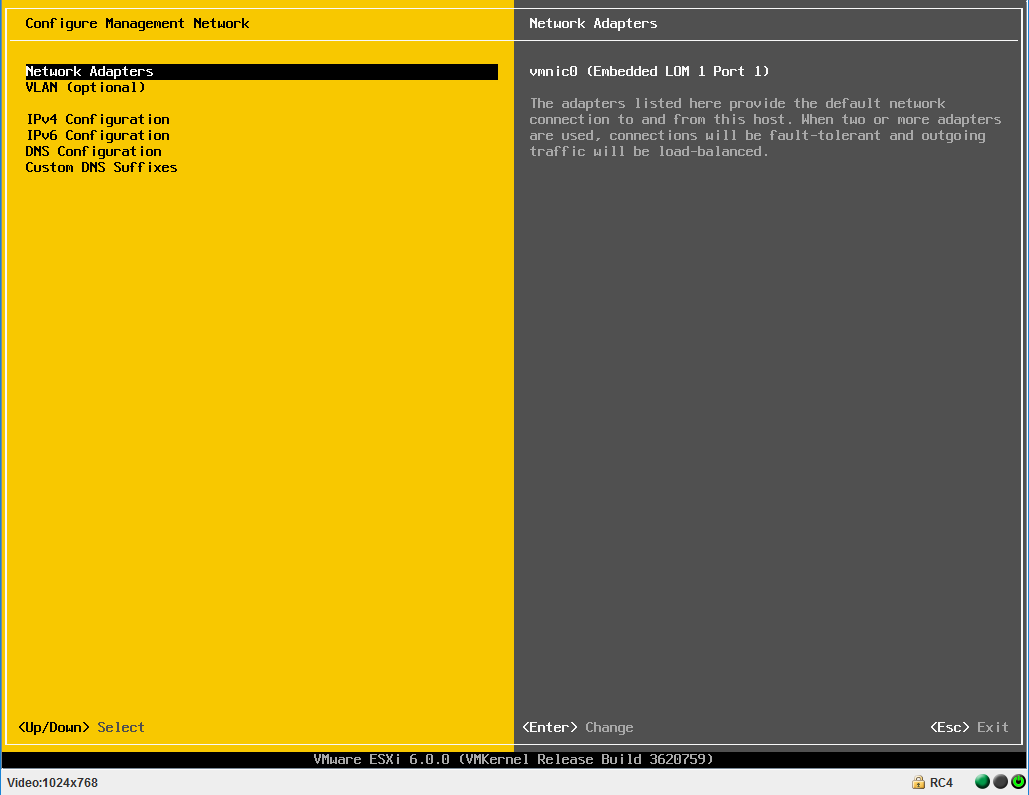

По умолчанию при установки ESXi в настройках management network прописан сетевой адаптер vmnic0. По этому порту мы будем изначально управлять настройками гипервизора, если потерять этот порт, то придётся сбрасывать сетевые настройки ESXi и начинать сначала.

Если вы подключаете гипервизор по одному кабелю данных, то проблем не будет. В случае подключения гипервизора по uplink — тоже дополнительных действий не понадобится. У нас же задача стоит шире, нужно подключить 4 провода по LACP, в vCenter это называется Lag. Однако, данное подключение можно настроить только через web-интерфейс, при этом без танцев с бубном не обойтись. Первоначально нужно добавить гипервизор через uplink, затем перенастроить на LACP.

Итак, подключаем гипервизор 4-мя кабелями данных (не считая ILO, если у вас HP сервер) по uplink.

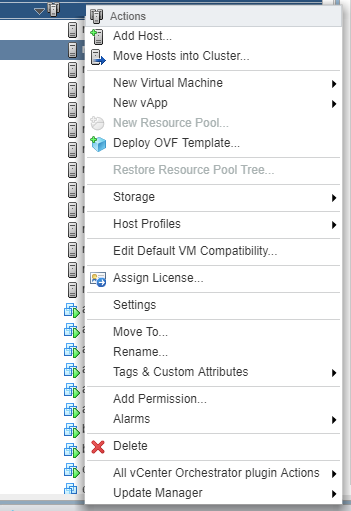

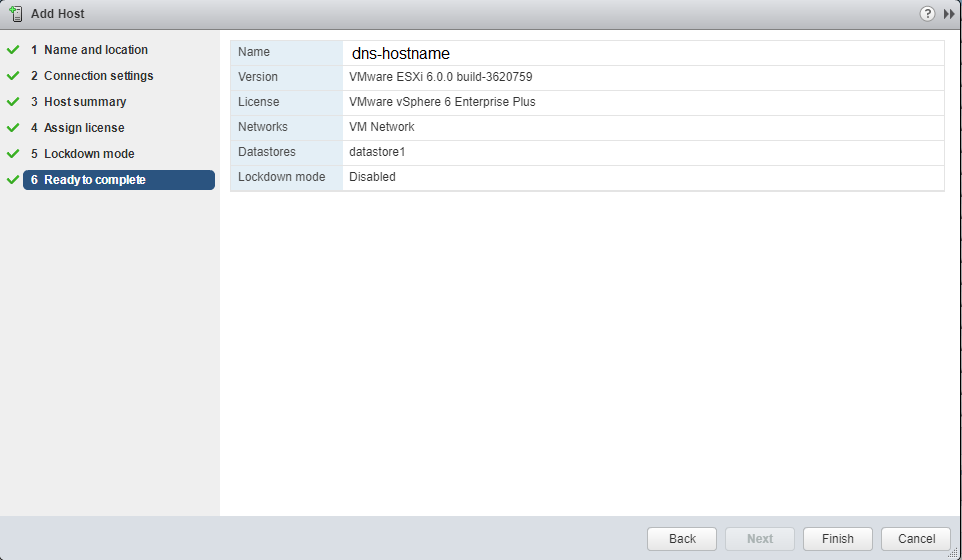

Заходим в vCenter через web-интерфейс, нажимаем правой кнопкой на выбранный кластер и выбираем пункт Add Host.

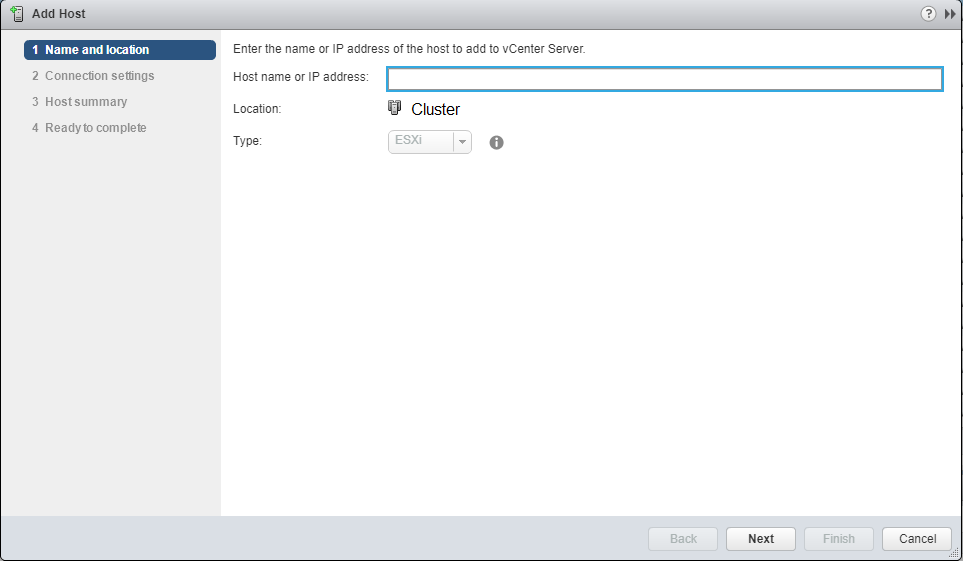

Указываем DNS имя нового гипервизора или IP адрес. Если вы используете DNS имя, то vCenter может потерять хост при неработающем DNS. Однако, использовать IP адреса неудобно при большом количестве хостов. Лучше настроить нормальный отказоустойчивый DNS сервис с несколькими серверами на разных площадках.

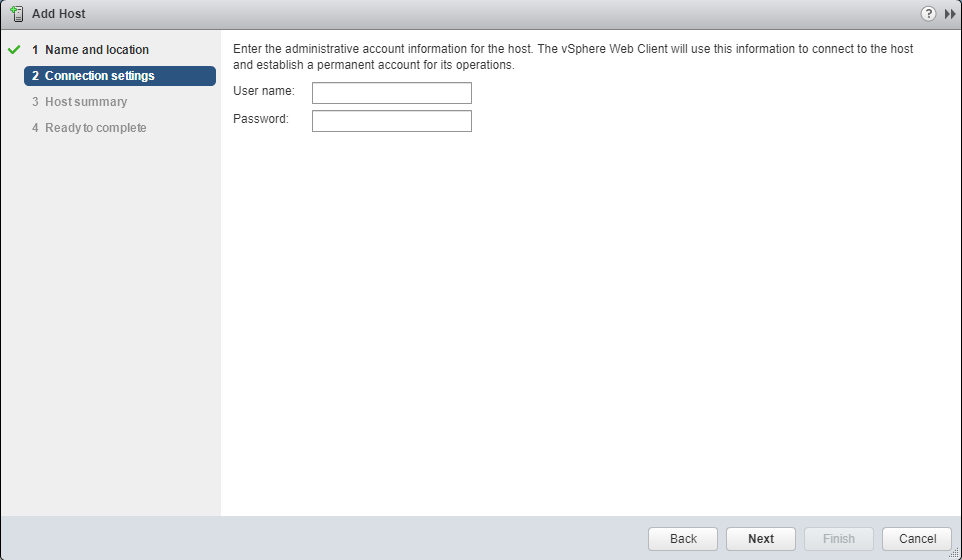

Указываем имя администратора гипервизора (root) и пароль, который настроили при установке ESXi.

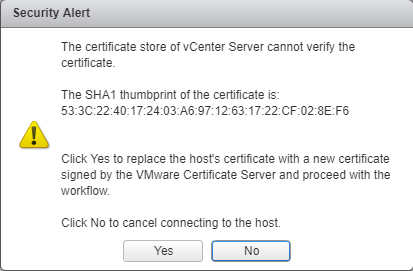

Подтверждаем замену сертификата.

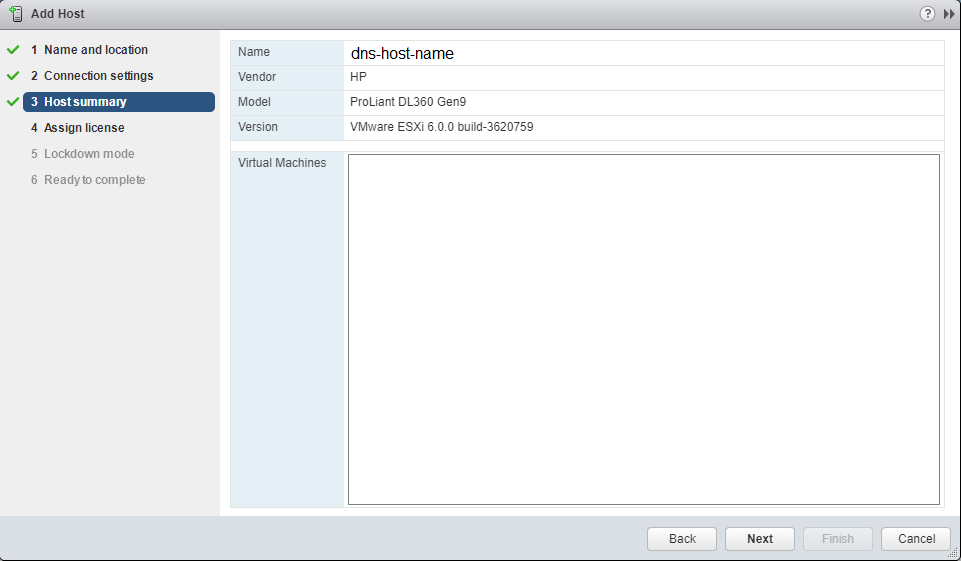

Видим данные вендора и нажимаем Next.

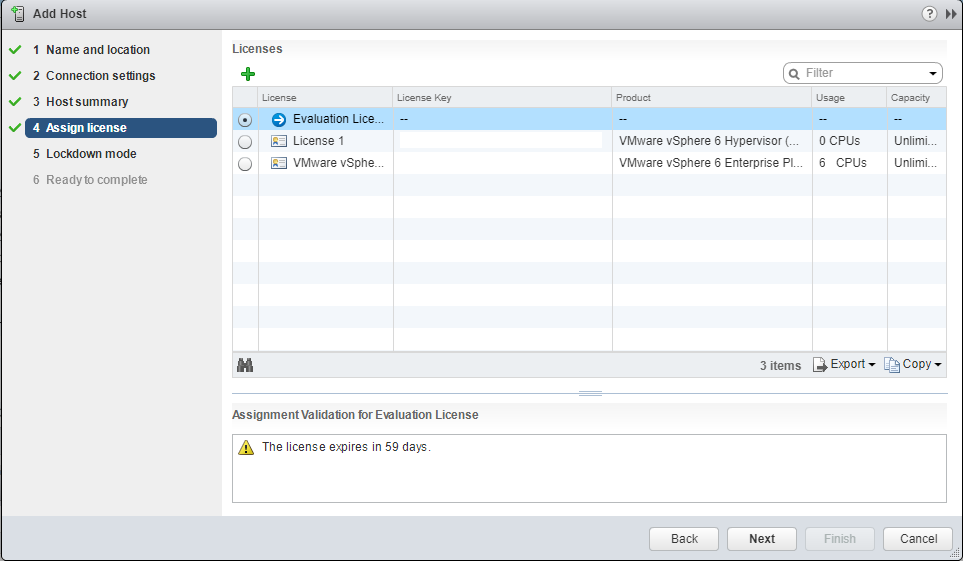

Выбираем лицензию. Вам всегда предоставят временную лицензию на 59 дней. Если вы забудете установить галку на свою лицензию, то через 59 дней карета превратится в тыкву.

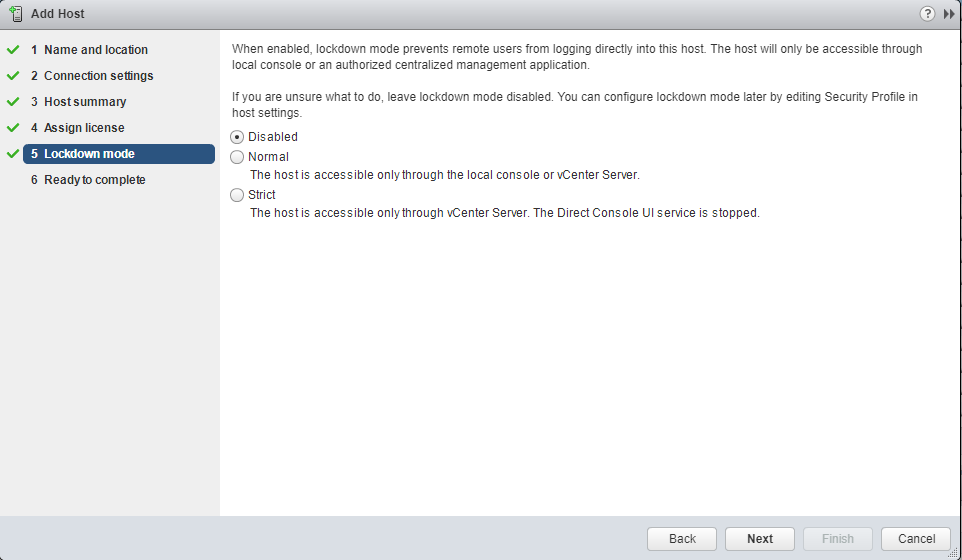

Выбираем Lockdown mode «Disabled».

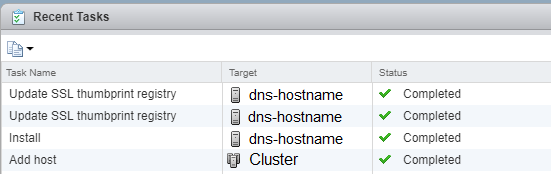

Проверяем всё на последнем экране и нажимаем Finish. Обратите внимание, VCenter нашел Datastore и назвал его datastore1. Это хранилище, на которое установлена операционная система ESXi. У меня на сервере два хранилища, их можно донастроить потом.

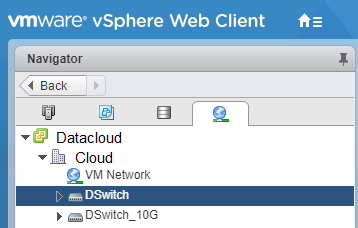

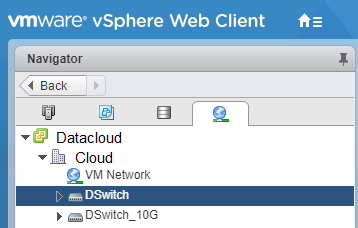

По умолчанию на гипервизоре устанавливается свитч vSwitch0, VMkernel adapter vmk0, настроенный на этот локальный свитч, сеть VM Network. Будем переключать наш новый гипервизор в общий Distributed Switch (DSwitch) с нашими VLAN. Переходим на вкладку Networking.

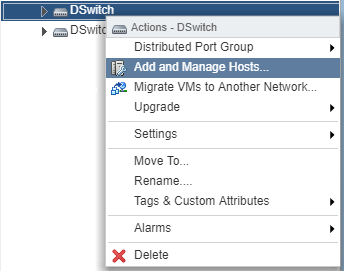

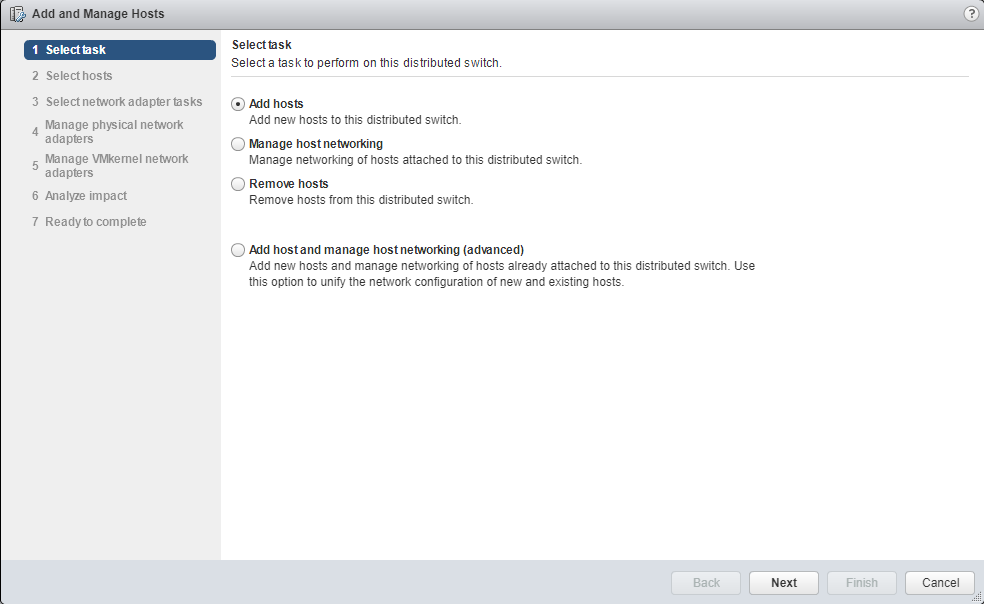

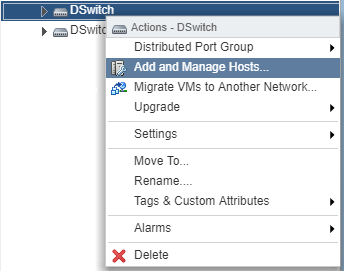

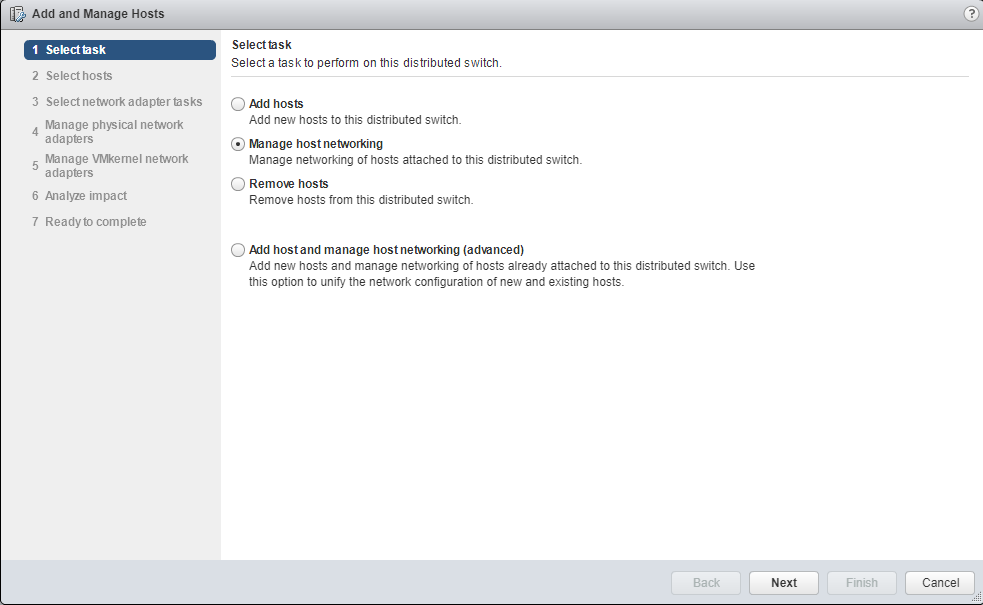

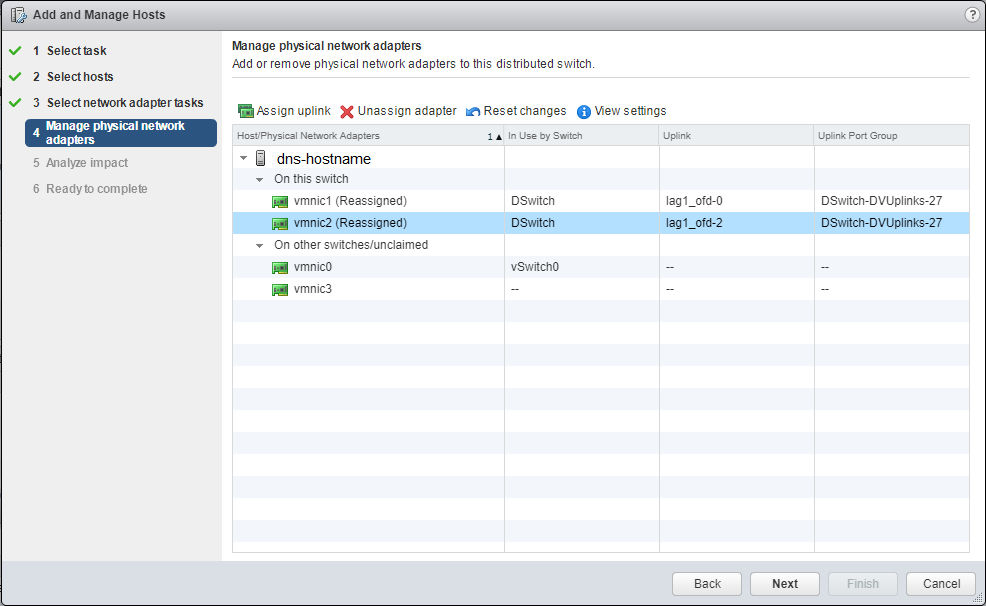

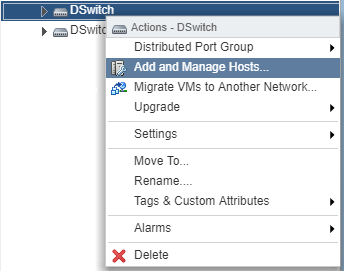

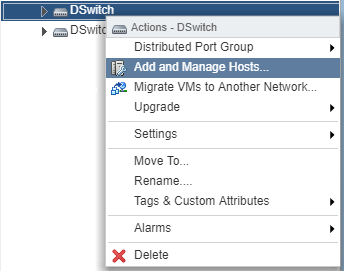

Кликаем правой кнопкой на нужный коммутатор, выбираем Add and Manage Hosts.

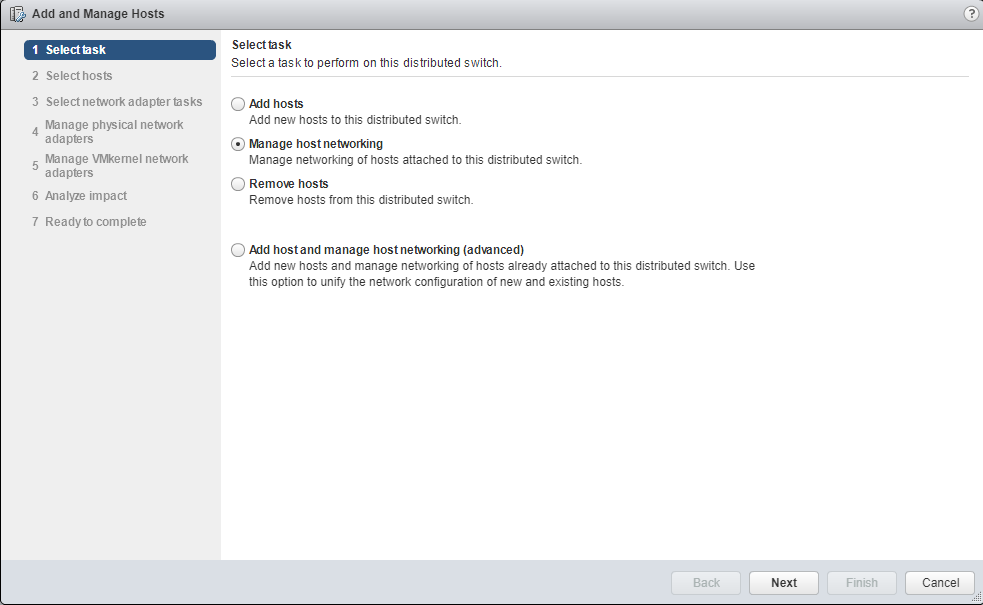

Выбираем Add hosts, кликаем Next.

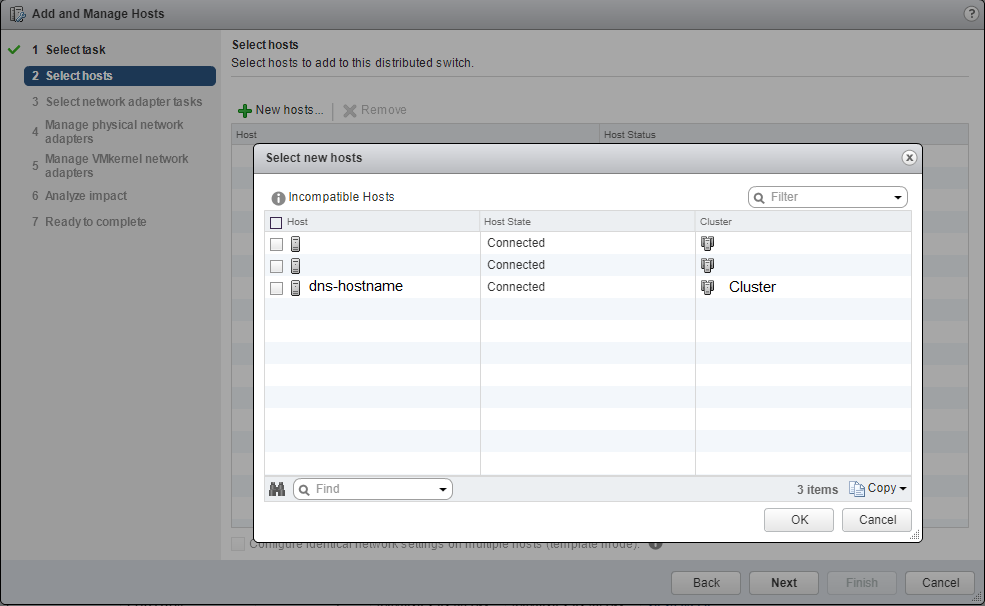

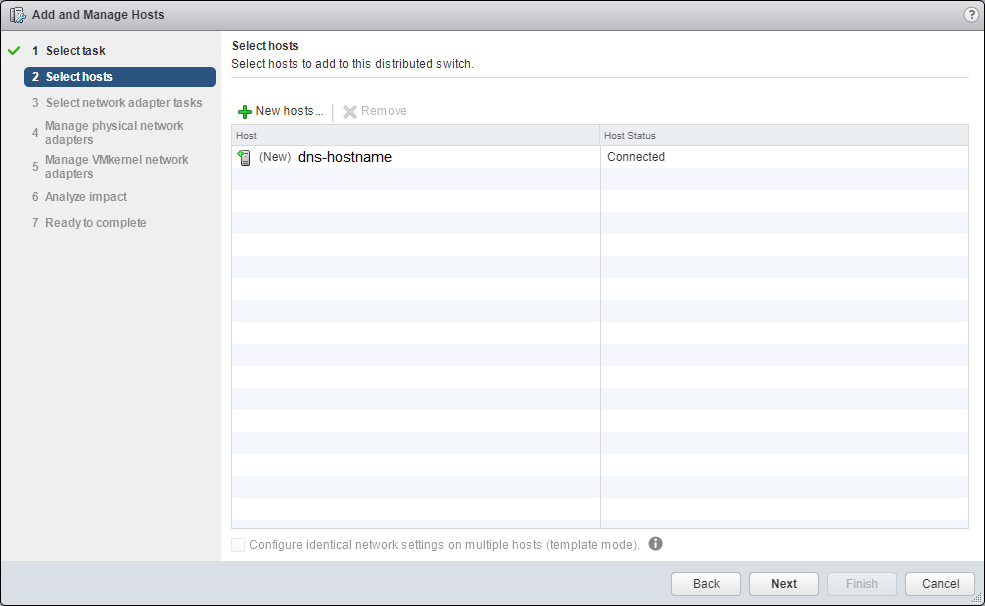

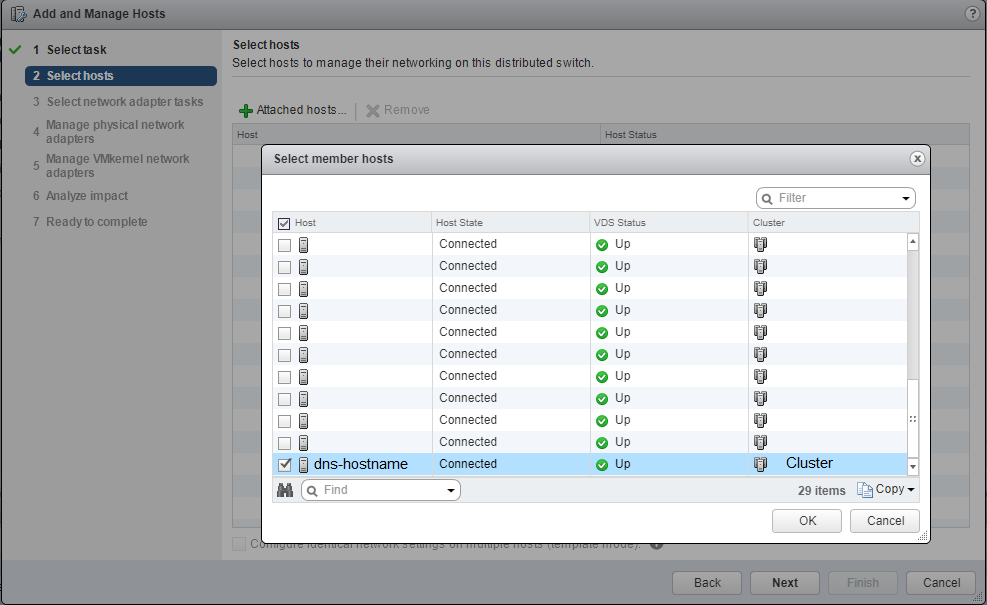

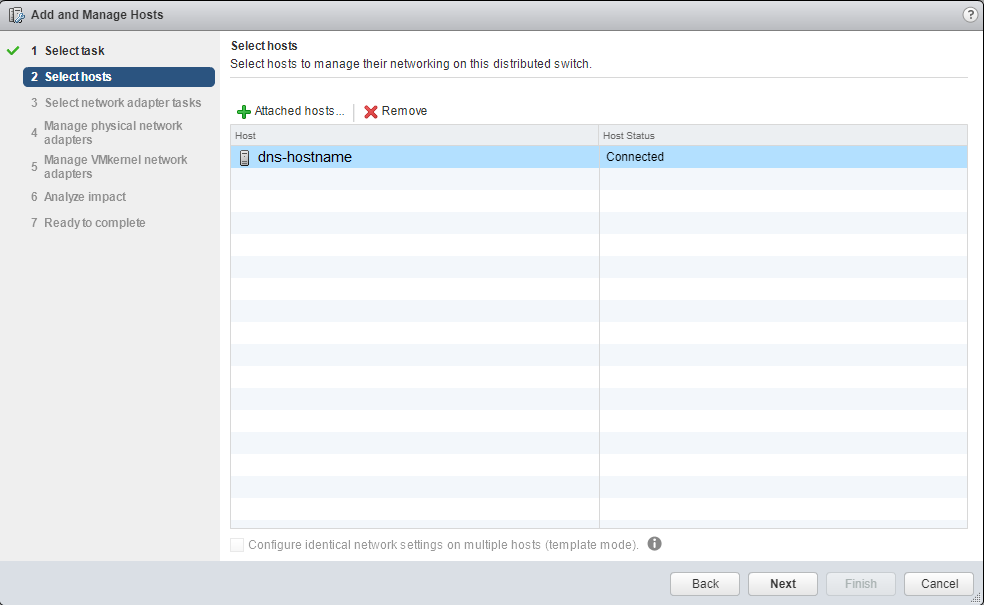

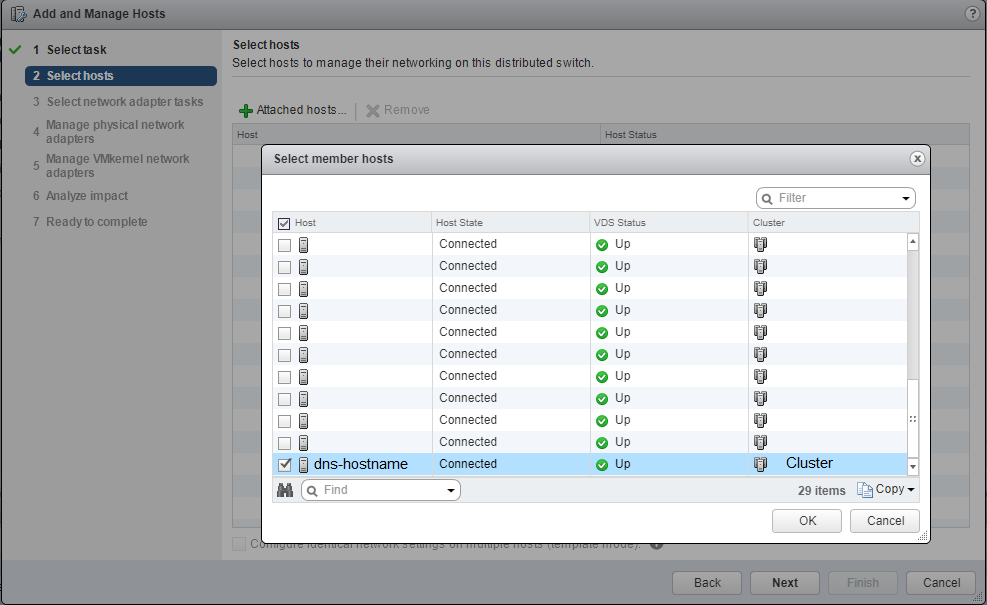

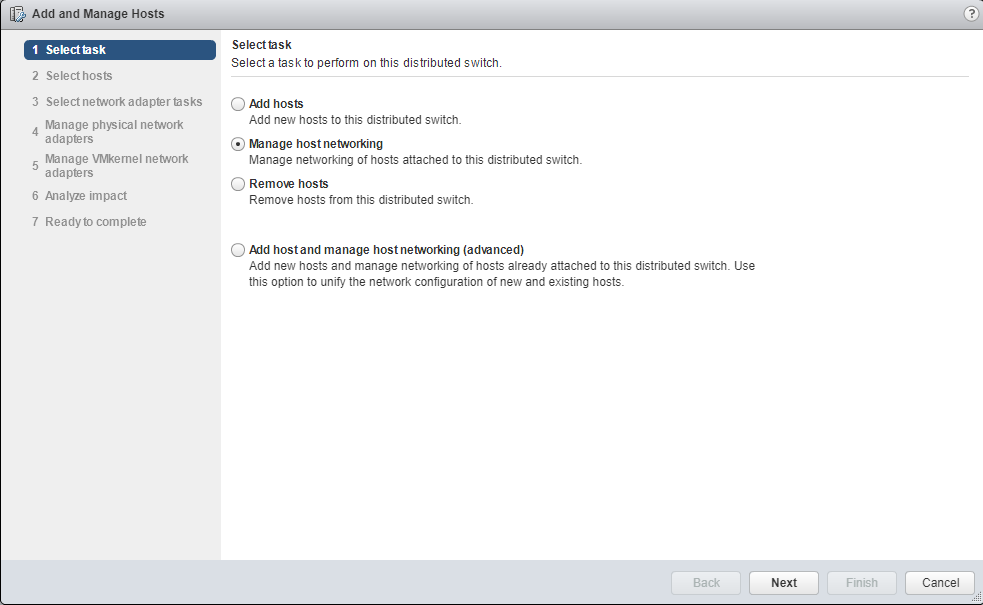

Кликаем + New hosts. Выбираем галкой в списке новый хост и кликаем ОК.

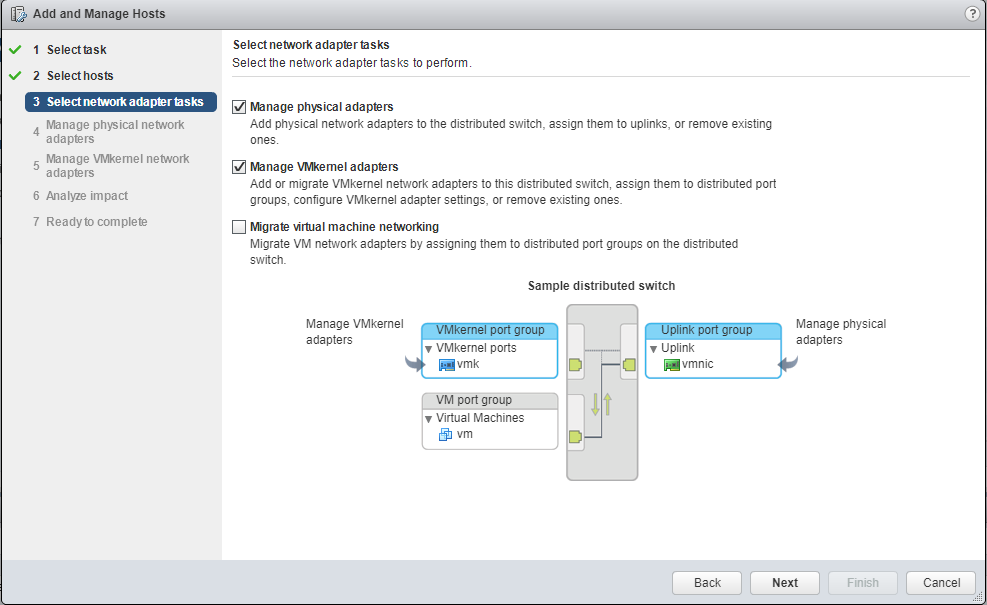

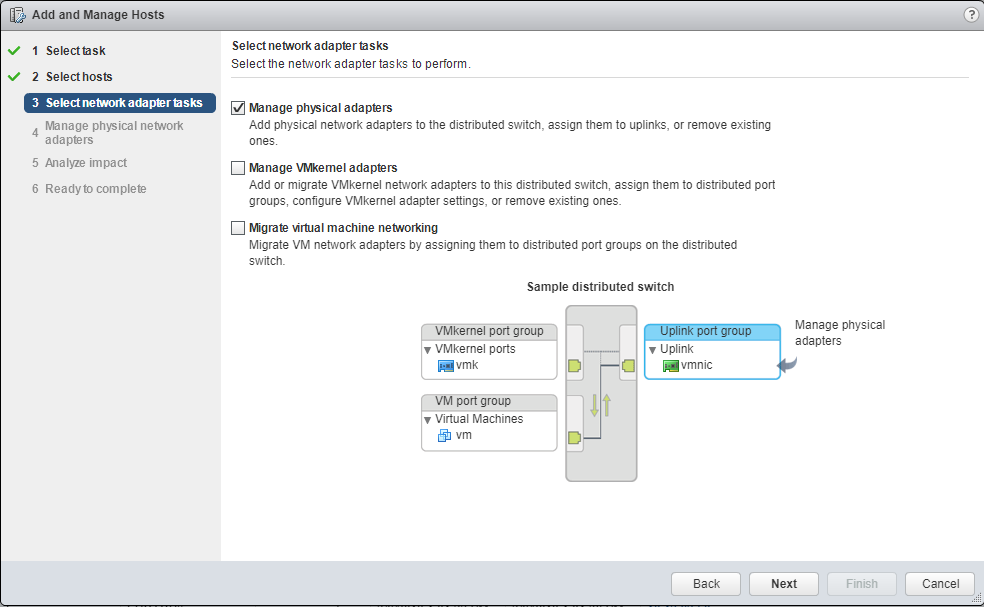

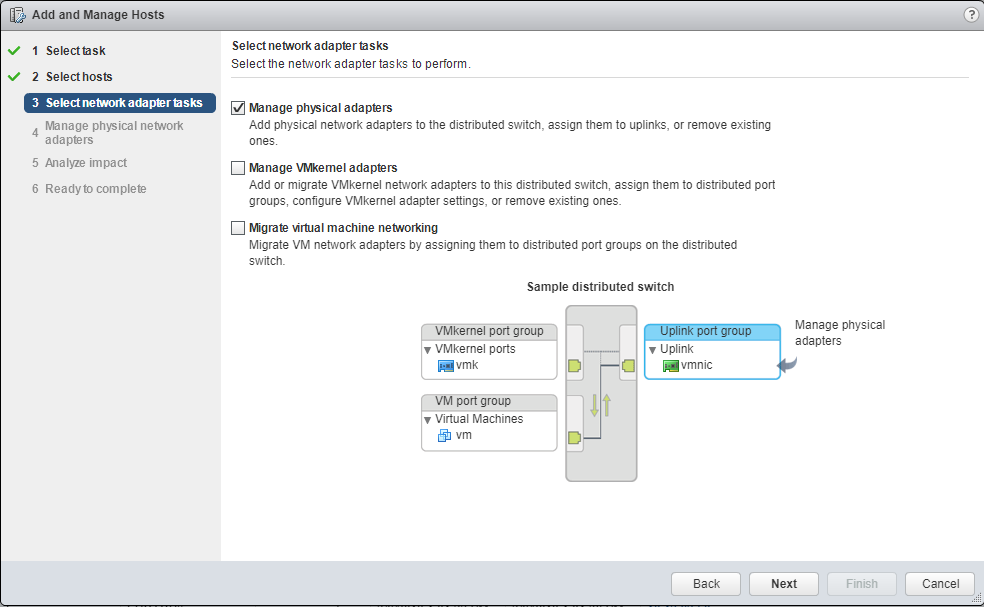

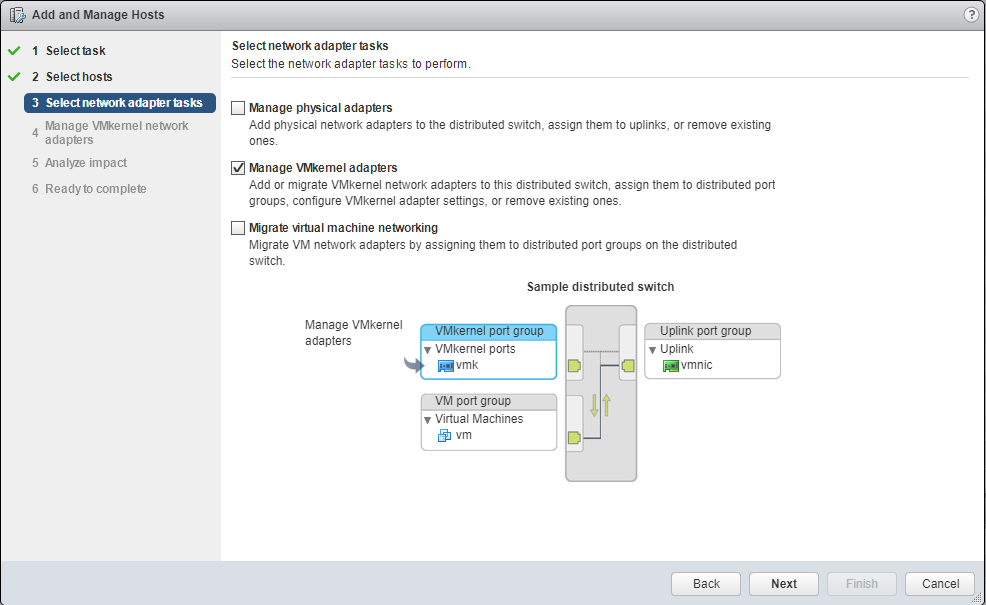

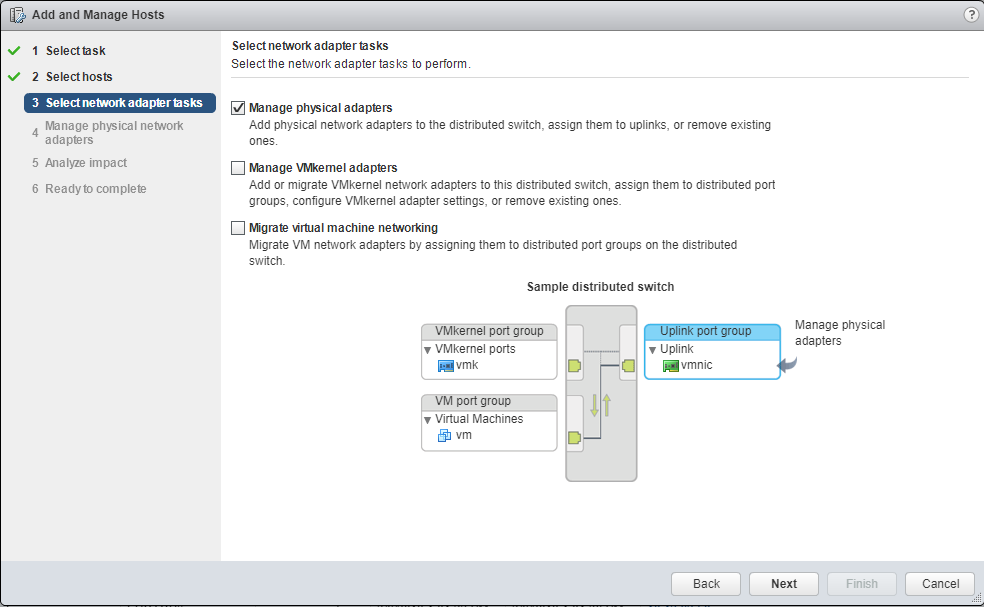

Открывается следующий экран. Там выделены две галки: Manage physical adapters и Manage VMkernel adapters.

Оставляем только Manage physical adapters. Галку Manage VMkernel adapters снимаем. Next.

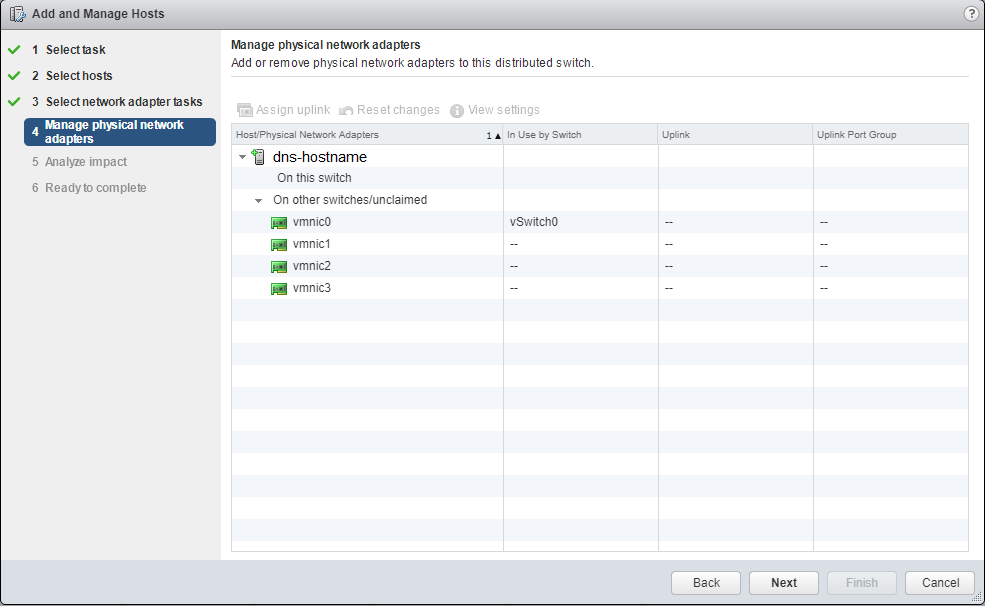

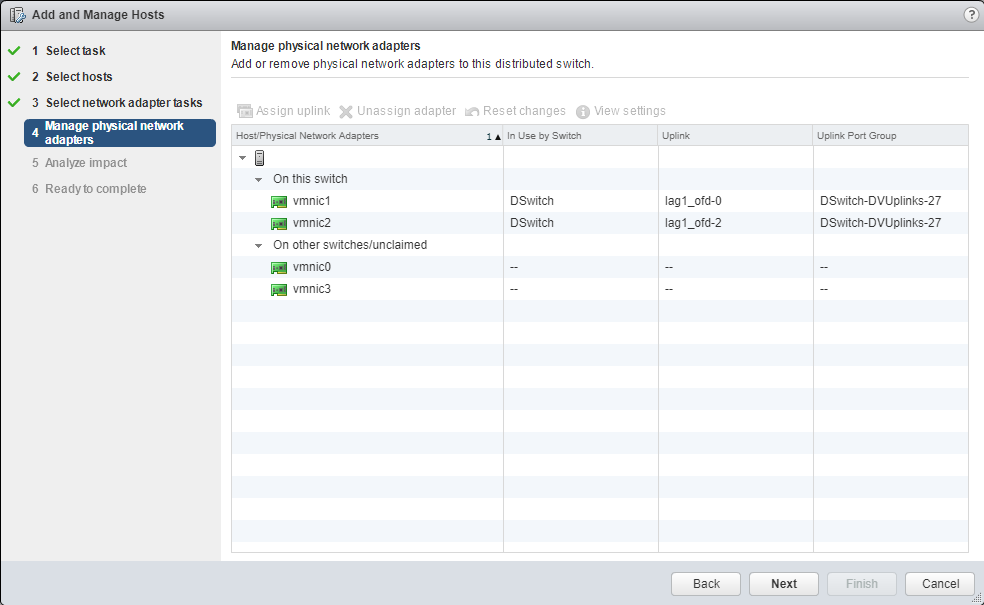

Открывается окно с физическими адаптерами. В моём случае их 4. vmnic0 включен в локальный коммутатор vSwitch0, остальные никуда не подключены.

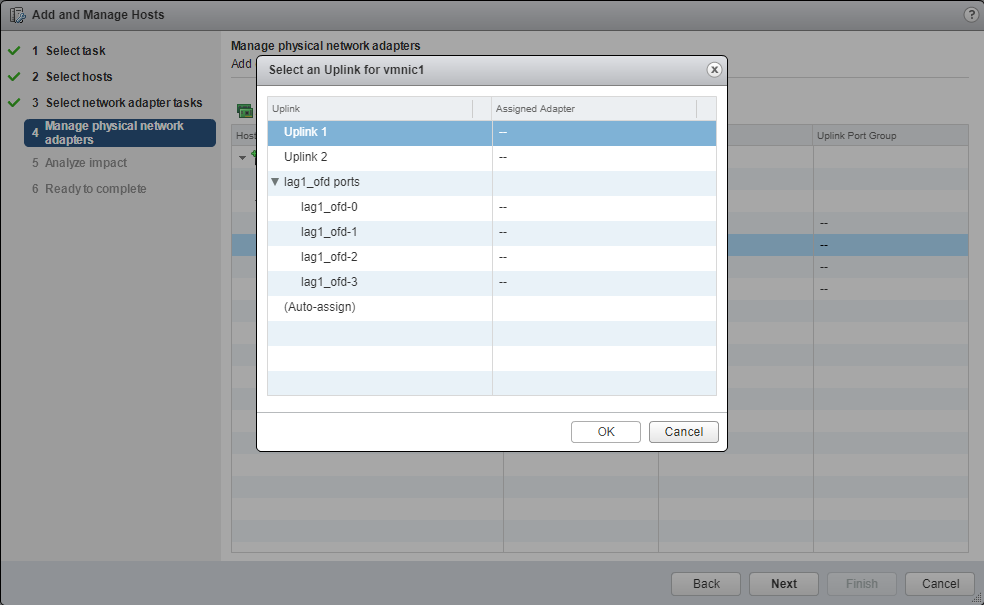

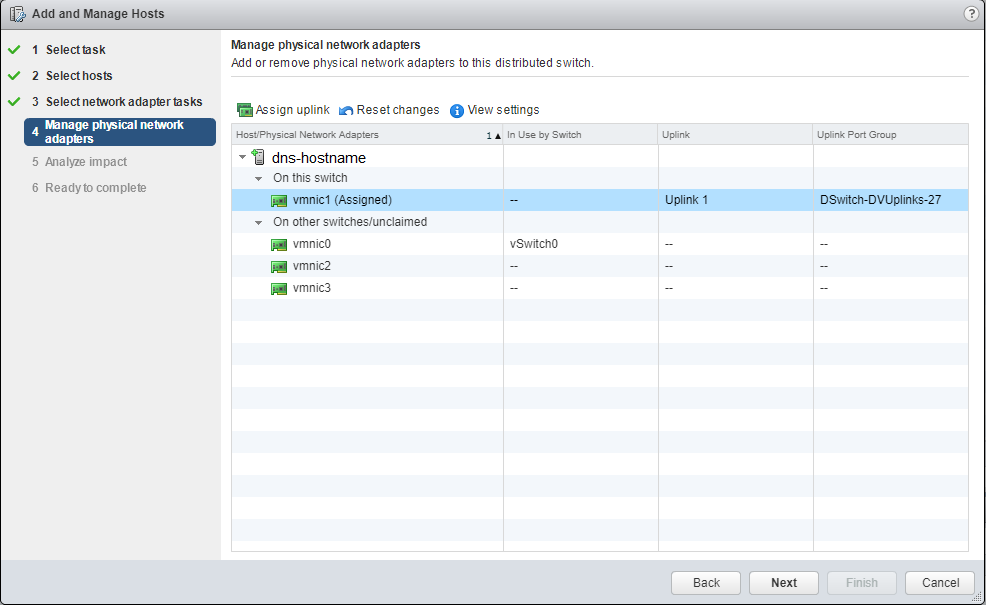

vmnic0 не трогаем, по нему сейчас управляется хост. Выбираем vmnic1, кликаем Assign uplink. Выбираем Uplink 1, нажимаем OK.

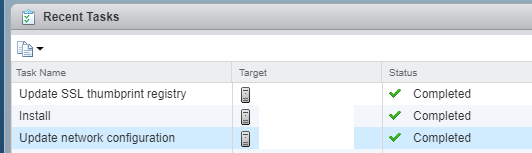

Гипервизор добавляется к DSwitch.

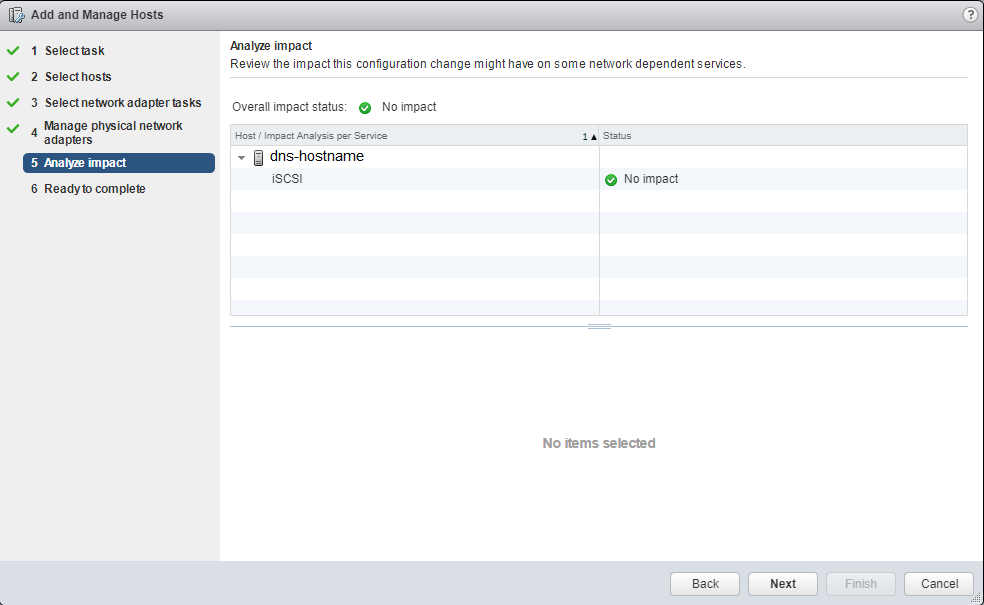

Сейчас управление идёт через vmnic0. vmnic1 подключен как Uplink 1, но сам Uplink 1 не работает, т.к. на Distributed Switch у нас используется только Lag. Если мы попытаемся изменить настройки vmkernel adapter, то потеряем связь с хостом. Нам нужно настроить Lag. Снова кликаем правой кнопкой на Distributed Switch и выбираем Add and Manage Hosts.

В следующем окне выделяем Manage host networking. Next.

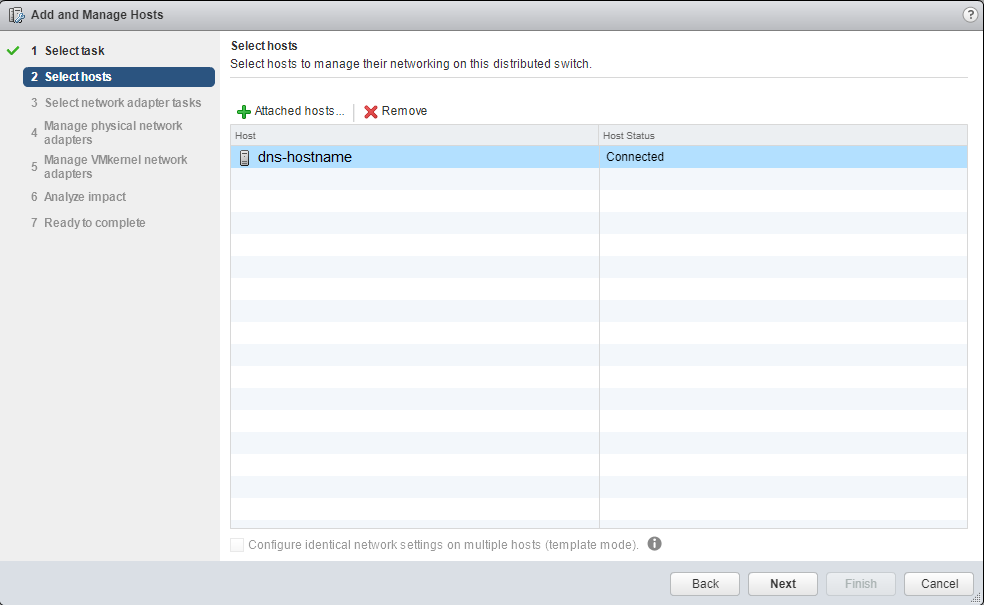

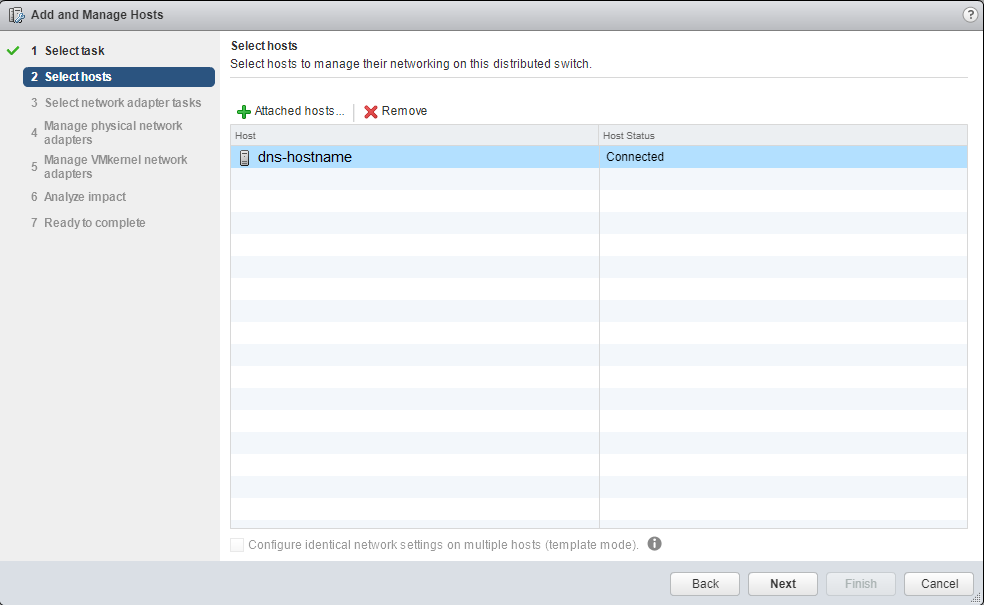

Кликаем + Attached hosts. Выбираем в списке наш гипервизор, кликаем ОК.

Выделяем в списке хост и кликаем Next.

Оставляем только Manage physical adapters. Галку Manage VMkernel adapters снимаем. Next.

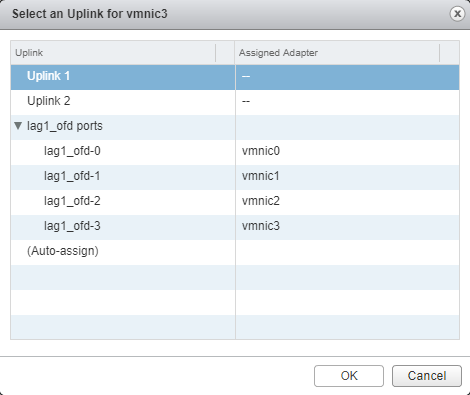

Поскольку управляющий VLAN на DSwitch уже настроен на работу в LACP, то засовываем vmnic1 в lag1, а vmnic2 в lag2.

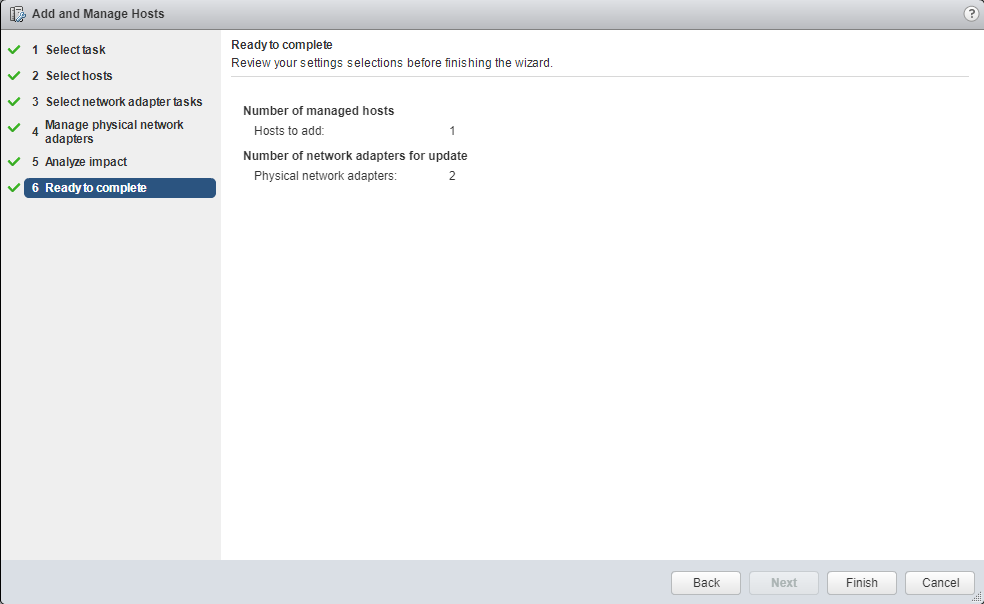

Next, Next, Finish.

Настало время переключиться на DSwitch. Снова кликаем правой кнопкой на Distributed Switch и выбираем Add and Manage Hosts.

В следующем окне выделяем Manage host networking. Next.

Кликаем + Attached hosts. Выбираем в списке наш гипервизор, кликаем ОК.

Выделяем в списке хост и кликаем Next.

Теперь ставим галку Manage VMkernel adapters, остальные снимаем. Next.

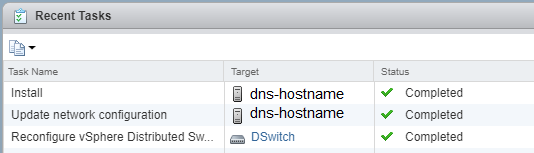

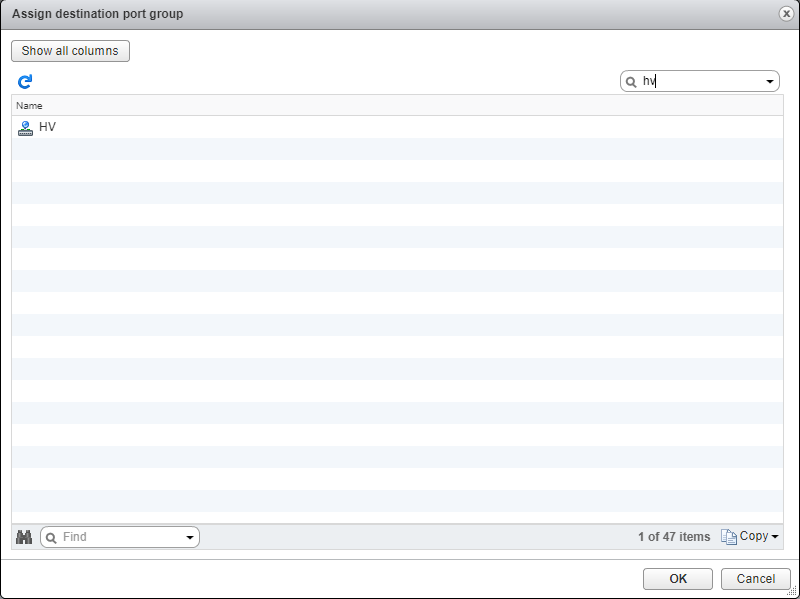

Выбираем адаптер vmk0 и кликаем на Assign port group. Отображается список вланов DSwitch. Нужно выбрать vlan, в котором живут все гипервизоры. У меня это HV. Кликаем ОК и Next, Next, Finish.

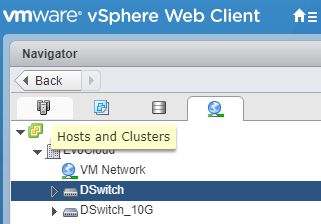

Теперь наш гипервизор управляется через DSwitch и необходимость в локальном коммутаторе отпала. Переключаемся на вкладку Hosts and Clusters.

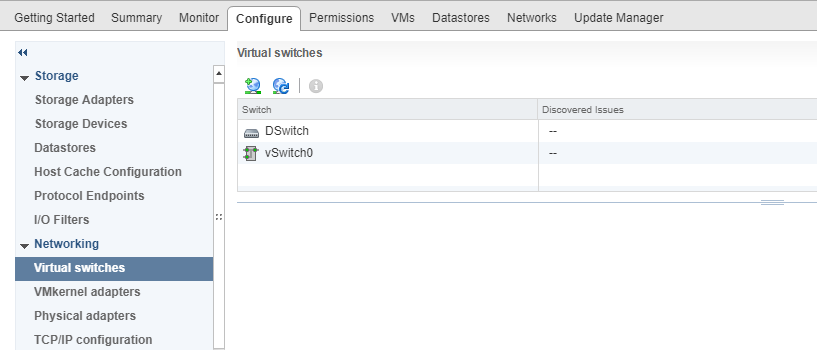

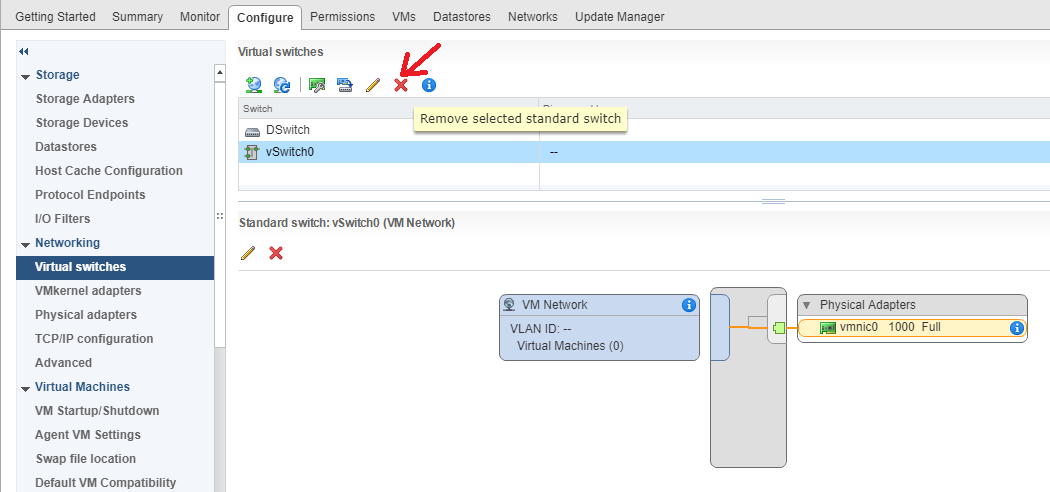

Выбираем наш хост. Во вкладке Configure находим пункт Networking > Virtual swinches.

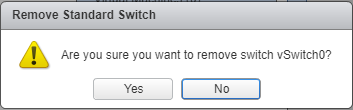

Выбираем vSwitch и удаляем его.

Остаётся один DSwitch с управлением по vmnic1 lag1-0 и vmnic2 lag1-2. Теперь нужно добавить остальные 2 порта в Lag.

Переходим на вкладку Networking.

Кликаем правой кнопкой на нужный свитч, выбираем Add and Manage Hosts.

В следующем окне выделяем Manage host networking. Next.

Кликаем + Attached hosts. Выбираем в списке наш гипервизор, кликаем ОК.

Выделяем в списке хост и кликаем Next.

Оставляем только Manage physical adapters. Галку Manage VMkernel adapters снимаем. Next.

Видим, что после удаления локального коммутатора адаптер vmnic0 освободился.

Привязываем vmnic0 и vmnic3 к Lag. Тут я замечаю, что немного некрасиво получается, и перепривязываю vmnic1 на lag1-1. Видимо, промахнулся мышкой ранее. В общем, как на картинке. Управление не потеряется, т.к. у нас ещё есть рабочий vmnic2. OK, Next, Next, Finish.

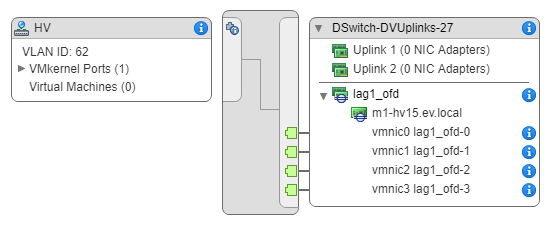

Получаем красивую картинку.

Итак, гипервизор добавлен в кластер и управляется по LACP через нужный коммутатор. Остались только тонкие настройки.

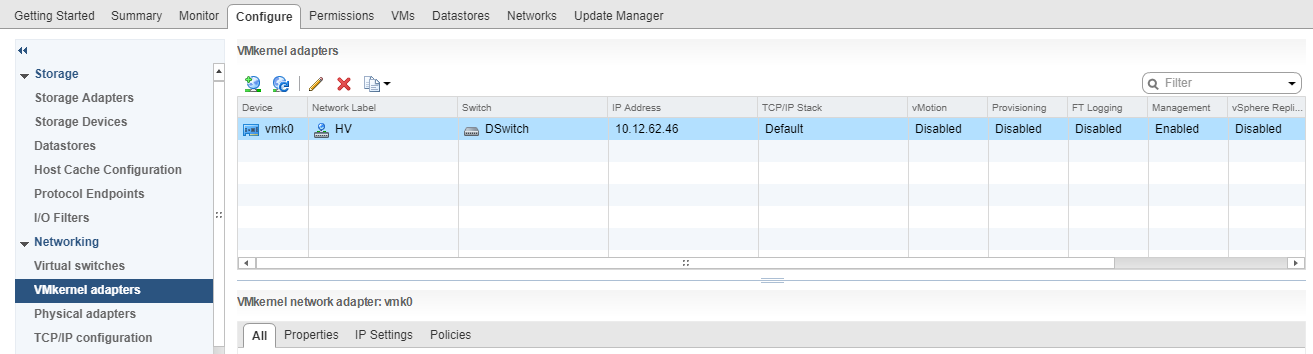

В свойствах сервера во вкладке Configure > Networking > VMkernel adapters выбираем vmk0.

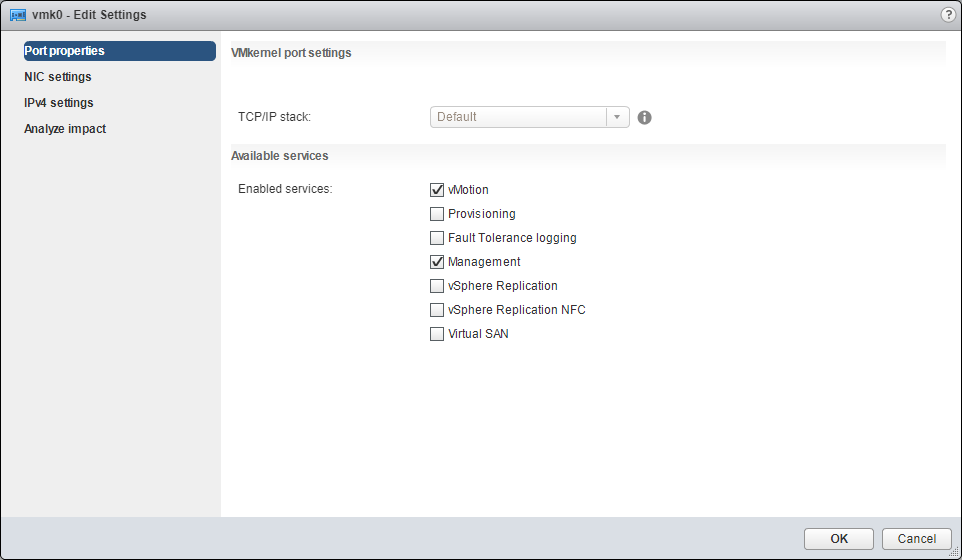

Редактируем, включаем vMotion.

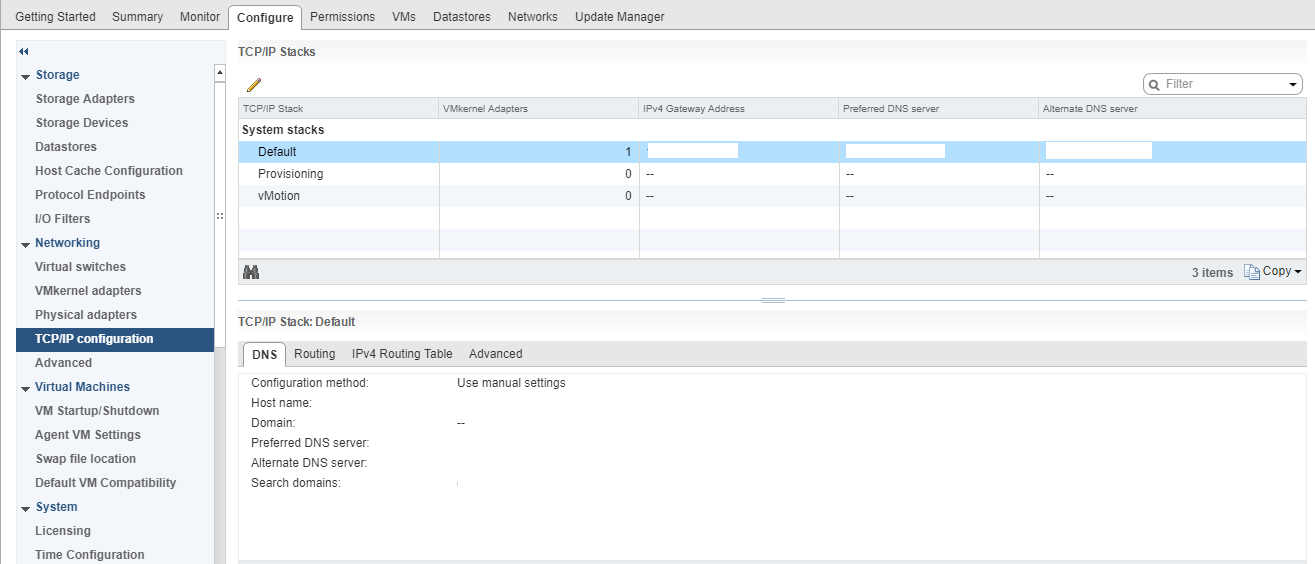

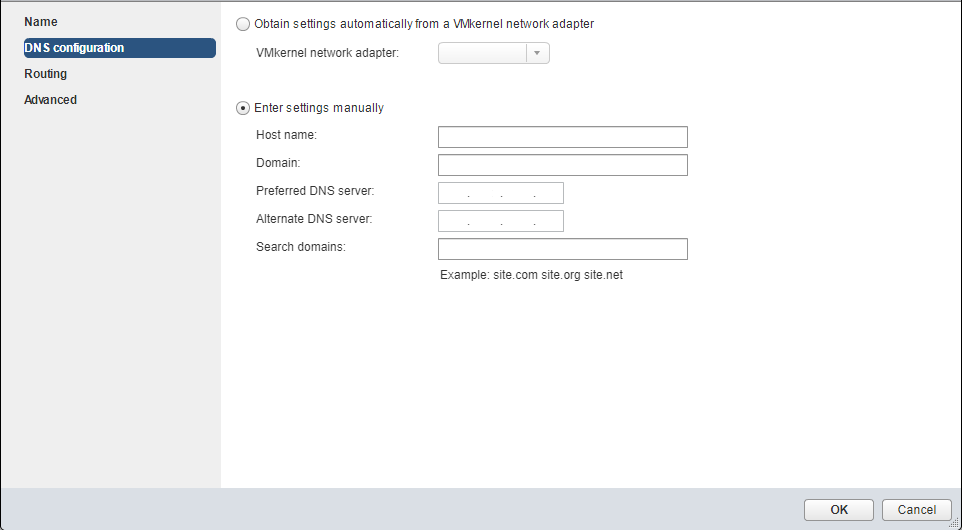

Во вкладке Configure > Networking > TCP/IP configuration редактируем Default.

Настраиваем DNS configuration. В частности, только здесь можно добавить Domain.

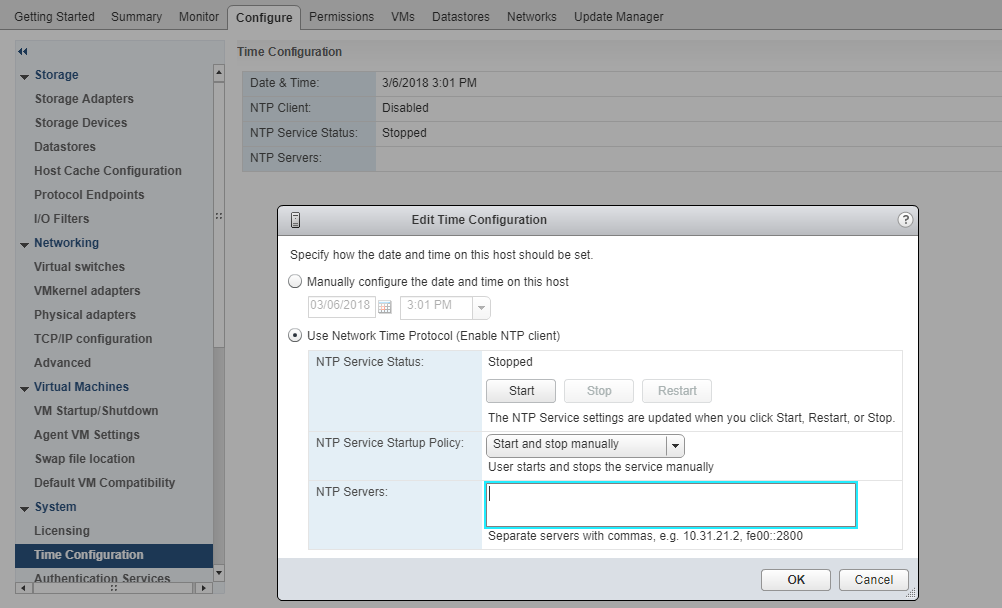

Можно ещё настроить Time Configuration.

P.S. ещё нужно настроить Datastore, но там ничего сложного нет. Переименовываете datastore1 в нужное название. Если есть ещё хранилища, то + New Datastore.

Основы компьютерных сетей. Тема №8. Протокол агрегирования каналов: Etherchannel

И снова всем привет! После небольшого перерыва, продолжаем грызть гранит сетевой науки. В данной статье речь пойдет о протоколе Etherchannel. В рамках данной темы поговорим о том, что такое агрегирование, отказоустойчивость, балансировка нагрузки. Темы важные и интересные. Желаю приятного прочтения.

Содержание

P.S. Возможно, со временем список дополнится.

Итак, начнем с простого.

Etherchannel — это технология, позволяющая объединять (агрегировать) несколько физических проводов (каналов, портов) в единый логический интерфейс. Как правило, это используется для повышения отказоустойчивости и увеличения пропускной способности канала. Обычно, для соединения критически важных узлов (коммутатор-коммутатор, коммутатор-сервер и др.). Само слово Etherchannel введено компанией Cisco и все, что связано с агрегированием, она включает в него. Другие вендоры агрегирование называют по-разному. Huawei называет это Link Aggregation, D-Link называет LAG и так далее. Но суть от этого не меняется.

Разберем работу агрегирования подробнее.

Есть 2 коммутатора, соединенных между собой одним проводом. К обоим коммутаторам подключаются сети отделов, групп (не важен размер). Главное, что за коммутаторами сидят некоторое количество пользователей. Эти пользователи активно работают и обмениваются данными между собой. Соответственно им ни в коем случае нельзя оставаться без связи. Встает 2 вопроса:

- Если линк между коммутаторами откажет, будет потеряна связь. Работа встанет, а администратор в страхе побежит разбираться в чем дело.

- Второй вопрос не настолько критичен, но с заделом на будущее. Компания растет, появляются новые сотрудники, трафика становится больше, а каналы все те же. Нужно как-то увеличивать пропускную способность.

Первое, что приходит в голову — это докинуть еще несколько проводов между коммутаторами. Но этот поход в корне не верен. Добавление избыточных линков приведет к появлению петель в сети, о чем уже говорилось в предыдущей статье. Можно возразить, что у нас есть замечательное семейство протоколов STP и они все решат. Но это тоже не совсем верно. Показываю на примере того же Packet Tracer.

Как видим, из 2-х каналов, активен только один. Второй будет ждать, пока откажет активный. То есть мы добьемся некой отказоустойчивости, но не решим вопрос с увеличением пропускной способности. Да и второй канал будет просто так простаивать. Правилом хорошего тона является такой подход, чтобы элементы сети не простаивали. Оптимальным решением будет создать из нескольких физических интерфейсов один большой логический и по нему гонять трафик. И на помощь приходит Etherchannel. В ОС Cisco 3 вида агрегирования:

- 1) LACP или Link Aggregation Control Protocol — это открытый стандарт IEEE.

- 2) PAgP или Port Aggregation Protocol — проприетарный протокол Cisco.

- Ручное агрегирование.

- Одинаковый Duplex

- Одинаковая скорость интерфейсов

- Одинаковые разрешенные VLAN-ы и Native VLAN

- Одинаковый режим интерфейсов (access, trunk)

Теперь об их отличии. Первые 2 позволяют динамически согласоваться и в случае отказа какого-то из линков уведомить об этом.

Ручное агрегирование делается на страх и риск администратора. Коммутаторы не будут ничего согласовывать и будут полагаться на то, что администратор все предусмотрел. Несмотря на это, многие вендоры рекомендуют использовать именно ручное агрегирование, так как в любом случае для правильной работы должны быть соблюдены правила, описанные выше, а коммутаторам не придется генерировать служебные сообщения для согласования LACP или PAgP.

Начну с протокола LACP. Чтобы он заработал, его нужно перевести в режим active или passive. Отличие режимов в том, что режим active сразу включает протокол LACP, а режим passive включит LACP, если обнаружит LACP-сообщение от соседа. Соответственно, чтобы заработало агрегирование с LACP, нужно чтобы оба были в режиме active, либо один в active, а другой в passive. Составлю табличку.

| Режим | Active | Passive |

|---|---|---|

| Active | Да | Да |

| Passive | Да | Нет |

Теперь перейдем к лабораторке и закрепим в практической части.

Есть 2 коммутатора, соединенные 2 проводами. Как видим, один линк активный (горит зеленым), а второй резервный (горит оранжевым) из-за срабатывания протокола STP. Это хорошо, протокол отрабатывает. Но мы хотим оба линка объединить воедино. Тогда протокол STP будет считать, что это один провод и перестанет блокировать.

Заходим на коммутаторы и агрегируем порты.

SW1(config)#interface fastEthernet 0/1 - заходим на интерфейс SW1(config-if)#shutdown - выключаем его (чтобы не было проблем с тем, что STP вдруг его заблокирует) %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down SW1(config-if)#channel-group 1 mode active - создаем интерфейс port-channel 1 (это и будет виртуальный интерфейс агрегированного канала) и переводим его в режим active. Creating a port-channel interface Port-channel 1 - появляется служебное сообщение о его создании. SW1(config-if)#no shutdown - включаем интерфейс. %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINK-5-CHANGED: Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up SW1(config)#interface fastEthernet 0/2 - заходим на второй интерфейс SW1(config-if)#shutdown - выключаем. %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down SW1(config-if)#channel-group 1 mode active - определяем в port-channel 1 SW1(config-if)#no shutdown - включаем. %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to upНа этом настройка на первом коммутаторе закончена. Для достоверности можно набрать команду show etherchannel port-channel:

SW1#show etherchannel port-channel Channel-group listing: ---------------------- Group: 1 ---------- Port-channels in the group: --------------------------- Port-channel: Po1 (Primary Aggregator) ------------ Age of the Port-channel = 00d:00h:08m:44s Logical slot/port = 2/1 Number of ports = 2 GC = 0x00000000 HotStandBy port = null Port state = Port-channel Protocol = LACP Port Security = Disabled Ports in the Port-channel: Index Load Port EC state No of bits ------+------+------+------------------+----------- 0 00 Fa0/1 Active 0 0 00 Fa0/2 Active 0 Time since last port bundled: 00d:00h:08m:43s Fa0/2 Видим, что есть такой port-channel и в нем присутствуют оба интерфейса.

Переходим ко второму устройству.

SW2(config)#interface range fastEthernet 0/1-2 - переходим к настройке сразу нескольких интерфейсов. SW2(config-if-range)#shutdown - выключаем их. %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down SW2(config-if-range)#channel-group 1 mode passive - создаем port-channel и переводим в режим passive (включится, когда получит LACP-сообщение). Creating a port-channel interface Port-channel 1 - интерфейс создан. SW2(config-if-range)#no shutdown - обратно включаем. %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINK-5-CHANGED: Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to upПосле этого канал согласуется. Посмотреть на это можно командой show etherchannel summary:

SW1#show etherchannel summary Flags: D - down P - in port-channel I - stand-alone s - suspended H - Hot-standby (LACP only) R - Layer3 S - Layer2 U - in use f - failed to allocate aggregator u - unsuitable for bundling w - waiting to be aggregated d - default port Number of channel-groups in use: 1 Number of aggregators: 1 Group Port-channel Protocol Ports ------+-------------+-----------+---------------------------------------------- 1 Po1(SU) LACP Fa0/1(P) Fa0/2(P) Здесь видно группу port-channel, используемый протокол, интерфейсы и их состояние. В данном случае параметр SU говорит о том, что выполнено агрегирование второго уровня и то, что этот интерфейс используется. А параметр P указывает, что интерфейсы в состоянии port-channel.

Все линки зеленые и активные. STP на них не срабатывает.

Сразу предупрежу, что в packet tracer есть глюк. Суть в том, что интерфейсы после настройки могут уйти в stand-alone (параметр I) и никак не захотят из него выходить. На момент написания статьи у меня случился этот глюк и решилось пересозданием лабы.

Теперь немного углубимся в работу LACP. Включаем режим симуляции и выбираем только фильтр LACP, чтобы остальные не отвлекали.

Видим, что SW1 отправляет соседу LACP-сообщение. Смотрим на поле Ethernet. В Source он записывает свой MAC-адрес, а в Destination мультикастовый адрес 0180.C200.0002. Этот адрес слушает протокол LACP. Ну и выше идет «длинная портянка» от LACP. Я не буду останавливаться на каждом поле, а только отмечу те, которые, на мой взгляд, важны. Но перед этим пару слов. Вот это сообщение используется устройствами для многих целей. Это синхронизация, сбор, агрегация, проверка активности и так далее. То есть у него несколько функций. И вот перед тем, как это все начинает работать, они выбирают себе виртуальный MAC-адрес. Обычно это наименьший из имеющихся.

И вот эти адреса они будут записывать в поля LACP.

С ходу это может не сразу лезет в голову. С картинками думаю полегче ляжет. В CPT немного кривовато показан формат LACP, поэтому приведу скрин реального дампа.

Выделенная строчка показывает для какой именно цели было послано данное сообщение. Вот суть его работы. Теперь это единый логический интерфейс port-channel. Можно зайти на него и убедиться:

SW1(config)#interface port-channel 1 SW1(config-if)#? arp Set arp type (arpa, probe, snap) or timeout bandwidth Set bandwidth informational parameter cdp Global CDP configuration subcommands delay Specify interface throughput delay description Interface specific description duplex Configure duplex operation. exit Exit from interface configuration mode hold-queue Set hold queue depth no Negate a command or set its defaults service-policy Configure QoS Service Policy shutdown Shutdown the selected interface spanning-tree Spanning Tree Subsystem speed Configure speed operation. storm-control storm configuration switchport Set switching mode characteristics tx-ring-limit Configure PA level transmit ring limitИ все действия, производимые на данном интерфейсе автоматически будут приводить к изменениям на физических портах. Вот пример:

SW1(config-if)#switchport mode trunk %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to down %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to upСтоило перевести port-channel в режим trunk и он автоматически потянул за собой физические интерфейсы. Набираем show running-config:

SW1#show running-config Building configuration. Current configuration : 1254 bytes ! version 12.2 no service timestamps log datetime msec no service timestamps debug datetime msec no service password-encryption ! hostname SW1 ! ! ! ! ! spanning-tree mode pvst ! interface FastEthernet0/1 channel-group 1 mode active switchport mode trunk ! interface FastEthernet0/2 channel-group 1 mode active switchport mode trunk ! *************************************** interface Port-channel 1 switchport mode trunk !И действительно это так.

Теперь расскажу про такую технологию, которая заслуживает отдельного внимания, как Load-Balance или на русском «балансировка». При создании агрегированного канала надо не забывать, что внутри него физические интерфейсы и пропускают трафик именно они. Бывают случаи, что вроде канал агрегирован, все работает, но наблюдается ситуация, что весь трафик идет по одному интерфейсу, а остальные простаивают. Как это происходит объясню на обычном примере. Посмотрим, как работает Load-Balance в текущей лабораторной работе.

SW1#show etherchannel load-balance EtherChannel Load-Balancing Operational State (src-mac): Non-IP: Source MAC address IPv4: Source MAC address IPv6: Source MAC addressНа данный момент он выполняет балансировку исходя из значения MAC-адреса. По умолчанию балансировка так и выполняется. То есть 1-ый MAC-адрес она пропустит через первый линк, 2-ой MAC-адрес через второй линк, 3-ий MAC-адрес снова через первый линк и так будет чередоваться. Но такой подход не всегда верен. Объясняю почему.

Вот есть некая условная сеть. К SW1 подключены 2 компьютера. Далее этот коммутатор соединяется с SW2 агрегированным каналом. А к SW2 поключается маршрутизатор. По умолчанию Load-Balance настроен на src-mac. И вот что будет происходить. Кадры с MAC-адресом 111 будут передаваться по первому линку, а с MAC-адресом 222 по второму линку. Здесь верно. Переходим к SW2. К нему подключен всего один маршрутизатор с MAC-адресом 333. И все кадры от маршрутизатора будут отправляться на SW1 по первому линку. Соответственно второй будет всегда простаивать. Поэтому логичнее здесь настроить балансировку не по Source MAC-адресу, а по Destination MAC-адресу. Тогда, к примеру, все, что отправляется 1-ому компьютеру, будет отправляться по первому линку, а второму по второму линку.

Это очень простой пример, но он отражает суть этой технологии. Меняется он следующим образом:

SW1(config)#port-channel load-balance ? dst-ip Dst IP Addr dst-mac Dst Mac Addr src-dst-ip Src XOR Dst IP Addr src-dst-mac Src XOR Dst Mac Addr src-ip Src IP Addr src-mac Src Mac AddrЗдесь думаю понятно. Замечу, что это пример балансировки не только для LACP, но и для остальных методов.

Заканчиваю разговор про LACP. Напоследок скажу только, что данный протокол применяется чаще всего, в силу его открытости и может быть использован на большинстве вендоров.

Тем, кому этого показалось мало, могут добить LACP здесь, здесь и здесь. И вдобавок ссылка на данную лабораторку.

Теперь про коллегу PAgP. Как говорилось выше — это чисто «цисковский» протокол. Его применяют реже (так как сетей, построенных исключительно на оборудовании Cisco меньше, чем гетерогенных). Работает и настраивается он аналогично LACP, но Cisco требует его знать и переходим к рассмотрению.

У PAgP тоже 2 режима:

- Desirable — включает PAgP.

- Auto — включиться, если придет PAgP сообщение.

| Режим | Desirable | Auto |

|---|---|---|

| Desirable | Да | Да |

| Auto | Да | Нет |

Собираем аналогичную лабораторку.

И переходим к SW1:

SW1(config)#interface range fastEthernet 0/1-2 - выбираем диапазон интерфейсов. SW1(config)#shutdown - выключаем. %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down SW1(config-if-range)#channel-group 1 mode desirable - создаем port-channel и переключаем его в режим desirable (то есть включить). Creating a port-channel interface Port-channel 1Теперь переходим к настройке SW2 (не забываем, что на SW1 интерфейсы выключены и следует после к ним вернуться):

SW2(config)#interface range fastEthernet 0/1-2 - выбираем диапазон интерфейсов. SW2(config-if-range)#channel-group 1 mode auto - создаем port-channel и переводим в auto (включиться, если получит PAgP-сообщение). Creating a port-channel interface Port-channel 1Возвращаемся к SW1 и включаем интерфейсы:

SW1(config)#interface range fastEthernet 0/1-2 SW1(config-if-range)#no shutdown %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINK-5-CHANGED: Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to up Вроде как все поднялось. Проверим. SW1: SW1#show etherchannel summary Flags: D - down P - in port-channel I - stand-alone s - suspended H - Hot-standby (LACP only) R - Layer3 S - Layer2 U - in use f - failed to allocate aggregator u - unsuitable for bundling w - waiting to be aggregated d - default port Number of channel-groups in use: 1 Number of aggregators: 1 Group Port-channel Protocol Ports ------+-------------+-----------+---------------------------------------------- 1 Po1(SU) PAgP Fa0/1(P) Fa0/2(P) SW2#show etherchannel summary Flags: D - down P - in port-channel I - stand-alone s - suspended H - Hot-standby (LACP only) R - Layer3 S - Layer2 U - in use f - failed to allocate aggregator u - unsuitable for bundling w - waiting to be aggregated d - default port Number of channel-groups in use: 1 Number of aggregators: 1 Group Port-channel Protocol Ports ------+-------------+-----------+---------------------------------------------- 1 Po1(SU) PAgP Fa0/1(P) Fa0/2(P) Теперь переходим в симуляцию и настраиваемся на фильтр PAgP. Видим, вылетевшее сообщение от SW2. Смотрим.

То есть видим в Source MAC-адрес SW2. В Destination мультикастовый адрес для PAgP. Повыше протоколы LLC и SNAP. Они нас в данном случае не интересуют и переходим к PAgP. В одном из полей он пишет виртуальный MAC-адрес SW1 (выбирается он по тому же принципу, что и в LACP), а ниже записывает свое имя и порт, с которого это сообщение вышло.

В принципе отличий от LACP практически никаких, кроме самой структуры. Кто хочет ознакомиться подробнее, ссылка на лабораторную. А вот так он выглядит реально:

Последнее, что осталось — это ручное агрегирование. У него с агрегированием все просто:

| Режим | On |

|---|---|

| On | Да |

При остальных настройках канал не заработает.

Как говорилось выше, здесь не используется дополнительный протокол согласования, проверки. Поэтому перед агрегированием нужно проверить идентичность настроек интерфейсов. Или сбросить настройки интерфейсов командой:

Switch(config)#default interface faX/XВ созданной лабораторке все изначально по умолчанию. Поэтому я перехожу сразу к настройкам.

SW1(config)#interface range fastEthernet 0/1-2 SW1(config-if-range)#shutdown %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to administratively down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down SW1(config-if-range)#channel-group 1 mode on - создается port-channel и сразу включается. Creating a port-channel interface Port-channel 1 SW1(config-if-range)#no shutdown %LINK-5-CHANGED: Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINK-5-CHANGED: Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up %LINK-5-CHANGED: Interface FastEthernet0/2, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to upИ аналогично на SW2:

SW2(config)#interface range fastEthernet 0/1-2 SW2(config-if-range)#channel-group 1 mode on Creating a port-channel interface Port-channel 1 %LINK-5-CHANGED: Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface Port-channel 1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/1, changed state to up %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to down %LINEPROTO-5-UPDOWN: Line protocol on Interface FastEthernet0/2, changed state to upНастройка закончена. Проверим командой show etherchannel summary:

SW1#show etherchannel summary Flags: D - down P - in port-channel I - stand-alone s - suspended H - Hot-standby (LACP only) R - Layer3 S - Layer2 U - in use f - failed to allocate aggregator u - unsuitable for bundling w - waiting to be aggregated d - default port Number of channel-groups in use: 1 Number of aggregators: 1 Group Port-channel Protocol Ports ------+-------------+-----------+---------------------------------------------- 1 Po1(SU) - Fa0/1(P) Fa0/2(P) Порты с нужными параметрами, а в поле протокол «-«. То есть дополнительно ничего не используется.

Как видно все методы настройки агрегирования не вызывают каких-либо сложностей и отличаются только парой команд.

Под завершение статьи приведу небольшой Best Practice по правильному агрегированию. Во всех лабораторках для агрегирования использовались 2 кабеля. На самом деле можно использовать и 3, и 4 (вплоть до 8 интерфейсов в один port-channel). Но лучше использовать 2, 4 или 8 интерфейсов. А все из-за алгоритма хеширования, который придумала Cisco. Алгоритм высчитывает значения хэша от 0 до 7.

| 4 | 2 | 1 | Десятичное значение |

|---|---|---|---|

| 0 | 0 | 0 | 0 |

| 0 | 0 | 1 | 1 |

| 0 | 1 | 1 | 3 |

| 1 | 0 | 0 | 4 |

| 0 | 0 | 1 | 1 |

| 1 | 0 | 1 | 5 |

| 1 | 1 | 0 | 6 |

| 1 | 1 | 1 | 7 |

Данная таблица отображает 8 значений в двоичном и десятичном виде.

На основании этой величины выбирается порт Etherchannel и присваивается значение. После этого порт получает некую «маску», которая отображает величины, за которые тот порт отвечает. Вот пример. У нас есть 2 физических интерфейса, которые мы объединяем в один port-channel.

Значения раскидаются следующим образом:

1) 0x0 — fa0/1

2) 0x1 — fa0/2

3) 0x2 — fa0/1

4) 0x3 — fa0/2

5) 0x4 — fa0/1

6) 0x5 — fa0/2

7) 0x6 — fa0/1

8) 0x7 — fa0/2

В результате получим, что половину значений или паттернов возьмет на себя fa0/1, а вторую половину fa0/2. То есть получаем 4:4. В таком случае балансировка будет работать правильно (50/50).

Теперь двинемся дальше и объясню, почему не рекомендуется использовать, к примеру 3 интерфейса. Составляем аналогичное сопоставление:

1) 0x0 — fa0/1

2) 0x1 — fa0/2

3) 0x2 — fa0/3

4) 0x3 — fa0/1

5) 0x4 — fa0/2

6) 0x5 — fa0/3

7) 0x6 — fa0/1

8) 0x7 — fa0/2

Здесь получаем, что fa0/1 возьмет на себя 3 паттерна, fa0/2 тоже 3 паттерна, а fa0/3 2 паттерна. Соответственно нагрузка будет распределена не равномерно. Получим 3:3:2. То есть первые два линка будут всегда загруженнее, чем третий.

Все остальные варианты я считать не буду, так как статья растянется на еще больше символов. Можно только прикинуть, что если у нас 8 значений и 8 линков, то каждый линк возьмет себе по паттерну и получится 1:1:1:1:1:1:1:1. Это говорит о том, что все интерфейсы будут загружены одинаково. Еще есть некоторое утверждение, что агрегировать нужно только четное количество проводов, чтобы добиться правильной балансировки. Но это не совсем верно. Например, если объединить 6 проводов, то балансировка будет не равномерной. Попробуйте посчитать сами. Надеюсь алгоритм понятен.

У Cisco на сайте по этому делу есть хорошая статья с табличкой. Можно почитать по данной ссылке. Если все равно останутся вопросы, пишите!

Раз уж так углубились, то расскажу про по увеличение пропускной способности. Я специально затронул эту тему именно в конце. Бывают случаи, что срочно нужно увеличить пропускную способность канала. Денег на оборудование нет, но зато есть свободные порты, которые можно собрать и пустить в один «толстый» поток. Во многих источниках (книги, форумы, сайты) утверждается, что соединяя восемь 100-мегабитных портов, мы получим поток в 800 Мбит/с или восемь гигабитных портов дадут 8 Гбит/с. Вот кусок текста из «цисковской» статьи.

Теоретически это возможно, но на практике почти недостижимо. Я по крайней мере не встречал. Если есть люди, которые смогли этого добиться, я буду рад услышать. То есть, чтобы это получить, нужно учесть кучу формальностей. И вот те, которые я описывал, только часть. Это не значит, что увеличения вообще не будет. Оно, конечно будет, но не настолько максимально.

На этом статья подошла к концу. В рамках данной статьи мы научились агрегировать каналы вручную, а также, при помощи протоколов LACP и PAgP. Узнали, что такое балансировка, как ею можно управлять и как правильно собирать Etherchannel для получения максимального распределения нагрузки. До встречи в следующей статье!

- Системное администрирование

- IT-инфраструктура

- Cisco

- Сетевые технологии

BabiyPetr

Абитуриент

Посетители профиля

Блок посетителей профиля отключен и не будет отображаться другим пользователям

Специфическая архитектура сети

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Спасибо всем за советы, не стал мучать нексус маршрутизацией, переложил ее на VirtualRouter от OpenNebula , на всех нодах настроил VPN доступ во внутреннюю сеть, все IP для IPMI перенес в серую сеть, а IP нод прикрыл фаерволом.

Специфическая архитектура сети

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Порты аплинков включены в L2 (mode access) Совершенно верно Сейчас так и сделано Vlan 1 — в него приходит от аплинка наш /23 блок Vlan 5 — 10.10.0.0/24 — это сеть комуникации гипервизора (10Г) Vlan 10 — 10.0.0.0/24 — это сеть синхронизации DRBD хранилища, от каждой ноды в этот влан по два 10Г порта входит и я их объединил при помощи lacp (L2) что бы обеспечить канал в 20Г на ноду для синхронизации массива (планировался ceph , но из-за того что все железки в одной стойке пока отказались от него) И по сути меня эта схема устраивает, есдинственное чего не хватает это что бы из сети 10.10.0.0/24 (влан 5) можно было выходить в интернет Вот это да, мне очень хочется это сделать, сейчас IPMI подключен через каталист свитч и в принципе нет проблем переключить линк на него в 5 влан что бы использовать там 10.10.0.0/24 сетку. Вопрос в том как лучше доступ к этой сети снаружи сделать? Понятно что я могу в принципе поднять ВПН в самом облаке и через него получать доуступ в эту приватную сеть, в принципе то вероятность того что все ноды облака умрут одновременно и исчезнет этот впн доступ достаточно минимальны. Что касается нод, то тут у меня вероятно явный недостаток знаний, допустим мостовой интерфейс vmbr0 на котором сейчас висит публичный адрес и который воткнут в влан 1 , я переведу во влан 5 где живет сетка 10.10.0.0/24 , но как тогда трафик пришедший на влан 1 (где живет наш блок /23) доберется до виртуалок которые включены через мост во влан 5 ? Если этот мост оставлять в первом влане то как на нем применить приватные адреса?

Специфическая архитектура сети

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Тут сложно сказать , NAT то не панацея. По сути ведь можно разрулить все и маршрутизацией, а для доступа к приватным сетям снаружи поднять IPSEC VPN вроди же можно такое на цисках? вчера находил какие то древние статьи на эту тему, но более и менее актуальное касается IPSEC типа точка — точка VPN был бы удобнее чем NAT для доступа к инфраструктурным нодам ну а исходящий трафик наверное можно и без NAT разрулить Вопрос только как правильно сделать. OpenNebula поддерживает Open Switch и VXLAN может это как то можно применить для достижения цели..

Специфическая архитектура сети

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Совершенно верно, то есть на ноде мост на мосту висит серый ip , она в сеть ходит через NAT , на виртуалках которые к этому мосту подключены можно использовать и серые и белые адреса В идеале на виртуалке всегда висит приватный ип и шлюз от него , и с 32 префиксом можно прописать публичный ип и тогда на эту виртуалку можно попасть по нему

Специфическая архитектура сети

тему добавил BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Приветствую ребята. Делаем частное облако на базе OpenNebula , под это дело была приобретена Cisco Nexus 9000 C9372PX, отдельное человеческое спасибо всем кто помог перепрошить ее и поднять аплинки)) Суть такова сейчас на этот свитч захидит два линка по 10Г от дата центра, линки агрегированы lacp , весь этот трафик идет в Vlan1 Создано еще два Vlan один для приватной сети между виртуалками а второй для синхронизации хранилища В целом Cisco сейчас работает в L2 режиме, но вот хочется использовать весь потенциал этого свитча и высвободить белые IP которых не так то и много спрятав все за NAT , но только вот таким хитрым способом, что если на виртуалке прописан белый IP то она должна быть доступна без NAT , если не прописан, то в интернет она ходить может через NAT. Высвободить хочется преимущественно ip для нод и IPMI пронатив это все по портам (PAT) Вчера пробовал и vrf и просто пытался трафик между вланами занатить, ну что то все тчетно. Может посоветуете можно ли как то организовать то что я хочу?

Cisco nexus 9372PX-E lacp port suspend

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Да, проблема была именно в этом, как только оба линка переставили в Nexus так сразу же все заработало. В итоге получился небольшой даунтайм (2-3 минутки) пока перетыкнули сервера в новый свитч.

Cisco nexus 9372PX-E lacp port suspend

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Дело в том что это Сингапурское отделение одного из крупных мировых ДЦ, но инженеры которые там находятся похоже того же уровня что и я)) Общение с ними у нас идет очень туго. когда поднимали аплинк с каталистом то потратили две недели пока не достучались до европейской сетевой команды и они уже дали разъяснения и нам и им)) Сейчас я затрудняюсь сказать как сконфигурирован этот линк на их стороне, выведен ли он из LACP или нет, то что он поднимается без LACP может свидетельствовать что он выведен? Но меня смущает то что когда линк поднят то пинги к дефолтному шлюзу нашей сети не идут.. ну и сосбвенно так же нельзя достучаться до IP адреса который прописан для менеджмента Наверное не стану отнимать Ваше время, попробую достучаться до европейского офиса , возможно получится оперативно уточнить детали) Спасибо за посильную помощь

Cisco nexus 9372PX-E lacp port suspend

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

И еще такой момент я обновлял прошивку там стояла aci-n9000-dk9.11.2.1m.bin А я поставил nxos.9.3.5.bin

Cisco nexus 9372PX-E lacp port suspend

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Ну другого нет, при заказе специально просил поставщика предоставить подходящие трансиверы и в документации он вроди как числится среди допустимых, подробности о транивере: sh int e 1/48 transceiver details Ethernet1/48 transceiver is present type is 10Gbase-LR name is Arista Networks part number is SFP-10G-LR revision is 0002 serial number is XDP150401719 nominal bitrate is 10300 MBit/sec Link length supported for 9/125um fiber is 10 km cisco id is 3 cisco extended id number is 4 SFP Detail Diagnostics Information (internal calibration) —————————————————————————- Current Alarms Warnings Measurement High Low High Low —————————————————————————- Temperature 45.23 C 85.00 C -15.00 C 80.00 C -10.00 C Voltage 3.27 V 3.79 V 2.79 V 3.70 V 2.90 V Current 29.21 mA 90.00 mA 2.00 mA 80.00 mA 3.00 mA Tx Power -2.95 dBm 1.99 dBm -10.22 dBm 1.00 dBm -9.20 dBm Rx Power -1.86 dBm 0.99 dBm -20.00 dBm 0.00 dBm -19.20 dBm Transmit Fault Count = 0 —————————————————————————- Note: ++ high-alarm; + high-warning; — low-alarm; — low-warning just-sw1# sh int e 1/48 transceiver calibrations Ethernet1/48 transceiver is present type is 10Gbase-LR name is Arista Networks part number is SFP-10G-LR revision is 0002 serial number is XDP150401719 nominal bitrate is 10300 MBit/sec Link length supported for 9/125um fiber is 10 km cisco id is 3 cisco extended id number is 4 SFP is internally calibrated По поддержке модуля заявлено как поддерживаемый

Cisco nexus 9372PX-E lacp port suspend

тему ответил в BabiyPetr пользователя BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Другая сторона не в моем подчинении, ДЦ требует что бы порты были агрегированы..

Cisco nexus 9372PX-E lacp port suspend

тему добавил BabiyPetr в Активное оборудование Ethernet, IP, MPLS, SDN/NFV.

Привет ребята! Я новичек в Cisco , но задачу мне все же поставили и я должен ее решить, но столкнулся с проблемкой и прошу Вашей помощи. Задача стоит перенести аплинки со свитча Cisco Catalyst c2960x-48ts (два линка по 1 Gbps агрегированных LACP ) на свитч Cisco Nexus 9372PX-E (тут уже будет два линка по 10Gbps так же агрегированных с LACP) и так как за catalyst еще живут клиенты то переносить нужно поочередно. Причем делается это все удаленно без физического контакта с оборудованием. В этом дата центра аплинком выступает Arista 7260cx3 и даже при конфигурировании старого доброго catalyst тоже были проблемы которые решились добавлением следующих опций в конфигурацию: service unsupported-transceive spanning-tree mode rapid-pvst spanning-tree extend system-id no errdisable detect cause gbic-invalid no errdisable detect cause sfp-config-mismatch errdisable recovery cause gbic-invalid Ну и конфигурация интерфейсов тоже специфична: interface Port-channel1 switchport mode access switchport nonegotiate speed nonegotiate interface GigabitEthernet1/0/49 switchport mode access switchport nonegotiate speed nonegotiate channel-protocol lacp channel-group 1 mode active ! interface GigabitEthernet1/0/50 switchport mode access switchport nonegotiate speed nonegotiate channel-protocol lacp channel-group 1 mode active ! Только в такой конфигурации это все завелось и работает по сей день. Сейчас линк из 50 го интерфейса переставили в Nexus , пока я не добавляю новый интерфейс в channel-group он вроди бы работает исправно: sh int e 1/48 Ethernet1/48 is up admin state is up, Dedicated Interface Hardware: 1000/10000 Ethernet, address: 00c8.8bcc.4091 (bia 00c8.8bcc.4091) MTU 1500 bytes, BW 10000000 Kbit , DLY 10 usec reliability 255/255, txload 1/255, rxload 1/255 Encapsulation ARPA, medium is broadcast Port mode is access full-duplex, 10 Gb/s, media type is 10G Beacon is turned off Auto-Negotiation is turned on FEC mode is Auto Input flow-control is off, output flow-control is off Auto-mdix is turned off Rate mode is dedicated Switchport monitor is off EtherType is 0x8100 EEE (efficient-ethernet) : n/a admin fec state is auto, oper fec state is off Last link flapped 00:00:15 Last clearing of «show interface» counters 01:23:34 4 interface resets Load-Interval #1: 30 seconds 30 seconds input rate 720 bits/sec, 0 packets/sec 30 seconds output rate 344 bits/sec, 0 packets/sec input rate 720 bps, 0 pps; output rate 344 bps, 0 pps Load-Interval #2: 5 minute (300 seconds) 300 seconds input rate 16 bits/sec, 0 packets/sec 300 seconds output rate 16 bits/sec, 0 packets/sec input rate 16 bps, 0 pps; output rate 16 bps, 0 pps RX 0 unicast packets 375 multicast packets 0 broadcast packets 375 input packets 64968 bytes 0 jumbo packets 0 storm suppression packets 0 runts 0 giants 0 CRC 0 no buffer 0 input error 0 short frame 0 overrun 0 underrun 0 ignored 0 watchdog 0 bad etype drop 0 bad proto drop 0 if down drop 0 input with dribble 0 input discard 0 Rx pause TX 0 unicast packets 266 multicast packets 0 broadcast packets 266 output packets 44686 bytes 0 jumbo packets 0 output error 0 collision 0 deferred 0 late collision 0 lost carrier 0 no carrier 0 babble 0 output discard 0 Tx pause но стоит добавить его в channel-group как он тут же переходит в статус suspend: sh int e 1/48 Ethernet1/48 is down (suspended) admin state is up, Dedicated Interface Belongs to Po1 Hardware: 1000/10000 Ethernet, address: 00c8.8bcc.4091 (bia 00c8.8bcc.4091) MTU 1500 bytes, BW 10000000 Kbit , DLY 10 usec reliability 255/255, txload 1/255, rxload 1/255 Encapsulation ARPA, medium is broadcast Port mode is access auto-duplex, auto-speed, media type is 10G Beacon is turned off Auto-Negotiation is turned on FEC mode is Auto Input flow-control is off, output flow-control is off Auto-mdix is turned off Rate mode is dedicated Switchport monitor is off EtherType is 0x8100 EEE (efficient-ethernet) : n/a admin fec state is auto, oper fec state is off Last link flapped 00:00:31 Last clearing of «show interface» counters 00:00:33 4 interface resets Load-Interval #1: 30 seconds 30 seconds input rate 800 bits/sec, 0 packets/sec 30 seconds output rate 312 bits/sec, 0 packets/sec input rate 800 bps, 0 pps; output rate 312 bps, 0 pps Load-Interval #2: 5 minute (300 seconds) 300 seconds input rate 48 bits/sec, 0 packets/sec 300 seconds output rate 200 bits/sec, 0 packets/sec input rate 48 bps, 0 pps; output rate 200 bps, 0 pps RX 0 unicast packets 27 multicast packets 0 broadcast packets 27 input packets 3557 bytes 0 jumbo packets 0 storm suppression packets 0 runts 0 giants 0 CRC 0 no buffer 0 input error 0 short frame 0 overrun 0 underrun 0 ignored 0 watchdog 0 bad etype drop 0 bad proto drop 0 if down drop 0 input with dribble 0 input discard 0 Rx pause TX 0 unicast packets 6 multicast packets 0 broadcast packets 6 output packets 1146 bytes 0 jumbo packets 0 output error 0 collision 0 deferred 0 late collision 0 lost carrier 0 no carrier 0 babble 0 output discard 0 Tx pause на новом месте конфигурировать пытаюсь так: — int e1/47-48 — switchport — switchport mode access — channel-group 1 mode active — no shutdown — int port-channel 1 — switchport — switchport mode access — no shutdown Состояние этого порта сейчас такое: sh port-channel summary Flags: D — Down P — Up in port-channel (members) I — Individual H — Hot-standby (LACP only) s — Suspended r — Module-removed b — BFD Session Wait S — Switched R — Routed U — Up (port-channel) p — Up in delay-lacp mode (member) M — Not in use. Min-links not met ——————————————————————————— Group Port- Type Protocol Member Ports Channel ——————————————————————————— 1 Po1(SD) Eth LACP Eth1/47(D) Eth1/48(s) В логах есть одна неприятная строчка: 2011 Jan 5 03:00:08 just-sw1 %ETHPORT-3-IF_UNSUPPORTED_TRANSCEIVER: Transceiver on interface Ethernet1/48 is not supported Но меня смущает что при этом интерфейс то поднимается без LACP . Лог предшестующий остановке интерфейса выглядит так: 2011 Jan 5 04:57:17 just-sw1 %ETHPORT-5-SPEED: Interface Ethernet1/48, operatio nal speed changed to 10 Gbps 2011 Jan 5 04:57:17 just-sw1 %ETHPORT-5-IF_DUPLEX: Interface Ethernet1/48, oper ational duplex mode changed to Full 2011 Jan 5 04:57:17 just-sw1 %ETHPORT-5-IF_RX_FLOW_CONTROL: Interface Ethernet1 /48, operational Receive Flow Control state changed to off 2011 Jan 5 04:57:17 just-sw1 %ETHPORT-5-IF_TX_FLOW_CONTROL: Interface Ethernet1 /48, operational Transmit Flow Control state changed to off 2011 Jan 5 04:57:17 just-sw1 %ETHPORT-5-IF_UP: Interface Ethernet1/48 is up in mode access 2011 Jan 5 04:59:19 just-sw1 %ETHPORT-5-IF_DOWN_CHANNEL_MEMBERSHIP_UPDATE_IN_PR OGRESS: Interface Ethernet1/48 is down (Channel membership update in progress) 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-SPEED: Interface Ethernet1/48, operatio nal speed changed to 10 Gbps 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_DUPLEX: Interface Ethernet1/48, oper ational duplex mode changed to Full 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_RX_FLOW_CONTROL: Interface Ethernet1 /48, operational Receive Flow Control state changed to off 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_TX_FLOW_CONTROL: Interface Ethernet1 /48, operational Transmit Flow Control state changed to off 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-SPEED: Interface port-channel1, operati onal speed changed to 10 Gbps 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_DUPLEX: Interface port-channel1, ope rational duplex mode changed to Full 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_RX_FLOW_CONTROL: Interface port-chan nel1, operational Receive Flow Control state changed to off 2011 Jan 5 04:59:21 just-sw1 %ETHPORT-5-IF_TX_FLOW_CONTROL: Interface port-chan nel1, operational Transmit Flow Control state changed to off 2011 Jan 5 04:59:46 just-sw1 %ETH_PORT_CHANNEL-5-PORT_SUSPENDED: Ethernet1/48: Ethernet1/48 is suspended Вот и вся вводная информация, подскажите пожалуйста в какую сторону копать, что можно попробовать?