Подготовка кластерных объектов-компьютеров в доменных службах Active Directory

В этом разделе показан порядок подготовки кластерных объектов-компьютеров в доменных службах Active Directory (AD DS). Эту процедуру можно использовать, чтобы дать возможность пользователю или группе создавать отказоустойчивые кластеры, если у них нет разрешений на создание объектов-компьютеров в AD DS.

Когда вы создаете отказоустойчивый кластер с помощью мастера создания кластеров или Windows PowerShell, необходимо указать имя кластера. Если при создании кластера у вас достаточно разрешений, процесс создания кластера автоматически создает объект-компьютер в AD DS с соответствующим именем кластера. Этот объект называется объектом имени кластера или CNO. Посредством CNO при настройке кластерных ролей, использующих точки доступа клиентов, автоматически создаются виртуальные объекты-компьютеры (VCO). Например, если вы создали файловый сервер высокой надежности с точкой доступа клиента с именем FileServer1, CNO создаст соответствующий VCO в AD DS.

Существует возможность создать отсоединяемый от Active Directory кластер, где в AD DS не создаются CNO или VCOS. Эта возможность предназначена для определенных типов развертывания кластера. Дополнительные сведения см. в разделе Deploy an Active Directory-Detached Cluster.

Для автоматического создания CNO у пользователя, создающего отказоустойчивый кластер, должно быть разрешение на создание объектов-компьютеров для подразделения или контейнера, в которых размещаются серверы, которые войдут в кластер. Чтобы позволить пользователям и группам, не имеющим разрешения, создавать кластеры, пользователь с соответствующими разрешениями в AD DS (обычно администратор домена) может подготовить CNO в AD DS. Это также обеспечивает администратору домена больший контроль над именами, используемыми для кластера, и над тем, в каких подразделениях можно создавать кластерные объекты.

Шаг 1. Подготовка CNO в AD DS

Перед началом работы убедитесь, что знаете следующее:

- Имя, которое нужно назначить кластеру

- Имя учетной записи пользователя или группы, которой требуется предоставить права на создание кластера.

Мы рекомендуем создать подразделение для кластерных объектов. Если подразделение, которое вы хотите использовать, уже существует, для завершения этого шага требуется членство в группе Операторы учета . Если подразделение для кластерных объектов необходимо создать, для завершения этого шага требуется членство в группе Администраторы домена или аналогичной группе.

Если вы создали CNO в контейнере компьютеров по умолчанию, а не в подразделении, вам не нужно выполнять шаг 3 этого раздела. В этом сценарии администратор кластера может создать до 10 VCO без какой-либо дополнительной настройки.

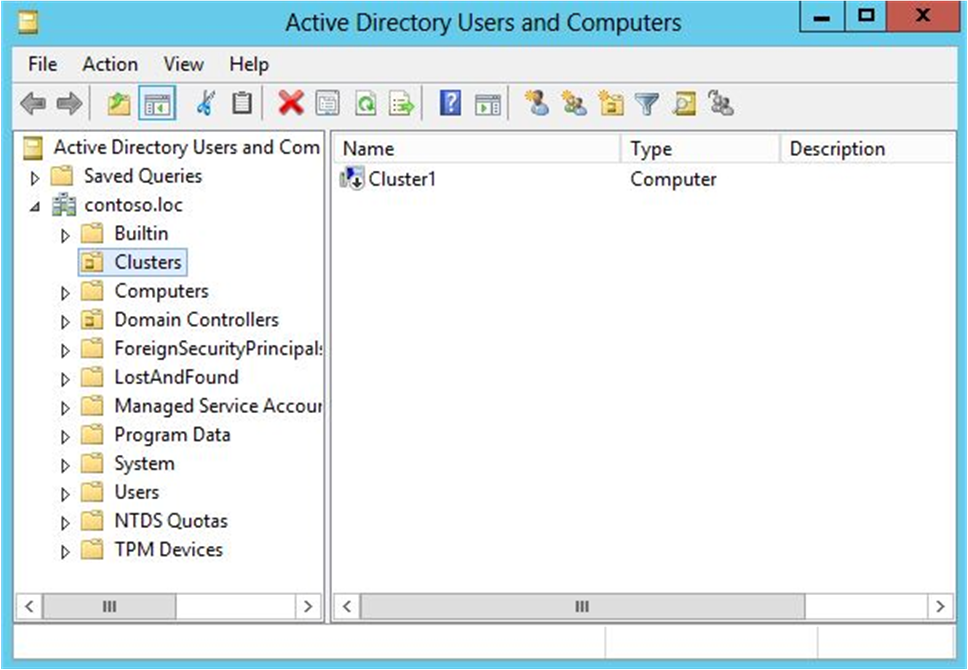

Подготовка CNO в AD DS

- На компьютере с установленными средствами AD DS из средств удаленного администрирования сервера или на контроллере домена откройте Пользователи и компьютеры Active Directory. Чтобы сделать это на сервере, запустите диспетчер сервера, а затем в меню «Сервис» выберите Пользователи и компьютеры Active Directory.

- Чтобы создать подразделение для объектов компьютера кластера, щелкните правой кнопкой мыши доменное имя или существующее подразделение, наведите указатель мыши на новое и выберите подразделение. В поле «Имя» введите имя подразделения и нажмите кнопку «ОК«.

- В дереве консоли щелкните правой кнопкой мыши подразделение, в котором нужно создать CNO, наведите указатель мыши на «Создать» и выберите «Компьютер».

- В поле «Имя компьютера» введите имя, которое будет использоваться для отказоустойчивого кластера, а затем нажмите кнопку «ОК«.

Примечание. Это имя кластера, которое пользователь, создающий кластер, укажет в мастере создания кластеров на странице Точка доступа для администрирования кластера или укажет как значение параметра –Name для командлета New-Cluster Windows PowerShell.

Примечание. Учетную запись необходимо отключить, чтобы во время создания кластера соответствующий процесс подтвердил, что учетная запись не используется в данный момент существующим компьютером или кластером в домене.

Рисунок 1. Отключенный CNO в примере подразделения кластеров

Шаг 2. Предоставление пользователю разрешений на создание кластера

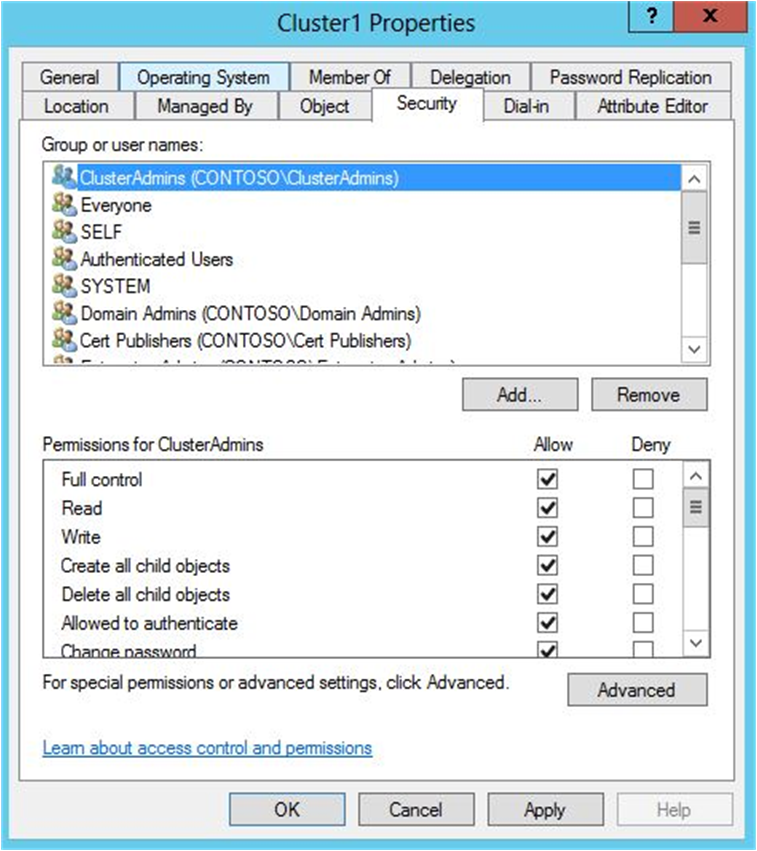

Необходимо настроить разрешения, чтобы учетная запись пользователя, которая будет использоваться для создания отказоустойчивого кластера, имела полный доступ к CNO.

Минимальное требование для выполнения этого шага — членство в группе Операторы учета .

Вот как предоставить пользователю разрешения на создание кластера:

- На странице «Пользователи и компьютеры Active Directory» в меню Вид убедитесь, что выбран пункт Дополнительные параметры .

- Найдите и щелкните правой кнопкой мыши CNO, а затем выберите «Свойства«.

- На вкладке Безопасность щелкните Добавить.

- В диалоговом окне выбора пользователей, компьютеров или групп укажите учетную запись пользователя или группу, которой требуется предоставить разрешения, а затем нажмите кнопку «ОК«.

- Выберите добавленную учетную запись пользователя или группу и около пункта Полный доступустановите флажок Разрешить . Рисунок 2. Предоставление полного доступа пользователю или группе, которые будут создавать кластер

- Нажмите ОК.

После завершения этого шага пользователь, которому вы предоставили разрешение, сможет создать отказоустойчивый кластер. Однако если CNO расположен в подразделении, до завершения вами шага 3 пользователь не сможет создавать кластерные роли, которые требуют точку доступа клиента.

Если CNO находится в контейнере компьютеров по умолчанию, администратор кластера может создать до 10 VCO без какой-либо дополнительной настройки. Чтобы добавить более 10 VCO, необходимо явно предоставить разрешение на создание объектов-компьютеров объекту имени кластера для контейнера компьютеров.

Шаг 3. Предоставление разрешений CNO подразделению или подготовка VCO для кластерных ролей

Когда вы создаете кластерную роль с точкой доступа клиента, кластер создает VCO в том же подразделении, что и CNO. Чтобы это происходило автоматически, CNO должен иметь разрешения на создание объектов-компьютеров в подразделении.

Если вы подготовили CNO в AD DS, для создания VCO можно сделать следующее.

- Вариант 1: Grant the CNO permissions to the OU. Если вы воспользуетесь этим вариантом, кластер сможет автоматически создавать VCO в AD DS. Таким образом, администратор отказоустойчивого кластера сможет создавать кластерные роли, не отправляя вам запрос на подготовку VCO в AD DS.

Необходимым минимумом для выполнения шагов этого варианта является членство в группе Администраторы домена или эквивалентной группе.

- Вариант 2. Подготовка виртуальной машины для кластеризованной роли. Используйте этот вариант, если есть необходимость в подготовке учетных записей для кластерных ролей из-за требований в вашей организации. Например, если вы хотите контролировать использование имен или создание кластерных ролей.

Необходимым минимумом для выполнения шагов этого варианта является членство в группе Операторы учета .

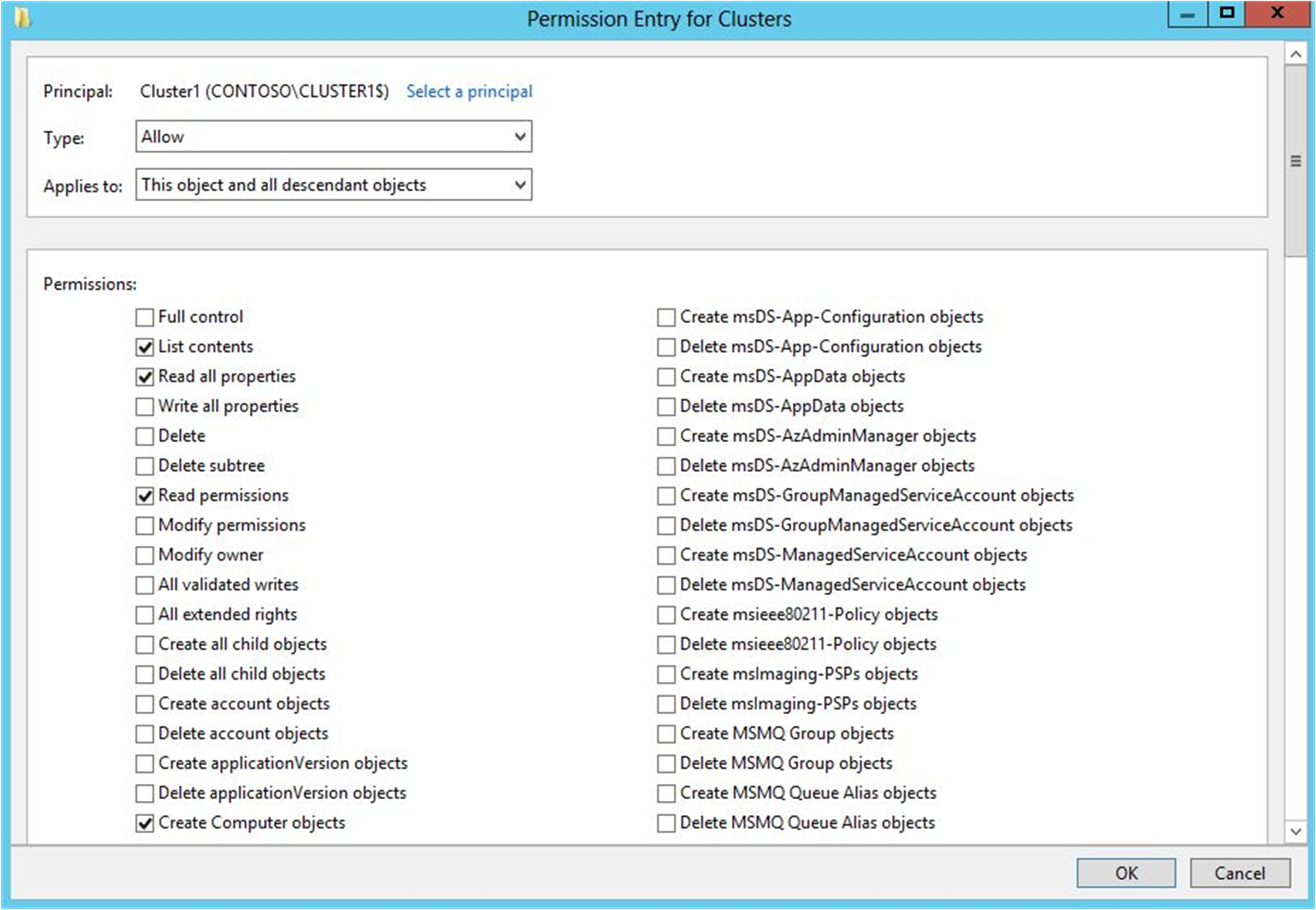

Предоставление разрешений CNO подразделению

- На странице «Пользователи и компьютеры Active Directory» в меню Вид убедитесь, что выбран пункт Дополнительные параметры .

- Щелкните правой кнопкой мыши подразделение, в котором вы создали CNO на шаге 1. Подготовка CNO в AD DS и выберите пункт «Свойства«.

- На вкладке Безопасность нажмите кнопку Дополнительно.

- В диалоговом окне «Расширенная безопасность» Параметры нажмите кнопку «Добавить«.

- Рядом с субъектом выберите пункт «Выбрать субъект«.

- В диалоговом окне «Выбор пользователя, компьютера, учетной записи службы» или «Группы» выберите «Типы объектов», «Компьютеры» проверка и нажмите кнопку «ОК«.

- В разделе «Введите имена объектов» для выбора, введите имя CNO, выберите «Проверить имена» и нажмите кнопку «ОК«. В ответ на предупреждение, которое говорит, что вы хотите добавить отключенный объект, нажмите кнопку «ОК«.

- В диалоговом окне Запись разрешения убедитесь, что для списка Тип установлено значение Разрешить, а для списка Применяется к — значение Этот объект и все дочерние объекты.

- В разделе Разрешенияустановите флажок Создание объектов-компьютеров . Рисунок 3. Предоставление CNO разрешения на создание объектов-компьютеров

- Нажмите кнопку «ОК«, пока не вернеесь к оснастке Пользователи и компьютеры Active Directory.

Теперь администратор отказоустойчивого кластера может создать кластерные роли с точкой доступа клиента и подключить ресурсы.

Подготовка виртуальной машины для кластеризованной роли

- Прежде чем начать подготовку, убедитесь, что знаете имя кластера и имя, которое будет иметь кластерная роль.

- На странице «Пользователи и компьютеры Active Directory» в меню Вид убедитесь, что выбран пункт Дополнительные параметры .

- В Пользователи и компьютеры Active Directory щелкните правой кнопкой мыши подразделение, в котором находится CNO для кластера, наведите указатель на «Создать» и выберите «Компьютер«.

- В поле «Имя компьютера» введите имя, которое будет использоваться для кластеризованной роли, а затем нажмите кнопку «ОК«.

- В качестве рекомендации щелкните правой кнопкой мыши созданную учетную запись компьютера, выберите «Свойства» и выберите вкладку «Объект«. На вкладке «Объект» установите флажок «Защитить объект от случайного удаления» проверка и нажмите кнопку «ОК«.

- Щелкните правой кнопкой мыши созданную учетную запись компьютера и выберите пункт «Свойства«.

- На вкладке Безопасность щелкните Добавить.

- В диалоговом окне «Выбор пользователя, компьютера, учетной записи службы» или «Группы» выберите «Типы объектов», «Компьютеры» проверка и нажмите кнопку «ОК«.

- В разделе «Введите имена объектов» для выбора, введите имя CNO, выберите «Проверить имена» и нажмите кнопку «ОК«. Если появится предупреждение о том, что вы хотите добавить отключенный объект, нажмите кнопку «ОК«.

- Убедитесь, что CNO выделен, после чего рядом с полем Полный доступустановите флажок Разрешить .

- Нажмите ОК.

Теперь администратор отказоустойчивого кластера может создать кластерную роль с точкой доступа клиента, которая соответствует подготовленному имени VCO, и подключить ресурсы.

Дополнительные сведения

- Отказоустойчивая кластеризация

- Настройка учетных записей кластеров в Active Directory

Как создать кластер из двух ноутбуков?

У меня родилась «гениальная» идея: создать соединить мощности двух компов.

Погуглил, такая технология есть, существует и активно используется людьми со всего мира.

Погуглил ещё, оказывается, что это можно сделать на Windows Server и Linux

Ну и соответственно, вопросы:

1.1 Можно ли комфортно работать на Сервере — играть в игры, отвечать на Тостере, смотреть кино? В том числе на кластеризированном?

1.2 Будет ли на кластеризированном линуксе нормально работать Wine и\или подобные средства запуска windows — программ?

Погуглил еще — оказывается, что скорости моего инета для нормального функционирования кластера не хватит, а надо для таких вещей кабельного сообщения компьютеров.

Ну и вопросы:

2.1 Можно ли просто напрямую соединить два компа каким-нибудь таким lan кабелем?

2.2 Если я захочу к этой бандуре подключить еще нетбук, то можно ли просто всё присоединить к подобному свитчу и радоваться жизни?

Хар-ки компьютеров:

2.40 Ghz | 2.27 Ghz — оба двухядерные, от intel

4 Gb RAM- одинаково

512 Mb GPU — одинаково, от nvidia

Dell|Asus

- Вопрос задан более трёх лет назад

- 13395 просмотров

Комментировать

Решения вопроса 2

Для того, для чего вы хотите — никак не создать.

Кластер — это даже согласно статье из Википедии, которую вы приводите — это слабо связанная вычислительная система.

Попробую объяснить, используя аналогию.

Вы считаете, что компьютеры можно объединять также, как можно объединять усилия людей, наполняющих бочку водой, таская ее ведрами. Один человек наполнит за час, два — за полчаса, и так далее. Но это процесс, который распараллеливается элементарно.

А на самом деле, кластер работает подобно команде сценаристов, которые пишут сценарий сериала из двадцати серий, работая удаленно по бумажной почте: сначала главный сценарист придумывает персонажей и общий сюжет, записывает это, потом ему нужно разбить его на серии и отослать каждому из сценаристов, указав, какую серию тому нужно прописать в подробностях. Если бы он писал все сам, ему бы понадобилось по неделе на серию, итого — двадцать недель. А съемки можно начинать, когда готова первая серия (через неделю). Поскольку съемки одной серии занимают три дня, съемочная группа будет простаивать четыре дня из каждой недели, пока не будет готова следующая серия (деньги во время простоя тоже расходуются, хотя ничего не производится). Съемки будут, таким образом, завершены через 20*7+3=143 дня.

Наемным сценаристам тоже нужно по неделе на написании серий, но начальная работа главного сценариста тоже занимает неделю, плюс — три дня на доставку «каркаса сценария» наемным сценаристам, три дня на доставку сценария серий обратно, еще пять дней на проверку и исправление нестыковок. Итог — начинать съемки можно только через 25 дней, а не через семь, но продолжать их можно уже непрерывно. Съемки будут завершены через 25+3*20=85 дней.

Ровно как здесь нельзя ускорить процесс еще больше, заставив больше сценаристов писать по половине серии (потому что при этом растет сложность стыковки кусков сюжета, которые написаны разными людьми, потому им придется переписываться, теряя время), так и пытаясь запустить на кластере условную игру, придется просадить кучу времени на медленное общение узлов между собой по сети.

Чтобы всё «летало» в реальном времени в игре, вам нужен один мощный компьютер с многоядерным процессором, мощной видеокартой и быстрой шиной, которая всех их объединяет. А собрать кластер из сотни древних ноутов на медленном Ethernet и получить производительность в сто раз больше в играх — это фантастика из дурацких фильмов про хакеров.

PARALLEL.RU — Информационно-аналитический центр по параллельным вычислениям

Для начинающих пользователей вычислительных кластеров

Данная страница написана с таким расчетом, чтобы она могла быть полезной не только пользователям вычислительных кластеров НИВЦ, но и всем, желающим получить представление о работе вычислительного кластера. Решение типичных проблем пользователей кластера НИВЦ изложено на отдельной странице.

Что такое вычислительный кластер?

В общем случае, вычислительный кластер — это набор компьютеров (вычислительных узлов), объединенных некоторой коммуникационной сетью. Каждый вычислительный узел имеет свою оперативную память и работает под управлением своей операционной системы. Наиболее распространенным является использование однородных кластеров, то есть таких, где все узлы абсолютно одинаковы по своей архитектуре и производительности.

Подробнее о том, как устроен и работает вычислительный кластер можно почитать в книге А.Лациса «Как построить и использовать суперкомпьютер».

Как запускаются программы на кластере?

Для каждого кластера имеется выделенный компьютер — головная машина (front-end). На этой машине установлено программное обеспечение, которое управляет запуском программ на кластере. Собственно вычислительные процессы пользователей запускаются на вычислительных узлах, причем они распределяются так, что на каждый процессор приходится не более одного вычислительного процесса. Запускать вычислительные процессы на головной машине кластера нельзя.

Пользователи имеют терминальный доступ на головную машину кластера, а входить на узлы кластера для них нет необходимости. Запуск программ на кластере осуществляется в т.н. «пакетном» режиме — это значит, что пользователь не имеет непосредственного, «интерактивного» взаимодействия с программой, программа не может ожидать ввода данных с клавиатуры и выводить непосредственно на экран. Более того, программа пользователя может работать тогда, когда пользователь не подключен к кластеру.

Какая установлена операционная система?

Вычислительный кластер, как правило, работает под управлением одной из разновидностей ОС Unix — многопользовательской многозадачной сетевой операционной системы. В частности, в НИВЦ МГУ кластеры работают под управлением ОС Linux — свободно распространяемого варианта Unix. Unix имеет ряд отличий от Windows, которая обычно работает на персональных компьютерах, в частности эти отличие касаются интерфейса с пользователем, работы с процессами и файловой системы.

Более подробно об особенностях и командах ОС UNIX можно почитать здесь:

- Инсталляция Linux и первые шаги (книга Matt Welsh, перевод на русский язык А.Соловьева).

- Учебник по Unix для начинающих.

- Энциклопедия Linux.

- Операционная система UNIX (информационно-аналитические материалы на сервере CIT-Forum).

Как хранятся данные пользователей?

Все узлы кластера имеют доступ к общей файловой системе, находящейся на файл-сервере. То есть файл может быть создан, напрмер, на головной машине или на каком-то узле, а затем прочитан под тем же именем на другом узле. Запись в один файл одновременно с разных узлов невозможна, но запись в разные файлы возможна. Кроме общей файловой системы, могут быть локальные диски на узлах кластера. Они могут использоваться программами для хранения временных файлов. После окончания (точнее, непосредственно перед завершением) работы программы эти файлы должны удаляться.

Какие используются компиляторы?

Никаких специализированных параллельных компиляторов для кластеров не существует. Используются обычные оптимизирующие компиляторы с языков Си и Фортран — GNU, Intel или другие, умеющие создавать исполняемые программы ОС Linux. Как правило, для компиляции параллельных MPI-программ используются специальные скрипты (mpicc, mpif77, mpif90 и др.), которые являются надстройками над имеющимися компиляторами и позволяют подключать необходимые библиотеки.

Как использовать возможности кластера?

Существует несколько способов задействовать вычислительные мощности кластера.

1. Запускать множество однопроцессорных задач. Это может быть разумным вариантом, если нужно провести множество независимых вычислительных экспериментов с разными входными данными, причем срок проведения каждого отдельного расчета не имеет значения, а все данные размещаются в объеме памяти, доступном одному процессу.

2. Запускать готовые параллельные программы. Для некоторых задач доступны бесплатные или коммерческие параллельные программы, которые при необходимости Вы можете использовать на кластере. Как правило, для этого достаточно, чтобы программа была доступна в исходных текстах, реализована с использованием интерфейса MPI на языках С/C++ или Фортран. Примеры свободно распространяемых параллельных программ, реализованных с помощью MPI: GAMESS-US (квантовая химия), POVRay-MPI (трассировка лучей).

3. Вызывать в своих программах параллельные библиотеки. Также для некоторых областей, таких как линейная алгебра, доступны библиотеки, которые позволяют решать широкий круг стандартных подзадач с использованием возможностей параллельной обработки. Если обращение к таким подзадачам составляет большую часть вычислительных операций программы, то использование такой параллельной библиотеки позволит получить параллельную программу практически без написания собственного параллельного кода. Примером такой библиотеки является SCALAPACK. Русскоязычное руководство по использованию этой библиотеки и примеры можно найти на сервере по численному анализу НИВЦ МГУ. Также доступна параллельная библиотека FFTW для вычисления быстрых преобразований Фурье (БПФ). Информацию о других параллельных библиотеках и программах, реализованных с помощью MPI, можно найти по адресу http://www-unix.mcs.anl.gov/mpi/libraries.html.

4. Создавать собственные параллельные программы. Это наиболее трудоемкий, но и наиболее универсальный способ. Существует два основных варианта. 1) Вставлять параллельные конструкции в имеющиеся параллельные программы. 2) Создавать «с нуля» параллельную программу.

Как работают параллельные программы на кластере?

Параллельные программы на вычислительном кластере работают в модели передачи сообщений (message passing). Это значит, что программа состоит из множества процессов, каждый из которых работает на своем процессоре и имеет свое адресное пространство. Причем непосредственный доступ к памяти другого процесса невозможен, а обмен данными между процессами происходит с помощью операций приема и посылки сообщений. То есть процесс, который должен получить данные, вызывает операцию Receive (принять сообщение), и указывает, от какого именно процесса он должен получить данные, а процесс, который должен передать данные другому, вызывает операцию Send (послать сообщение) и указывает, какому именно процессу нужно передать эти данные. Эта модель реализована с помощью стандартного интерфейса MPI. Существует несколько реализаций MPI, в том числе бесплатные и коммерческие, переносимые и ориентированные на конкретную коммуникационную сеть.

Как правило, MPI-программы построены по модели SPMD (одна программа — много данных), то есть для всех процессов имеется только один код программы, а различные процессы хранят различные данные и выполняют свои действия в зависимости от порядкового номера процесса.

Более подробно об MPI можно почитать здесь:

- Курс Вл.В.Воеводина «Параллельная обработка данных». Лекция 5. Технологии параллельного программирования. Message Passing Interface.

- Вычислительный практикум по технологии MPI (А.С.Антонов).

- А.С.Антонов «Параллельное программирование с использованием технологии MPI».

- MPI: The Complete Reference (на англ.яз.).

- Глава 8: Message Passing Interface в книге Яна Фостера «Designing and Building Parallel Programs» (на англ.яз.).

Где можно посмотреть примеры параллельных программ?

Схематичные примеры MPI-программ можно посмотреть здесь:

- Курс Вл.В.Воеводина «Параллельная обработка данных». Приложение к лекции 5.

- Примеры из пособия А.С.Антонова «Параллельное программирование с использованием технологии MPI».

Примеры простейших работающих MPI-программ доступны в составе пакета MPICH, свободно распространяемой реализации MPI. Для пользователей НИВЦ МГУ простейшие примеры MPI-программ на Си и Фортране доступны в директории /home/examples/mpi. Примеры использования конструкций MPI в программах на языке Си можно посмотреть в тестах производительности для параллельных компьютеров. Примеры программ на Фортране с комментариями можно посмотреть в англоязычном документе «MPI User’s Guide in Fortran» (формат Word).

Можно ли отлаживать параллельные программы на персональном компьютере?

Разработка MPI-программ и проверка функциональности возможна на обычном ПК. Можно запускать несколько MPI-процессов на однопроцессорном компьютере и таким образом проверять работоспособность программы. Желательно, чтобы это был ПК с ОС Linux, где можно установить пакет MPICH. Это возможно и на компьютере с Windows, но более затруднительно.

Насколько трудоемко программировать вычислительные алгоритмы c помощью MPI и есть ли альтернативы?

Набор функций интерфейса MPI иногда называют «параллельным ассемблером», т.к. это система программирования относительно низкого уровня. Для начинающего пользователя-вычислителя может быть достаточно трудоемкой работой запрограммировать сложный параллельный алгоритм с помощью MPI и отладить MPI-программу. Существуют и более высокоуровневые системы программирования, в частности российские разработки — DVM и НОРМА, которые позволяют пользователю записать задачу в понятных для него терминах, а на выходе создают код с использованием MPI, и поэтому могут быть использованы практически на любом вычислительном кластере.

Как ускорить проведение вычислений на кластере?

Во-первых, нужно максимально ускорить вычисления на одном процессоре, для чего можно принять следующие меры.

1. Подбор опций оптимизации компилятора. Подробнее об опциях компиляторов можно почитать здесь:

- Компиляторы Intel C++ и Fortran (русскоязычная страница на нашем сайте).

- GCC online documentation.

2. Использование оптимизированных библиотек. Если некоторые стандартные действия, такие как умножение матриц, занимают значительную долю времени работы программы, то имеет смысл использовать готовые оптимизированные процедуры, выполняющие эти действия, а не программировать их самостоятельно. Для выполнения операций линейной алгебры над матричными и векторными величинами была разработана библиотека BLAS («базовые процедуры линейной алгебры»). Интерфейс вызова этих процедур стал уже фактически стандартом и сейчас существуют несколько хорошо оптимизированных и адаптированных к процессорным архитектурам реализаций этой библиотеки. Одной из таких реализаций является свободно распространяемая библиотека ATLAS, которая при установке настраивается с учетом особенностей процессора. Компания Интел предлагает библиотеку MKL — оптимизированную реализацию BLAS для процессоров Intel и SMP-компьютеров на их основе. Тут статья про подбор опций MKL.

Подробнее о библиотеках линейной алгебры (BLAS) можно почитать здесь:

3. Исключение своппинга (автоматического сброса данных из памяти на диск). Каждый процесс должен хранить не больше данных, чем для него доступно оперативной памяти (в случае двухпроцессорного узла это примерно половина от физической памяти узла). В случае необходимости работать с большим объемом данных может быть целесообразным организовать работу со временными файлами или использовать несколько вычислительных узлов, которые в совокупности предоставляют необходимый объем оперативной памяти.

4. Более оптимальное использование кэш-памяти. В случае возможности изменять последовательность действий программы, нужно модифицировать программу так, чтобы действия над одними и те же или подряд расположенными данными данными выполнялись также подряд, а не «в разнобой». В некоторых случаях может быть целесообразно изменить порядок циклов во вложенных циклических конструкциях. В некоторых случаях возможно на «базовом» уровне организовать вычисления над такими блоками, которые полностью попадают в кэш-память.

5. Более оптимальная работа с временными файлами. Например, если программа создает временные файлы в текущем каталоге, то более разумно будет перейти на использование локальных дисков на узлах. Если на узле работают два процесса и каждый из них создает временные файлы, и при этом на узле доступны два локальных диска, то нужно, чтобы эти два процесса создавали файлы на разных дисках.

6. Использование наиболее подходящих типов данных. Например, в некоторых случаях вместо 64-разрядных чисел с плавающей точкой двойной точности (double) может быть целесообразным использовать 32-разрядные числа одинарной точности (float) или даже целые числа (int).

Более подробно о тонкой оптимизации программ можно почитать в руководстве по оптимизации для процессоров Intel и в других материалах по этой теме на веб-сайте Intel.

Как оценить и улучшить качество распараллеливания?

Для ускорения работы параллельных программ стоит принять меры для снижения накладных расходов на синхронизацию и обмены данными. Возможно, приемлемым подходом окажется совмещение асинхронных пересылок и вычислений. Для исключения простоя отдельных процессоров нужно наиболее равномерно распределить вычисления между процессами, причем в некоторых случаях может понадобиться динамическая балансировка.

Важным показателем, который говорит о том, эффективно ли в программе реализован параллелизм, является загрузка вычислительных узлов, на которых работает программа. Если загрузка на всех или на части узлов далека от 100% — значит, программа неэффективно использует вычислительные ресурсы, т.е. создает большие накладные расходы на обмены данными или неравномерно распределяет вычисления между процессами. Пользователи НИВЦ МГУ могут посмотреть загрузку через веб-интерфейс для просмотра состояния узлов.

В некоторых случаях для того, чтобы понять, в чем причина низкой производительности программы и какие именно места в программе необходимо модифицировать, чтобы добиться увеличения производительности, имеет смысл использовать специальные средства анализа производительности — профилировщики и трассировщики. На кластере Ant установлена система для отладки MPI-программ deb-MPI. Краткую информацию по системе можно найти по адресу http://parallel.ru/cluster/deb-MPI-UG.html .—>

Подробнее об улучшении производительности параллельных программ можно почитать в книге В.В.Воеводина и Вл.В.Воеводина «Параллельные вычисления».

Создай свой кластер

С выходом Windows NT Server 3.51 у администраторов появилась возможность объединять серверы Windows в кластеры с помощью продуктов Microsoft и независимых поставщиков. Кластеризация всегда считалась удачным решением, но раньше мало кто мог себе это позволить. Однако благодаря снижению цен и совершенствованию технологии кластеризация стала гораздо более доступной. Я рекомендую объединять в кластеры серверы даже на малых предприятиях.

Многие считают, что кластер — это группа серверов, в которой при неисправности одного сервера другие серверы без промедления принимают на себя и выполняют ту же задачу. Однако это мнение верно лишь отчасти. Данное определение подходит лишь для одной разновидности кластеров, называемых кластерами с высоким уровнем отказоустойчивости. Кластеры другого вида обеспечивают балансировку сетевой нагрузки (Network Load Balancing, NLB, согласно терминологии Microsoft) и могут быть определены как группа совместно функционирующих компьютеров, которые обеспечивают выполнение общего набора приложений или служб.

Функции организации кластеров с высоким уровнем отказоустойчивости реализованы в Windows Server 2003 Datacenter Edition, Windows Server 2003 Enterprise Edition, Windows 2000 Advanced Server и Windows 2000 Datacenter Server. В данной статье основное внимание уделяется характеристикам и функциональности Windows 2003. Windows 2003 поддерживает кластеры с высоким уровнем отказоустойчивости, содержащие до 8 узлов. В NLB-кластеры, которые можно организовать с использованием всех версий Windows 2003, может входить до 32 узлов.

Нельзя сформировать непрерывно функционирующую вычислительную среду с балансировкой нагрузки, соединив технологии кластеров высокой отказоустойчивости и NLB компании Microsoft. Одновременно можно применять только одну технологию кластеризации. Чтобы получить среду с балансировкой нагрузки и высокой отказоустойчивостью, необходимо обратиться к решениям независимых поставщиков.

NLB используется в средах с интенсивным трафиком и в крупных организациях для формирования ферм Web-серверов и Web-ферм терминальных служб. Но многим предприятиям могут подойти именно кластеры с высокой отказоустойчивостью — например, биржам, системам предварительного заказа авиабилетов, больницам, банкам и казино. Представьте, какой будет реакция директора казино, если попросить его остановить игру на несколько минут для применения пакета обновлений и перезагрузки сервера. Не все предприятия предъявляют к своей информационной инфраструктуре столь жесткие требования, но кластеры с высоким уровнем отказоустойчивости уместны при использовании файл- и принт-серверов, систем Microsoft Exchange Server и Microsoft SQL Server, а также специальных серверов приложений.

Как работает Microsoft Cluster Service

На первый взгляд организовать кластер просто: достаточно подключить несколько компьютеров к общей сети и общему жесткому диску. Однако кластеру необходимо присвоить единый уникальный IP-адрес, а назначать нескольким машинам один IP-адрес нельзя. Кроме того, Windows кэширует дисковую информацию, в том числе содержимое файлов, в оперативной памяти, чтобы увеличить скорость дисковых операций. Windows «не видит» оперативную память другого компьютера, поэтому при записи данных на диск несколькими компьютерами может быть испорчен диск или потеряны данные. Для устранения этой и других проблем специалисты Microsoft разработали службу Microsoft Cluster Service.

Служба Microsoft Cluster Service генерирует фантомный IP-адрес, который представляет кластер и может быть назначен любому из его узлов. Тем не менее каждый компьютер в кластере располагает уникальным IP-адресом. Служба Microsoft Cluster выделяет закрытую область диска (иначе называемую диском кворума — quorum disk), через которую узлы обмениваются параметрами реестра и информацией о состоянии кластера. Служба Microsoft Cluster Service также использует сеть для передачи данных о состоянии узлов между серверами группы.

Служба Microsoft Cluster Service — не полностью отказоустойчивое, а кластерное решение с высокой отказоустойчивостью. Разница заключается в том, что в среде с высокой отказоустойчивостью пользователи выжидают «секундную паузу» (согласно терминологии Microsoft) при переключении задания с отказавшего узла на исправный. В полностью отказоустойчивой среде пауз при переключении нет. При работе с типичным приложением для сферы бизнеса моментальные паузы не представляют серьезной проблемы, но администратор сможет самостоятельно оценить длительность «моментальной» задержки в своем тестовом кластере.

Построение тестового кластера

Обычно администраторы сервера стараются побыстрее отложить в сторону том технической документации и сразу приступить к экспериментам. В данной статье приводится информация, необходимая для организации тестового кластера, а также некоторые рекомендации и указания по вопросам, недостаточно полно изложенным в документации. Хочу предупредить, что эти рекомендации предназначены для домашней или тестовой сети. Не следует применять их на производственных системах Exchange или SQL Server.

Необходимо иметь по крайней мере четыре компьютера; три с Windows 2003 Enterprise Edition и четвертый — с Windows XP или иной клиентской операционной системой. Можно задействовать VMware, но некоторые вещи просто невозможно выполнить с помощью виртуальной машины (VM). Я бы рекомендовал совместно с коллегами провести эксперименты с кластерами в выходные дни. Так будет легче выполнить требования к аппаратным средствам.

Помимо четырех компьютеров (каждый из которых оснащен сетевой платой), потребуются два дополнительных сетевых адаптера, две платы SCSI (я использовал модель Adaptec AHA-2940), внешний SCSI-диск любой емкости, Y-образный кабель SCSI и два 10-Мбит/с или 100-Мбит/с концентратора. Кроме того, понадобятся несколько кабелей Ethernet и файл MP3. Если каких-то аппаратных устройств не хватает, их лучше всего купить на онлайновом аукционе. Заплатив в общей сложности менее 100 долл., там можно приобрести SCSI-диск, SCSI-платы и SCSI-кабель.

| Рисунок 1. Архитектура тестового кластера |

На рис. 1 показана схема тестового кластера: контроллер домена (DC), два сервера с высокой отказоустойчивостью и рабочая станция; все эти компьютеры подключены к общедоступной сети, именуемой Public. Оба сервера с высокой отказоустойчивостью оснащены вторым сетевым адаптером и подключаются к частной сети, называемой Private. Я полагаю, что желающие смогут самостоятельно установить все серверные программы, исправления и драйверы. По умолчанию Windows 2003 Enterprise Edition устанавливает службу Microsoft Cluster. Перед установкой серверного программного обеспечения на двух серверах с высокой отказоустойчивостью следует установить второй сетевой адаптер и плату SCSI. С помощью Device Manager можно убедиться, что платы SCSI и вторые сетевые адаптеры функционируют корректно. SCSI-диск подключать пока не следует.

Всем сетевым адаптерам назначаются статические IP-адреса — в отсутствие DHCP-сервера удобно использовать жестко заданные IP-адреса серверов. Щелкнув правой кнопкой мыши на My Network Places, следует выбрать пункт Properties и пометить сетевые адаптеры в серверах высокой отказоустойчивости как Public и Private, чтобы в дальнейшем без труда различать их. Для адреса Private не нужен шлюз, выбираемый по умолчанию, так как маршрутизации трафика не требуется. IP-адрес DC нужно указать в качестве предпочтительного сервера DNS на серверах с высокой отказоустойчивостью и рабочей станции. Порты FireWire (IEEE 1394) на серверах с высокой отказоустойчивостью следует отключить, иначе при создании кластера система выдаст соответствующее предупреждение.

Рабочая станция нужна для просмотра и создания текстовых файлов, а также воспроизведения файлов MP3 с сервера. На системе DC можно запустить Dcpromo, назначить ее контроллером домена и организовать лес и домен. В состав домена можно ввести рабочую станцию, но пока не следует добавлять в домен два сервера с высокой отказоустойчивостью.

С помощью Y-образного кабеля SCSI нужно подключить SCSI-диск к SCSI-платам в серверах. SCSI-диск не должен получать питание ни от одной из машин с высокой отказоустойчивостью: один из тестов, которые предстоит выполнить, состоит в отключении компьютера от сети. Затем следует удалить терминатор на диске SCSI и убедиться, что адаптеры SCSI терминированы правильно. В большинстве SCSI-дисков ID установлен в значение 0, что вполне приемлемо. Однако ID одной из плат SCSI, вероятно, придется изменить. По умолчанию идентификаторы SCSI-плат устанавливаются равными 7. Один из них следует изменить на 6, а другой оставить равным 7, иначе обе платы окажутся на одной шине SCSI и возникнет конфликт. Включая компьютеры по одному, можно убедиться, что каждый из них распознает диск SCSI.

Затем следует ввести оба компьютера в состав домена и дать им имена. Я назвал свои d34 и d35, они вошли в состав домена dog.attbi.com. Наконец, необходимо создать учетную запись для кластера. Я назвал свою учетную запись CSerAct-1 (сокращение от Cluster Services Account-1) и назначил ей локальные административные полномочия. В учетной записи следует отменить режим User must change password at next logon и установить флажок Password never expires.

Создание кластера и добавление узлов

Создавая кластер, необходимо сначала дать ему имя. Затем в новый кластер вводятся серверы или узлы. Далее с кластером ассоциируется ресурс, например приложение или служба. Всю процедуру можно выполнить примерно за час.

- Сначала один из серверов отключен, а другой запущен. На включенном сервере следует щелкнуть на кнопке Start и выбрать из меню пункты Administrative Tools, Cluster Administrator.

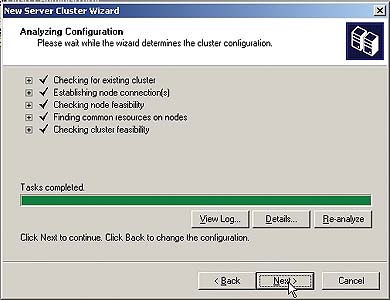

- Необходимо убедиться, что в раскрывающемся списке Open Connection to Cluster выбран вариант Create new cluster, и щелкнуть на кнопке OK, чтобы запустить мастера New Server Cluster Wizard. Затем следует щелкнуть на кнопке Next.

- Подтвердив, что домен выбран, нужно дать имя первому кластеру. Я выбрал имя Cluster-1. После этого необходимо щелкнуть на кнопке Next.

- На следующем экране требуется ввести имя компьютера — нужно указать имя первого сервера и щелкнуть на кнопке Next.

- Служба Microsoft Cluster анализирует конфигурацию (экран 1). Этот процесс запускается автоматически и должен быть завершен за одну-две минуты. После его окончания следует заглянуть в файл журнала, чтобы выяснить, какие параметры отмечены службой Microsoft Cluster.

- На следующем экране нужно ввести действительный неиспользуемый IP-адрес общедоступной сети для инструментов управления (этот виртуальный IP-адрес отличается от адреса сервера высокой отказоустойчивости). Нажмите Next.

- Следует ввести имя учетной записи для кластера (в моем случае CSerAct-1). Этой учетной записи даны полномочия локального администратора на всех узлах в кластере. Затем нужно щелкнуть на кнопке Next.

- Мастер выводит на экран рекомендуемую конфигурацию кластера, которая представляет собой сводку выбранных пользователем параметров. Нажмите Next.

- Служба Microsoft Cluster создает кластер, и Cluster Administrator предоставляет еще одну возможность просмотреть файл журнала. Щелкните на кнопке Finish, чтобы закрыть мастер.

- Уделите некоторое время изучению Cluster Administrator и его меню.

|

| Экран 1. Анализ конфигурации кластера |

Таким образом создается одноузловой кластер. Чтобы добавить к нему второй узел, необходимо выбрать пункт Add nodes to cluster из раскрывающегося списка Open Connection to Cluster и запустить мастер Add Nodes Wizard. Этот мастер проводит пользователя по тем же шагам, что и New Server Cluster Wizard. В ответ на запрос имени и IP-адреса компьютера следует ввести имя и адрес второго сервера. Альтернативный метод создания второго узла — выбрать пункты New, Node из меню File программы Cluster Administrator. На экране 2 показан двухузловой кластер в окне Cluster Administrator.

Создание ресурса для кластера

Следующая задача после создания кластера — связать кластер с ресурсом. Ресурс может быть совместно используемым файлом, принт-спулером, службой DHCP, WINS или таким приложением, как Exchange или SQL Server. Чтобы создать разделяемый файловый ресурс с высоким уровнем отказоустойчивости на диске SCSI, необходимо создать группу, ресурсы физического диска, IP-адреса, сетевое имя и общий файл, а затем сделать файловый ресурс доступным по сети.

Чтобы сформировать группу, нужно выполнить следующие шаги.

- На каждом узле кластера или на DC открыть Cluster Administrator и подключиться к кластеру.

- В одном из узлов щелкнуть правой кнопкой мыши на Active Groups и выбрать из меню пункты New, Group.

- На первом экране мастера New Group Wizard назначить имя общего файлового ресурса (я использовал имя FileShare-Group-1) и дать ему описание. Затем следует щелкнуть на кнопке Next.

- В качестве владельцев ресурсов выбрать два сервера с высокой отказоустойчивостью, назначить им полномочия (то есть определить порядок работы) и щелкнуть на кнопке Finish.

Чтобы создать ресурс на физическом диске, необходимо выполнить следующие операции.

- Щелкнув правой кнопкой мыши на вновь созданной группе, нужно выбрать пункты New, Resource. Этот и другие ресурсы будут составной частью новой созданной группы.

- Необходимо ввести имя и описание физического диска. В качестве типа ресурса следует выбрать Physical Disk, а в качестве группы — только что сформированную группу (FileShareGroup-1). Затем требуется щелкнуть на кнопке Next.

- В качестве владельцев следует указать два кластерных узла и нажать Next.

- Не нужно указывать никаких зависимостей. Физический диск независим от других ресурсов. Щелкните на кнопке Next.

Затем необходимо создать ресурс из IP-адреса. Этот IP-адрес представляет собой виртуальный IP-адрес для SCSI-диска; с его помощью служба Microsoft Cluster обнаруживает SCSI-диск, обслуживаемый одним из серверов с высоким уровнем отказоустойчивости. Виртуальный IP-адрес позволяет любому узлу с высокой отказоустойчивостью направлять запросы к диску.

- Щелкнув правой кнопкой мыши на группе, необходимо выбрать пункты New, Resource.

- Требуется ввести имя и описание для IP-адреса. Выбрав IP-адрес для типа ресурса, следует выбрать группу, а затем щелкнуть на кнопке Next.

- Необходимо указать два узла в качестве владельцев и щелкнуть на кнопке Next.

- Не следует задавать зависимостей. Щелкните на кнопке Next.

- Требуется ввести действительный (виртуальный) IP-адрес в общедоступной сети, указать маску подсети и выбрать сеть, а затем щелкнуть на кнопке Finish.

Чтобы задать имя сетевого ресурса, необходимо выполнить следующие шаги.

- Щелкнув правой кнопкой мыши на группе, выбрать пункты New, Resource.

- Ввести имя и описание. Для типа ресурса необходимо выбрать Network Name, затем указать группу и щелкнуть на кнопке Next.

- Выбрать два узла в качестве владельцев и щелкнуть на кнопке Next.

- Сетевое имя ресурса зависит от его IP-адреса, поэтому следует добавить ресурс IP-адреса в поле в правой части экрана и щелкнуть на кнопке Next.

- Затем необходимо ввести имя виртуального сервера и щелкнуть на кнопке Finish.

Теперь все готово для создания ресурса разделяемого файла.

- Необходимо щелкнуть правой кнопкой мыши на группе и выбрать пункты New, Resource.

- Следует ввести имя и описание. Выбрав IP-адрес для типа ресурса, нужно выбрать группу и нажать Next.

- Укажите два узла в качестве владельцев и щелкните на кнопке Next.

- Общий файл как ресурс зависит от корректного функционирования физического диска, IP-адреса и сетевого имени, поэтому названные три ресурса следует ввести в правое поле экрана. Щелкните на кнопке Next.

- Введите имя, путь и описание общего ресурса.

- Щелкните на кнопке Permissions. По умолчанию предоставляется разрешение Read Only. Разрешения следует изменить таким образом, чтобы иметь возможность обновлять файлы в ходе тестирования кластера. Нажмите OK.

- Щелкнув на кнопке Advanced, необходимо выбрать режимы Share Subdirectories и Hide Subdirectories, а затем последовательно щелкнуть на кнопках OK и Finish.

Последний шаг — сделать общий файл доступным.

- Щелкните правой кнопкой мыши на группе и выберите пункт Bring Online.

Теперь разделяемый ресурс готов к использованию.

Тестирование

Приступаем к самому интересному этапу. Следует зарегистрироваться в домене с рабочей станции и скопировать файл MP3 на диск SCSI, подключенный к серверам с высоким уровнем отказоустойчивости. Теперь можно начать опыты с файлом и отключить сетевой кабель одного из узлов. Продолжается ли воспроизведение песни без перерыва или произошла задержка? Затем следует вновь подключить кабель и посмотреть, что будет дальше. Наблюдаются ли какие-нибудь отличия при отключении разных серверов? После этого можно экспериментировать (отключать другие кабели, в том числе кабель питания) с кластером, осваивая тонкости технологии. Чтобы определять активный и пассивный узлы в ходе тестирования, можно использовать Cluster Administrator или утилиту командной строки cluster.exe.

После выполнения первого набора тестов следует запустить программу Microsoft NetMon для анализа трафика как частного, так и общедоступного сегмента в ходе последующих экспериментов. Постарайтесь идентифицировать пакеты «я жив» (heartbeat packet), которые посылает активный сервер, и пакет, свидетельствующий о переключении узлов (fail-over packet). Можно запустить и System Monitor (раньше эта утилита называлась Performance Monitor) на обоих узлах с высокой отказоустойчивостью для наглядного сопоставления производительности.

Интересно дополнить кластер третьим и четвертым узлами. В этом случае проблемы возникают с кабелем SCSI, и Microsoft официально поддерживает только узлы, работающие с операционной системой, но не кабель или накопитель SCSI, поэтому действовать приходится на свой страх и риск. Было бы интересно узнать о результатах экспериментов с еще большим числом узлов. Самый простой способ увеличить число узлов — задействовать Internet SCSI (iSCSI). Я построил 8-узловой кластер с использованием iSCSI и подключал более 60 серверов к одному приемнику iSCSI через 100-Мбит/с сеть Ethernet. Я рекомендую уделить некоторое время изучению iSCSI. Для начала можно прочитать врезку «Принципы iSCSI».

Итак, мы сделали большой шаг на пути к освоению кластеров. Я был бы рад предложить читателям источники более подробной информации, но, к сожалению, мне не удалось найти ни одного. В книгах по Windows 2003 рассказывается о Windows Server 2003 Standard Edition и упоминается лишь о дисковых кластерах. Другой ресурс — форумы и почтовые списки рассылки, в первую очередь в Web и Google.

Дуглас Спиндлер (douglas-spindler@sfntug.org) — консультант и преподаватель, президент группы San Francisco Networking Technologies Users Group. Имеет сертификат Microsoft MVP

Коротко о главном

- Сегодня кластеры с высоким уровнем отказоустойчивости доступны даже для малых предприятий.

- Хорошая документация для кластеров отсутствует.

- Следуя подробным инструкциям, изложенным в данной статье, можно настроить простую тестовую среду и создать двухузловой кластер.

Принципы iSCSI

Стандарт Internet SCSI (iSCSI), принятый IETF, обеспечивает инкапсуляцию команд SCSI в пакетах TCP/IP. Это экономичное решение для кластеризации и балансировки нагрузки. iSCSI позволяет использовать существующую сетевую инфраструктуру для пересылки данных SCSI.

Сервер может быть расположен в Нью-Йорке, а дисковая система в Сан-Франциско — от пользователя требуется лишь терпение, так как соединение через Internet работает медленно. Microsoft реализовала iSCSI в Windows Server 2003, Windows XP и Windows 2000 Server. Спецификацию поддерживают и другие поставщики, такие как Cisco Systems. iSCSI отличается невысокой стоимостью по сравнению с SAN (Storage Area Network — сеть устройств памяти) и простотой реализации, к тому же она встроена в хорошо знакомую технологию TCP/IP.

Как работает iSCSI

Принцип работы iSCSI несложен. Сервер, называемый инициатором (initiator), посылает запрос к диску. Операционная система и драйвер инициатора iSCSI перехватывают запрос и инкапсулируют его в пакете IP. Вместо того чтобы передавать запрос по шине SCSI, драйвер направляет запрос в сетевой адаптер, который передает его по адресу назначения приемника (target) iSCSI (возможно, с шифрованием) точно так же, как любой другой пакет IP. Получив пакет, приемник iSCSI «разворачивает» его и передает команду SCSI в присоединенный диск. Следует обратить внимание, что iSCSI, как и SAN, передает данные блоками, а устройства NAS (Network Attached Storage — система хранения данных, подключаемая к сети) передают данные на файловом уровне.

Стандарт iSCSI не предназначен для замены высокоуровневых SAN, но легко заменит SAN начального или среднего класса. Пропускная способность в сети 1000Base-T близка к Fibre Channel. iSCSI подойдет для серверов с умеренным трафиком, например внутренних Web-узлов, файл- и принт-серверов, а также малых приложений для работы с базами данных.

Построение среды iSCSI

Для iSCSI необходимы сеть, сервер или рабочая станция (которые будут служить инициатором), драйверы инициатора и приемник. Сеть и компьютер-инициатор у администратора уже имеются; компьютер должен работать с Windows 2003, Windows XP Professional Service Pack 1 (SP1), Windows 2000 SP3 или более поздними версиями. Драйверы инициатора — небольшие программы, которые можно бесплатно загрузить с Web-узла Microsoft по адресу http://www.microsoft.com/downloads/ details.aspx?familyid=12cb3c1a-15d6-4585-b385-befd1319f825&displaylang=en. Их установка занимает одну-две минуты, и перезагружать машину не требуется. В процессе установки загружаются служба Microsoft iSCSI Initiator и панель управления iSCSI Initiator Control Panel, ярлык для которой размещается на рабочем столе. С помощью этой утилиты можно настроить несколько параметров — IP-адрес или имя DNS-приемника iSCSI, а также некоторые параметры безопасности.

Для полного решения не хватает одного компонента, приемника iSCSI: в настоящее время Microsoft не выпускает программ, которые позволяли бы серверу выполнять роль приемника. Несколько поставщиков предлагают приемники и специализированные шлюзы iSCSI. Компания EqualLogic выпускает приемник, Cisco предоставляет шлюз, а Novell поставляет приемник и инициатор вместе с NetWare 6.5. Существуют инициаторы и приемники Linux. Поскольку стандарт iSCSI подготовлен комитетом IETF, при использовании инициатора и приемника от разных производителей проблем возникнуть не должно. Мнение специалистов, уже имеющих опыт работы с iSCSI, и мои тесты подтверждают успешность взаимодействия.

iSCSI — развивающаяся технология, но она уже успешно применяется на практике. Несколько администраторов серверов рассказывали мне, что используют iSCSI на основных производственных серверах и за более чем двухлетний период круглосуточной эксплуатации без выходных дней не сталкивались ни с какими проблемами. iSCSI построен на базе двух широко применяемых протоколов: TCP/IP и SCSI. Технология не требует больших затрат, проста для внедрения и поможет расширить функциональность центра обработки данных. Вопрос о применении технологии iSCSI на конкретном предприятии заслуживает самого пристального внимания.

Нет необходимости в указании шлюза по умолчанию для частного адреса, поскольку данные никогда не маршрутизируются.