Как скопировать любой сайт целиком: 7 способов

Можно ли скопировать любой сайт в интернете? Да, конечно. Для этого потребуется всего пара минут и несколько кликов. Но с одной оговоркой — вы получите его html-код, внешний вид сайта, без сложных скриптов (для их реализации потребуется программист). Этот вариант подойдет для тех, кому нужно скопировать несложный сайт — например, лендинг конкурента и быстро запустить рекламу.

Скопировать сайт целиком и переделать?

Стоит понимать, что, копируя сайт, вы с большой вероятностью столкнетесь с “сюрпризами”, которые обязательно нужно проверить перед работой:

- корректная верстка (все элементы на своих местах, работает исправно и мобильная версия, и десктоп),

- все картинки загружаются (при копировании, возможно, что-то не сохранилось, неправильно указан путь файла в коде),

- активные элементы работают исправно (кнопки, формы).

Все эти мелочи исправляются за несколько минут самостоятельно, либо с помощью фрилансеров, если речь идет о скриптах.

Для самостоятельной работы с кодом рекомендуем: Sublime Text, Visual Studio Code, Atom.

Далее, все что вам останется — перенести сайт на ваш хостинг с доменом.

Так чем же скопировать сайт?

7 способов бесплатно скопировать сайт

Самый простой способ: “Ctrl+S” — команда в браузере, которая сохраняет текущую страницу. Быстро, без посторонних сервисов, но с высокой вероятностью потерять часть сайта (динамические элементы, скрипт, формы) — больше подойдет для копирования контента страниц.

Если вам нужно скопировать работоспособный одностраничный сайт, то лучше обратиться к специальным сервисам, которые помимо HTML, копируют CSS, JavaScript, все изображения, анимации, ссылки и формы. Тем более, что часть из них полностью бесплатна.

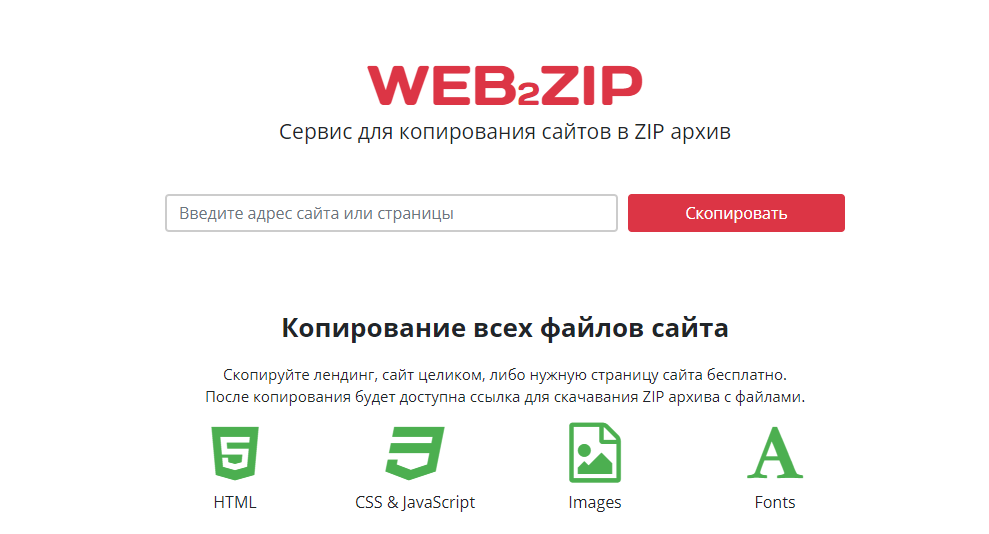

Web2zip

https://web2zip.ru/ — бесплатный онлайн сервис с простым интерфейсом. Вводим нужный нам url сайта, нажимаем скопировать и получаем сайт в архиве с возможностью предпросмотра онлайн.

Сервис копирует HTML, CSS, JavaScript, изображения и шрифты.

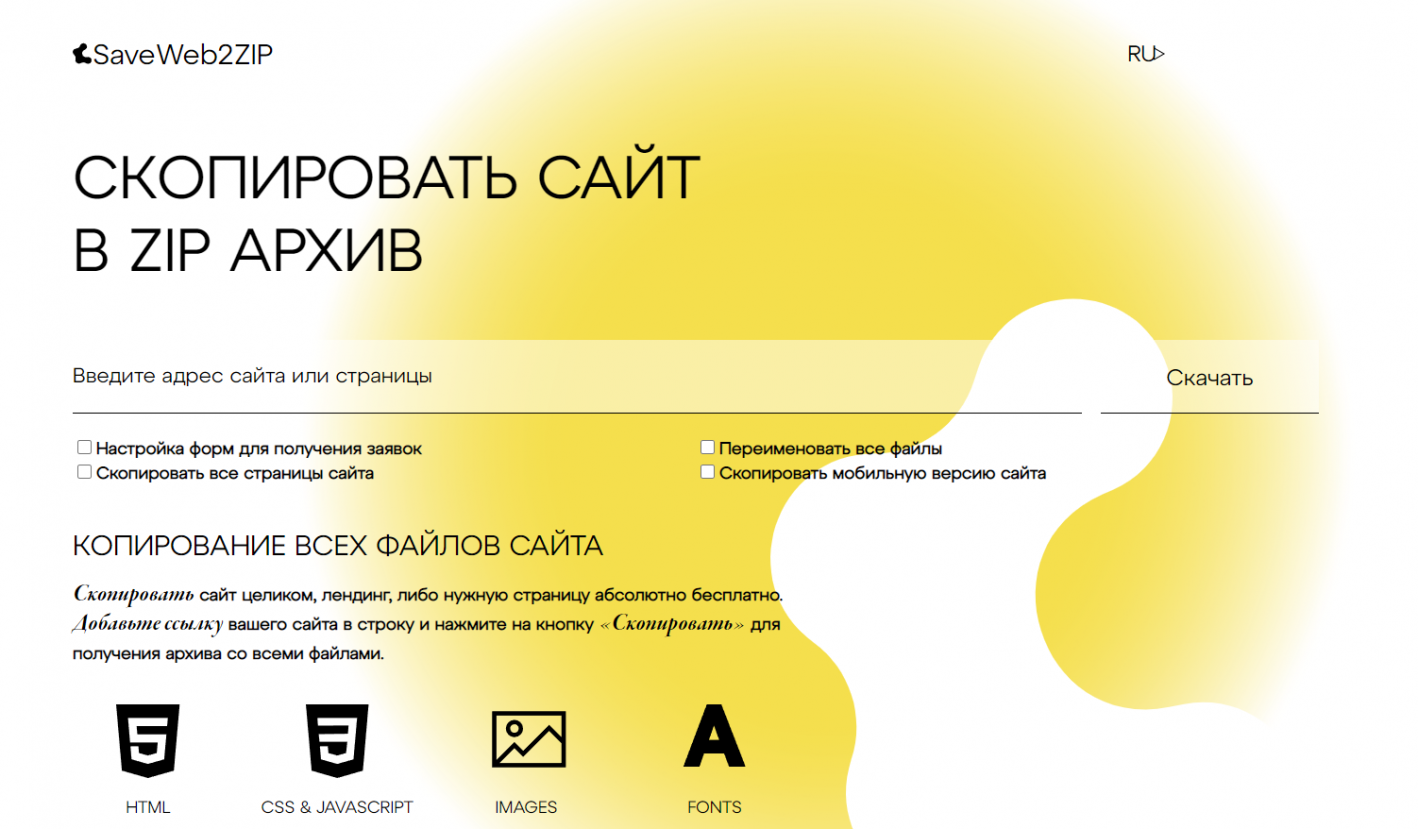

Saveweb2zip

https://saveweb2zip.com/ru — онлайн-сервис с бесплатной возможностью скачать сайт, сохраняя HTML, CSS, JavaScript, изображения и шрифты. За дополнительную плату можно заказать настройку форм и решение других вопросов.

При скачивании есть возможность автоматически переименовать названия файлов, скопировать мобильную версию сайта.

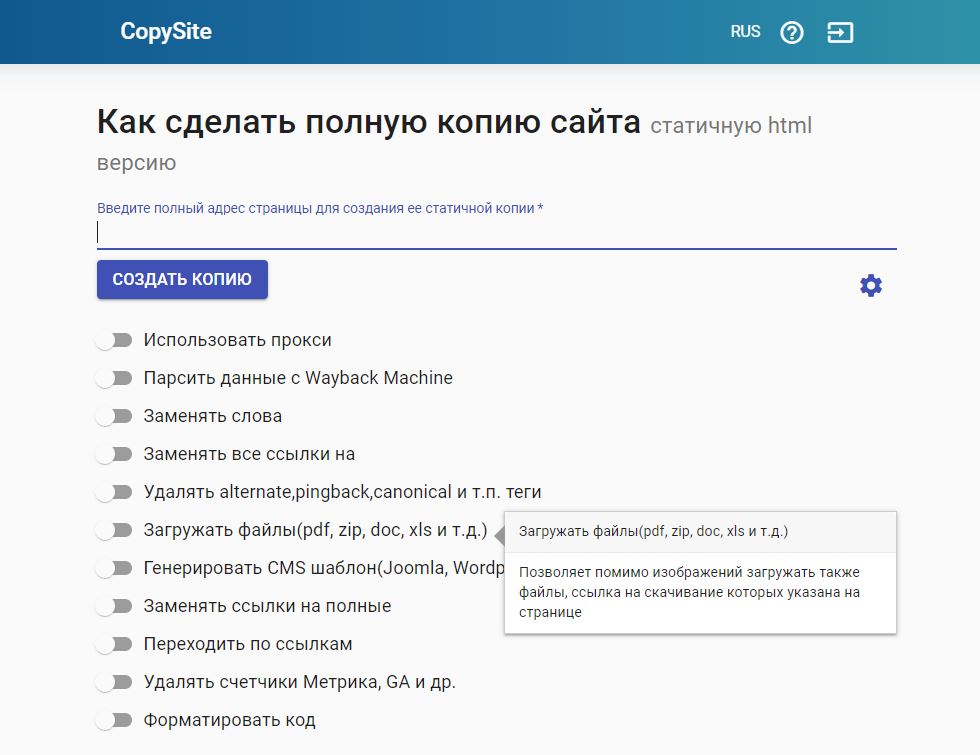

CopySite

https://copysite.link/ — онлайн-сервис уже с платной подпиской, но более широким функционалом. При скачивании есть возможность использовать прокси, заменять слова, ссылки, автоматически удалять теги, счетчики метрик и форматировать код.

Стоимость — 300 руб./мес., 200 руб./неделя, 75 руб./сутки.

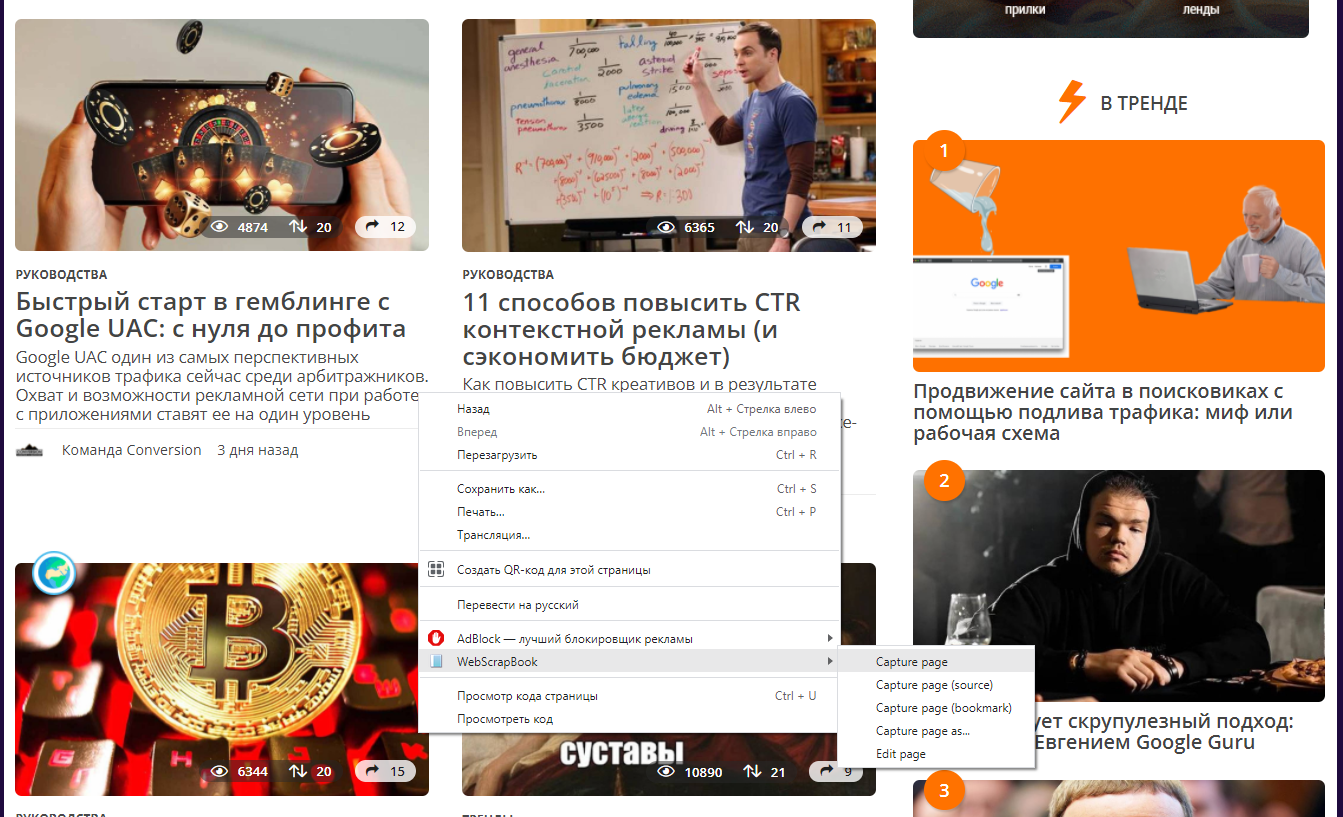

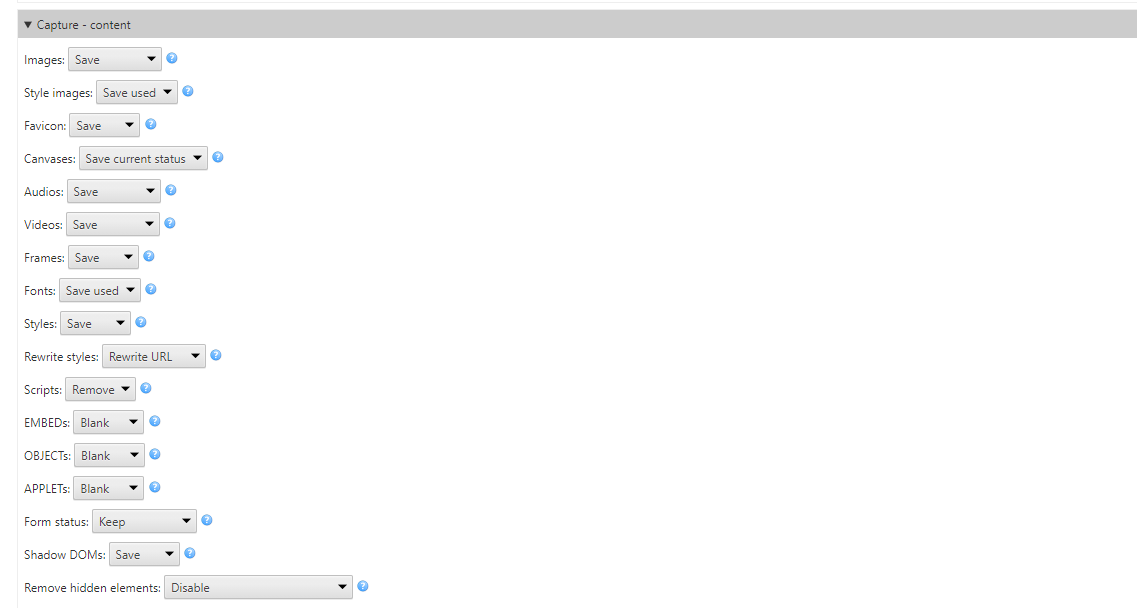

Web ScrapBook

Web ScrapBook — бесплатное браузерное расширение, которое позволяет скачивать необходимые страницы сайта не покидая целевую страницу.

Сервис имеет широкий опционал для настройки, позволяющий работать с мультимедийными файлами и скриптами: скачивать, вырезать, заменять, пропускать.

Httrack

Httrack — бесплатный локальный сервис, для работы нужно устанавливать на компьютер. С задачей справляется отлично, основное преимущество — можно скачивать несколько сайтов одновременно (списком загружать url), всегда готов к работе (не зависит от работоспособности онлайн-сервисов), менее удобен, чем решения выше.

Cyotek WebCopy

Cyotek WebCopy — один из сервисов компании Cyotek, требует установки, но абсолютно бесплатный. Копирует контент, а также стили, но теряет JavaScript.

Отлично подойдет для парсинга контента сайтов и копировании простых сайтов.

wget

wget — консольная утилита, которая позволяет копировать сайты без графического интерфейса, используя команду типа “wget -r -k -l 7 -p -E -nc http:/vash.site/”

Параметры отвечают за:

- -r — указывает на то, что нужно переходить по ссылкам на сайте, чтобы скачивать все подкаталоги и все файлы в подкаталогах.

- -k — преобразует все ссылки в скаченных файлах, чтобы по ним можно было переходить на локальном компьютере в автономном режиме.

- -p — указывает на то, что нужно загрузить все файлы, которые требуются для отображения страниц (изображения, css и т.д.).

- -l — определяет максимальную глубину вложенности страниц, которые нужно скачать. Обычно сайты имеют страницы с большой степенью вложенности и чтобы wget не начал «закапываться», скачивая страницы, можно использовать этот параметр.

- -E — добавлять к загруженным файлам расширение .html.

- -nc — указывает на то, что существующие файлы не будут перезаписаны — например, при продолжении ранее прерванной загрузки сайта.

Среди платных решений стоит выделить также: RoboTools (2$ — 250 стр), Teleport Pro ($50).

Итог

Скопировать любой сайт в 2021 году может абсолютно каждый пользователь, который даже не знает про программирование, код и прочее — для этого есть широкий выбор сервисов. Они отлично решают вопрос скачивания одностраничных лендингов, сохраняя их работоспособность, но далеко не всегда могут справиться с сложными сайтами.

Если вам нужен качественный сайт или его копия, то рекомендуем все же обратиться к специалистам — тогда значительно повысится вероятность, что все элементы будут корректно работать, сайт — выполнять свою задачу, а трафик — приносить вам деньги.

Чтобы не было сюрпризов, обязательно проверяйте работоспособность сайта перед работой со всех устройств!

Как скачать бесплатно любой сайт

Действительно можно скачать любой сайт и у вас будет рабочая копия этого сайта, но есть одно но — это будет HTML версия сайт. Практическое применение такого сайта:

Одностраничный лендиг пейдж для запуска рекламы. Подправить отсылку конверсии на ваш почтовый ящик, вы сможете самостоятельно, используя любой текстовый редактор, например Sublime Text.

Оффлайн версия сайта, позволит вам переходить по ссылкам так, как вы делаете это в Интернете. В рамках скачанного сайта вы сможете пользоваться всеми разделами, меню и т.д.

Изучение. Допустим, вы веб-дизайнер или разработчик, вы можете изучать новые модели UX и лучшие практики кодирования. Все, что вам нужно сделать, это загрузить полный веб-сайт и начать учиться.

Скопировать любой сайт в 2022 году может абсолютно каждый пользователь, который даже не знает про программирование, код и прочее — для этого есть широкий выбор сервисов, программ и плагинов. Они отлично решают вопрос скачивания одностраничных лендингов, сохраняя их работоспособность, но далеко не всегда могут справиться с сложными сайтами.

Если вам нужен качественный сайт или его копия, то рекомендуем все же обратиться к специалистам — тогда значительно повысится вероятность, что все элементы будут корректно работать, сайт — выполнять свою задачу, а трафик — приносить вам деньги. Обязательно проверяйте работоспособность сайта перед работой со всех устройств!

1. Самый простой и доступный

В любом браузере нажмите сочетание клавиш «Ctrl+S», которая сохраняет текущую страницу. Это быстрый способ, но скорей всего будет утеряна часть сайта (динамические элементы, скрипт, формы). Способ больше подойдет для копирования контента страниц.

Если нужно скопировать работоспособный одностраничный сайт, не только HTML , но и CSS , JavaScript, изображения, анимации, ссылки и формы, то этот способ вам не подойдет.

2. Плагин Save Page WE

Плагин Save Page WE предоставляет простое средство для сохранения веб-страницы (в том виде, в котором она отображается в данный момент) в виде одного файла HTML , который можно открыть в любом браузере. Сохраненная страница — это очень точное представление исходной страницы. Несколько страниц можно сохранить, выбрав несколько вкладок или загрузив список URL -адресов страниц.

Save Page WE реализована с использованием API WebExtensions и доступна как для Firefox, так и для Chrome с идентичными функциями и пользовательскими интерфейсами.

3. Сервис Web2zip

web2zip — бесплатный онлайн сервис с простым интерфейсом. Вводим нужный нам url сайта, нажимаем скопировать и получаем сайт в архиве с возможностью предпросмотра онлайн. Сервис копирует HTML , CSS , JavaScript, изображения и шрифты.

Удобно, сам до этого не пользовался этим сервисом. В целях тестирования проверил — работает.

4. Программа Cyotek WebCopy

Программа Cyotek WebCopy — абсолютно бесплатна. Устанавливается только на Windows, поддерживает Windows 10, 8.1, 8, 7, Vista SP2.

Отлично подойдет для копирования несложных сайтов. Я чаще всего использую именно эту программу.

WebCopy просканирует указанный веб-сайт и загрузит его содержимое. Ссылки на такие ресурсы, как таблицы стилей, изображения и другие страницы веб-сайта будут автоматически преобразованы в соответствие с локальным путем. WebCopy проверит HTML -разметку веб-сайта и попытается обнаружить все связанные ресурсы, такие как другие страницы, изображения, видео, загрузки файлов — все и вся. Он загрузит все эти ресурсы и продолжит поиск. Таким образом, WebCopy может «сканировать» весь веб-сайт и загружать все, что он видит, чтобы создать разумное факсимиле исходного веб-сайта.

5. Консольная программа wget

Где скачать версию консольную программы Wget и как нею пользоваться читайте в статье Примеры использования wget.

6. Программа HTTrack Website Copier

Универсальная программа HTTrack Website Copier под Windows, Linux, FreeBSD и даже Android.

HTTrack — это простая в использовании утилита для автономного браузера. Она позволяет загрузить сайт из Интернета в локальную директорию, рекурсивно выстраивая все директории, получая html, изображения и другие файлы с сервера на ваш компьютер. HTTrack упорядочивает относительную ссылочную структуру исходного сайта. Просто откройте страницу «зеркального» сайта в своем браузере, и вы сможете просматривать сайт от ссылки к ссылке, как если бы вы просматривали его онлайн. HTTrack также может обновлять существующий зеркальный сайт и возобновлять прерванные загрузки. HTTrack полностью настраивается и имеет встроенную справочную систему.

7. Сервис SaveWeb2Zip

Сервис SaveWeb2Zip, в отличии от сервиса Web2zip, умеет автоматически переименовать все файлы, это важно для арбитражников, простым людям занимающимся белым бизнесом — это не важно.

Также, за дополнительную плату можно заказать настройку форм и решение других вопросов.

8. Сервис Archivarix скачивание onion сайтов из Даркнет

Сервис Archivarix позволяет скачать 200 файлов бесплатно. Если файлов на сайте больше и вам нужны все, то вы можете заплатить за эту услугу. Стоимость загрузки зависит от количества файлов.

Archivarix умеет скачивать не только с существующих сайтов, но также Wayback Machine, Google Cache и .onion сайты.

.onion — псевдо-домен, созданный для обеспечения доступа к анонимным или псевдо-анонимным адресам сети Tor (сокращение от The Onion Router). Добро пожаловать в Даркнет (Darknet)!

Заключение, или как разместить скаченный сайт на хостинг

В данной инструкции описан процесс размещения сайта на хостинг TimeWeb. Этого хостера рекомендую как простого в настройке виртуального хостинга.

Для размещения сайта закажите хостинг по нужному тарифу и зайдите в созданную панель управления аккаунтом, используя логин и пароль, высланные на ваш e-mail после регистрации на сайте. Более подробно о регистрации + промокоды в статье Регистрация на веб хостинге «TimeWeb». Просто и быстро.

Далее выполните следующие действия:

Регистрируем домен. Если у вас уже есть зарегистрированный домен, добавьте его в раздел «Домены и поддомены» по кнопке «Добавить домен», либо зарегистрируйте новый домен в этом же разделе по кнопке «Зарегистрировать домен». При регистрации необходимо создать администратора домена, если еще не создан. Так же можно убрать все ненужные платные опции. После регистрации домена должно пройти 3-24 часа, чтобы он стал доступен в сети — это время необходимое для обновления DNS .

Создаем директорию сайта. Переходим в раздел «Сайты» и нажимаем ссылку «Создать новый сайт». Выбираем способ «Создать директорию». Указываем имя директории, например, такое же, как имя домена.

Привязываем домен к директории сайта. В разделе «Сайты» кликаем по ссылке «Привязать домен» напротив созданной директории и выбираем нужный домен из списка. Если нужного домена нет в списке, то он может быть привязан к другой директории и тогда сначала нужно его отвязать.

Загружаем файлы сайта. Переходим в раздел «Файловый менеджер». Заходим в созданную до этого директорию сайта, далее заходим в папку public_html. Удаляем все содержимое этой папки, выделив его мышкой и выбрав в меню менеджера «Файл» → «Удалить». Далее в меню менеджера выбираем «Файл» → «Загрузить на сервер». Выбираем ZIP архив с сайтом и загружаем его в директорию. Выделяем загруженный архив мышкой в файловом менеджере, в меню менеджера выбираем «Архиватор» → «Разархивировать» и распаковываем архив.

Проверьте работу сайта. Введите в адресной строке браузера ваш домен. Если все сделали правильно, то сайт должен открыться.

Как скопировать любой сайт целиком и переделать под себя?

Причём речь идёт как о лендосах, так и о многостраничниках (например, интернет-магазин) — скачать можно всё. Только посадочные страницы загружаются в несколько кликов, а на копирование полноценных сайтов могут уйти дни и даже недели. Арбитражник должен это понимать перед тем, как браться за работу.

Как скопировать сайт? Какие способы для этого существуют? Можно ли упростить себе задачу, используя сторонние сервисы? Сегодня расскажем всё, погнали!

Риски копирования сайтов для арбитражников

Во-первых, это защита авторского права. Владелец сайта может подать в суд на арбитражника, который решил воспользоваться наработками конкурентов для собственного обогащения.

Это как со спай-сервисами : работу конкурентов можно использовать как заготовку, материал для собственного вдохновения, но не более того. Грубая копипаста чужого труда не только чревата неприятностями — она попросту не принесёт вебмастеру ни трафика, ни денег. Невозможно переманить ЦА с оригинального сайта на копию, к тому же если она сделана на тяп-ляп.

Вебмастер, понимающий своё дело, никогда не станет полностью копировать чужую работу: он заменит логотип, поработает над цветами, разместит свой контент — словом, проведёт работу, которая поможет ему создать оригинальный продукт.

А уж тогда будьте уверены, что трафик польётся рекой.

Итак, какие существуют способы скопировать чужой веб-ресурс?

Скопировать сайт через браузер ( CTRL + S)

– Скопируется не всё: динамические файлы страницы и скрипты могут не загрузиться, в результате будут ошибки в вёрстке.

Самый простой способ: нажать CTRL + S (на MacOS это cmd + S) и выбрать способ скачки — только страница HTML, страница одним файлом или веб-страница полностью. Подойдёт тем, кто хочет иметь доступ к странице оффлайн. Но простота — единственный плюс копирования через браузер, так как клонируется только визуальная часть сайта, тогда как остальное в процессе копирования просто отвалится. Баннеры, скрипты, формы обратной связи — всё это придётся настраивать вручную, так как частично эта кухня работает на стороне сервера. Для допиливания копированного сайта и его адекватного запуска всё равно придётся искать программиста и платить ему деньги.

Альтернатива — сделать это самостоятельно, если есть навык. В помощь такому арбитражнику будут Notepad++, Visual Studio Code или Sublime Text.

Вариант для арбитражников, которые любят иметь в своём арсенале несколько вариантов решения задачи — браузерное расширение Save Page WE. В отличие от обычного Save As, упаковывает сайт в более упорядоченную структуру и имеет ещё несколько интересных функций, которые бывалым вебмастерам точно понравятся.

Wget — как скачать сайт через консоль

Этот способ тоже подразумевает копирование сайта без графических элементов. Но функционал у утилиты довольно широкий, а именно:

- скан и копирование сайтов по протоколам http, https, ftp и ftps;

- упаковывание исходного кода + контента в один файл mhtml с локальным доступом;

- создание зеркал с возможностью загрузки оных на новый сервер.

Утилита доступна на Linux (изначально) и на Windows (позднее). Для копирования необходимо ввести в консоль команду типа “wget -r -k -l 7 -p -E -nc http:/tvoi.site/”.

Параметры обозначают следующее:

- -r — переход по ссылкам на сайте, скачивание подкаталогов и всех файлов в этих подкаталогах;

- -k — преобразование скачанных урлок для работы с ними в автономном режиме;

- -l — параметр глубины вложенности страницы. Если вы парсите не одностраничник, а целый интернет-магазин, то последний будет иметь глубину вложенности, и благодаря этому параметру утилита будет знать насколько глубоко ей копать;

- -p — команда для загрузки всех «визуальных» файлов — изображений, css и проч.;

- -E — преобразует скачанные файлы в .html;

- -nc — указывает на то, что утилита не будет перезаписывать текущие файлы — например, если загрузка была прервана.

Клонировать сайт через скрипт

+ Бесплатно; можно подкрутить скрипт под свои задачи;

– Скорее всего, придётся разбираться в PHP; если сайт защищён протоколом HTTPS, то с выгрузкой могут быть проблемы; формы обратной связи тоже работать не будут, так что и тут придётся идти к программисту.

В данном случае речь идёт о скрипт-парсерах, с помощью которых вебмастер может не только скопировать весь сайт, но и выгрузить данные с него в excel-таблицу. Такие библиотеки для парсинга чаще всего делаются программистами под конкретные задачи, поэтому в интернете вы найдёте огромное их количество. По этой причине многие подобные программы бесплатны, это их главное преимущество.

А если вы арбитражник, ещё и немножечко умеющий в веб-разработку, то сможете докрутить ту или иную библиотеку для парсинга под свои задачи. Фактически, умея кодить, арб может выкачивать любые данные с сайта на свой выбор, будь то текстовые страницы сайта, контакты, базы email, каталоги товаров и проч.

Скачать сайт через сторонний софт

+ Ручные настройки: можно выбирать между копированием как отдельных элементов (фото, тексты, каталоги товаров), так и всего сайта; есть разнообразие возможностей, в зависимости от выбранного софта;

– Функционал = стоимость: чем его больше, тем дороже программа;

А ещё с помощью таких инструментов можно останавливать и возобновлять скачку. Некоторые софтины для клонирования сайтов довольно сложны в освоении и придётся потратить время, чтобы разобраться. Но разве этим напугаешь профессионального веба? Ведь каждый день нам приходится сталкиваться не только с многозадачностью, но и с необходимостью разбираться в том, как всё устроено.

Ниже — несколько программ, дающих представление о том как скопировать сайт целиком .

WebScrapBook

Браузерное расширение, с помощью которого вебмастера могут скачать и зафиксировать нужные страницы сайта, не покидая самой целевой страницы.

Функции сервиса включают:

- Захват веб-страницы с точными данными — такими, как урла источника, отметка времени и т.д.;

- Захват страницы с данными, которые арбитражник выбирает сам: область страницы, сохранение исходное страницы, сохранение страницы в виде закладки. Сюда же относится скачка графического контента, шрифтов, стилей и рамок. Веб-мастер может сохранять скачанные страницы в виде zip-архива, папки или HTML-страницы;

- Встроенное редактирование страницы. Это к вопросу о том как скопировать сайт и переделать под себя ;

- Доступ к данным с любого устройства. Скачанные страницы можно просматривать с любого ПК или смартфона, так как они хранятся на центральном сервере. Можно создать индекс статического сайта, который будет размещён на общем сервере;

- Поддержка мобильных браузеров. Сюда относятся Firefox для Андроид и Kiwi browser.

Основное преимущество софтины в том, что она бесплатна.

Teleport Pro

Онлайн-сервис для скачивания сайта полностью, со всей его структурой и исходным кодом, или выборочных файлов.

- Многопоточность, что ускоряет процесс скачки файлов;

- Несколько режимов клонирования, включая копию сайта для автономного просмотра;

- Возможность задать маску файлов;

- Ручная настройка глубины прохода по сайту и ограничение доменного имени;

- Автоматизация запуска, остановки и обновления процесса копирования сайта.

И многое другое.

- Дороговато. Месячная подписка стоит около $50;

- Обновления. Cофт довольно старый: он был создан в 2006, интерфейс у него нафталиновый. И увы, программа доступна только для Винды. Последний раз обновлялся аж в 2016 году, но олдфагам должно понравится.

Teleport Pro совместима с основными браузерами, включая Гугл Хром. Она во многом напоминает утилиту Wget, которую мы рассматривали выше.

Httrack Website Copier

Ещё одна старенькая софтина для клонирования сайта, которая тоже давно не обновлялась — с 2017 года. Интерфейс в лучших традициях начала нулевых. Функционал похож на Телепорт и Вгет.

- Можно скачивать несколько сайтов одновременно;

- Упорядочивает ссылочную структуру скопированного сайта;

- Бесплатный.

Доступен только для Винды и Линукса. Пользователи, пробовавшие несколько решений, уверяют, что WebScrapBook и Teleport Pro будут поудобнее, чем Websire Copier.

Cyotek WebCopy

Программа, которая идеально подойдёт для скачивания небольших сайтов. Для арбитражников, которые регулярно работают с лендосами — то, что нужно.

- Есть ручная конфигурация — парсить веб-ресурс полностью или частично;

- Простой;

- Бесплатный;

- Требует установки;

- Клонирует контент и CSS, но теряет JavaScript.

В принципе это всё, что стоит знать о программе. Поскольку она тоже считается устаревшей, вебы могут использовать её как доп. средство для клонирования сайтов конкурентов вместе с другими сервисами, представленными в этой статье.

Копия сайта через WordPress

Вордпресс заслужил любовь вебов за свою простоту: чтобы создавать или копировать сайты на этой CMS, не нужно знать код. Пользоваться WordPress относительно просто, все базовые инструменты находятся внутри системы. К услугам арбов куча плагинов, с помощью которых можно в том числе и копировать сайты коллег-конкурентов. Ниже рассмотрим некоторые из них.

Scrapes

Плагин автоматического захвата контента, который позволяет срисовывать инфу с любого сайта и переносить её на другие источники. Фича парсера — автоматическое копирование: настроив его один раз, арбитражник будет регулярно получать обновления с копируемого сайта в онлайн-режиме. Минус софтины в том, что она запустится только на Windows, «яблочным» пользователям она недоступна.

WPGrabber

Этот плагин на движке Вордпресс заточен под автоматическое наполнение сайтов контентом разных видов. При этом арбитражник может парсить контент для своей площадки с любого количества источников — хоть с двух сайтов, хоть с тысячи. Главное разобраться как это всё настроить и автоматизировать, потому что помимо того как скопировать чужой сайт , плагин может парсить контент из соц. сетей, Youtube и блогов — всего он «знает» более 90 площадок, с которых может вытаскивать данные. WPGrabber фильтрует контент по ключевым словам или по изображениям, умеет переводить текстовое содержимое более чем с 20 языков и многое другое.

Онлайн-сервисы для копирования сайтов

+ Никаких требований к железу и ОС; можно скачать сайт на смартфон — как iOs, так и Android; простота и доступность — никаких инструкций и долгих копаний в настройках, всё автоматизировано максимально;

– Медленная скорость клонирования из-за нагрузки на сервер; ограниченность опций по сравнению с полноценными программами для скачки сайтов.

Вроде как всё просто и удобно — зашли на сайт, задали параметры копирования и начали скачку. Но обратная сторона медали — это ошибки, которые могут возникать при копировании: их может быть больше, чем при использовании полноценного софта. Тёртые арбитражники для клонирования веб-ресурсов используют несколько онлайн-сервисов одновременно, но на это уходить немало времени. И денег тоже, так как хорошие онлайн-сервисы для копирования сайтов редко бывают бесплатными, а вернуть средства, если инструмент не зайдёт, вряд ли получится.

На каком из способов клонирования сайта конкурента останавливаться, выбирать вам. Ниже мы обрисуем возможности нескольких онлайн-сервисов, чтобы вы могли выбрать для себя лучший вариант — или вернуться к одному из предыдущих способов копирования сайтов.

Saveweb2zip.com

Простой и доступный онлайн-сервис для копирования любого сайта — от скромного лендоса до огромных многостраничников. Арбы могут выкачивать содержимое сайта в несколько кликов. Оно загружается в архив, который содержит файл index.html. В отличие от других допотопных программ, таблицы стиля и javascript тоже скачиваются, так что при загрузке сайта с динамическими изображениями они скорее всего будут отображаться.

Как скачать сайт через saveweb2zip?

- Заходим на сайт — saveweb2zip.com;

- Вставляем ссылку на ресурс — обязательно в виде https://www.vashsite.com/ ;

- Ждём, пока скачается, это занимает несколько секунд.

Всё. Инструмент на момент написания статьи бесплатный. Дополнительно можно настроить:

- Форму для получения заявок (для арбов предусмотрена интеграция с перечнем партнёрок, включая Adcombo и Aff1, но в том числе и с целой кучей российских сервисов, так что тут стоит быть бдительным);

- Мобильную версию сайта;

- Переименование скачанных файлов;

А ещё можно скачать сайт другим алгоритмом, если с первого раза что-то пошло не так.

WebsiteDownloader и Website Copier

Первый сервис, дело рук нидерландских разработчиков, также называется Wayback Machine Loader. Вебмастера могут скачать любой ресурс в несколько ctrl+c и ctrl+v:

- Переходим на сайт сервиса ;

- Вставляем адрес сайта, который хотим скачать, в соответствующую строку;

- Указываем почту, на которую хотим получить результат;

- Выбираем что именно будем клонировать: пдфки, документы, эксельки, эксемельки, другие файлы — или всё вместе;

- Ставим галочку, что мы не робот.

Скачиваем. Как и в предыдущих случаях, мы получим файл index.html. Это демо-версия скачанного сайта и её мы можем получить бесплатно. Получить доступ ко всем файлам можно за $15. Сервис также предлагает арбам восстановление доменов с archive.org, преобразование html-файлов в WordPress, неограниченное восстановление архива в HTML, генератор политики конфиденциальности и создание htaccess. Что-то из этого достанется бесплатно, а за что-то нужно будет оформить платную подписку.

Website Copier, который теперь называется Toolsbug.com, это целый набор инструментов: тут и скачка изображений из Инсты и Пинтереста, и генератор тегов для Ютуба, и конечно инструмент копирования сайтов. До 50 страниц можно скачать бесплатно, если больше, доплачиваем $12.50. Инструкция по скачиванию прилагается.

Как скопировать сайт с админкой

Клонирование веб-ресура с админкой, помимо скачивания самого сайта, обычно включает в себя:

- Настройку формы обратной связи;

- Установку текстового редактора;

- Очистку информации — удаление левых номеров телефонов, счётчиков, адресов и т.д.;

- Загрузку на хостинг.

И так далее. Многие сервисы из тех, что мы рассмотрели в этой статье — например, Httrack, имеют соответствующие настройки, но надо разбираться, так как они могут быть не выставлены по дефолту. Если делать это лень, то можно делегировать фрилансеру — услуга эта недорогая, адекватный спец сделает всё за 1-2 рабочих дня. Сюда же относится и вопрос как скопировать сайт на другой домен. Выполнение подобной задачи на украинских биржах фриланса на момент написания статьи стоило $20-30.

Вывод

Что нужно знать арбитражнику о копировании сайтов конкурентов и о том, как их переделать под свои потребности?

- Чужой сайт как объект интеллектуальной собственности может быть защищён авторским правом. В этом случае за его полное копирование вы как арбитражник можете попасть под уголовную ответственность. Но есть одно но;

- Умный арбитражник будет использовать скопированный сайт как сырьё для собственного веб-ресурса. Он переделает шрифты, цвета, поменяет адреса, телефоны и емейлы, заменит текстовый, фото- и видеоконтент — словом, проведёт работу для того, чтобы его сайт выглядел уникальным;

- Существует масса способов скопировать чужой сайт: от комбинации клавиш в браузере до сложных программ с кучей опций, в которых надо копаться. В некоторых случаях вебмастеру могут понадобиться навыки разработчика. Если их нет или не хочется осваивать код, то копирование сайта с админкой и перенос его на новый домен можно поручить фрилансеру, стоит эта услуга относительно недорого. Но опять же всё будет зависеть от размера сайта: за простенький лендинг фрилансер возьмёт $20-30, тогда как клонирование крупных интернет-магазинов может стоить сотни долларов;

- Некоторые софтины по клонированию сайтов на сегодняшний день устарели. Тем не менее современные проги и онлайн-сервисы располагают широким функционалом — могут скачать сайт со всеми данными, включая динамический контент, CSS и т.д.

Зарегистрируйся, чтоб оставить комментарий

- По рейтингу

- По порядку

Сайт скопировали полностью! Что делать?

Воровством контента в интернете уже никого не удивишь. Бороться с этим бесполезно, остается только создавать скопированный контент заново, чтобы сайт не потерял (или же восстановил) позиции. С определением первоисточника у поисковых систем по-прежнему не очень, несмотря на попытки это исправить.

Мы сегодня рассмотрим случай, когда сайт скопирован полностью: и каталог продукции с ценами, и дизайн, и контакты.

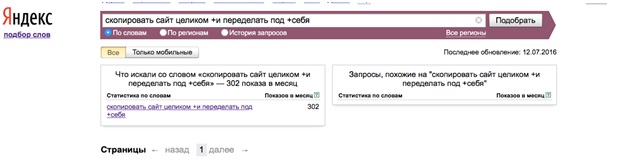

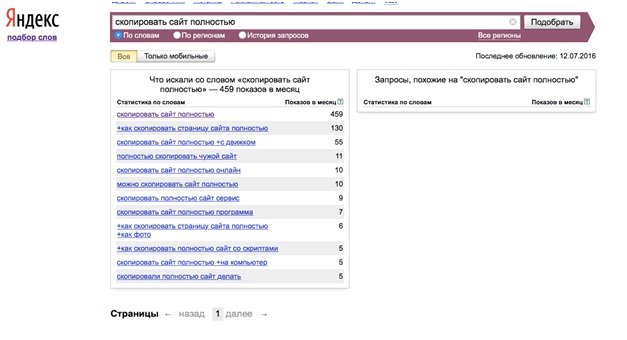

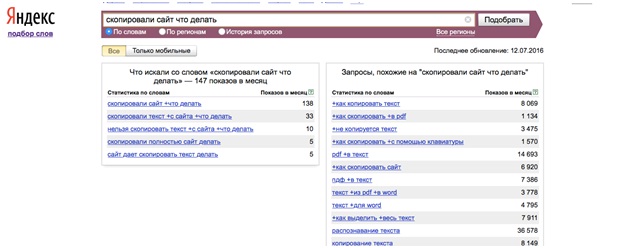

Как часто ищут «как скопировать сайт»?

При подготовке этого материала мы немного изучили статистику запросов wordstat.yandex.ru по теме.

Вот что получили:

Как видите, желающих скопировать чужой сайт и использовать его достаточно. Пострадавших, которые ищут ответ в интернете, немного меньше.

В этом материале мы расскажем, что можно сделать, если ваш сайт скопировали полностью, на примере двух сайтов наших заказчиков.

История 1. Сайт скопировали полностью, разместили свои контакты

Эта история о том, как мошенники скопировали сайт нашего заказчика и даже на этом заработали.

Шаг первый. Обнаружение.

Для решения проблемы нужно для начала ее обнаружить.

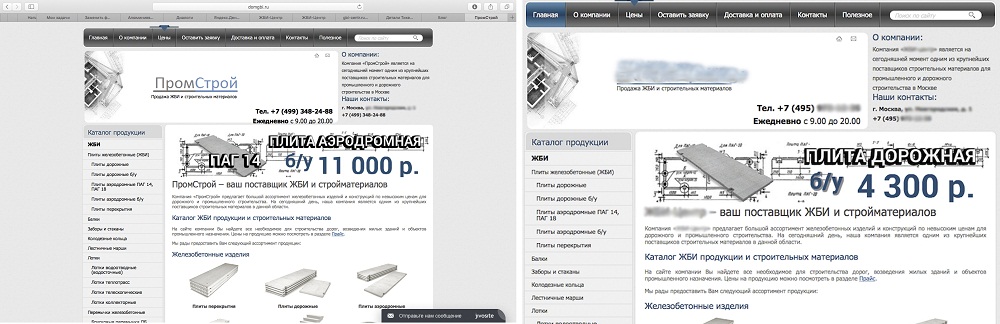

В начале июня мы обратили внимание на переход на opexu.com с домена domgbi.ru. При первом же взгляде на сайт стало понятно – полностью скопирован сайт нашего заказчика в тематике «ЖБИ-изделия».

На скриншотах слева – сайт-копия, справа – сайт заказчика.

Изменены только номер телефона и название компании.

При звонке по номеру телефона ответила юридическая компания.

Шаг второй. Письмо в техническую поддержку ПС Яндекс.

При любой сомнительной ситуации с сайтом необходимо написать письмо в техническую поддержку Яндекса для возможного прояснения ситуации. Как правило, вы получите стандартный ответ о том, что поисковая система не может влиять на сайты, размещенные в сети интернет. При этом, написать нужно, чтобы зафиксировать проблему и иметь аргументы при дальнейших проблемах с ранжированием.

Мы связались с техподдержкой Яндекса по поводу копирования сайта. Как и ожидали, получили стандартный ответ.

Поисковая система Яндекс автоматически индексирует информацию, размещенную на общедоступных ресурсах сети интернет, и формирует страницы с результатами поиска, которые на текущий момент являются наиболее подходящими для соответствующего запроса пользователя.

Отображая в результатах поиска ссылки на страницы, созданные третьими лицами, которые может посетить любой пользователь, мы не несем ответственности за содержимое этих страниц. Также мы не уполномочены разрешать вопросы о неправомерном копировании статей третьими лицами.

В случае если по какому-то запросу сайт с идентичным, на Ваш взгляд, текстовым контентом находится в результатах поиска выше Вашего, и именно Вы впервые опубликовали этот контент, то Вы можете помочь нам в работе над алгоритмами ранжирования с целью их улучшения в будущем. Для этого надо прислать пример такого запроса в ответ на это письмо. Если же Ваш сайт показывается на более высоких позициях в поиске Яндекса, то присылать пример запроса не нужно, мы не сможем использовать эту информацию в дальнейшей работе.

Шаг третий. Мониторинг индексации и ранжирования сайта-копии

Спустя некоторое время сайт-копия проиндексировался поисковыми системами и начал искаться по некоторым запросам (сработала наша оптимизация, т.к. оптимизированные элементы страницы и контент также были скопированы).

Вскоре к нам обратился заказчик с просьбой о помощи: владельцы сайта-копии выставили счет покупателю на поставку продукции. Покупатель счет оплатил, продукцию не получил. Номера телефонов на сайте перестали отвечать. К нашему заказчику обманутый покупатель обратился, так как совпадал адрес офиса и склада компании. Его мошенники менять на скопированном сайте не стали.

Нужно было срочно что-то предпринимать.

Шаг четвертый. Связаться с хостингом, на котором находится сайт копия

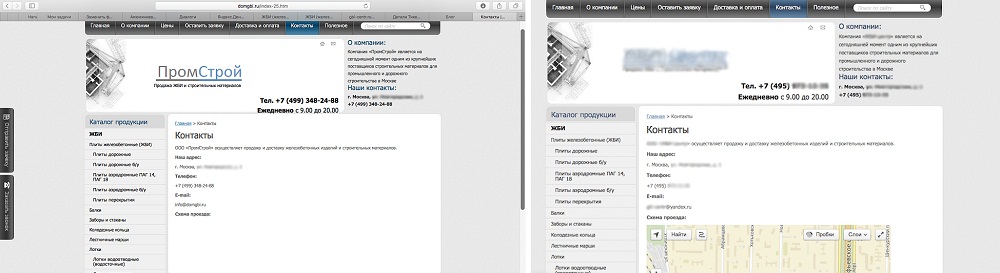

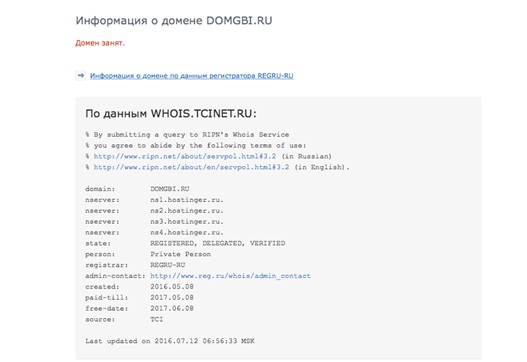

С помощью сервиса nic.ru легко определить, где лежит сайт.

Видим, что сайт лежит на хостинге hostinger.ru.

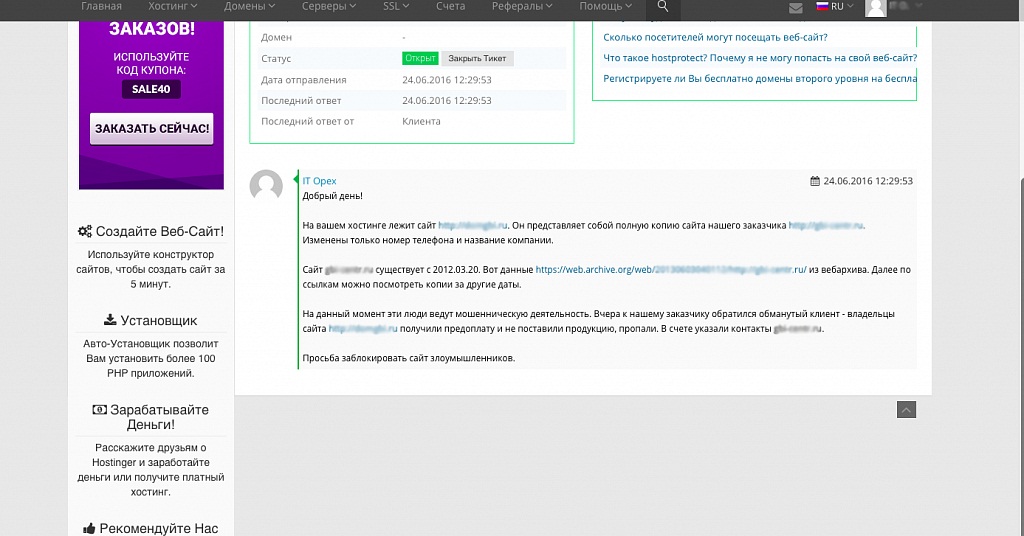

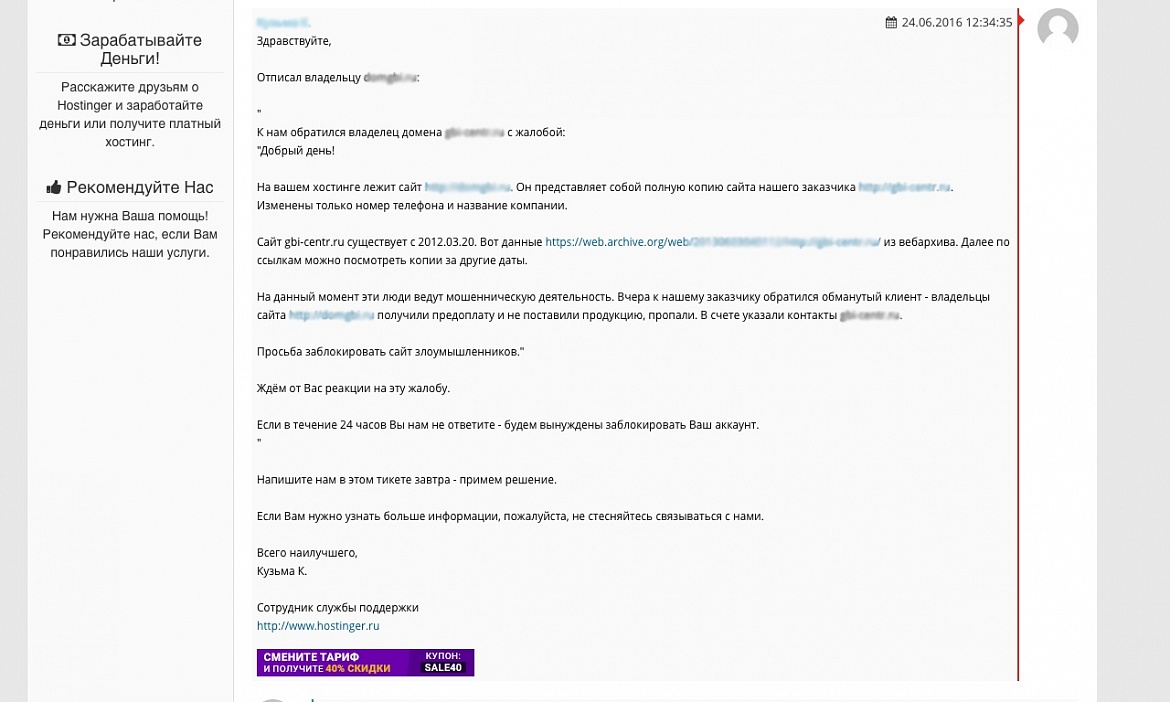

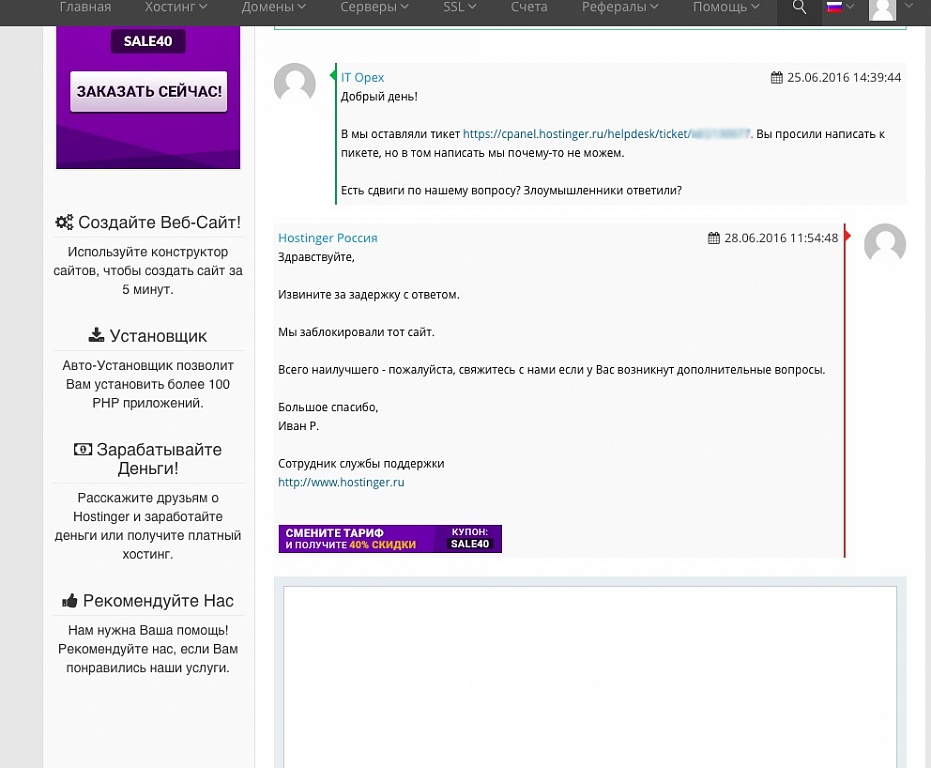

Мы связались с технической поддержкой хостинга, подробно описав ситуацию, а также противозаконную деятельность лиц, скопировавших сайт.

Техническая поддержка хостинга отреагировала очень быстро.

Спустя 4 дня мы получили следующий ответ:

На данный момент сайт, который представляет собой полную копию сайта нашего заказчика, заблокирован.

Эта история закончилась хорошо. Попался добросовестный и ответственный хостер, который пошел навстречу.

Компания http://www.hostinger.ru, большое вам спасибо!

История 2. Сайт скопировали полностью, включая контакты

Вторая история также связана с тематикой ЖБИ, как это ни странно. Наш заказчик обратился к нам с просьбой разобраться с сайтом-копией.

Шаг первый. Обнаружение

Эта копия никак не мешала продвижению сайта, так как почти не индексировалась поисковыми системами и существенно устарела, так как была сделана до начала нашего сотрудничества. Заказчик нашел ее в поиске по картинкам.

На сайте копии были размещены контакты нашего заказчика. Для каких целей она создавалась было не совсем понятно. Можно было бы предположить, что копию сделали для продажи ссылок, но и их не было.

Вероятно, что копию сайта сделал какой-то специалист, чтобы показать, что он это может.

Шаг второй. Письмо в техническую поддержку ПС Яндекс

На написанное письмо мы получили рекомендацию обратиться к хостинг-провайдеру для блокировки сайта.

Шаг третий. Мониторинг индексации и ранжирования сайта-копии

В индексе ПС Яндекс присутствовало несколько страниц сайта. Сайт практически не участвовал в поиске.

Шаг четвертый. Связаться с хостингом, на котором находится сайт копия

Мы путем, описанным в предыдущей истории, выяснили расположение сайта и связались с технической поддержкой хостинга.

Хостинг отказал нам в блокировке сайта, потребовав юридические документы, подтверждающие права на дизайн и контент данного сайта. Сайт заказчика был создан в 2009 году, когда о юридической стороне создания сайтов и авторском контенте даже никто не думал. Поэтому вариант с хостером провалился.

На нашу удачу у этого домена были открыты контакты владельца домена. Если бы они были закрыты, думаем, можно было бы обратиться к доменному регистратору и постараться получить какую-то информацию.

Владелец домена дал нам контакты другого человека, который владел этим сайтом-копией на данный момент. Тот после переговоров пошел нам навстречу и удалил сайт. Сайт был ему, действительно, не нужен, и сделан давно ради эксперимента.

Выводы

Каждая ситуация, связанная с копированием сайта, индивидуальна.

Методы борьбы существуют, но при этом гарантии на положительный исход нет.

Если вы обнаружили копию своего сайта – обратитесь к своему подрядчику, который занимается продвижением ресурса, за помощью.

Если вы занимаетесь сайтом сами, вам могут помочь меры из нашей статьи.

Как защитить свой сайт от копирования?

- Программы, защищающие от копирования. Стали появляться программы и сервисы, защищающие от копирования как контент сайта, так и сайты от скачивания. При этом, есть опасность проблем с индексацией сайта.

- Использовать на сайте в некоторых разделах абсолютные ссылки (ссылки с адресом домена), чтобы оперативно обнаружить сайт-копию с помощью обратной ссылки.

- Юридическая защита. Регистрация авторских прав на дизайн сайта, программный код и доменное имя. Это позволит вам обращаться к хостеру и на законных основаниях требовать блокировки сайта-копии.

На этом все. Если у вас возникли вопросы, пишите нам в комментариях. Чтобы предложить тему для статьи, жмите на баннер справа.

Иллюстрации к статье:

Фрагмент фильма «Зеркала» («Mirrors», 2008), скриншоты из wordstat.yandex.ru, фрагменты переписки с технической поддержкой хостинга.