Собираем недорогой NAS своими руками для дома и семьи

В отдельном ролике подробно было разобрано, что такое NAS, какие у них бывают характеристики, за что отвечают различные фишки и зачем оно вообще такое надо. Вот видео:

В комментариях резонно замечали, что проще и дешевле собрать NAS самому на базе обычного компьютера. В этом есть смысл как минимум экономический — нынче готовые сетевые хранилища стоят очень даже не мало. Поэтому сейчас будем собирать сетевое хранилище «на минималках»: функциональное, но очень бюджетное.

Главные параметры компьютера под NAS для дома

Если и собирать сетевое хранилище на базе компьютера, то не первого попавшегося, а правильного.

- Процессор (или чипсет материнки) со встроенной графикой . Если избавимся от дискретной видеокарты, то избавимся и от лишнего вентилятора на ней вместе с шумом. Да, можно собрать NAS без видеоадаптера вообще, но не факт, что любая старая материнка будет готова запускаться в таком режиме.

- Приоритет материнским платам малого формата, желательно mATX или mini-itx. Чем крупнее материнка, тем обычно кучерявее чипсет, чтобы вывести всевозможные разъёмы на мать. В нашем домашне-бюджетном случае это излишне.

- Твердотельные конденсаторы на материнской плате. На моей памяти, твердотельники начали ставить со времён DDR3, то есть уже в начале 2010-х. Нет ничего плохого в обычных электролитах, просто твердотельные конденсаторы видятся более надёжными.

- Наиболее низкий TDP процессора. Выбирайте самые холодные процессоры из линейки. Селерон вместо пентиума, атлон вместо ряженки и т.д. Производительность процессора в сетевом хранилище не очень-то важна, а вот теплоотдача существенна.

- Серверное оборудование идёт нахер! Просто поверьте, серверные решения очень шумные, особенно стоечные, особенно 1U. Пересмотрите видео выше: там практически в самом начале включают стоечный сервер и да — он реально так гудит.

- Охлаждение строго 4-pin вентиляторами. Это те самые, что умеют подстраивать скорость автоматически. Не факт, что такие вертушки будут в купленном компьютере, но если материнка не поддерживает 4-pin, это проблема.

- Больше SATA-портов! Допустимый минимум — 4 порта (один на системный диск, два под накопители), хотя можно обойтись двумя (если грузить систему с USB-флешки). Идеальный вариант — 6 портов.

- Гигабитный ethernet на плате. Это вообще-то не проблема, потому что гигабитные сетевые карты на платах ставятся уже лет пятнадцать.

- Больше жёстких дисков разумного объёма. Если есть возможность взять пару одинаковых — хорошо, можно их задействовать под зеркальный RAID-массив для надёжного хранения данных. Но ещё лучше, если дисков будет больше двух. И необязательно одинаковых.

Какие диски выбрать для NAS

Так как мы договорились собирать бюджетное домашнее сетевое хранилище, то и диски должны быть бюджетными и домашними. Не обязательно переплачивать за оптимизацию под RAID или NAS, брать самые вместительные или самые быстрые. В домашнем сетевом хранилище диски не должны быть качественными и дорогими — они должны быть объёмными и бюджетными. А это как раз домашний сегмент, а не SOHO и не энтерпрайз. У каждого производителя дисков есть «домашняя» серия: у Western Digital — blue; у Seagate — Barracuda; у Toshiba — P300. Подробнее про специализацию дисков рассказано в ролике.

Сколько дисков нужно для домашнего сетевого хранилища

Всё зависит от конкретно ваших желаний но я рекомендую минимум три. В статье про архивацию данных я предлагал мыслить категориями уникальности, а теперь предлагаю на эти категории наложить слой критериев используемости. Вот и получается три диска:

- Первый диск может быть не самого большого объёма — на нём должны храниться все данные, которые очень ценные для вас. Большую часть времени этот диск будет простаивать, потому что…

- Второй диск должен быть среднего объёма — именно на нём будет храниться вообще вся информация, как уникальная и ценная, так и не очень важная. Именно сюда будут качаться торренты, именно здесь будут общие ресурсы на чтение-запись, именно этот диск будет впухать в первую очередь (и, скорее всего, именно он первым выйдет из строя). Но это не страшно, ведь всё самое важное будет периодически архивироваться со второго диска на первый.

- Третий диск — самый большой по объёму. Главное файлохранилище больших объёмов данных, которые редко нужно изменять. Тут можно держать коллекцию фильмов и музыки, софта и прочего, что вы не планируете удалять. На этот диск придётся меньше операций записи, он будет почти read-only.

RAID или не RAID

С точки зрения домашнего пользования RAID-массив — это расточительство. Вы как бы переплачиваете за большее количество дисков, а пользуетесь меньшим пространством. Конечно, если дисков достаточно много, то можно настроить зеркальный RAID с первым диском, чтобы ещё лучше защитить ценную, уникальную информацию. А можно добавить ещё один диск и настроить зеркало уже со вторым, основным. А дальше — вообще забубенить зеркала на всё, что можно, но это уже не совсем бюджетно и точно не по-домашнему. Так что если выбирать между RAID или не RAID — я предлагаю RAID. Но если дисков мало и душит жаба — можно обойтись периодической архивацией. А если ценных данных нет — можно и не архивировать.

Что лучше для NAS: Windows или Linux

Последний пункт в сборке конфигурации — определиться с системой, на которой всё это будет работать. Linux менее удобен для неподготовленного пользователя, но систему можно установить на флешку и сэкономить на системном накопителе, а ещё освободить один SATA-порт. Windows даст больше возможностей, но и потребует значительно больше вычислительных ресурсов. Можно поднять NAS на системе постарше, хоть на Windows XP, но тогда встаёт вопрос безопасности данных и уязвимости NAS. Специализированные дистрибутивы Linux для создания NAS не имеют графического интерфейса, а вся настройка происходит через web-панель — для таких задач достаточно конфигурации «два ядра, два гига», а то и меньше. С другой стороны, я так и не смог заставить из консоли работать софт для записи оптических дисков и виртуализировать машину на Windows. Для себя я решил вопрос довольно просто: отдельный бюджетный NAS крутится на линуксе, отдельная машинка помощнее круглосуточно гоняет нужный мне софт под виндой. Ну а раз у нас дешёвый NAS, то настраивать будем Linux. Так и требования к железу будут поменьше, сильно поменьше.

Собираем недорогой NAS из компьютера

Материнская плата для сетевого хранилища может быть любой. Но лучше выбирать что-то, на чём никак нельзя собрать «современный мощщный игровой ПК» — такой утиль ценится меньше, комплектухи на него вагон за бесценок, но коллекционеров раритета это оборудование ещё не интересует. То есть это примерно эпоха LGA755 у Intel или AM2 у AMD. Мамки на DDR2 продаются нынче за бесценок, а производительности для домашнего NAS хватит. Можно бы даже рассмотреть времена DDR1, но в таком случае есть вероятность столкнуться с устаревшим поколением SATA-портов и более медленной работой дисков. Впрочем, если есть вариант урвать по дешману DDR3 или даже DDR4 — дерзайте! Это всё же оверкил для таких задач, но почему нет?

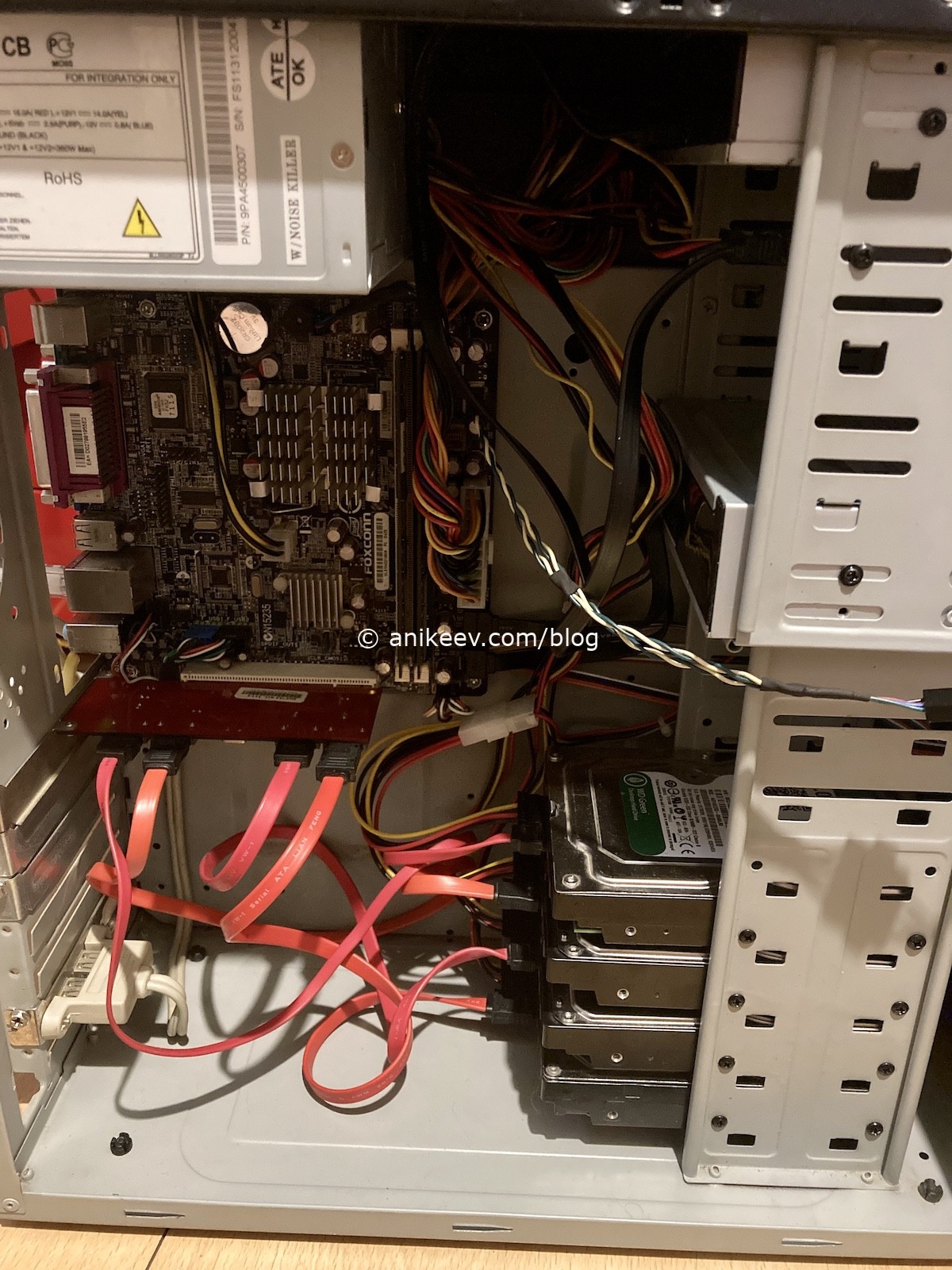

В качестве базы для сетевого хранилища я выбрал имеющуюся mini-itx плату от foxconn с несъёмным процессором Intel atom, двумя слотами под оперативную память стандарта DDR2 и двумя же SATA-портами на мамке. Из разъёмов — только самое нужное. Из интересного — один порт PCI и нормальное взрослое питание через колодку ATX, а не собственный проприетарный разъём, как у некоторых.

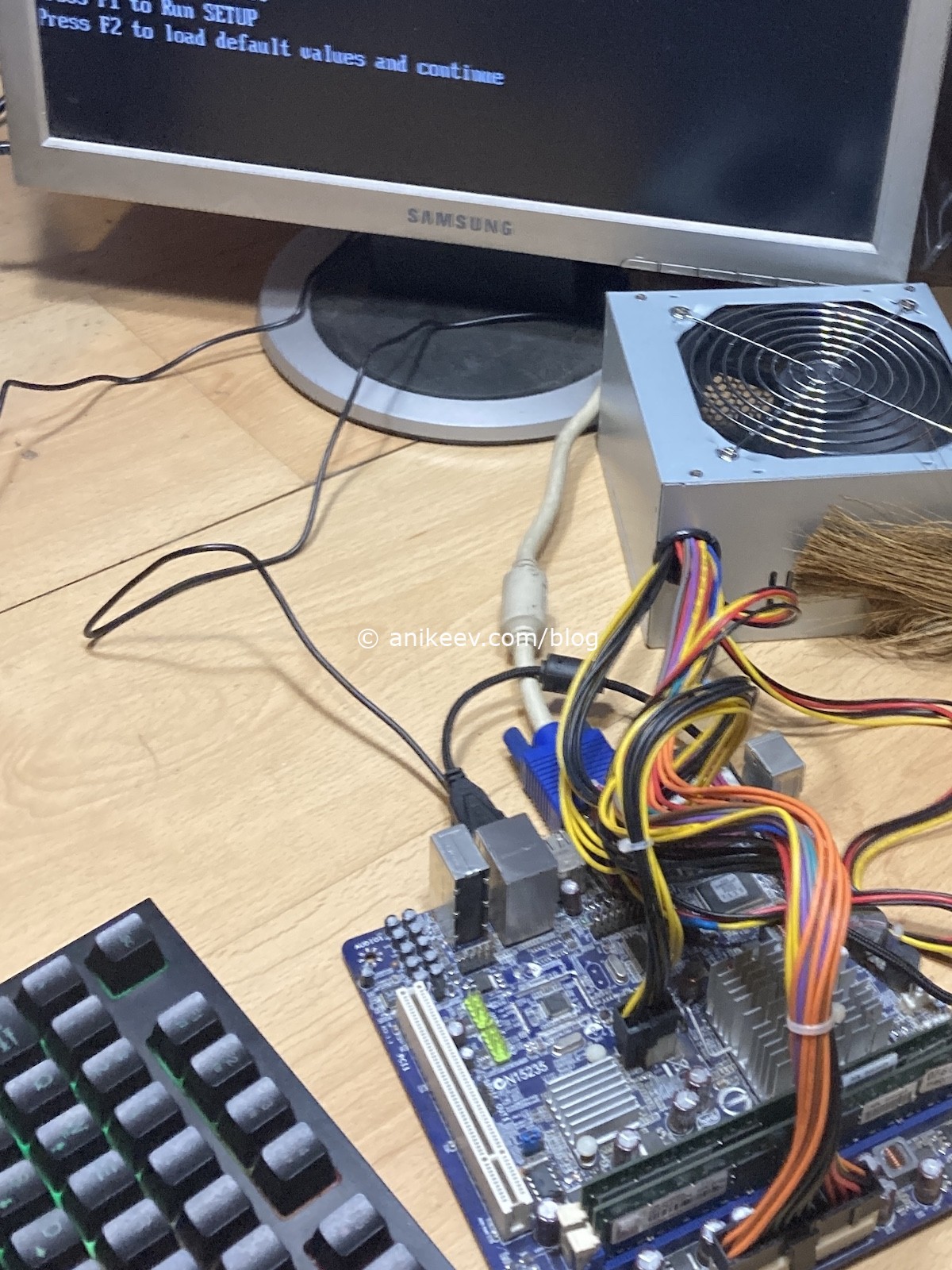

Процессор для сетевого хранилища должен быть холодным, многоядерным и 64 битным. Мне выбирать не приходится — Intel Atom D425 впаян в мать намертво.

Оперативная память для NAS должна быть набрана модулями одинакового объёма, частоты и таймингов, и занимать все слоты из возможных. В моём случае это пара модулей по 1 Гб. И да, 2 гигабайта для NAS — это нормально. Даже один гигабайт оперативки — для NAS нормально. А вот если бы ставили актуальную Windows — надо бы минимум 4 Гб. Кстати, если на материнке четыре разъёма — ещё лучше: можно взять модули меньшего объёма, чтобы получить нужное количество гигабайт. А это наверняка выйдет дешевле.

Охлаждение для NAS получилось нестандартное. Я не смог подобрать вентилятор подходящего размера под свой радиатор, так что сделал охлаждение из штатного воздуховода, вкорячив туда боксовый кулер от какого-то Intel, точнее вентилятор из этого комплекта — он на 4 контакта и управляется автоматически, что снижает общий уровень шума.

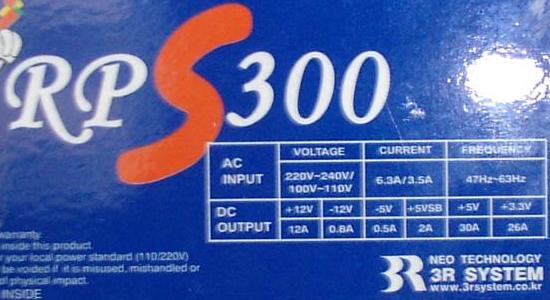

Блок питания для сетевого хранилища подойдёт вообще любой. Вполне хватит на 300 Вт любого офисно-китайского — такие блоки продаются за бесценок. Главное, чтобы БП был относительно свежим, если рассматриваете вторичку. Лучше взять безымянного блестящего китайца, чем потасканный годами бренд. Главное — чтобы вентилятор был побольше — он будет работать на меньших оборотах и издавать меньше шума.

Корпус для NAS тоже может быть любой. Желательно выбирать что-то из старых офисных моделей, где корзина под диски занимает всю переднюю часть и упирается в основание корпуса, а блок питания расположен с верхней стороны, на выдув. Внешние USB и аудиовыходы вам не понадобятся. Безвинтовые крепежи, салазки, корзины и прочее — не нужно. Ну и приличный внешний вид не помешает. Обращайте внимание на кнопки включения и индикацию — светодиоды не должны быть сильно яркими, а кнопка включения желательна побольше.

Тут можно столкнуться с мнением, что корпус для сетевого хранилища должен быть очень компактным, стильным и красивым. Если вы не готовы собирать NAS в обычном корпусе — не выделывайтесь и дуйте в магазин за готовым NAS. Нестандартный корпус будет не самым бюджетным, под него потребуется определённое железо, а если в ходе эксптуатации что-то из электроники сдохнет — будут проблемы. Унификация — наше всё!

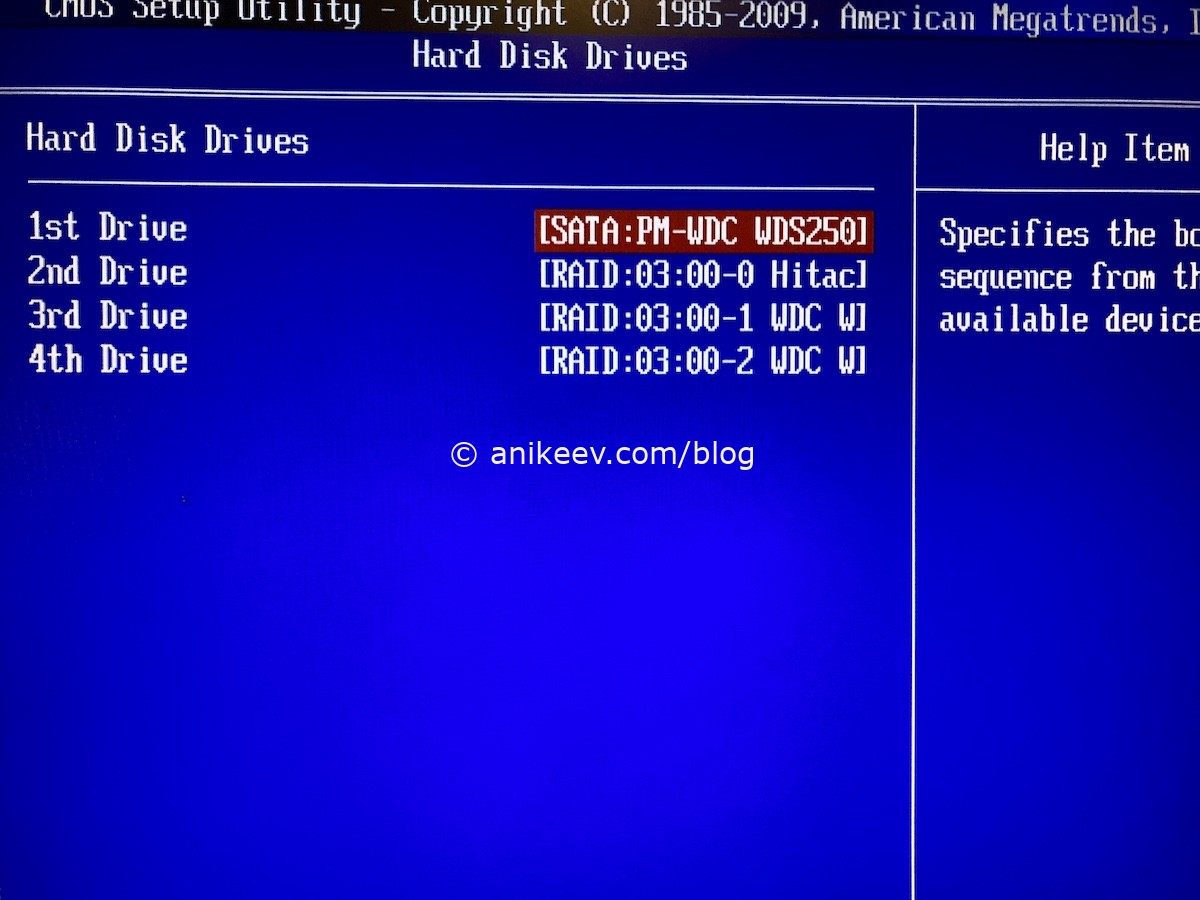

SATA-контроллер для NAS я вкорячил ровно по двум причинам. Во-первых, у меня был контроллер. Во-вторых, было желание подключить под хранилище сразу четыре диска (они тоже были), а на мамке было всего два SATA. Сата-контроллер позволит помимо прочего создать аппаратный RAID-массив, который любой системой дальше будет видеться как единое пространство. Я НЕ РЕКОМЕНДУЮ делать аппаратный RAID. Если контроллер сдохнет — придётся искать точно такой же, шансы спасти данные будут ниже. Обычный программный, soft-RAID подойдёт лучше. И да, несмотря на то, что диски нормально определяются и контроллером и в биосе — не желательно грузить систему с диска, который подключён в контроллер — используйте тот, что подключен к материнке.

Жёсткие диски для сетевого хранилища я использовал те, что у меня были. А именно, пара дисков на 2 Тб для важных данных в зеркало, один диск с протухшим смартом (S.M.A.R.T. — self-monitoring, analysis and reporting technology ) на 2 Тб для неважных данных в формате read-only и ещё один на 1 Тб для повседневного использования.

По дискам ещё важный момент — отсутствие вибрации. Решайте этот вопрос как хотите: ставьте уплотнительные резинки, салазки, подвешивайте диски на верёвочке. Или изначально выбирайте такие, которые не гудят при работе.

Последний шаг: настройка материнки для NAS

Перел тем, как приступить к установке системы и настройке NAS, установим в настройках BIOS нужные опции:

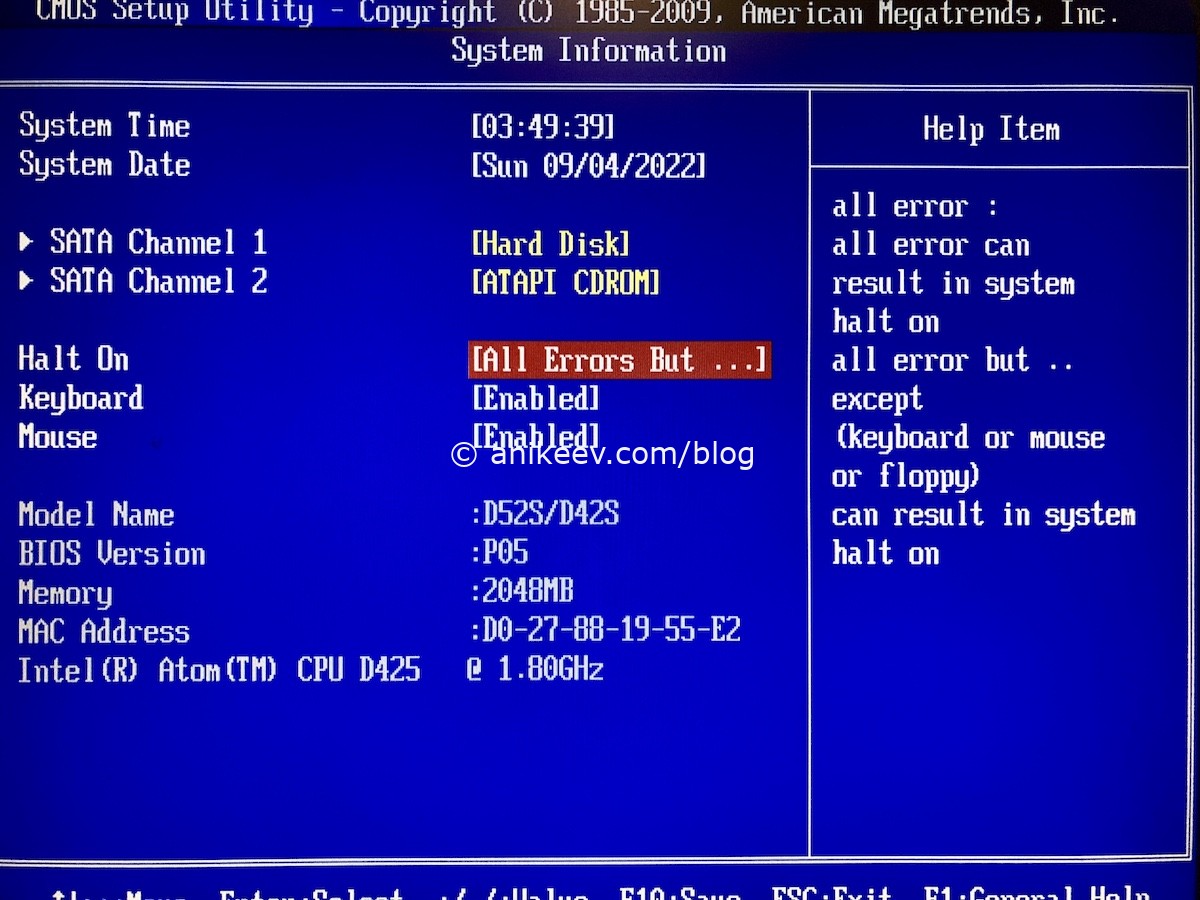

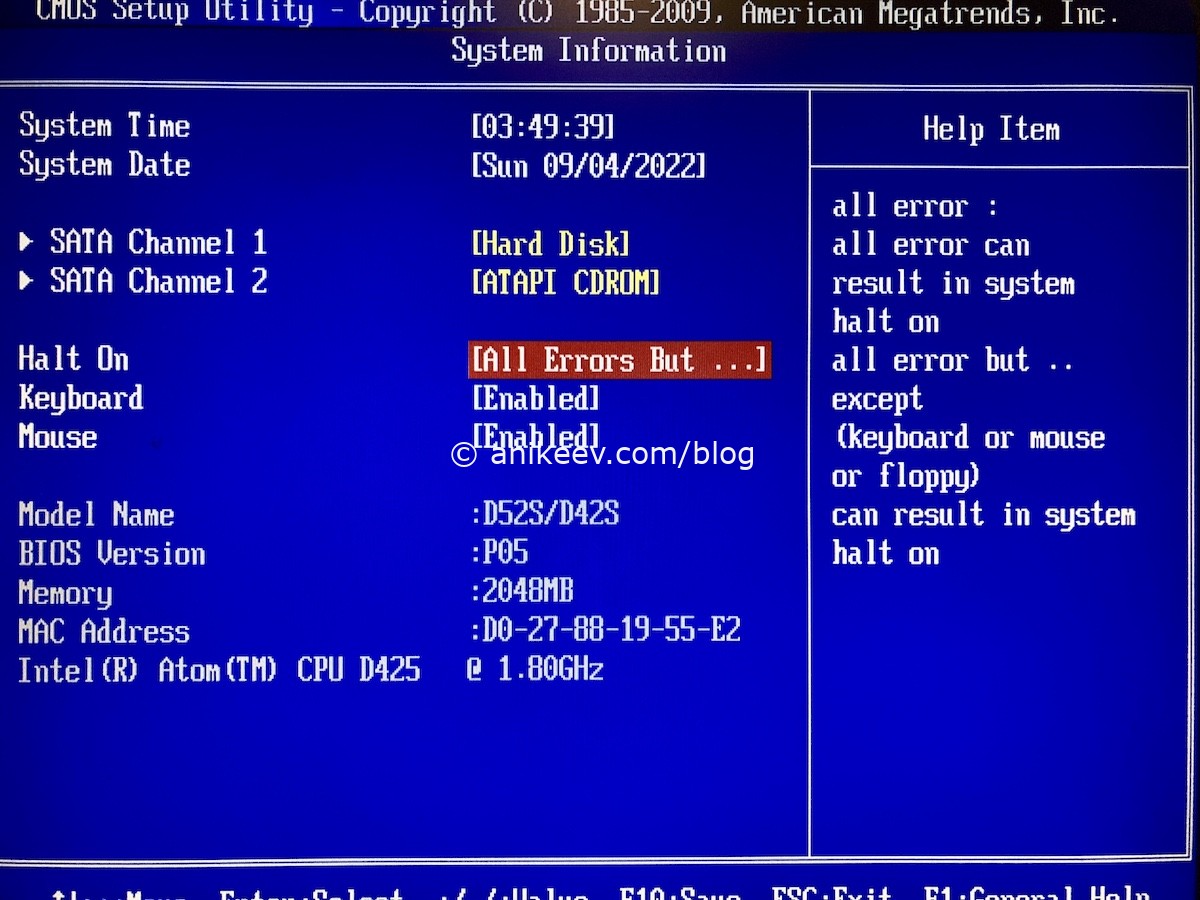

- Halt on errors = NONE — опция Halt on не позволяет плате грузить систему при возникновении некоторых ошибок, типа неподключенной клавиатуры, отсутствующего монитора и прочего. Эта опция обычно включена в режим All, что для нормального компьютера вообще не проблема. Но нам бы надо заставить включаться компьютер только с подключённым кабелем питания и сетью, без всего остального. То есть надо переключить опцию в режим None. Не во всех платах есть возможность отключить проверку на ошибки полностью, так что будьте внимательны.

В моём случае опции NONE не было, но была возможность отключить проверку наличия клавиатуры и мыши. Я отключил проверку, чтобы система грузилась в любом случае.

Внимательно читайте подсказки, название опций может отличаться. Например, у меня в режиме Enabled (Включено) происходит буквально «включать игнор на периферию».

- Restore on AC power loss = Power on — параметр Restore on AC power loss задаёт поведение компьютера при подаче электропитания после отключения. В нашем случае нужно выставить Power on, чтобы самосборный NAS включался сам после отключения электроэнергии и при её возвращении. Как вариант можно выбрать опцию Laststate, что переводится «делай, как было». Это удобный вариант для редкоиспользуемых сетевых хранилищ: в случае установки значения Last state NAS включится после перебоя с энергией только если и до него он работал, а если был выключен — так выключенным и останется.

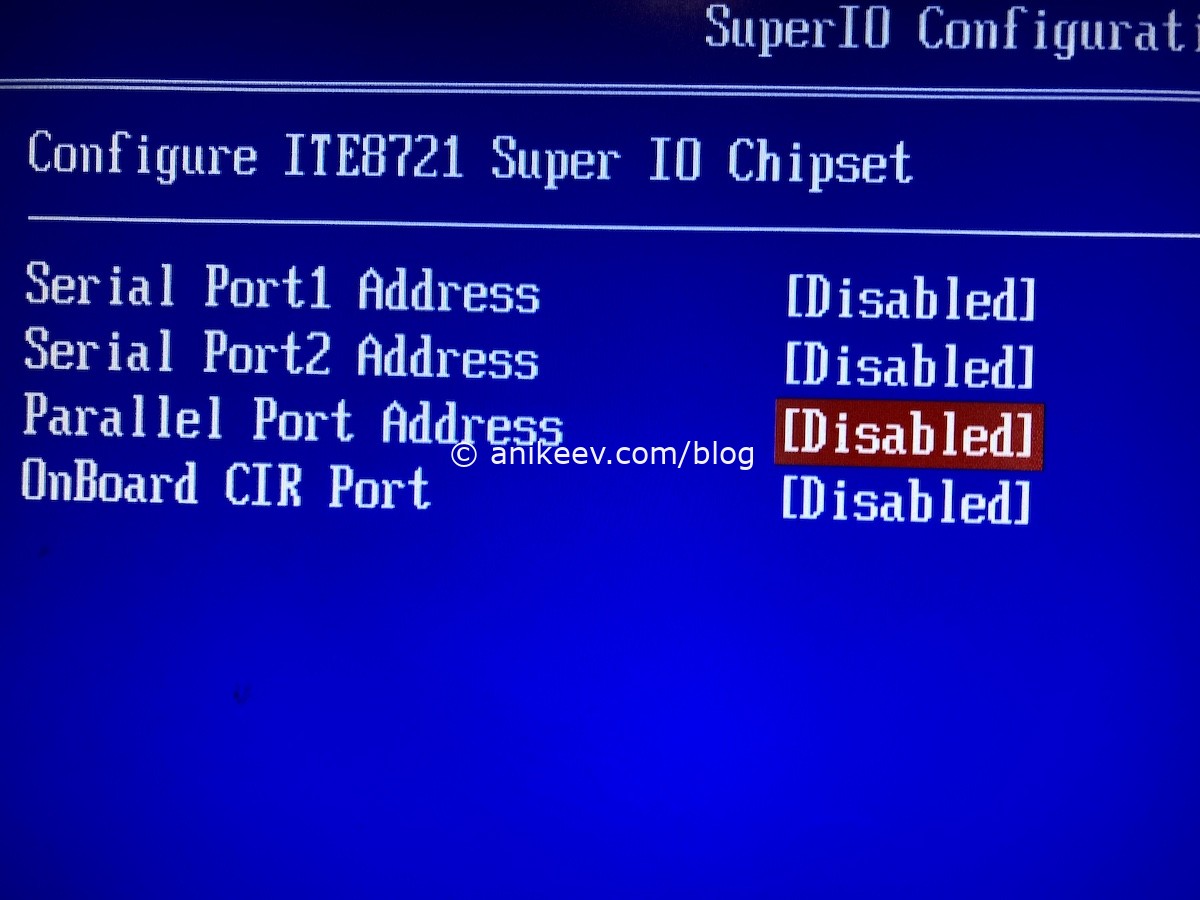

Остальные параметры можно менять (или не менять) по необходимости. Например, можно включить для отдельных SATA-разъёмов опцию горячего отключения, чтобы извлекать диск не завершая работу компьютера (сделал так на виндовой машинке). Можно отключить USB-порты, неиспользуемые контроллеры типа COM, Floppy и LPT, жёстко задать загрузочный накопитель и до кучи запаролить вход в биос, чтобы никто ничего не поменял.

В свежих материнках можно поиграться с кривыми оборотов вентилятора, чтобы охлаждать лучше и тише. Все эти настройки опциональны, а мастхэва ровно два: уметь включаться после потери питания и уметь включаться без подключённой периферии.

Всё, мы собрали NAS и базово настроили само железо. Следующий уровень: установка софта, в моём случае — OpenMediaVault или коротко OMV.

Смотрите также

- Мод платы MSI H410M-A PRO: ставим держатель под батарейку BIOS

- Что такое RAID 0 и зачем он нужен

- Внешний SSD Adata SE760 становится внутренним: как разобрать и использовать?

- Измельчитель пищевых отходов, он же диспоузер: будущее наступило, пора его принять

- Вторая жизнь старого блока питания ATX — можно ли его использовать в новом компьютере?

Бюджетный сервер для обучения нейронных сетей

Всем добрый день. В этой статье я расскажу как собрать сервер для обучения нейронных сетей и сэкономить кучу денег.

Спойлер, сэкономлено почти 400 000 рублей.

Немного предыстории.

Я много лет занимаюсь наукой и стартапами. Последние несколько лет я делал проект в сфере аналитики международных финансовых рынков на базе нейронных сетей (В связи с развалом международной оплаты его пришлось прикрыть, если кому-то интересно, и сейчас я его разворачиваю в другую сторону. Но написать я хочу не об этом). Кому интересно, можете прочитать статьи здесь.

Проблематика проектов такова, что развиваясь я неизбежно пришел к работе с большими данными. Легко некоторые датасеты стали достигать под сотню гигабайт, и обучать их на обычном дектопе стало затруднительно.

Если посмотреть в сторону облачных решений, то все они стоят как крыло от боинга.

Не в рамках рекламы, а в рамках примера я приведу сервис:

На момент написания статьи она стоит 7200. Упал доллар к рублю, стало дешевле.

В качестве аналога можно привести:

Материнская плата Supermicro MBD-H11DSI-O Socket SP3 16xDDR4 2xPCI-E 16x 3xPCI-E 8x 10 EATX Retail.

Цена: 57 тысяч рублей.

Серверная материнская плата ASUS Z10PE-D8 WS.

Цена: 59 тысяч рублей.

Итого, сэкономлено 45 тысяч рублей.

Здесь я скажу ДВА очень важных момента, на которые вы должны обратить внимание.

Если вы будете покупать подобные платы, то осознавайте её размер. Об этом я дополнительно скажу ниже.

Например, размер этой платы 33 на 30,5. Заявляется EATX, что в принципе правда. Но ей нужен ООЧЕНЬ большой корпус, желательно EEATX.

Смотрел по соотношению цены и характеристик. Взял топовый по производительности, но хороший по цене.

То E-ATX точно соотносится с тем, что заявляет производитель материнской платы: E-ATX305 × 330.

Однако, корпуса, которые заявляют поддержку E-ATX делают это опрометчиво. Я перепробовал несколько, ни в одну он не вошел.

Он поддерживает EE-ATX, и наверное в него войдет материнская плата, но подобные корпуса стоят 35к+.

Поэтому было принято решение купить самый большой корпус с поддержкой E-ATX и немного допилить его напильником, чтобы установить туда материнскую плату.

Был куплен: корпус Cougar PANZER MAX-G [106AMK0015-00] черный

Цена вопроса 12к. +30к экономии.

Для того, чтобы выпилить часть задней панели как на рисунке выше, а также для доработки мест крепления материнской платы был куплен инструмент: пилки для электролобзика, свёрла 2,5 мм, метчики М3, вороток. В качестве упоров для материнской платы использовались пластиковые скобы высотой 5 мм.

После удаления лишнего, материнская плата встала.

Упоры для крепления материнской платы дорабатывались как показано на картинке ниже.

Как итог, часть корпуса под материнскую плату после установки упоров выглядела вот так:

Для поддержки материнской платы сверху пришлось делать пластиковый прихват:

Тем не менее, всё отлично встало и работает:

Всё отлично работает.

Цена сборки (с учётом доработки): порядка 130 000 рублей.

Экономии 380 000 рублей, по сравнению, если закупать аналоги в России.

Под конец хочу сказать, что не призываю никого покупать на Алике. Следует понимать, что это риск в разных смыслах слова. + Качество. Каждый делает свой выбор сам.

Однако, в кризис порой не бывает выбора, и приходится искать решения.

Всем всех благ и успешного бизнеса.

12K открытий

58 комментариев

Написать комментарий.

Мам, это для учебы.

Развернуть ветку

К сожалению, аппаратного RAID для M2 SSD у меня сделать не удалось, поэтому пришлось довольствоваться программным через Windows.

К счастью.

/fixed

Когда развалится программный RAID — поматеришься, но восстановишь. А вооот когдааа развалится аппарааатный.

Развернуть ветку

Взял 2 XEON 2693v3 по 18 ядер на каждом.

Это Хасвелл почти 10 летней давности

Обращаю внимание на то, что данная память серверная. Она подойдет в х99, но не подойдет в обычные компьютеры.

Все Ryzen поддерживают ECC. Как минимум часть плат ASRock поддерживает комбинацию ECC + Ryzen. Но в целом это конечно бессмысленно, т.е. память с ECC дороже.

Взял Taifast на 1800 Вт за 8,5к. В Росси такой мощности стоят порядка 55к.

Это унылое говно, а не блоки питания. У той же supermicro блоки питания под сервера с видюшками от 2 кВт, хотя можно 3 кВт+ купить. Но самое большое отличие в том, что у серверов два блока питания, если это не лезвие. Лезвия по-другому резервируют питание в случаях выхода из строя одного из блоков питания.

+ Видеокарта 3090 ti 450 Вт.

Не серверная видеокарта. И нужно понимать, что есть обучение, есть инференс. Надо смотреть на то что там с тензорными ядрами. Велика вероятность что в ваших задачах v100 скорее всего будут сильно производительнее 3090 ti.

SSD KingSpec 2 штуки по 512 Гб работают в RAID 0 для ускорения производительности. Обошлись оба за 8,5 к. В России за 2 можно отдать порядка 14к. +6к экономии.

Никогда не стоит использовать RAID0. Во-первых, это не надежно. Во-вторых, встроенные контроллеры обычно очень плохие по производительности. Смысла брать SSD и объединять их — нет. Если уж хочется RAID0, то надо брать внешний PCI-E контроллер, но с Intel могут быть проблемы. Лучше собирать коробку на AMD EPIC, у AMD PCI-E линий раза в 3-4 больше, чем аналогичных конфигурациях у Intel. Вообще любые конфиги на видеокартах типа A100 сейчас собирают на AMD из-за PCI-E.

Цена сборки (с учётом доработки): порядка 130 000 рублей.

Экономии 380 000 рублей, по сравнению, если закупать аналоги в России.

Это не экономия. Собрали +/- нормальный игровой комп со старыми процами, которые будут медленнее современных десктопных процов. Тем более SIMD инструкции в новых десктопных процах возможно превзойдут старые Xeon. Не могу оценить, т.к. нет десктопных вариантов и некуда их вставить. На сервер это все не тянет, скорее воркстейшен. Ну и я бы лучше брал б/у v100 все же.

Сборка домашнего сервера

Здравствуйте дорогой StopGame и его обитатели. В блоке введения я представлюсь и расскажу вам о том что сейчас будет происходить. Заодно поясню как я пришел к тому что стоит написать уже хоть что-то на своем любимом сайте.

Во-первых, несмотря на то, что на момент публикации этого блога моему профилю, с момента регистрации, стукнул день, я являюсь давним читателем сайта и естественно смотрителем канала (точнее каналов на ютуб), лайкаю каждый день выпуски инфактов, заглядываю на стримы и даже посмотрел историю серии Metroid. Но да, я не активный пользователь, я как тот парень из общего чата который никогда ничего не пишет, но все читает и в курсе всех мемов и тем. Пользуясь случаем передаю привет таким же людям как я, наверняка нас много.

Во вторых, я инженер. Писать тексты для меня не то что бы сложная задача, но слогом я владею хм… наверное не очень хорошо. Так что, извините заранее за косноязычность и грамматику.

В третьих, поводом написания этих строк послужила последняя «АМА» в которой старый и новый главред отвечали на вопросы, а точнее один из вопросов о том что StopGame нужны «железные» авторы. Нет я не напрашиваюсь в авторы, но стало интересно посмотреть на то интересна ли эта тема, хотя если о ней говорят сами главреды то наверное интересна, но как видите тему я выбрал именно серверную, а не сборку игрового ПК. Поэтому проверка будет максимально «хардкорная». Так уж совпало, что когда я слушал эту «АМА» я как раз перебирал свой домашний медиа сервер, поэтому мы собираем именно СЕРВЕР.

Весь блог я постараюсь построить на тонкостях сборки домашнего сервера, рассмотрю варианты и сценарии использования, а так же поделюсь парой советов. Блог рассчитан прежде всего для новичков и ничего не понимающих людей, поэтому некоторые моменты, особенно «парням в теме», могут показаться весьма очевидными, но это сделано намерено.

Со вступлением покончено, перейдем к главной теме… Какое же длинное однако получилось это вступление… простите.

Хотя я слукавил. В одном из выпусков инфакта, в этом году, Илья Шарифов поздравил меня с ДР, а значит под предыдущем выпуском комментарий я все-таки оставлял. Выпуск я сохранил на своем сервере =)

Терминология

Отсюда и далее я буду использовать определенный термины, а именно:

Дядюшка Али — этим емким термином буду обозначать китайские всеми известные магазины например ТаоБао или Алиэкспресс.

Металлоприемка — онлайн/офлайн барахолки типа авито, юла и прочих. Почему металлоприемка? Потому что там мы будем смотреть на в основном неликвидное железо, которое стоит копейки, никому не нужно, а нам очень сильно пригодится.

Справка для самых маленьких — в этих блоках буду пояснять весьма очевидные вещи, для совсем незнающих людей, так что если вы в теме, можете смело пропускать эти блоки текста.

Зачем оно мне надо?

Я думаю у многих в голове возник этот вопрос, зачем вообще нужен мне этот сервер? Что же, сценариев использования довольно много.

Во-первых, хранилище медиа контента для семьи. Это мой сценарий использования. Ваши родители смотрят свои сериалы/фильмы, дети свои мультики, жены/мужья свои, причем каждый делает это со своего устройства, например батя сидит на диване с матерью и смотрит кино, жена на кухне на планшете смотрит сериал, а ребенок за компьютером смотрит мультик. Для этих целей я использую сервер Plex. Отличный сервис который позволяет структурировать ваш медиаконтент.

Во вторых, общая файлопомойка доступная вам со всех устройств дома. Тем более она может быть защищенной от потери данных с помощью RAID. Сценарии использования думаю понятны. Для примера, вы сидите за компьютером, делаете какой-нибудь проект, решили полежать, взяли ноутбук, а ваш проект уже на сервере, не нужны флешки и прочие облачные сервисы.

Справка для самых маленьких

RAID бывает множества видов, как аппаратный, так и программный. Типов так же не один, но так как это простая справка, я опишу самый понятный принцип работы одного из типов. А именно зеркальный.

У вас есть два жестких диска, одинакового размера, закидывая файл на сервер, он автоматические сохраняется на обоих дисках. Зачем? Все просто, в случае поломки одного из дисков вы не теряете свой файл, потому что на втором жестком всегда есть копия. Все что вам останется это заменить сломанный жесткий диск на новый.

В третьих, личное облачное хранилище. По типу Яндекс диска или Гугл драйва, объём которого ограничен лишь вашими жесткими дисками. Правда если вы захотите пользоваться им вне вашей локальной сети вам потребуется статичный IP. Услуга у вашего провайдера интернета может быть платной.

Справка для самых маленьких

IP это адрес вашего компьютера в сети, к которому вы будете подключаться, но каждый раз когда вы перезагружаете свой роутер, этот самый IP меняется, поэтому и нужен статичный адрес. Проще говоря закрепленный за вами в сети IP, который никогда не поменяется. Почему это важно? Все просто, вот вы настроили свой облачный сервис, на телефоне в приложение прописали подключаться по такому вот адресу, перезагрузили роутер и вам придется проводить эту настройку заново, потому что адрес сменился.

В четвертых, совсем уж очевидное использовать сервер как хм… сервер. Например, можно поднять свой сервер майнкрафта и играть там с друзьями.

Сценариев использования на самом деле еще уйма, я же описал самые основные. Если вы придумаете что-то еще с радостью почитаю.

ОС

В качестве операционной системы мы будем использовать TrueNas core (бывший FreeNas). Эта операционная система абсолютна бесплатна, имеет кучу возможностей, большинство вообще покажется вам избыточными. Отличный веб интерфейс, где в пару кликов можно установить необходимый софт будь то описанный выше Plex или же NextCloud (облачное хранилище), QbitTorrent (пираты, поднять паруса!).

Впрочем, это не значит что вы должны использовать именного его, можете хоть на Windows делать сервер, зависит от ваших целей и задач. В этом блоге я не буду особо углубляться в выбор/настройку софта. Хотя подбор железа мы будем осуществлять под TrueNas core, существенной разницы (помимо пары нюансов) в вашем выборе не будет.

Материнская плата, процессор и оперативная память

Сразу оговорюсь, сборку я буду описывать для людей у которых нет целого гаража старых железок, если у вас такой есть, то можете конечно же использовать его. Я также не буду вам говорить БЕРИТЕ ЭТО И НИЧЕГО КРОМЕ ЭТОГО, просто дам основные наводки и критерии того куда «копать», особенно если вы новичок в этом деле.

Intel (R) Xeon (R) CPU E5-2650 v2 и материнская плата Atermiter X79 Turbo + 32gb оперативной памяти. Мой выбор. На его основе и буду делать пояснения по выбору.

Зелененькая и даже с подсветкой. Ну как такую лапу не купить?

Начнем с процессора, почему этот? Ответ тут прост, цена. Дядюшка Али дает нам возможность покупать такие процессоры по «касарю» и меньше, а бонусом к этому идет то, что у материнских платах под Socket серверных процессоров Xeon довольно часто встречается по 4 разъёма для планок оперативной памяти, а так же возможность подключать серверную память, которая стоит по «касарю» у Дяди Али. Так же процессоры Xeon несмотря на свою цену довольно мощные, в дебрях ютуба вы найдете не один ролик о том как кто-нибудь запускает Cyberpunk 2077 на них и получает вполне приемлемые FPS. В моем случае E5-2650 v2 был у меня уже на руках, поэтому я просто подобрал материнскую плату под него.

Справка для самых маленьких

Socket это гнездо в которое мы вставляем наш процессор. Он имеет обозначения типа LGA2011 v2, как в случае нашего E5-2650 v2 или AM3, AM4 для процессоров производства AMD. Поэтому если у вас на руках есть какой-нибудь процессор гуглите его Socket, и уже по нему начинайте поиск материнской платы. Если у вас есть материнка гуглите её сокет и ищете процессор который туда подойдет. Так же необходимо проверить поймет ли материнская плата «из коробки» ваш процессор. Возможны случаи когда необходимо обновление BIOS (программное обеспечение материнской платы), они редки, но все-таки бывают. Проблема тут в том что, чтобы обновить BIOS вам понадобится другой процессор который материнская плата сможет принять «из коробки», хорошо если у какого-нибудь друга найдется такой, но если не найдется то сами понимаете.

Процессор прежде всего будет использоваться при так называемом архивировании файлов на сервере. Как это происходит:

1. Вы загружаете файл на сервер.

2. Процессор начинает сжимать данные.

3. Вы скачиваете файл с сервера.

4. Процессор разархивирует эти данные.

TrueNas core делает это «на лету». Соответственно, если у вас есть какой-нибудь старый компьютер который вы будете использовать в качестве базы для сервера, функцию архивации на нем нужно будет выключать. Стоит так же добавить то, что разные данные сжимаются по разному. Видео плохо сжимается, текст хорошо и если вы планируете хранить на вашем сервере чисто фильмы, то каких-то невероятных объёмов сэкономить не получиться, а нагрузка на процессор останется. В этом сценарии использование архивации так же можно выключить.

Оперативная память очень важна, TrueNas core использует её для дедупликации данных. Минимальный объём оперативной памяти требующийся для стабильной работы TrueNas core 8гб. дедупликация будет «отжирать» по 5гб, за каждый 1тб. пространства жесткого диска. Например, вы хотите сервер с 2тб. под ваши файлы, для стабильной и хорошей работы вашего сервера потребуется 8гб для системы + 10гб для жестких дисков. Думаю теперь ясно зачем нужны 4 слота под оперативную память. Конечно всегда можно обойтись и без дедупликации. Тогда большие объёмы не нужны.

Справка для самых маленьких

Дедупликация автоматически удаляет дублированные блоки данных оставляя лишь один. Например, вы загрузили какую-нибудь картинку на ваше облачное хранилище, ваша супруга загрузила такую же картинку, сервер видит что данные дублированы и удаляет одну из картинок, но оставляет обоим пользователям доступ к ней. Так же я не спроста сказал «блоки данных» некоторые файлы могут иметь в себе одинаковые части, в этом случае дедупликация тоже срабатывает.

На самом деле это объяснение совсем уж на пальцах и не до конца точное, для более углубленного понимания процесса рекомендую это погуглить, я же описал чисто основной смысл.

Совет:

Не используйте одну плашку памяти. Да, вы можете купить сразу один модуль оперативной памяти скажем на 16GB и вставить его в один слот, но тогда вы лишитесь двух канального или в случае 4 слотов, четырех канального режима работы оперативной памяти. Разделив же 16GB на 4 планки оперативной памяти по 4гб. вы получите прирост производительности за счет того что процессор может обращаться к каждой плашке по отдельности распределяя нагрузку между каналами памяти.

Справка для самых маленьких

При покупке оперативной памяти не забывайте смотреть на обозначения её разъёма DDR2, DDR3, DDR4 и другие. Если на вашей материнской плате распаян разъем DDR4, то DDR2 память физически туда не влезет.

В сухом остатке можно сказать следующее. Чем мощнее вы соберете компьютер, тем эффективнее будете использовать пространство ваших жестких дисков. Если у вас в гараже пылиться старый компьютер, использовать его можно, но не забудьте выключить все эти надстройки в виде дедупликации и архивации данных.

У ребят в теме, я думаю, уже давно зреет один вопрос. Почему Atermiter X79 Turbo? Есть же просто Atermiter X79, нафига тебе это Turbo? Отвечаю, это же ТУРБО, а значит работает в 1000000 раз быстрее.

Жалкий Atermiter X79 без приписки TURBO.

Ладно, это шутка. Думаю вы уже поняли по красному кружочку на фотокарточке выше причину выбора Turbo. Количество SATA портов. У нашего «турбированного» образца их 6, а у обычного 4. Это довольно важный критерий выбора материнской платы. Количество жестких дисков которое вы сможете подключить. Чем больше, тем лучше. Если вы не доверяете Дедушке Али и его непонятным брендам типа HUANAN и Atermiter, а хотите собирать свой сервер на комплектующих от «нормальных брендов» и без доставок через пол мира, так же обращайте на количество SATA портов очень пристальное внимание. Даже если у вас всего 4 жестких диска на руках, есть вероятность, что вам захочется подключить больше. Ходят конечно слухи о картах расширения, но я таких зверей не встречал. Хотя картинки видел.

Справка для самых маленьких

SATA порт это разъем для подключения жесткого диска. При сборке вашего компьютера обращайте внимание на его версию. У Atermiter X79 Turbo есть два типа разъёма SATAII и SATAIII (зеленый сата3, черный сата2), да, они выглядят одинаково и к ним подключается один и тот же кабель, но пропускная способность у них разная. Поэтому подключайте более быстрые жесткие диски или SSD на SATAIII, а более медленные на SATAII.

Видеокарта

Тут все просто, любая.

Ладно не любая, критериев не так уж много, но они важны:

1. Разъем подключения к материнской палате. Да, знаю весьма очевидно, но когда вы пойдете на металлоприемку и по тегу «видеокарта» поставите цену от самых дешёвых до самых дорогих вы можете увидеть в начале списка динозавров на AGP. Обращайте на это внимание. В моем случае разъем на материнской плате PCI Express, соответственно карту выбираем выбираем с таким типом подключения. Вы же выбираете под тот разъем который у вас.

2. Разъем подключения к монитору. Скорее всего, если у вас не старый монитор, то там HDMI. Да всегда можно докупить переходник например с DVI, но оно вам нужно? В прочем если цена на видеокарту будет особенно «вкусной» то можно и с переходником.

3. Не такой критичный критерий выбора как первые два, но все же. Пассивное охлаждение. Проще говоря, отсутствие вентилятора на карте. Это прежде всего не создает шума и страхует вас от поломки кулера. Кусочек железки прикрученный к плате сломать весьма проблематично.

Видеокарта вам потребуется только для первоначальной установки программного обеспечения, делать это без монитора немного сложновато =).

Если ваш процессор имеет встроенное видео ядро можно обойтись без видеокарты.

Охлаждение и блок питания

Не буду особенно подробно останавливаться на этом пункте, отмечу лишь пару нюансов.

В случае если вы решитесь пойти по моему пути LGA2011 обратите внимание на то что не каждый куллер подойдет под этот сокет. Есть варианты, что добрый Дядюшка Али положит вам переходное кольцо для крепления. Или не положит, тут уж как повезет, в любом случае при выборе куллера смотрите на поддерживаемые им сокеты.

Совет:

Всегда старайтесь подключать ваши корпусные кулеры к материнской плате, а не к блоку питания напрямую. Подключив их напрямую, они будут молотить всегда на 100% скорости создавая кучу шума. Используйте реобас, в случае если на материнской плате нет разъёмов или если она не умеет регулировать скорость вращения кулера, он позволит вам «подкручивать» скорость вращения кулеров делая компьютер тише.

Dexp CR-6025U добавит в вашу систему картридер, а двумя крутилками по бокам вы можете настроить скорость вращения ваших вентиляторов.

Блок питания берите новый! Чем больше у него систем защиты, тем лучше. Сервер предполагает работу 24/7 поэтому количество ситуаций когда он может принять на себя скачек напряжения и прочие ужасы жизни, кратно возрастают, в отличие от ПК который вы включили на пару часов поиграли и выключили.

Еще одним критерием выбора блока питания количество разъемов 15-pin SATA, которые будут питать ваши жесткие диски. Больше и есть запас? Наш выбор! Если не хватает, есть переходники с Molex на SATA, стоят копейки, можно использовать их.

Жесткие диски

Выбор жестких дисков полностью зависит от вашего кошелька. Да банально, но это факт. Денег мало? Идем на металлоприемку и покупаем все что плохо лежит. Денег много? Идем в магазин и покупаем Seagate Exos X16 на 10тб за 36 тысяч рублей.

Нюансов тут не так много, прежде всего как и в случае с видеокартой держим в голове факт, что не все жесткие диски имеют SATA разъем. Смотрите внимательно на это при покупке.

Есть так называемые «серверные» жесткие диски, как например все тот же Seagate Exos X16, отличие от обычных? Все банально, они рассчитаны на работу в серверах. Если совсем просто, дольше живут, но и стоят дороже. Покупать их или нет зависит от ценности и важности того что вы будете хранить на своем сервере. Супер ценная инфа? Берем серверные жесткие диски и объединяем их в RAID. Сериалы, потеря которых пройдет безболезненно? За 500 рублей с металлоприемки живой образец походит.

В случае использования TrueNas core нужно будет купить 2 жестких диска. Потому что, тот диск на котором стоит система будет вам не доступен для хранения файлов. В моем случае я использую старый жесткий диск из Playstation 3 на 80гб. под систему и 4 диска под хранилище. Да, объём системного диска не сильно важен, образ системы весит 1гб. поэтому ставить систему на крутой «терабайтник» смысла нет. Можете использовать SSD от Дядюшки Али, минимального объёма, система будет загружаться быстрее, а денег особо много тратить не придется.

Немного о программах

Как я и говорил много букв назад, я не буду рассказывать вам о том как установить/настроить софт (это тема для отдельного большого блога), но думаю, для понимания сценариев использования такого сервера будет полезно привести пару примеров.

SMB и AFP. SMB это протокол общего доступа к диску. Включаете его и на любом компьютере вашей сети появляется сетевой диск который будет доступен как обычный диск в «Мой компьютер». AFP это аналог от Apple. Диски которые будут доступны по этому протоколу можно использовать в качестве TimeMachne (пользователи Mac думаю знают что это и зачем).

Демонстрация папки SMB, как видите, проста папка, ничем не отличающаяся от обычных. Ну и да, чё пацаны, аниме?

Nextcloud это плагин который позволит вам организовать свое облачное хранилище. Доступ к которому вы можете получать из приложения на телефоне или браузера. Я его пробовал пользовать, но как-то он у меня не прижился. Если вы используете Яндекс диск (или аналоги), но не хотите доверять ваши файлы яндексу, то почему нет? Тем более вы будете свободны от подписок если вам нужны большие объёмы.

Вот так вот выглядит вкладка плагины в TrueNas core. Все просто, понятно и на русском.

QbitTorrent, что тут скажешь, это торрент в браузере. Зачем? Ну вот вы лежите с планшетом на диване, хотите посмотреть кино, его надо скачать, подниматься с дивана и идти к компьютеру не хочется, открываете браузер на планшете, заходите на торрент, качаете оттуда заветный файлик, переходите на сайт вашего торрента, закидываете туда файл, ставите флажок загружать последовательно. Вуаля, фильмец уже на сервере, Plex его увидел, можно смотреть пока оно качается.

Торрент в хроме! Во до чего эти ваши технологии дошли!

Plex это ваш домашний онлайн кинотеатр. Почему именно Plex? Его приложение можно установить на любую микроволновку, телефон, телевизор, ТВ приставку. Естественно есть и Web интерфейс. Поддержка субтитров так же в наличии.

Plex это не просто каталог безликих файлов, он автоматически подгружает основную информацию о фильмах/сериалах/аниме с Кинопоиска и прочих ресурсов.

Заключение

Не думайте что все выше сказанное это истина в последней инстанции. Я лишь задал направление и описал основные принципы построения такой штуки как домашний сервер. Причем несмотря на объём текста, я что называется «лишь прошел по верхам». Надеюсь вам было интересно это читать. Если у вас появились вопросы, задавайте, буду рад на них ответить, возможно если будет много вопросов продолжу эту тему в другом блоге.

Лучшие комментарии

Я бы хотел внести несколько добавлений от себя.

Производительный проц, это конечно, хорошо. Но тот же 2650v2 — хоть и стоит копейки и дури в нем полно, но производительность для дома, мягко говоря, избыточная а TDP приличный. Перебарщивать тут смысла нет. Я бы, для тех, кто задался целью собрать домашний сервак, смотрел на камни сильно попроще и холоднее. Например 2630l v1|2|3. Под них и материнки есть формата DTX, чтобы собрать компактную систему. Но самый топ для домашних NAS и «гаражных» компов, на текущий момент, это 1260l. Он холодный, достаточно производительный для «бытовых» нужд, со встроенной графикой и под «обычный» сокет 1155. У меня домашний NAS без проблем крутится на E3400, правда и пользуется только как фйалойвая помойка (smb, ftp).

С выбором БП надо быть очень аккуратным. HDD очень чувствительны к качеству питания. Самый дешман брать категорически нельзя. Увлекаться «топовыми» блоками, конечно, тоже не стоит, но все защиты по току в блоке должны быть и емкость выходных конденсаторов по выходу 12V и 5V должна быть приличной. Ну и сами эти кондеры должны быть вменяемые. Не дешманские ChengX и им подобные. (Основной силовой банки это не так сильно касается). Тут при выборе придётся серьёзно покопаться в обзорах и потратить дополнительно денег — но это важно. Диски нынче недешёвые. Хотя, по нынешним временам, можно взять и SSD. У них с требованием к питанию попроще всё.

В охлаждении крайне желательно использовать вентиляторы от 120мм (даже на охлаждении ЦП. Особенно хорошо, если у них и максимальные обороты до 1500. В сочетании с реобасом (тут можно обратить внимание на дешвые китайские трехпозиционные, как правило, этого достаточно) — всё это работает долго и, что немаловажно, тихо. При этом ещё и создает какой-никакой воздушный поток.

Блог действительно полезный. Если кто вдруг считает, что такое ему не надо, подумайте ещё раз. Если есть важные лично вам данные — это очень полезная штука. На фоне цен на восстановление информации (и это если таковая операция будет в принципе возможна), даже недорогая.

Ну и напоследок, для примера, как это компактно можно собрать (на самом деле тупо похвастаться, хотя, по большому счету, это уже дрова во многих смыслах)

https://images.stopgame.ru/uploads/images/212476/form/2022/08/22/65962e9b17386f092b8f5038892bb391.jpg

https://images.stopgame.ru/uploads/images/212476/form/2022/08/22/951a1e5448ba4059f1ec488ce823b5a9.jpg

Да, полностью согласен со всем выше сказанным. И правда, как минимум про TDP надо что нибудь сказать. Я просто когда начал писать этот блог, подумал, ну сейчас пару строк накидаю, расскажу в основном че да как, а оно все пишется, пишется, букв становится уже как-то неприлично много, а сказать по каждому пункту ещё так много надо, поэтому я остановился в какой-то момент, пробежал глазами, увидел что основное было сказано и нажал заветное опубликовать. И писал все чисто под новичка, я потому что по себе помню, когда залетал в эту тему, видел статьи в которых куча терминов, непонятно каких слов и автор со стороны выглядит как профессор магических наук, а ты сидишь такой ээээ куда вставлять sata, порты кончились =) чтооо, мне надо платить 150р сверху в месяц моему провайдеру что бы мы с друзьями могли играть в Майнкрафт, мамочки… И да, маскировка под ящик зачёт, особенно кнопка понравилась, ну и слюни попускал конечно на пурпурные вэдешки.

Я тут могу лишь оперировать своим опытом, до переборки, стоял huanan x79, когда я его увидел впервые, это жесть, компоненты все во флюсе, припой растекщийся, радиатор на мосту не прикручен… Я думал оно вообще не заведется, однако 3 года он отслужил работая 24/7, пока месяц назад дома не выключили свет и когда свет вернулся, к несчастью, ни блок питания, ни хуанан признаков жизни не подали… Сейчас вот пришел этот Atermiter, в плане сборки вопросов ноль, все чисто, красиво, встроенный бипер, экранчик с пост кодами все дела, буду смотреть как он в деле. Вообще, в идеале, если просто хочется попробовать, собирать первый сервак надо из всего что плохо лежит, 775, 478 (хотя ладно, 478 наверное уже не подойдёт), бульдозеры от Amd и так далее. Дальше уже смотреть, если как писал комментатор выше, надо только smb/ftp, то можно сидеть как есть, там какая-то супер мощность не нужна, если уже захочется поднимать свои сервера контры, Майнкрафта, делать суперзащищенное хранилище, вешать камеры наблюдения, а тот же Plex будет перекодировать видео для 5 устройств сразу, ну тут уж при маленьком бюджете только Xeon и вот эти вот платы от дяди Али

Наверно всё-таки дедупликация, а не дуплекация. Вот только зачем он в простенком домашнем NAS’е — не понятно. Этож надо ещё ECC оперативную память ставить. Много памяти. В то время, как без дедупликации хватит и 2 гигов.

На домашем NAS’е, в основном, хранятся фильмы, картинки, дистрибы игр. А они уже в сжатом формате. Так что и сжатие особо не нужно.

Домашний NAS хорошо поднять на чём-нить энергоэффективном, тихом и дешевым. Например, у меня в качестве файлопомойки используется SoC со встроенным процом J1900. Там даже куллер пассивный. И стоит куда меньше.

TrueNas core для домашнего NAS’a тоже избыточен. XigmaNAS, OpenMediaVault или Xpenology — наше всё.

Вообще я считаю что полезно было бы упомянуть что и просто старый комп с парой б/у hdd(берём б/у ведь у нас есть какая-никакая защита от потери данных в виде RAID, но всё же стараемся убитые не брать) вполне пойдёт как сервер для неискушенного пользователя. Ну и я вот вроде показал что я шарю, но на самом деле нет, и потому хочу спросить: как думаете стоит ли собирать сервер на стареньком i5 2400(4 ядра 4 потока, частоты 3.2 ГГц или типа того) и с 8 Гб памяти DDR3(не помню даже в одно- или двухканале), или слабоват будет?

Отсуствие нормально продува внутри корпуса. Между левым кулером и стеной, не больше 3 см, эффективность выдува «крайне мала» как и вероятность «фаер резиста» — крайне мала.

Но судя по всему Вы тоже инженер, добро пожаловать под кат.

Содержимое комода вызывает вопросы в целесообразности. Zotac nforce 610i-itx, socket 775 fsb 1333, ddr2, msata через переходник в качестве системного диска, второй диск 5400 под файлы, БП так не узнаю и отсуствие проводного сетевого подключения. То есть Вы как и автор темы, где-то получили мать+проц и скорее всего msata(это у нас сейчас называется бюджет «шоколадка, пачка чипсов и бутылка тархуна), купили приличный hdd и блок питания, запихнули это все в непродуваемый комод и сейчас сливаете туда файлы с wifi, потому что неуправляемый гигабитный свитч это не для нас. Хотите я Вам, просто за стоимость доставки, отправлю Chieftec BA-01B-B-B-OP?

Не думайте, что я стараюсь Вас обидеть, Вы можете сколько угодно творить любую ерунду, с любым оборудованием, но выкладывать и хвастаться этим — моветон ей-богу.

Всем доброе утро. Уважаемый автор давайте маненько разберемся с Вашей, кхм, идеей. Также в конце сделаю вставку на инженерском языке, там будет специфическая информация.

Вы предлагаете использовать серверный процессор(8 ядер, 16 потоков) для машины, которая будет: хранить файлы, передавать файлы по сети, качать файлы и показывать кино в локалке — это невероятно избыточный подход.

Материнская плата, которой нет в обычных магазинах: citilink, dns, и прочее. Выйдет из строя, и где будете искать замену на сокете 2011-x? Ждать с алиэкспресса от 3х недель или покупать за оверпрайс(в среднем +2000 рублей от цены с алиэкспресс) на авито? Рискованный подход для сервера, который работает 24/7/365. Про платы расширения для увеличения количества подключаемых дисков Вы пошутили я надеюсь, потому что иначе Ваша инженерность трещит по швам.

Видеокарта, тут спорный вопрос, конечно в идеале она нужна только 1 раз, при первичной установке операционной системы, если конечно все по плану пойдет. При современных ценах придется выложить минимум 1500 — 2000 рублей, сомнительная трата «на один раз». Вообще странно, Вы советуете процессор, в котором нет встроенной видеокарты, а потом пишите «Если ваш процессор имеет встроенное видео ядро можно обойтись без видеокарты.»

Вообще странно, что Вы не пишите нормально про охлаждение, про блок питания и главное ПРО корпус. А тут много нюансов, начиная от количество HDD, заканчивая расположением БП и длиной кос c Sata-питанием. «главное, чтобы новый был» — сомнительный совет, выбирая между новым Aerocool KCAS и б\у Chieftec с «металлоприемки» или авито, я выберу Chieftec.

Жесткие диски. О, тут Вы завернули адище какое-то. «Нет денег на новый идите покупайте б/у» — написать такое мог только очень глупый человек, при условии, что БП нужно обязательно новый ибо надежно. Прописная истина — хочешь НАДЕЖНО хранить данные — покупай НОВЫЕ диски и делай резервное копирование. Опять же некорректно написано про TrueNas «не нужно купить 2 жестких диска», а нужно рассчитывать, что ОДИН диск будет использоваться под операционную систему, а ОСТАЛЬНЫЕ диски для хранения файлов. А, да, покупать SSD с алиэкспресса это тоже сомнительный совет, надежности там чуть-чуть.

Про софт ничего писать не буду, тут каждый для себя решает сам, Вы правда зачем-то написали о протоколах для доступа к файлам по сети, они уже лет дцать не меняются.

В целом статья непонятно зачем нужна, какая-то каша из советов по подбору комплектующих и сборке ПК, а также кусочков информации об использовании домашних NAS’ов и хранении/резервном копировании файлов.

Без всяких оскорблений, я надеюсь, что Вы инженер не в сфере IT.

Всем добра и хороших выходных.

P.S. Автору комментария с файлопомойке внутри комода — отдельный дизреспект, если уж собрали «сервачок в комоде», не кидайте его как пример в подобные статьи, научите людей плохому.

x79 + DDR3 в 2022 году это палеонтология какая-то. Почему не x99 + DDR4, бегло нагуглил материнскую плату altermiter x99 turbo d4, она стоит на 800 рублей дешевле, чем то, что предлагает автор. С оперативной памятью та же история, плюс можно найти плату, которая умеет в ECC и non ECC.

А TrueNas Вы выбрали потому что там файловая система ZFS(«архивирование», дедупликация — нужные вещи для файлопойки и медиапроигрывателя)? А добавлять диски/разделы в существующий пул можно? Год назад было нельзя.

Советовать покупать реобас для домашнего сервера, без указания даже примерного количество корпусных вентиляторов — глупость несусветная.

HDD на 80Гб из консоли использовать под ОС на домашнем сервере, Ж — надежность. Вы так хорошо писали про сокеты, оперативную память, но не слова про параметры HDD: скорость вращения шпинделя, черепичную запись, парковку головок и SMART в целом.

Ошибку исправил, спасибо. Ну а касательно раздела, имеется ввиду раздел железо? Ну туда только авторы могут, если я правильно все понимаю, с советующей редактурой и факчекингом. Я то так, рядовой пользователь. Вообще, что называется «интересно» писать, особенно на игровом ресурсе, про железо можно. Интересные рубрики замутить и так далее, ну и гайды естественно, но если гайд/совет написать можно и не имея этого самого «железа» (следующий блог как раз сделаю гайдом такого плана), то вот рубрики которые подразумевают тест игр, уже без этого самого «жедеза» не напишешь, а железо надо либо покупать, что сразу делает бюджет одной статьи неприлично большим, либо как-то выходить на магазины или вендоров, что хрен знает как делается. Не, конечно, на просторах интернета можно найти все тесты, но какой смысл тогда этой статьи, пересказ? В любом случае, спасибо за пожелания, мне правда приятно =)

Начнем с конца, если Вы гуглили о sata-pci контроллерах, то мое опасение, что вы IT’шник испарилось, я выдохнул, спасибо. Едем дальше:

Ваш выбор комплектующих не только исбыточен, они еще вдобавок устарели и продаются за оверпрайс. Хотите избыточности, пожалуйста пишите об актуальном железе и указывайте сразу цены.

Теперь HDD и БП. Придержите челюсть, я выберу 5-7 летний Chieftec с авито, чем новый Aerocool, Exegate, Foxline, и весьма неожиданно, Thermaltake. Потому что я им не доверяю, и покупать раз в 2 года БП не входит в мои планы, пусть даже стоит он до 3 000 рублей. А вероятность, что за «ужаренный Chieftec» умрет и заберет с собой к примеру HDD гораздо ниже, чем хлопок или просадка KCAS’ов по питанию CPU. А вот HDD действительно нужно брать только новые, абсолютно без разницы, что будет на них лежать «Улицы разбитых фонарей», Дом-2 или все фильмы Rocco Siffredi, внезапная потеря данных это всегда неприятно, если Вы с этим не согласны, значит диски у Вас не умирали.

Видеокарта. Тут Вы правы, я не сверился с ценами, сейчас даже gt210 silent можно купить за 1000 рублей.

А теперь самое главное. Если цель Вашей статьи не гайд как собрать и использовать домашний медиасервер, а рассказать людям, какой он у Вас уже есть и как Вы его сделали, то зачем столько ненужных подробностей: серверные процессоры и материнские платы с Алиэкспресс, что-то про память и ее объем, покупка дисков и бп — пишите просто, было вот это, вот это пришлось купить, вот эту ОС поставил, вот так использую, вот фото и скриншоты как пруфы. И сразу набегут те, кому нужен гайд, И Вы напишите этот гайд и будете молодец!

Про бюджет в пачку чипсов, шоколадку и Тархун обидно было, но если все действительно плохо, могу Opteron’ов выслать, там ядер усраться, много чего полезного сделать можно.

Наверное, комментарий про платы расширения был к тому, что платы PCI — SATA на рынке уже лет так дцать, а на современных PCI слотах они размещают по 4 SATA III без потерь. Не говоря уж от PCI Raid картах.

Поддержу инженера. Я тоже инженер, но я инженер телефонии )

Как собрать дешевый сервер

В сознании многих пользователей сервер ассоциируется с высоченным шкафом или хотя бы с корпусом типа Big Tower. Один вид этой конструкции вызывает уважительные мысли о мощи и надежности информационных технологий. Но внешность бывает обманчивой. Случается так, что вся эта махина выполняет функции, которые вполне под силу маленькой китайской коробочке с встроенным Linux-ом, Web-интерфейсом и ценой от 1500 до 6000 рублей за штуку. А если открыть корпус сервера, то иногда обнаруживается. пустота — как в старом шкафе, из которого забрали одежду. Так бывает тогда, когда сервер выполняет в основном представительские функции.

Эта статья не о том, как произвести впечатление на доверчивого пользователя. Разговор пойдет о том, как собрать надежный сервер, достаточный для обслуживания файлового архива и веб-служб в 100-мегабитной сети класса С из 50-200 компьютеров. Такие функции могут выполнять серверы уровня подразделения, которые занимают ценовой диапазон от 45000 до 75000 рублей — за счет применения нескольких процессоров, дисков SCSI с возможностью горячей замены и т.п. На целесообразность применения столь мощных и дорогих серверов зависит от величины рабочей нагрузки, которая в нашем академическом институте невелика. Поэтому мы применяем сервер начального уровня, главная задача которого состоит в надежном хранении данных объемом от 100 гигабайт и выше. Бонус заключается в том, что для сборки сервера начального уровня можно использовать недорогие десктоповые комплектующие и попасть в ценовой диапазон от 30000 до 45000 рублей, а также получить малошумную машину, которую можно поставить в одну комнату с сотрудниками. Такой сервер подойдет не только для офисной сети с небольшой рабочей нагрузкой, но и для отдельной рабочей группы, а при необходимости может выполнять роль рабочей станции с повышенной надежностью хранения данных.

Основное внимание будет уделяться вопросам надежности и стоимости, а также подбору комплектующих для достижения оптимальной производительности; впрочем, обсуждение последнего вопроса не следует рассматривать, как исчерпывающее. В отличие от многих статей, посвященных серверам — здесь не будет тестов на скорость выполнения запросов. Для сервера начального уровня это не столь актуально, потому что к его производительности никакие особенные требования не предъявляются. Т.е. речь идет о задачах, с которыми справляется любой более или менее современный компьютер — такие, как NAT, электронная почта и файловый архив, а также корпоративные Web-сервер и база данных на движке с эпизодической рабочей нагрузкой. А если нагрузка в сети такова, что сервер начального уровня не справляется с поставленными задачами — то нужен полноценный сервер уровня подразделения или организации со всеми вытекающими из этого финансовыми последствиями.

Начнем с небольшой обзорной экскурсии.

Серверы бывают очень разные. На выставках и в преуспевающих фирмах иногда приходится видеть высоченные шкафы, набитые суперсовременной (на момент их изготовления) аппаратурой. Кластеры из многопроцессорных одноплатных серверов, дисковые массивы Fiber Channel, коммутаторы Gigabit Ethernet, самые дорогие процессоры — вот неполный перечень того, что ставит производитель в эти памятники вычислительной технике. Администратор при таком сервере — это полубог, обладающий недоступными простым смертным сертификатами и получающий нереально большую зарплату.

На более скромном уровне стоят серверы в вертикальных корпусах типа «Pedestal». Такой оборудование можно встретить даже в бюджетной организации. Моим первым сервером был Acer Altos 9000 (на рисунке справа), который продали нашему директору по чьему-то совету за немалые деньги. Не шкаф, кончено — но настоящий брендовый Big Tower с блоком питания от Дельты, восемью слотами для горячей установки SCSI дисков и множеством вентиляторов для их обдува. Для расширения предусмотрены восемь слотов ISA и PCI. Память была из четырех SIMM c ECC по 32 мегабайта каждая (а всего слотов — восемь). В качестве интеллекта стоят два Пентиума-200, мощности которых по нынешним временам уже недостаточно: сервер честно тянет разделяемый диск на 20 компьютеров, электронную почту с прикрученным к ней антивирусом и примитивный Web-сайт, но впадает в задумчивость от движка PostNuke.

При желании, Big Tower можно купить в магазине и попытаться собрать сервер самостоятельно. Одна бюджетная организация так и поступила — но бюджетных денег хватило только на корпус, а дальше пришлось экономить. Поэтому в корпус поставили маленькую такую плату micro-ATX на K6-2 и периферию IDE. Нет, сервер до сих пор жив — но за время службы на нем от перегрузки отказали два жестких диска. Но это еще тот анекдот. Здесь компьютер хотя бы пытается выглядеть сервером. А ведь бывает так, что даже этот романтический флер безжалостно отбрасывается!

На другом конце шкалы жизненного преуспевания стоит старый системный блок на первом Пентиуме или втором Селероне, который в силу его полной непригодности для компьютерных игр списали на роль файлового, почтового, модемного, прокси и Web сервера, маршрутизатора, брандмауэра, а также рабочего места администратора, который сидит возле него в дырявых башмаках. К такому серверу обычно прикручивают локальную сеть, построенную на антикварных 10-мегабитных хабах по топологии «очень длинная цепочка». Только не говорите мне, что такая сеть работать не будет. Я и сам знаю, что по теории это работать не может. Но как-то работает.

Вопрос актуален потому, что многие бренды предлагают совсем дешевые серверы начального уровня. Возьмем, к примеру, сервер Compaq ML330. Эту машину, оборудованную процессором Pentium III/900, 256 мегабайтами памяти ECC SDRAM и 9-гигабайтным диском SCSI мне собрали в 2002 году всего за 33500 рублей. Модель ML330e c IDE была еще дешевле — но это не вариант, если принять во внимание ненадежность IDE дисков.

На человека, не избалованного брендовой техникой, сервер Compaq производит сильное впечатление. Начнем с того, что внутри не висят шлейфы — они почти все тщательно сложены и прикреплены к корпусу.

На сиcтемной плате есть два 64-битных и четыре 32-битных разъема PCI. Один из 32-битных разъемов занят платой с видеоадаптером и одноканальным контроллером SCSI. Блок питания на 250 ватт, но от Дельты, что как раз достаточно для сервера на Pentium III. Вентилятор на блоке питания шумит умеренно, но ему помогает оборотистый и шумный вентилятор на задней стенке корпуса.

Подготовка сервера к работе автоматизирована до предела. Если забудешь подключить клавиатуру или что-то еще — BIOS выдает подробные разъяснения на английском. Для форматирования диска и установки операционной системы применяется диск SmartStart. Загружаешься с него, вводишь тип операционной системы и серийный номер, ставишь ее CD — и теперь можно отдыхать — через пару часов сервер будет готов к работе.

Через два часа полета возвращаемся в обыденную действительность. Диск SmartStart годится только для первой установки т.к. он стирает винчестер целиком. Поэтому повторную установку (она потребовалась через месяц экспериментов с новой операционной системой) я делал как обычно. И тут система благополучно вылетела в синеву. Оказывается, диск SmartStart при установке незаметно подкладывает ей специфичный драйвер SCSI. Драйвер пришлось искать на сайте Compaq. Мне до сих пор непонятно — почему не предупредили?

Другое разочарование наступило, когда я принялся искать на сервере порт USB. Его там не было. Ну это не беда, можно добавить. А когда потребовалось установить еще один диск SCSI, пришлось лезть в маленькую корзину, где два места из трех уже были заняты. Никакого вентилятора рядом с корзиной нет, что (парадокс!) не мешает дискам оставаться почти совершенно холодными. Надо отдать должное инженерам Compaq — корпус устроен так, что значительная часть воздуха втягивается в него через корзину с винчестерами. Но вряд охлаждение будет столь же эффективным, если убавить обороты шумного вентилятора на задней стенке системного блока. Еще одно лыко в строку — никаких фильтров нет, поэтому через несколько месяцев платы покрываются густой серой пылью.

Иногда случается так, что сервер стоит не в закрытом помещении, как это принято по соображениям безопасности, а прямо на рабочем месте администратора. В этом случае имеет значение уровень шума, на который производители серверов вплоть до самого недавнего времени не обращали никакого внимания. Посмотрим, можно ли избавиться от этого недостатка при сборке сервера по собственному проекту.

Классические серверные корпуса имеют высокий уровень шума. К примеру, для корпусов Intel SC5200 и SC5250-E он доходит до 55 dB. Можно, кончено, взять шумный корпус и заняться его тюнингом, но еще лучше выбрать корпус, который изначально рассчитан на работу в малошумном режиме, и при этом обеспечивает хорошую вентиляцию процессорной зоны и жестких дисков. Таких корпусов довольно много — почти у каждого производителя есть недорогие модели потребительского класса, которые хорошо подходят для сборки небольшого файлового сервера.

В качестве примера рассмотрим корпус 3R System R101. Сталь 0.8 мм, два корпусных вентилятора на 120 мм каждый, один из которых продувает пять установочных мест для винчестеров внизу корпуса. Три термопары, шестиступенчатая регулировка вентиляторов вручную или на автомате, настраиваемое отключение при перегреве в диапазоне 50-85 градусов с шагом 5. И полная бесшумность при работе корпусных вентиляторов на минимальной скорости. Что еще нужно для сервера? Разве что иметь еще один вентилятор на боковой стенке около процессора :).

Обратите внимание на то, что установочные места для винчестеров находятся за вентилятором. Это очевидное, но почему-то не слишком распространенное решение позволяет отказаться от установки дополнительных кулеров на каждом винчестере.

При более близком знакомстве становятся заметны недостатки. Увы, их довольно много, поэтому R101 нельзя назвать лучшим выбором для сервера:

Инструкцию по установке корпуса и настройке автоматики можно найти на сайте 3R System. Там же есть описания альтернатив R101, которые выглядят не столь эффектно, но зато лучше продуманы с конструктивной точки зрения. Интересна модель с фильтром от пыли 3R AIR, а также более дешевая 3R NEON Light, у которой спереди есть дополнительные вентиляционные отверстия и нет столь большой и бестолковой платы автоматики. Среди продукции других производителей можно отметить недорогой, но качественный ASUS Ascot 6AR/300, а также разнообразную продукцию Chieftec и малошумные серверные корпуса Yeong Yang.

Корпуса 3R поставляются без блока питания или в комплектации с блоком питания RPS, который снабжен абсолютно бесшумным боковым вентилятором размером 120 мм. Это идеальное решение как для обдува платы блока питания, так и для вентиляции процессорной зоны. Номинал блоков питания RPS — 300, 350 или 400 ватт; мне достался блок RPS300:

Со всеми проводами блок весит примерно 1.5 килограмма. Помимо стандартного, 12-вольтового и AUX-разъема имеются два разъема FDD, шесть разъемов Molex и переходник на два разъема Serial ATA. Провода AWG18. Заявление нагрузочные характеристики соответствуют фактическим, выходные напряжения отвечают стандарту ATX. Все хорошо, кроме одного — блок слабоват по линии +12V.

Основные потребители +12V — это процессор и внешние накопители. С учетом КПД регулятора напряжения на системной плате, для Pentium-2400С резервируется 8A (96 ватт), каждый внешний накопитель берет до 1A. У меня 3 диска и 1 CD-RW. Еще пара ампер уходит на питание вентиляторов, платы автоматики и разной мелочи на системной плате и видеокарте. В сумме получается 14A, в то время как блок питания дает до 12A. Его спасает от перегрузки только то, что процессор и накопители не берут свой максимальный ток одновременно.

В отличие от бытовой техники, серверы принято собирать с запасом по мощности — поэтому вместо 300-ваттного блока питания нужен, как минимум, 350-ваттный (на всякий случай оговорюсь, что речь идет о нормальном 350-ваттном блоке питания, а не о дешевых имитациях). Чтобы не изменять схему вентиляции в корпусe, я выбрал на замену блок питания FSP350-60PN:

Основное назначение файлового сервера — это хранение данных, которые надо защитить от утраты в случае аппаратной неисправности. Другое требование состоит в оперативной выдаче данных по запросам с клиентских рабочих мест. В нашем конкретном случае основная рабочая нагрузка приходится на файловый архив с документами, программами, презентациями и другими относительно редко востребуемыми файлами. Поэтому нас будет интересовать прежде всего надежность хранения данных, после этого — затратность и в самую последнюю очередь — производительность.

Диски SCSI быстры и надежны, но стоят дорого. Бытовые диски с интерфейсом ATA дешевы, но в файловом сервере живут недолго. Заверения производителей про диски Serial ATA самые радужные — MTBF у них вдвое выше, чем у ATA (1,000,000 часов против 500,000) и производительность приближается к производительности дисков SCSI. Но данные заверения надо воспринимать с поправкой на то, что предполагается применение дисков в бытовых условиях, а не круглосуточная эксплуатация на сервере под интенсивной нагрузкой. Среди немногих исключений — серверные диски Seagate NL35 и Barracuda ES (7200 RPM, 200-750G), Maxtor MaxLine II Plus (5400 RPM) и Western Digital Caviar RE (RAID Edition, 7200 RPM, 120-500G), которые рассчитаны на непрерывную работу в режиме 24*7.

Характеристики малошумных жестких дисков с объемом до 160-200 гигабайт собраны здесь: Винчестеры с пониженным шумом и тепловыделением. Многие производители предлагают диски большего объема — вплоть до 400 гигабайт; такие диски обычно шумят на 2-3 dB сильнее, чем соответствующие модели небольшого объема.

Самая последняя новость в мире Serial ATA — это поддержка очереди команд для оптимизации перемещения головок. По оценкам Intel и Seagate, очередь команд дает 30% рост производительности и сокращает нагрузку на привод головок накопителя. В версии SCSI эта технология называется TCQ (Tagged Command Queuing) и реализуется аппаратно; Serial ATA диски WD Raptor реализуют TCQ на микропрограммном уровне. Для недорогих дисков Serial ATA разработана облегченная версия NCQ (Native Command Queuing).

Очередь команд нуждается в соответствующей поддержке со стороны контроллера Serial ATA, с которой дело пока обстоит не густо — она имеется только на некоторых самых современных системных платах и внешних контроллерах для шины PCI. В частности, Intel обеспечила поддержку NCQ в чипсетах для Socket 775 с южным мостом ICH6R, NVidia — в чипсетах nForce4 Ultra/SLI для Athlon 64 и nForce4 IE для Pentium 4. Определенные надежды могут быть связаны и с имеющимися системными платами и контроллерами, на которых установлены чипы Silicon Image Sil3512 и Sil3114, т.к. для этих чипов производитель обещает выпуск драйверов с программной поддержкой NCQ.

Чтобы собрать надежную дисковую систему, берем два недорогих диска Serial ATA (в нашем случае это будет Seagate Barracuda 7200.7) и создаем на них отказоустойчивый массив по технологии RAID 1. Это значит, что информация продублирована на обоих дисках и выход из строя одного из дисков не приводит к потере данных. Такое решение дешевле, чем установка одного соответствующего по объему диска SCSI, хотя и будет уступать ему по производительности. Кроме того, выбранные нами диски не рассчитаны на круглосуточную работу — поэтому можно ожидать, что срок их службы будет ограничен и диски придется периодически менять. Процедура замены выглядит таким образом: достаем отказавший диск, ставим новый и запускаем встроенную в контроллер RAID процедуру копирования для восстановления массива RAID 1. На время замены диска и восстановления массива сервер выводится из эксплуатации.

Производительность дискового массива RAID 1 будет выше производительности одиночного диска, если контроллер реализует чередование обращений к дискам — примером может служить Архитектура 3Ware TwinStor. Контроллер с чередованием распределяет запросы на чтение данных между дисками, исходя из текущего положения блоков магнитных головок, при этом чтение с двух дисков может выполняться одновременно, т.к. каналы Serial ATA независимы друг от друга.

Но даже с учетом чередования, производительность нашего массива RAID 1 недалеко уходит от уровня дисковой подсистемы обыкновенного бытового компьютера. Это приемлемо только при умеренной рабочей нагрузке; если же предполагается интенсивная работа с промышленными базами данных, системами потокового видео и т.п., тo производительности может элементарно не хватить, не говоря уж о том, что отказавшие от непомерной нагрузки диски придется менять, как перчатки.

Для повышения производительности вместо дисков на 7200 RPM можно использовать диски WD Raptor на 10000 RPM (но это будет дороже, чем один диск SCSI). Более дешевый способ поднять производительность — поставить диски с NCQ и подобрать соответствующий контроллер.

Дисковые массивы RAID 1 отличаются простотой и надежностью, но не рекордно высокой производительностью. Для создания скоростных дисковых массивов применяется технология RAID 0 с чередованием секторов на двух или нескольких дисках. В результате получается один большой логический диск, производительность которого растет почти пропорционально числу физических дисков. Благодаря высокой производительности, технология RAID 0 активно обсуждается в компьютерных журналах. Но для наших целей она неинтересна, т.к. снижает и без того невысокую надежность хранения данных на бытовых дисках. Зато может пригодиться комбинированная технология RAID 0+1 или RAID 10, когда заводится четыре диска и на одной паре делается чередование секторов, а на другой — зеркало первой пары. Эта комбинация сочетает высокую производительность и отказоустойчивость. Более экономичная технология Intel MST (Matrix Storage Technology), поддержанная также RAIDCore/Broadcom, позволяет сочетать технологии RAID 0 и RAID 1 всего на двух дисках. Для этого на каждом диске создаются два раздела — один для массива RAID 0 и другой для массива RAID 1. Резервирование обеспечивается только для раздела RAID 1.

Кроме упомянутых простых вариантов RAID, существует большое количество более сложных, среди которых наиболее известен RAID 5. В массив RAID 5 объединяются несколько дисков c чередованием секторов (от 3 и более), из которых только один содержит избыточную информацию, получаемую путем суммирования секторов с данными по XOR. Эта технология обеспечивает отказоустойчивость при меньших накладных расходах на резервные диски. RAID 5 имеет невысокую производительность при записи, в то время как производительность при чтении примерно соответствует RAID 0.

Массивы RAID 0, 1 и 5 поддерживаютcя программно в некоторых операционных системах, в их числе — Linux и серверные операционные системы Microsoft. Реализация RAID во Windows 2000/2003 несовместима с реализацией RAID во Windows NT, но зато позволяет создавать загрузочные разделы c RAID 1. С формальной точки зрения этого вполне достаточно для построения отказоустойчивых систем, но для достижения большей надежности и производительности предпочтительнее аппаратная реализация RAID.

Многие материнские платы обладают встроенной поддержкой RAID уровней 0, 1 и в некоторых случаях 0+1(10). Данный RAID иногда называют аппаратным, но это не более, чем недоразумение. В популярных решениях от Promise, Intel, SIS и VIA функциональность RAID реализована в драйверах, при этом аппаратура выполняет функции контроллера Serial ATA и плюс к этому имеет регистры для взаимодействия с драйвером RAID. Т.е. речь идет о преимущественно программном RAID-е, при котором специфичные операции выполняются на центральном процессоре. Судя по тому, что загрузка процессора бывает невысокой — по разным тестам от 0.5% до 25%, такой подход можно считать оправданным. Аппаратное ускорение RAID впервые былом заявлено в чипсете NVidia nForce3 250 для Athlon 64, причем без уточнения деталей («The combination of hardware acceleration and optimized software architectures adds up to superior performance»).

Наибольший опыт в программном RAID имеет Promise, которая довольно давно применяет его в своих внешних контроллерах серии FastTrak — именно оттуда ее чипы перекочевали на материнские платы. Интересно отметить, что контроллеры FastTrak некогда имели репутацию аппаратных, благо и сам производитель не считал нужным распространяться о деталях реализации.

Производительности контроллера зависит главным образом от эффективного управления дисками (в это плане упоминались поддержка очереди команд и чередование запросов в RAID 1), а также от скорости обмена данными с оперативной памятью. Скорость обмена зависит от того, где находится контроллер — в чипсете или в отдельном чипе. В последнем случае чип обычно подключается к шине PCI, которая обладает ограниченной пропускной способностью (133 MB/s). Впрочем, пропускной способности PCI вполне хватает для обслуживания двух не слишком быстрых дисков в массиве RAID уровня 0 или 1. Есть только одно но — это гигабитный сетевой контроллер, который обычно тоже сидит на шине PCI и может откусить от нее до 125 MB/s. Если он будет работать при предельной нагрузке, то на долю дискового массива останется всего ничего.

Производительность увеличится, если хотя бы один контроллер (RAID или гигабитный сетевой) будет подключен в обход PCI на более скоростную шину. На эту тему есть гигабитные сетевые чипы Intel 82547EI для CSA (266 MB/s) и Marvel Yukon 88E8050 для PCI Express X1 (512 MB/s). Из дискретных чипов Serial ATA RAID можно упомянуть JMicron JMB363/366 для PCI Express X1, который часто встречается на современных бюджетных платах для Socket 775 и AM2.

Пропускная способность PCI становится недостаточной при создании массивов из большого числа дисков, например, по технологии RAID 0+1. Походящий для них уровень производительности могут обеспечить контроллеры, встроенные в чипсет — если они подключаются к скоростным внутренним шинам. Но и здесь можно встретить контроллеры, полученные простым встраиванием в чипсет дискретных решений с интерфейсом PCI. Вот хороший обзор на эту тему: Chipset Serial ATA and RAID performance comparison.

Теперь о внешних контроллерах. Самый дешевые — Promise FastTrak S150 TX2plus, S150 TX4 и их многочисленные аналоги идеологически ничем не отличаются от интегрированных — то же самое сочетание аппаратного контроллера жестких дисков и программного RAID на драйвере. В пользу данных внешних контроллеров говорит разве что возможность установки на шину PCI/66 с пропускной способностью 266 MB/s, если она поддерживается материнской платой.

К более продвинутым относятся внешние контроллеры с поддержкой RAID 5, в их числе — Promise FastTrak S150 SX4 и различные платы с применением оптимизированных под RAID 0 чипов Silicon Image Sil3112, Sil3114 и аппаратного XOR-процессора. Здесь речь идет об аппаратно-программном решении, т.к. XOR-процессор берет на себя вычисление контрольных сумм RAID 5. Для ускорения работы на плату устанавливается буферная память и задействуются скоростные расширения шины PCI. Многие контроллеры допускают установку и на десктоповую шину PCI, но их производительность в этом режиме будет не особенно высокой.

Десктоповая шина PCI (32 bit, 33 MHz, 133 MB/s) не подходит для скоростных контроллеров, т.к. при объединении диcков в массив RAID скорость передачи данных суммируется. К примеру, теоретическая скорость передачи данных с 5 дисков Serial ATA в массиве RAID 5 будет равна 600 (4*150) MB/s, реальная скорость доходит до 220 MB/s: см. Тесты масштабирования RAID 5: от трёх до восьми жёстких дисков.

Полностью аппаратный RAID встречается в контроллерах с микропроцессорами, применение которых оправдано при наличии большого числа дисков, повышенных требований к готовности и т.п — современными примерами такого решения являются чипы Broadcom BCM 5773 и 8603.

Как показывает практика, высокой надежностью обладают реализации RAID в специализированных чипах. Чипсетный RAID тоже бывает надежен, но при условии, что производитель чипсета имеет опыт разработки специализированных чипов — в качестве примера можно привести VIA. А вот NVidia RAID имеет свойство «разваливаться» без особых на то причин, из чего можно сделать вывод о том, что NVidia реализовала функции RAID для «галочки», а не для работы. Выбор конкретного решения зависит и от требуемой производительности. Если ограничиться созданием одиночного массива RAID 1 и не задействовать гигабитную сеть, то для этой цели подойдет любая материнская плата со встроенным контроллером — именно это решение будет оптимальным по стоимости. При наличии более высоких требований к производительности надо будет принять во внимание такие технические характеристики, как ширина внешней шины и поддержка протоколов RAID высокого уровня. Вот известные мне чипы Serial ATA RAID, которые применяются (или могут применяться) на материнских платах и недорогих внешних контроллерах.

Таблица 1: Одночиповые контроллеры с поддержкой Serial ATA RAID

В колонке Чередование в RAID 1 помечены чипы, которые благодаря чередованию запросов хотя бы в одном тесте работают с массивом RAID 1 быстрее, чем с одиночным диском. Эффективной реализацией RAID 1 и 0+1 обладают чипсеты NVidia: благодаря оптимизации последовательного чтения RAID 0+1 показывает невероятную скорость чтения в Burst Mode — до 320 MB/s по ATTO, а общая производительность RAID 1 и 0+1 в тестах IOMeter аналогична производительности соответствующих по числу дисков массивов RAID 0. Отлично реализован RAID 1 и в чипсетах (точнее — в драйвере) Intel. В драйверах RAID от Promise оптимизирован только случайный доступ, в то время как последовательное чтение идет на одинарной скорости.